IntRec: Intent-based Retrieval with Contrastive Refinement

作者: Pourya Shamsolmoali, Masoumeh Zareapoor, Eric Granger, Yue Lu

分类: cs.CV

发布日期: 2026-02-19

💡 一句话要点

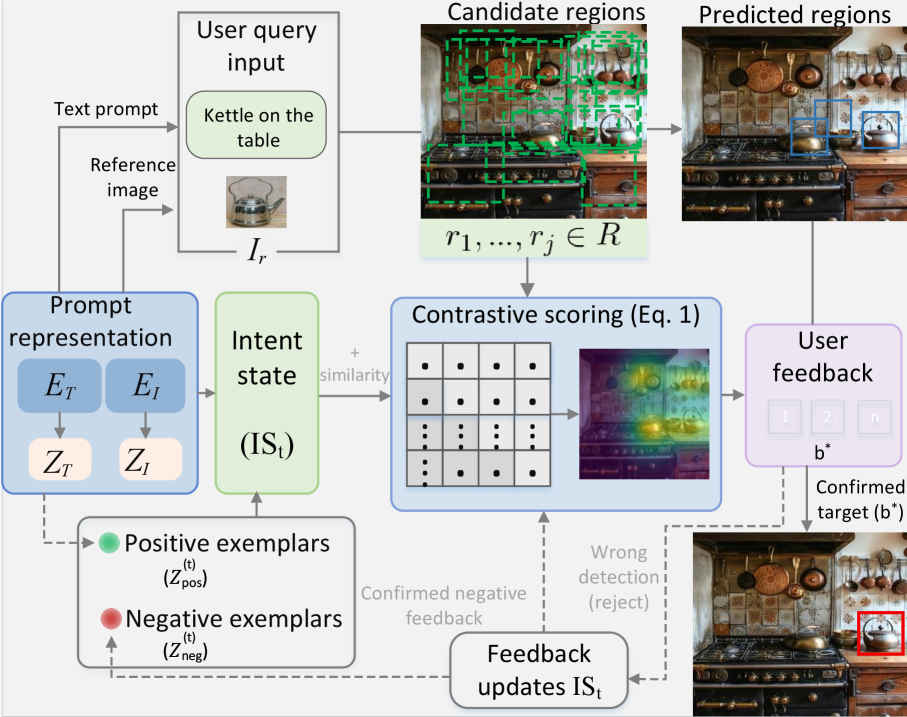

提出IntRec交互式目标检索框架,通过对比精炼用户意图提升复杂场景下的检索精度。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 交互式检索 开放词汇检测 对比学习 用户反馈 意图状态

📋 核心要点

- 现有开放词汇检测器缺乏利用用户反馈迭代优化预测的能力,导致复杂场景下检索精度不足。

- IntRec维护正负锚点双重记忆集,通过对比对齐函数,根据用户反馈迭代精炼检索结果。

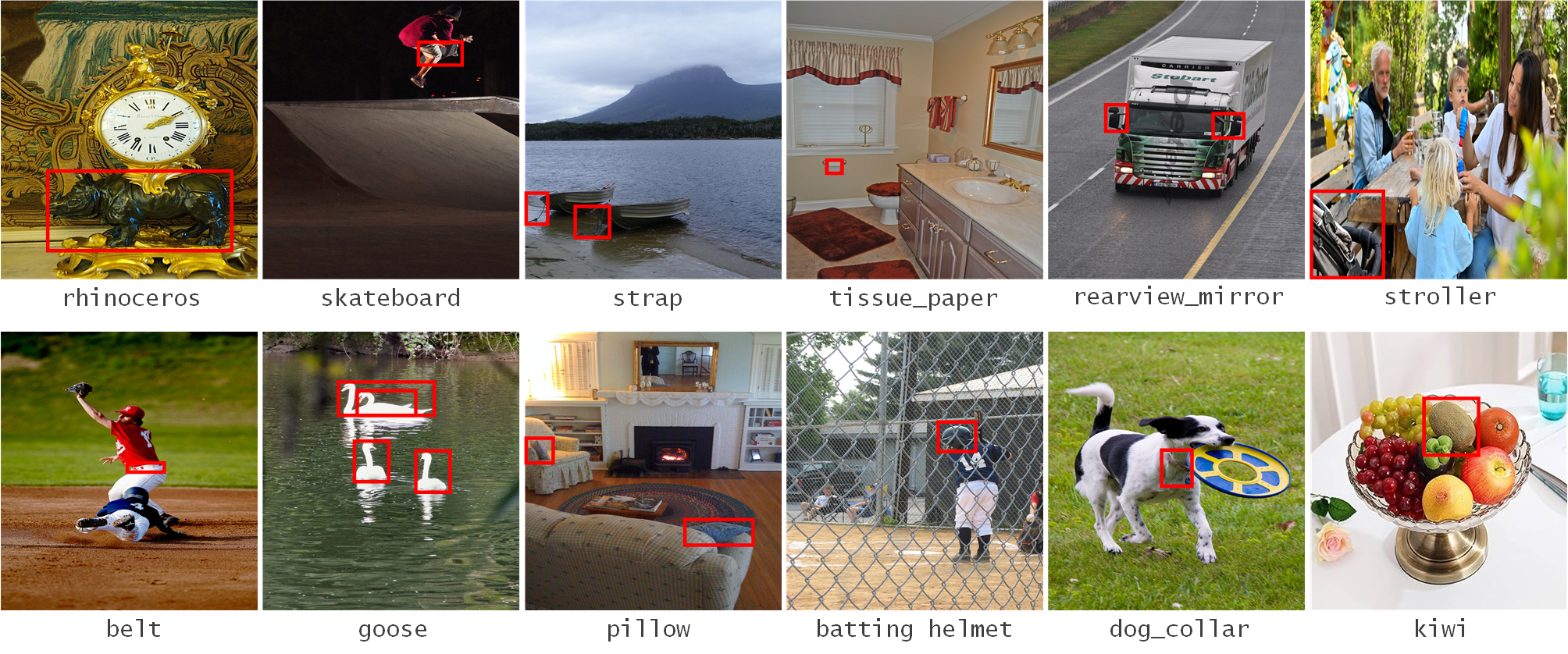

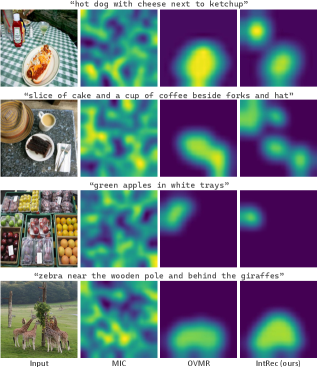

- 实验表明,IntRec在LVIS和LVIS-Ambiguous数据集上显著提升了检索精度,且交互延迟较低。

📝 摘要(中文)

从复杂场景中检索用户指定的目标是一项具有挑战性的任务,尤其是在查询模糊或涉及多个相似目标时。现有的开放词汇检测器以一次性方式运行,缺乏基于用户反馈来改进预测的能力。为了解决这个问题,我们提出了IntRec,一个交互式目标检索框架,可以根据用户反馈来改进预测。其核心是一个意图状态(IS),它维护了用于正锚点(已确认线索)和负约束(已拒绝假设)的双重记忆集。对比对齐函数通过最大化与正线索的相似性,同时惩罚被拒绝的线索来对候选对象进行排序,从而能够在杂乱的场景中进行细粒度的消除歧义。我们的交互式框架在没有额外监督的情况下,显著提高了检索精度。在LVIS上,IntRec达到了35.4 AP,分别超过OVMR、CoDet和CAKE +2.3、+3.7和+0.5。在具有挑战性的LVIS-Ambiguous基准测试中,经过一次纠正性反馈后,其性能比一次性基线提高了+7.9 AP,每次交互增加的延迟不到30毫秒。

🔬 方法详解

问题定义:论文旨在解决开放词汇目标检测中,在复杂场景下,由于查询模糊或存在多个相似目标,现有方法难以准确检索用户指定目标的问题。现有方法通常采用一次性检测,无法利用用户反馈进行迭代优化,导致检索精度受限。

核心思路:论文的核心思路是构建一个交互式的目标检索框架,通过维护一个意图状态(Intent State, IS),记录用户对检索结果的肯定和否定反馈,并利用这些反馈信息来迭代改进检索结果。这种方法模拟了人与人之间的交互过程,通过不断澄清用户意图来提高检索的准确性。

技术框架:IntRec框架主要包含以下几个模块:1) 图像特征提取模块:用于提取输入图像的视觉特征。2) 文本特征提取模块:用于提取用户查询的文本特征。3) 意图状态(IS)模块:维护正锚点(已确认线索)和负约束(已拒绝假设)的双重记忆集,用于记录用户反馈。4) 对比对齐模块:通过对比学习的方式,计算候选目标与正锚点之间的相似度,以及与负约束之间的差异度,从而对候选目标进行排序。5) 交互模块:接收用户反馈,并更新意图状态。

关键创新:IntRec的关键创新在于引入了意图状态(IS)的概念,并利用对比学习的方式,将用户反馈融入到目标检索过程中。与现有方法相比,IntRec能够更好地理解用户意图,并根据用户反馈进行迭代优化,从而显著提高检索精度。

关键设计:意图状态(IS)采用双重记忆集的设计,分别存储正锚点和负约束。对比对齐模块采用对比损失函数,鼓励候选目标与正锚点之间的相似度最大化,同时与负约束之间的相似度最小化。交互模块采用简单的点击反馈机制,用户可以通过点击图像中的目标来确认或拒绝检索结果。

🖼️ 关键图片

📊 实验亮点

IntRec在LVIS数据集上取得了显著的性能提升,达到了35.4 AP,超过了OVMR、CoDet和CAKE等基线方法。在更具挑战性的LVIS-Ambiguous数据集上,经过一次纠正性反馈后,IntRec的性能比一次性基线提高了+7.9 AP,且每次交互增加的延迟不到30毫秒,表明该方法具有较高的效率和实用性。

🎯 应用场景

IntRec可应用于智能安防、智能家居、人机交互等领域。例如,在智能安防中,用户可以通过语音或文本描述目标,并根据系统反馈进行修正,从而快速定位可疑人员或物品。在智能家居中,用户可以通过交互式的方式控制家电设备,提高用户体验。该研究的交互式检索框架具有广泛的应用前景,能够提升人机交互的效率和准确性。

📄 摘要(原文)

Retrieving user-specified objects from complex scenes remains a challenging task, especially when queries are ambiguous or involve multiple similar objects. Existing open-vocabulary detectors operate in a one-shot manner, lacking the ability to refine predictions based on user feedback. To address this, we propose IntRec, an interactive object retrieval framework that refines predictions based on user feedback. At its core is an Intent State (IS) that maintains dual memory sets for positive anchors (confirmed cues) and negative constraints (rejected hypotheses). A contrastive alignment function ranks candidate objects by maximizing similarity to positive cues while penalizing rejected ones, enabling fine-grained disambiguation in cluttered scenes. Our interactive framework provides substantial improvements in retrieval accuracy without additional supervision. On LVIS, IntRec achieves 35.4 AP, outperforming OVMR, CoDet, and CAKE by +2.3, +3.7, and +0.5, respectively. On the challenging LVIS-Ambiguous benchmark, it improves performance by +7.9 AP over its one-shot baseline after a single corrective feedback, with less than 30 ms of added latency per interaction.