4D Monocular Surgical Reconstruction under Arbitrary Camera Motions

作者: Jiwei Shan, Zeyu Cai, Cheng-Tai Hsieh, Yirui Li, Hao Liu, Lijun Han, Hesheng Wang, Shing Shin Cheng

分类: cs.CV

发布日期: 2026-02-19

备注: Due to the limitation "The abstract field cannot be longer than 1,920 characters", the abstract here is shorter than that in the PDF file Subjects

🔗 代码/项目: GITHUB

💡 一句话要点

提出Local-EndoGS,解决任意相机运动下单目内窥镜手术场景的4D重建问题

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 4D重建 单目视觉 内窥镜 手术场景 形变重建

📋 核心要点

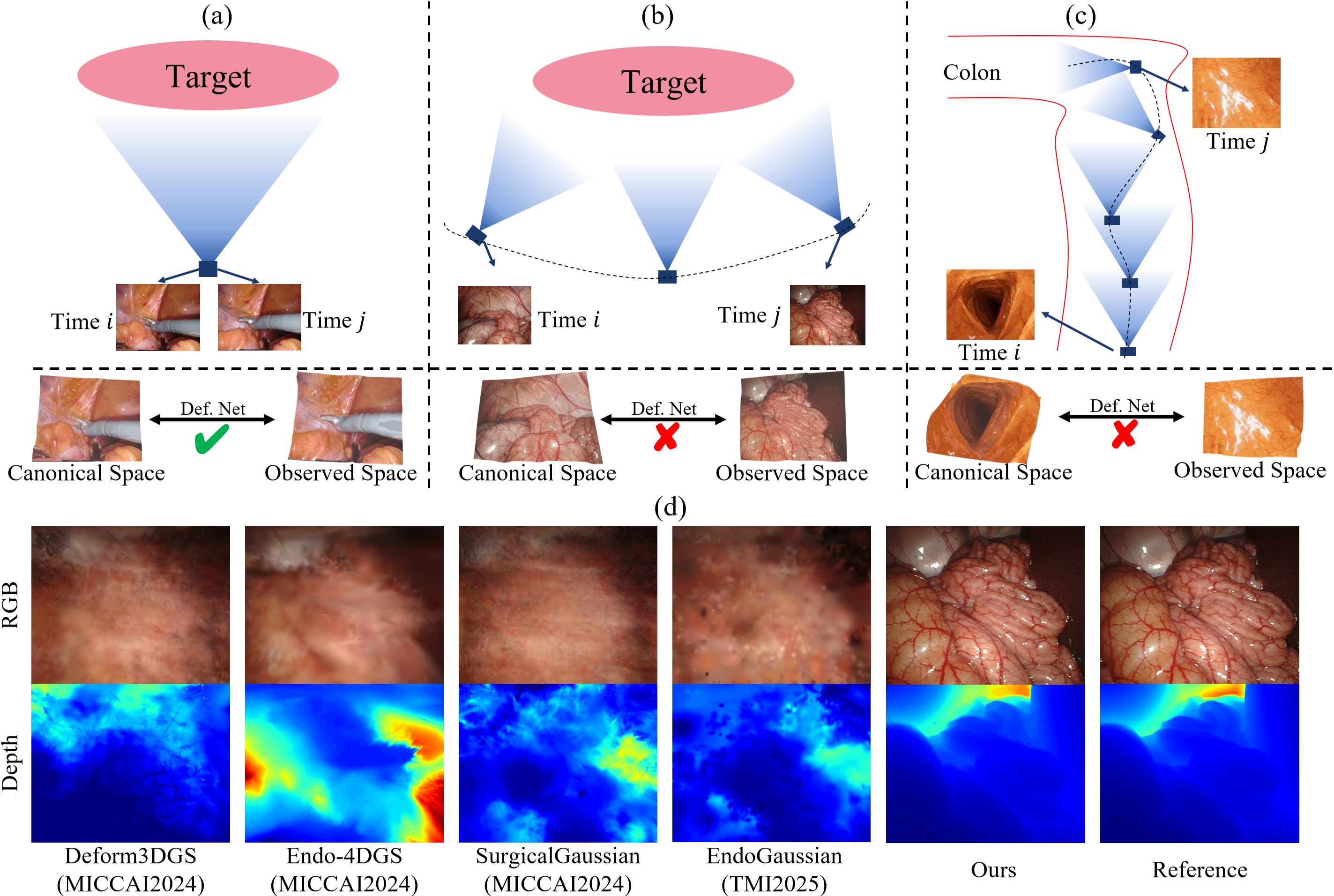

- 现有内窥镜视频重建方法依赖立体深度或精确的运动结构恢复,难以处理真实临床场景中大幅相机运动的单目视频。

- Local-EndoGS采用渐进式窗口全局表示,结合多视角几何、跨窗口信息和单目深度先验,实现稳健的初始化和优化。

- 实验表明,Local-EndoGS在外观质量和几何精度上优于现有方法,并通过消融实验验证了关键设计的有效性。

📝 摘要(中文)

本文提出Local-EndoGS,一个高质量的4D重建框架,用于处理任意相机运动下的单目内窥镜序列。现有方法通常针对固定视角的形变场景,依赖立体深度先验或精确的运动结构恢复进行初始化和优化,难以应对真实临床环境中大幅相机运动的单目序列。Local-EndoGS引入了一种渐进式的、基于窗口的全局表示,为每个观察窗口分配局部形变场景模型,从而扩展到具有显著运动的长序列。为了克服在缺乏立体深度或精确运动结构恢复的情况下不可靠的初始化问题,本文设计了一种由粗到精的策略,整合了多视角几何、跨窗口信息和单目深度先验,为优化提供了稳健的基础。此外,还结合了长程2D像素轨迹约束和物理运动先验,以提高形变的合理性。在三个公共内窥镜数据集上的实验表明,Local-EndoGS在外观质量和几何精度方面始终优于现有方法。消融研究验证了关键设计的有效性。

🔬 方法详解

问题定义:论文旨在解决单目内窥镜视频中,在任意相机运动下,对形变手术场景进行高质量4D重建的问题。现有方法主要依赖于立体视觉或者精确的Structure-from-Motion (SfM) 初始化,这在单目内窥镜场景中,尤其是在相机运动剧烈的情况下,难以保证重建的准确性和鲁棒性。此外,现有方法通常针对固定视角的场景,难以扩展到长序列的重建。

核心思路:论文的核心思路是采用一种局部到全局的重建策略,将长序列分割成多个窗口,每个窗口内构建一个局部的形变场景模型,然后通过跨窗口的信息传递和优化,实现全局一致的4D重建。这种方法可以有效应对相机的大幅运动,并提高重建的鲁棒性。

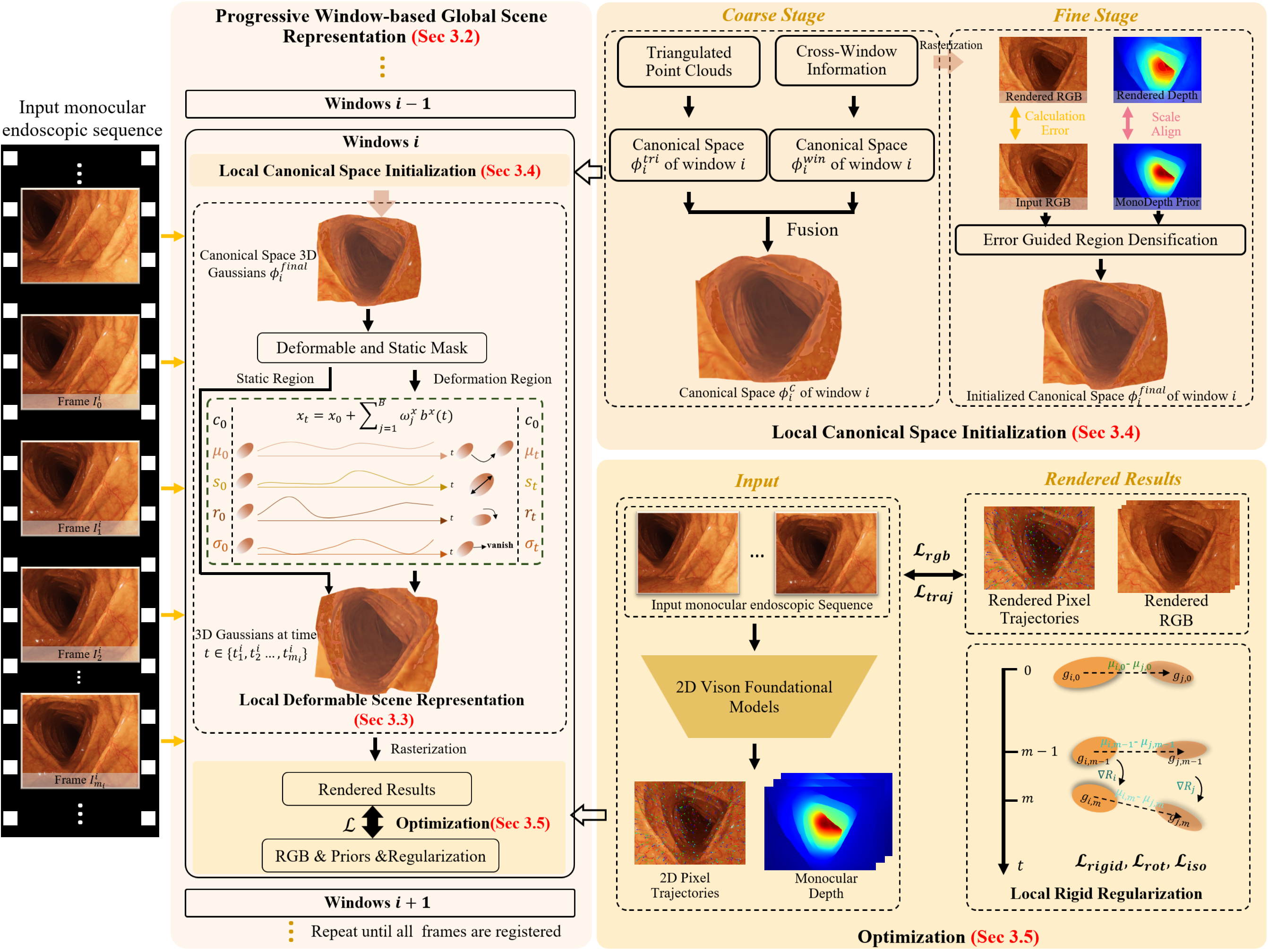

技术框架:Local-EndoGS的整体框架包含以下几个主要阶段:1) 窗口分割:将长序列分割成多个窗口。2) 局部场景初始化:对每个窗口,利用多视角几何、跨窗口信息和单目深度先验进行由粗到精的初始化。3) 局部场景优化:在每个窗口内,利用2D像素轨迹约束和物理运动先验,对局部场景进行优化。4) 全局一致性:通过跨窗口的信息传递和优化,保证全局重建的一致性。

关键创新:论文的关键创新在于:1) 提出了一种渐进式的、基于窗口的全局表示,可以有效处理长序列和大幅相机运动。2) 设计了一种由粗到精的初始化策略,可以克服在缺乏立体深度或精确SfM的情况下不可靠的初始化问题。3) 结合了长程2D像素轨迹约束和物理运动先验,提高了形变的合理性。

关键设计:在初始化阶段,论文采用了一种由粗到精的策略,首先利用多视角几何信息进行粗略的初始化,然后利用跨窗口的信息进行精细化,最后利用单目深度先验进行进一步的优化。在优化阶段,论文设计了一种基于2D像素轨迹的约束,可以有效约束形变的运动轨迹。此外,论文还引入了物理运动先验,例如平滑性约束,以提高形变的合理性。具体的损失函数包括重建损失、深度损失、轨迹损失和物理运动损失等。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Local-EndoGS在三个公共内窥镜数据集上,均优于现有的state-of-the-art方法。在外观质量方面,Local-EndoGS的PSNR和SSIM指标均有显著提升。在几何精度方面,Local-EndoGS的Chamfer Distance和Normal Consistency指标也优于其他方法。消融实验验证了各个关键设计的有效性。

🎯 应用场景

该研究成果可应用于计算机辅助手术、手术机器人导航、医生培训和术后分析等领域。通过提供准确的4D手术场景重建,可以帮助医生更好地理解手术过程,提高手术精度和安全性,并为手术机器人的自主操作提供可靠的环境感知。

📄 摘要(原文)

Reconstructing deformable surgical scenes from endoscopic videos is challenging and clinically important. Recent state-of-the-art methods based on implicit neural representations or 3D Gaussian splatting have made notable progress. However, most are designed for deformable scenes with fixed endoscope viewpoints and rely on stereo depth priors or accurate structure-from-motion for initialization and optimization, limiting their ability to handle monocular sequences with large camera motion in real clinical settings. To address this, we propose Local-EndoGS, a high-quality 4D reconstruction framework for monocular endoscopic sequences with arbitrary camera motion. Local-EndoGS introduces a progressive, window-based global representation that allocates local deformable scene models to each observed window, enabling scalability to long sequences with substantial motion. To overcome unreliable initialization without stereo depth or accurate structure-from-motion, we design a coarse-to-fine strategy integrating multi-view geometry, cross-window information, and monocular depth priors, providing a robust foundation for optimization. We further incorporate long-range 2D pixel trajectory constraints and physical motion priors to improve deformation plausibility. Experiments on three public endoscopic datasets with deformable scenes and varying camera motions show that Local-EndoGS consistently outperforms state-of-the-art methods in appearance quality and geometry. Ablation studies validate the effectiveness of our key designs. Code will be released upon acceptance at: https://github.com/IRMVLab/Local-EndoGS.