EAGLE: Expert-Augmented Attention Guidance for Tuning-Free Industrial Anomaly Detection in Multimodal Large Language Models

作者: Xiaomeng Peng, Xilang Huang, Seon Han Choi

分类: cs.CV

发布日期: 2026-02-19

🔗 代码/项目: GITHUB

💡 一句话要点

EAGLE:专家增强注意力引导,用于多模态大语言模型中免调优的工业异常检测

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 工业异常检测 多模态大语言模型 注意力引导 免调优学习 可解释性 智能制造

📋 核心要点

- 现有深度学习异常检测方法通常只能给出二元判断,缺乏细粒度的语义解释,限制了其在工业场景中的应用。

- EAGLE框架通过集成专家模型的输出,引导多模态大语言模型关注异常区域,从而实现更准确和可解释的异常检测。

- 实验表明,EAGLE无需微调即可提升多个MLLM在MVTec-AD和VisA数据集上的异常检测性能,达到与微调方法相当的水平。

📝 摘要(中文)

工业异常检测对于智能制造至关重要,但许多深度学习方法仅产生二元决策,且提供的语义解释有限。多模态大语言模型(MLLM)有潜力生成细粒度的、基于语言的分析,然而,现有方法通常需要昂贵的微调,并且与轻量级专家检测器相比,并不能持续提高异常检测的准确性。我们提出了用于MLLM工业异常检测的专家增强注意力引导(EAGLE),这是一个免调优的框架,它集成了专家模型的输出,以引导MLLM实现准确的检测和可解释的异常描述。我们进一步研究了EAGLE如何影响MLLM的内部结构,通过检查MLLM中间层中对异常图像区域的注意力分布。我们观察到,成功的异常检测与异常区域上注意力集中度的增加有关,而EAGLE倾向于鼓励这种对齐。在MVTec-AD和VisA上的实验表明,EAGLE在没有任何参数更新的情况下,提高了多个MLLM的异常检测性能,实现了与基于微调的方法相当的结果。

🔬 方法详解

问题定义:工业异常检测旨在自动识别生产过程中出现的缺陷或异常情况。现有基于深度学习的方法,特别是那些依赖于二元分类的方法,往往缺乏对异常原因的解释能力,难以满足智能制造对可解释性和可信赖性的需求。多模态大语言模型虽然具备生成语言描述的潜力,但直接应用通常需要昂贵的微调,且效果不稳定。

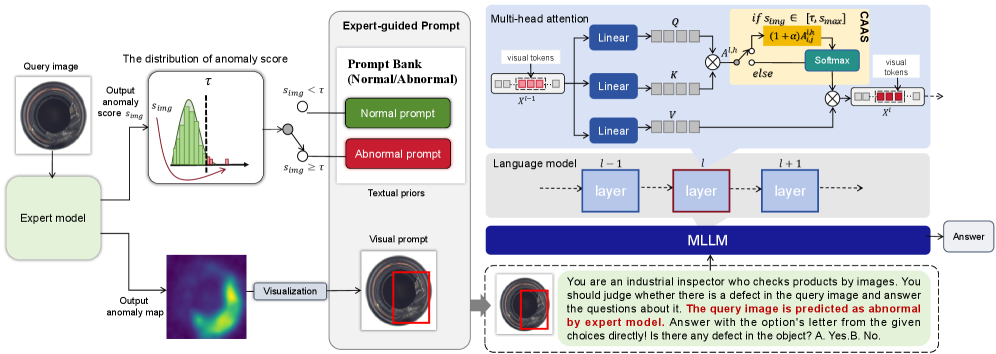

核心思路:EAGLE的核心思路是利用领域专家模型(或轻量级检测器)的先验知识,通过注意力引导的方式,影响多模态大语言模型对图像中异常区域的关注程度。这种方法旨在将专家模型的检测能力与大语言模型的语义理解能力相结合,从而在无需微调的情况下,提升异常检测的准确性和可解释性。

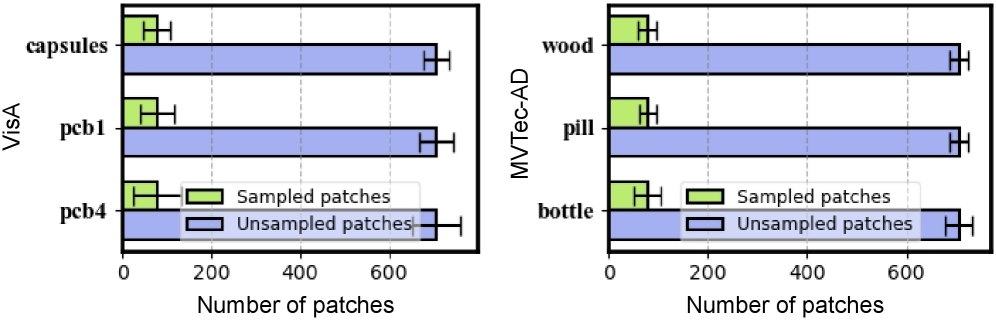

技术框架:EAGLE框架主要包含以下几个阶段:1) 使用专家模型(如预训练的视觉模型)对输入图像进行分析,提取潜在的异常区域信息。2) 将专家模型的输出(例如,异常区域的显著性图)作为注意力引导信号。3) 将图像和注意力引导信号输入到多模态大语言模型中。4) MLLM利用注意力引导信号,调整其内部注意力机制,使其更加关注图像中的异常区域。5) MLLM生成关于图像异常情况的描述性文本。

关键创新:EAGLE的关键创新在于提出了一种免调优的注意力引导机制,它能够有效地将专家模型的知识迁移到多模态大语言模型中,而无需对大语言模型进行任何参数更新。这种方法避免了昂贵的微调过程,并提高了模型的泛化能力。

关键设计:EAGLE框架的关键设计包括:1) 如何选择合适的专家模型,使其能够有效地检测到图像中的异常区域。2) 如何将专家模型的输出转换为有效的注意力引导信号,使其能够被多模态大语言模型所理解和利用。3) 如何设计损失函数或训练策略,以鼓励多模态大语言模型更加关注异常区域,并生成准确的异常描述。论文中具体的技术细节(如专家模型的选择、注意力引导信号的表示方式、损失函数的设计等)未知。

🖼️ 关键图片

📊 实验亮点

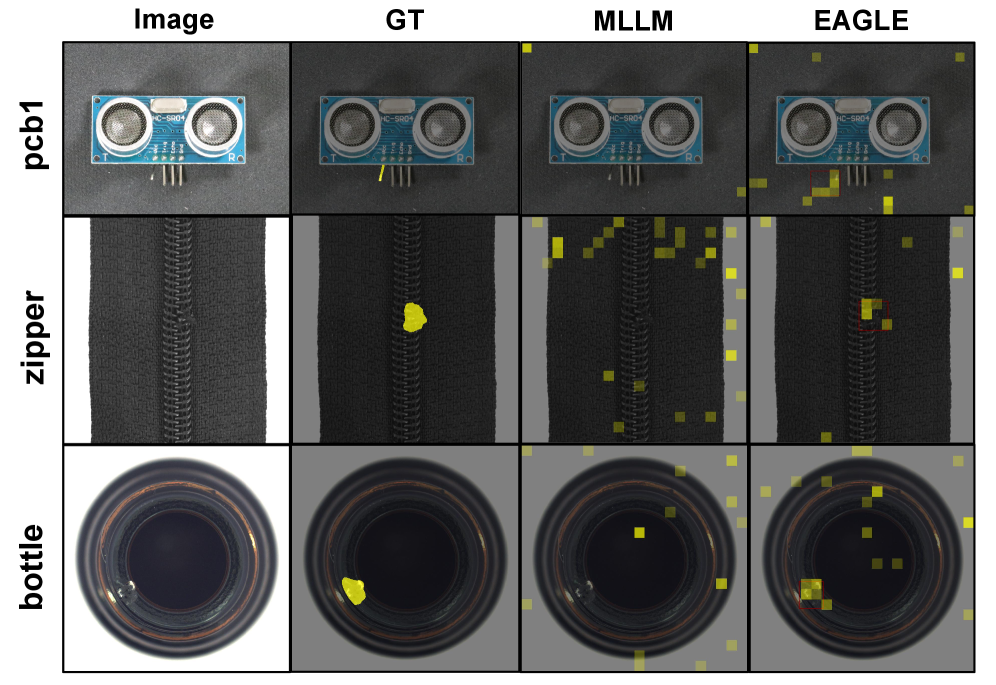

EAGLE在MVTec-AD和VisA数据集上进行了实验,结果表明,在不进行任何参数更新的情况下,EAGLE能够显著提高多个MLLM的异常检测性能,达到与基于微调的方法相当的水平。具体的性能提升幅度未知,但论文强调EAGLE在免调优的前提下实现了具有竞争力的结果。

🎯 应用场景

EAGLE框架可应用于各种工业制造场景中的产品质量检测、设备故障诊断和安全监控。通过提供准确且可解释的异常检测结果,EAGLE能够帮助企业提高生产效率、降低运营成本,并提升产品质量。未来,该技术有望与机器人、自动化系统等集成,实现更智能化的工业生产。

📄 摘要(原文)

Industrial anomaly detection is important for smart manufacturing, but many deep learning approaches produce only binary decisions and provide limited semantic explanations. Multimodal large language models (MLLMs) can potentially generate fine-grained, language-based analyses, yet existing methods often require costly fine-tuning and do not consistently improve anomaly detection accuracy compared to lightweight specialist detectors. We propose expert-augmented attention guidance for industrial anomaly detection in MLLMs (EAGLE), a tuning-free framework that integrates outputs from expert model to guide MLLMs toward both accurate detection and interpretable anomaly descriptions. We further study how EAGLE affects MLLMs internals by examining the attention distribution of MLLMs to the anomalous image regions in the intermediate layers. We observe that successful anomaly detection is associated with increased attention concentration on anomalous regions, and EAGLE tends to encourage this alignment. Experiments on MVTec-AD and VisA show that EAGLE improves anomaly detection performance across multiple MLLMs without any parameter updates, achieving results comparable to fine-tuning based methods. Code is available at \href{https://github.com/shengtun/Eagle}{https://github.com/shengtun/Eagle}