Selective Training for Large Vision Language Models via Visual Information Gain

作者: Seulbi Lee, Sangheum Hwang

分类: cs.CV

发布日期: 2026-02-19

💡 一句话要点

提出基于视觉信息增益的选择性训练方法,提升大视觉语言模型的视觉 grounding 能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言模型 视觉信息增益 选择性训练 视觉 grounding 语言偏差

📋 核心要点

- 现有LVLM易受语言偏差影响,缺乏对视觉信息利用程度的定量评估。

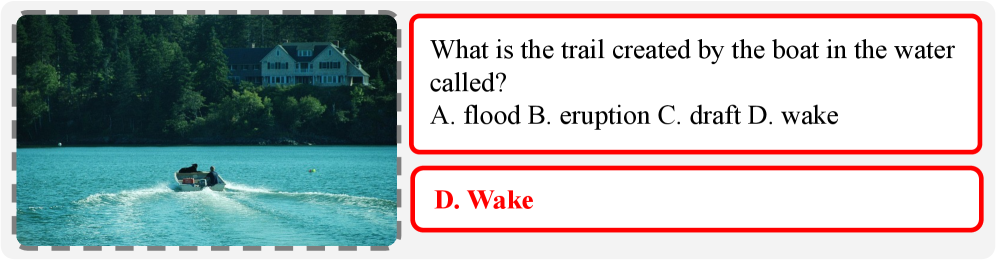

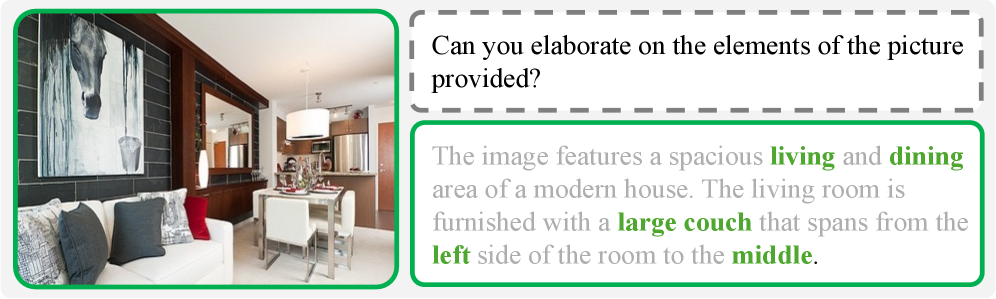

- 提出视觉信息增益(VIG)指标,量化视觉输入对预测不确定性的降低程度,指导选择性训练。

- 实验表明,VIG引导的选择性训练能有效提升视觉 grounding 能力,并减少语言偏差。

📝 摘要(中文)

大型视觉语言模型(LVLMs)取得了显著进展,但它们常常受到语言偏差的影响,在没有依赖视觉证据的情况下生成答案。虽然先前的工作试图通过解码策略、架构修改或精心设计的指令数据来缓解这个问题,但它们通常缺乏对单个训练样本或token从图像中实际获益多少的定量衡量。在这项工作中,我们引入了视觉信息增益(VIG),这是一种基于困惑度的指标,用于衡量视觉输入提供的预测不确定性的降低程度。VIG能够对样本和token级别进行细粒度分析,有效地突出显示视觉基础元素,如颜色、空间关系和属性。利用这一点,我们提出了一种VIG引导的选择性训练方案,该方案优先考虑高VIG样本和token。这种方法通过专门关注视觉信息丰富的样本和token,在显著减少监督的情况下,提高了视觉基础能力,并减轻了语言偏差,从而实现了卓越的性能。

🔬 方法详解

问题定义:大型视觉语言模型(LVLMs)在理解图像内容方面表现出色,但常常过度依赖语言先验知识,而忽略图像中的视觉信息,导致视觉 grounding 不足。现有方法缺乏对训练数据中视觉信息贡献的有效评估,无法针对性地提升模型的视觉感知能力。

核心思路:论文的核心思想是利用视觉信息增益(Visual Information Gain, VIG)来量化图像信息对模型预测的贡献。VIG通过比较有无视觉输入时模型预测的困惑度差异来衡量。高VIG的样本和token表明其包含丰富的视觉信息,对模型的视觉 grounding 更有帮助。

技术框架:该方法包含两个主要步骤:1) 计算训练集中每个样本和token的VIG值。2) 基于VIG值进行选择性训练,优先选择高VIG的样本和token进行训练。具体来说,可以根据VIG值对样本进行排序,选择top-k%的样本进行训练,或者根据VIG值对token进行加权,在损失函数中赋予高VIG的token更高的权重。

关键创新:该方法最重要的创新点在于提出了VIG这一指标,能够定量地衡量视觉信息对模型预测的贡献。与现有方法相比,VIG提供了一种细粒度的分析工具,可以识别出训练数据中真正包含视觉信息的样本和token,从而实现更有效的选择性训练。

关键设计:VIG的计算基于困惑度(perplexity),困惑度越低,表示模型对该样本的预测越准确。VIG定义为:VIG = Perplexity(仅语言) - Perplexity(视觉+语言)。在选择性训练中,可以使用不同的策略来利用VIG值,例如,基于VIG值的阈值筛选、基于VIG值的采样概率等。具体的超参数,如选择的样本比例、token的权重系数等,需要根据具体任务进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,VIG引导的选择性训练方法在多个视觉语言任务上取得了显著的性能提升。例如,在视觉问答任务上,使用VIG选择的10%的训练数据,可以达到甚至超过使用全部数据训练的基线模型的性能。此外,该方法还能够有效缓解语言偏差,提高模型对视觉信息的依赖程度。

🎯 应用场景

该研究成果可应用于各种需要视觉 grounding 的视觉语言任务,例如图像描述生成、视觉问答、视觉推理等。通过选择性训练,可以显著减少训练数据量,降低训练成本,同时提升模型的性能和鲁棒性。该方法还有助于提高模型的可解释性,更好地理解模型如何利用视觉信息进行预测。

📄 摘要(原文)

Large Vision Language Models (LVLMs) have achieved remarkable progress, yet they often suffer from language bias, producing answers without relying on visual evidence. While prior work attempts to mitigate this issue through decoding strategies, architectural modifications, or curated instruction data, they typically lack a quantitative measure of how much individual training samples or tokens actually benefit from the image. In this work, we introduce Visual Information Gain (VIG), a perplexity-based metric that measures the reduction in prediction uncertainty provided by visual input. VIG enables fine-grained analysis at both sample and token levels, effectively highlighting visually grounded elements such as colors, spatial relations, and attributes. Leveraging this, we propose a VIG-guided selective training scheme that prioritizes high-VIG samples and tokens. This approach improves visual grounding and mitigates language bias, achieving superior performance with significantly reduced supervision by focusing exclusively on visually informative samples and tokens.