NRGS-SLAM: Monocular Non-Rigid SLAM for Endoscopy via Deformation-Aware 3D Gaussian Splatting

作者: Jiwei Shan, Zeyu Cai, Yirui Li, Yongbo Chen, Lijun Han, Yun-hui Liu, Hesheng Wang, Shing Shin Cheng

分类: cs.CV, cs.RO

发布日期: 2026-02-19

💡 一句话要点

NRGS-SLAM:基于形变感知3D高斯溅射的内窥镜单目非刚性SLAM

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 非刚性SLAM 内窥镜 3D高斯溅射 形变感知 单目视觉 同步定位与地图构建 贝叶斯自监督

📋 核心要点

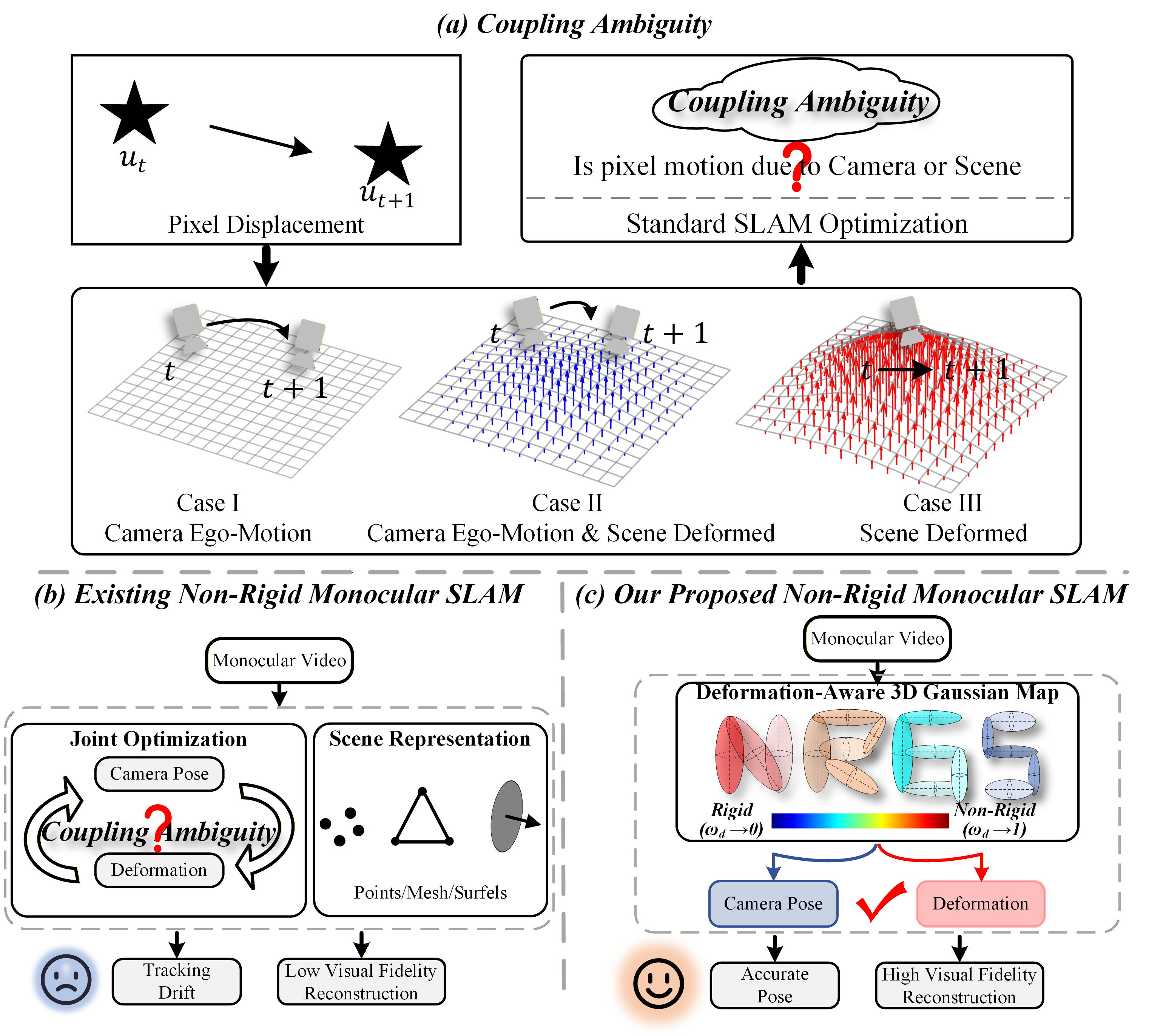

- 内窥镜场景中软组织形变导致相机运动与场景形变耦合,现有非刚性SLAM方法缺乏有效解耦机制,重建质量受限。

- 提出NRGS-SLAM,利用形变感知3D高斯溅射表示场景,通过贝叶斯自监督学习形变概率,解耦相机运动与形变。

- 实验表明,NRGS-SLAM在内窥镜数据集上实现了更准确的相机姿态估计(RMSE降低高达50%)和更高质量的重建效果。

📝 摘要(中文)

视觉同步定位与地图构建(V-SLAM)是自主感知和导航的基本能力。然而,由于持续的软组织形变,内窥镜场景违反了刚性假设,导致相机自身运动和内在形变之间存在强耦合模糊性。尽管最近的单目非刚性SLAM方法取得了显著进展,但它们通常缺乏有效的解耦机制,并且依赖于稀疏或低保真度的场景表示,这导致了跟踪漂移和有限的重建质量。为了解决这些限制,我们提出了一种基于3D高斯溅射的内窥镜单目非刚性SLAM系统NRGS-SLAM。为了解决耦合模糊性,我们引入了一种形变感知的3D高斯地图,该地图使用可学习的形变概率来增强每个高斯基元,并通过贝叶斯自监督策略进行优化,而无需外部非刚性标签。在此表示的基础上,我们设计了一个可变形的跟踪模块,该模块通过优先考虑低形变区域来执行鲁棒的由粗到精的姿态估计,然后进行有效的每帧形变更新。一个精心设计的可变形映射模块逐步扩展和细化地图,平衡了表示能力和计算效率。此外,统一的鲁棒几何损失结合了外部几何先验,以减轻单目非刚性SLAM固有的不适定性。在多个公共内窥镜数据集上的大量实验表明,NRGS-SLAM实现了比最先进方法更准确的相机姿态估计(RMSE降低高达50%)和更高质量的照片级真实感重建。全面的消融研究进一步验证了我们关键设计选择的有效性。源代码将在论文被接受后公开。

🔬 方法详解

问题定义:内窥镜手术中的单目SLAM面临着软组织非刚性形变带来的挑战,传统SLAM算法的刚性假设不再成立。现有的非刚性SLAM方法通常依赖于稀疏或低保真度的场景表示,并且缺乏有效的相机运动与形变解耦机制,导致跟踪漂移和重建质量下降。

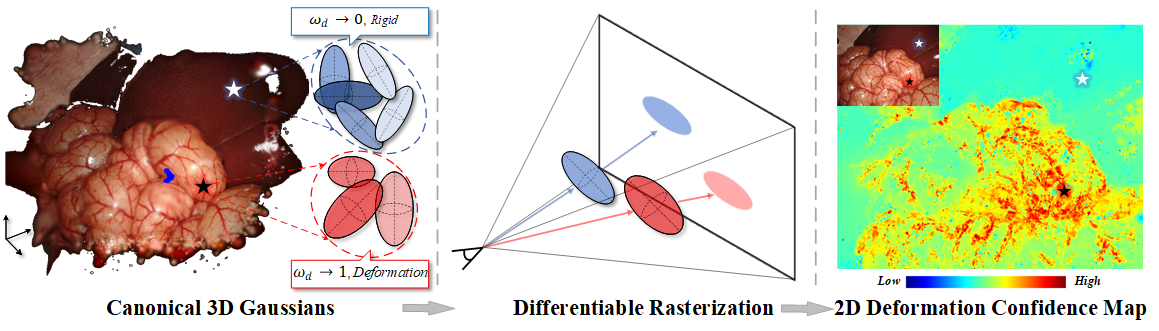

核心思路:NRGS-SLAM的核心思路是利用3D高斯溅射(3D Gaussian Splatting)作为场景表示,并引入形变感知机制。通过为每个高斯基元赋予一个可学习的形变概率,并利用贝叶斯自监督策略进行优化,从而实现相机运动与形变的解耦。这种方法能够在保证重建质量的同时,提高跟踪的鲁棒性。

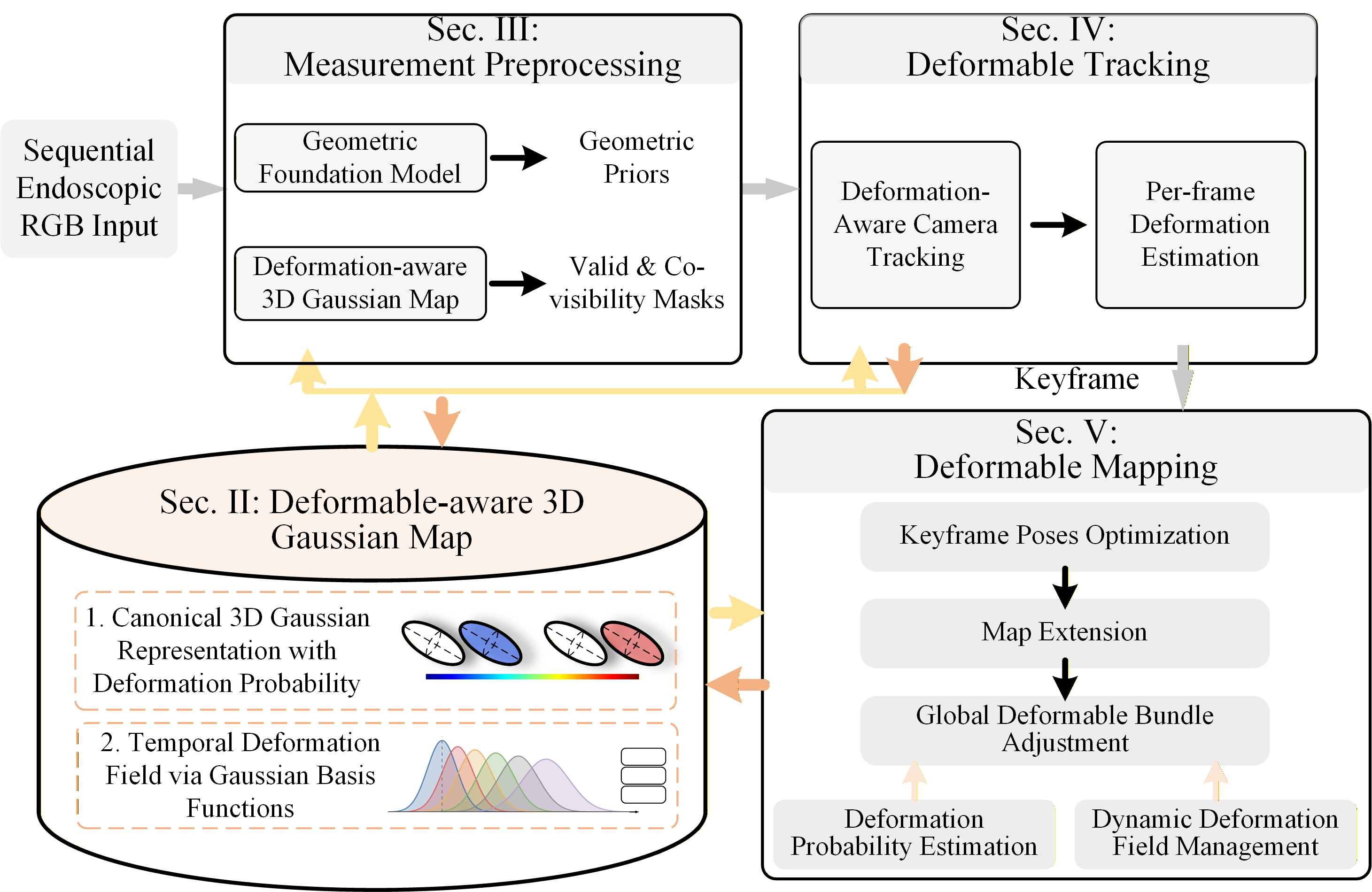

技术框架:NRGS-SLAM系统主要包含三个模块:可变形跟踪模块、可变形映射模块和鲁棒几何损失。可变形跟踪模块通过优先考虑低形变区域进行粗到精的姿态估计,并进行每帧形变更新。可变形映射模块逐步扩展和细化地图,平衡表示能力和计算效率。鲁棒几何损失则结合外部几何先验,缓解单目非刚性SLAM的不适定性。

关键创新:NRGS-SLAM的关键创新在于提出了形变感知的3D高斯地图。与传统的3D高斯溅射不同,NRGS-SLAM为每个高斯基元引入了一个可学习的形变概率,从而能够显式地建模场景的非刚性形变。这种形变感知的表示方法能够有效地解耦相机运动与形变,提高SLAM系统的鲁棒性和准确性。

关键设计:在形变感知3D高斯地图中,每个高斯基元除了位置、协方差、颜色等属性外,还包含一个形变概率。该形变概率通过贝叶斯自监督策略进行学习,无需外部非刚性标签。在可变形跟踪模块中,采用粗到精的姿态估计策略,并优先考虑低形变区域,以提高跟踪的鲁棒性。鲁棒几何损失则结合了外部几何先验,例如表面法向量等,以缓解单目非刚性SLAM的不适定性。

🖼️ 关键图片

📊 实验亮点

NRGS-SLAM在多个公共内窥镜数据集上进行了评估,实验结果表明,该方法在相机姿态估计的RMSE方面比最先进的方法降低了高达50%,并且能够生成更高质量的照片级真实感重建。消融实验验证了形变感知3D高斯地图、可变形跟踪模块和鲁棒几何损失的有效性。

🎯 应用场景

NRGS-SLAM在内窥镜手术导航、机器人辅助手术等领域具有广阔的应用前景。它可以帮助医生更准确地定位手术器械,减少手术风险,提高手术成功率。此外,该技术还可以应用于其他需要处理非刚性形变的场景,例如人体运动捕捉、柔性物体操作等。

📄 摘要(原文)

Visual simultaneous localization and mapping (V-SLAM) is a fundamental capability for autonomous perception and navigation. However, endoscopic scenes violate the rigidity assumption due to persistent soft-tissue deformations, creating a strong coupling ambiguity between camera ego-motion and intrinsic deformation. Although recent monocular non-rigid SLAM methods have made notable progress, they often lack effective decoupling mechanisms and rely on sparse or low-fidelity scene representations, which leads to tracking drift and limited reconstruction quality. To address these limitations, we propose NRGS-SLAM, a monocular non-rigid SLAM system for endoscopy based on 3D Gaussian Splatting. To resolve the coupling ambiguity, we introduce a deformation-aware 3D Gaussian map that augments each Gaussian primitive with a learnable deformation probability, optimized via a Bayesian self-supervision strategy without requiring external non-rigidity labels. Building on this representation, we design a deformable tracking module that performs robust coarse-to-fine pose estimation by prioritizing low-deformation regions, followed by efficient per-frame deformation updates. A carefully designed deformable mapping module progressively expands and refines the map, balancing representational capacity and computational efficiency. In addition, a unified robust geometric loss incorporates external geometric priors to mitigate the inherent ill-posedness of monocular non-rigid SLAM. Extensive experiments on multiple public endoscopic datasets demonstrate that NRGS-SLAM achieves more accurate camera pose estimation (up to 50\% reduction in RMSE) and higher-quality photo-realistic reconstructions than state-of-the-art methods. Comprehensive ablation studies further validate the effectiveness of our key design choices. Source code will be publicly available upon paper acceptance.