PartRAG: Retrieval-Augmented Part-Level 3D Generation and Editing

作者: Peize Li, Zeyu Zhang, Hao Tang

分类: cs.CV

发布日期: 2026-02-19

🔗 代码/项目: GITHUB | PROJECT_PAGE

💡 一句话要点

PartRAG:提出检索增强的部件级3D生成与编辑框架,提升生成质量和编辑能力。

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion)

关键词: 3D生成 部件级编辑 检索增强 扩散模型 Transformer

📋 核心要点

- 现有单图像3D生成方法难以覆盖部件几何形状的长尾分布,且难以保证多视角一致性,限制了生成质量。

- PartRAG通过检索增强的方式,利用外部部件数据库,将多样且物理上合理的部件样本注入到扩散Transformer的去噪过程中。

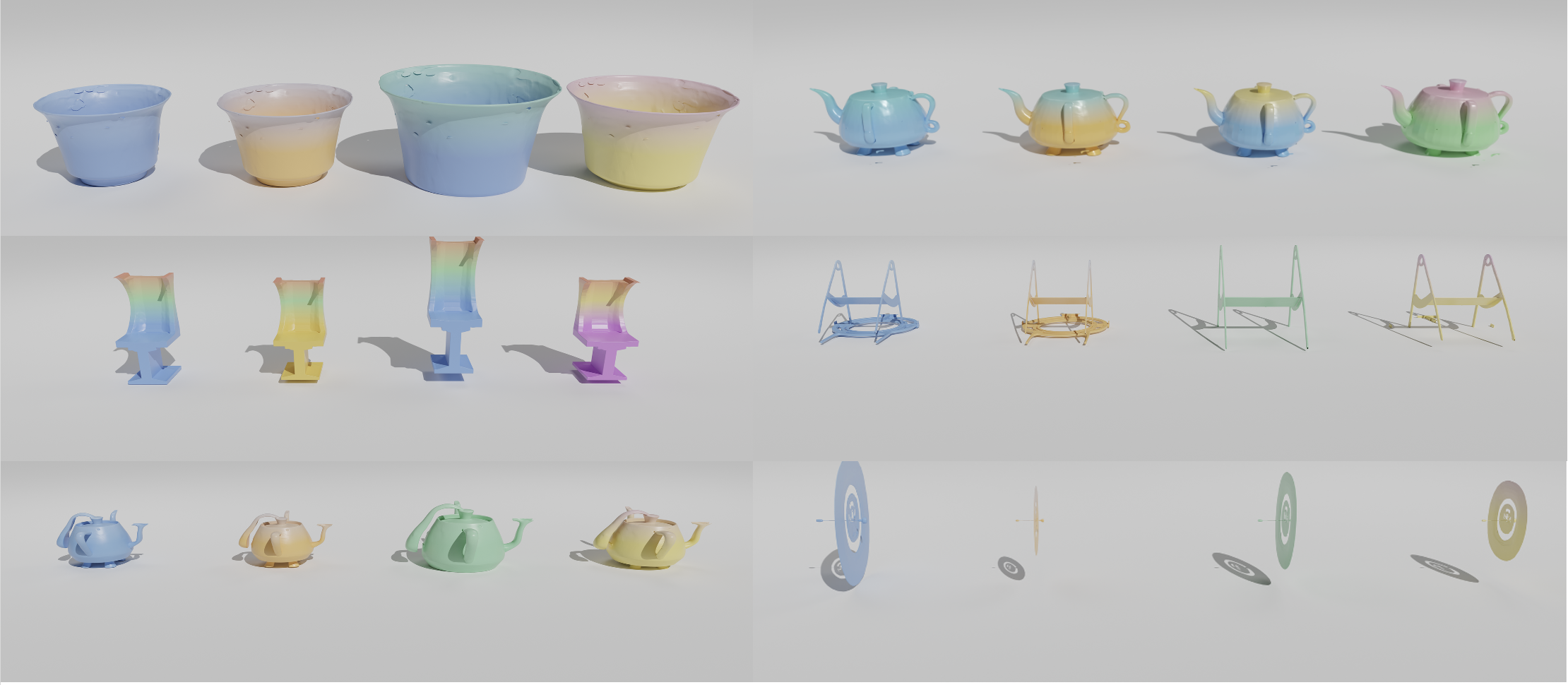

- PartRAG引入部件级编辑器,在规范空间中进行局部编辑,无需重新生成整个对象,同时保持非目标部件和多视角一致性。

📝 摘要(中文)

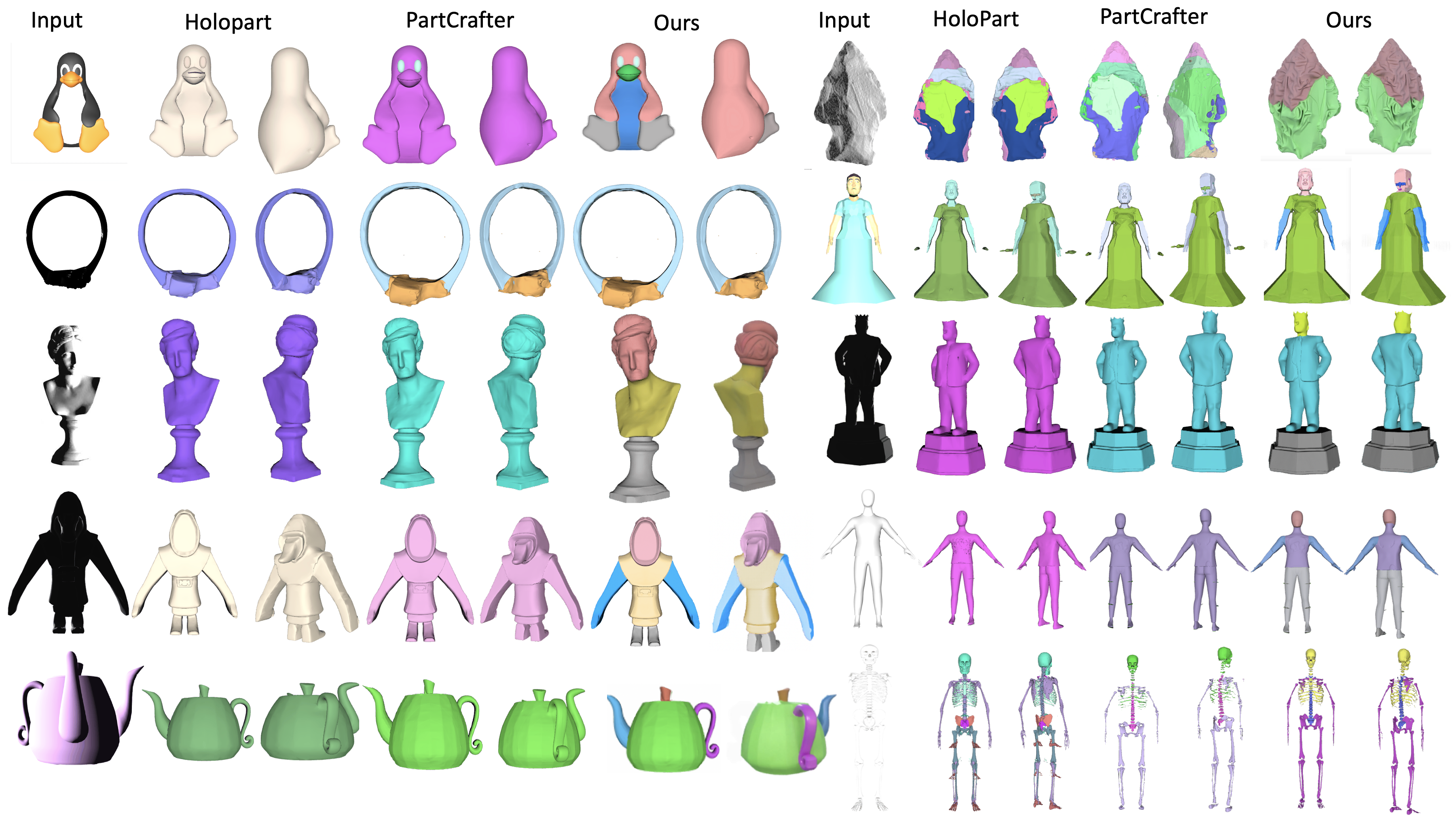

本文提出PartRAG,一个检索增强框架,用于部件级3D生成和编辑,旨在解决单图像3D生成中部件几何形状长尾分布和多视角一致性问题,并提供精确的局部编辑能力。PartRAG集成了一个外部部件数据库和一个扩散Transformer,将生成与可编辑的表示相结合。为了解决长尾问题,引入了分层对比检索模块,该模块在部件和对象粒度上将密集图像块与3D部件潜在空间对齐,从包含1236个部件标注资产的数据库中检索,将多样且物理上合理的样本注入到去噪过程中。为了实现精确编辑,添加了一个掩码的部件级编辑器,该编辑器在共享规范空间中运行,无需重新生成整个对象即可实现交换、属性细化和组合更新,同时保留非目标部件和多视角一致性。PartRAG在Objaverse、ShapeNet和ABO上取得了有竞争力的结果,在Objaverse上,Chamfer距离从0.1726降低到0.1528,F-Score从0.7472提高到0.844,推理时间为38秒,交互式编辑时间为5-8秒。在定性方面,PartRAG产生了更清晰的部件边界,更好的薄结构保真度,以及在铰接对象上的鲁棒行为。

🔬 方法详解

问题定义:单图像3D生成任务面临部件几何形状长尾分布的问题,导致生成结果在部件细节上表现不佳,且难以保证多视角一致性。此外,现有的3D生成系统在进行局部编辑时,往往需要重新生成整个对象,效率低下且容易破坏非目标区域的结构。

核心思路:PartRAG的核心思路是利用检索增强的方式,将外部部件数据库中的高质量3D部件信息融入到生成过程中,从而克服部件几何形状的长尾分布问题。同时,通过在规范空间中进行部件级的局部编辑,实现高效且精确的3D对象修改。

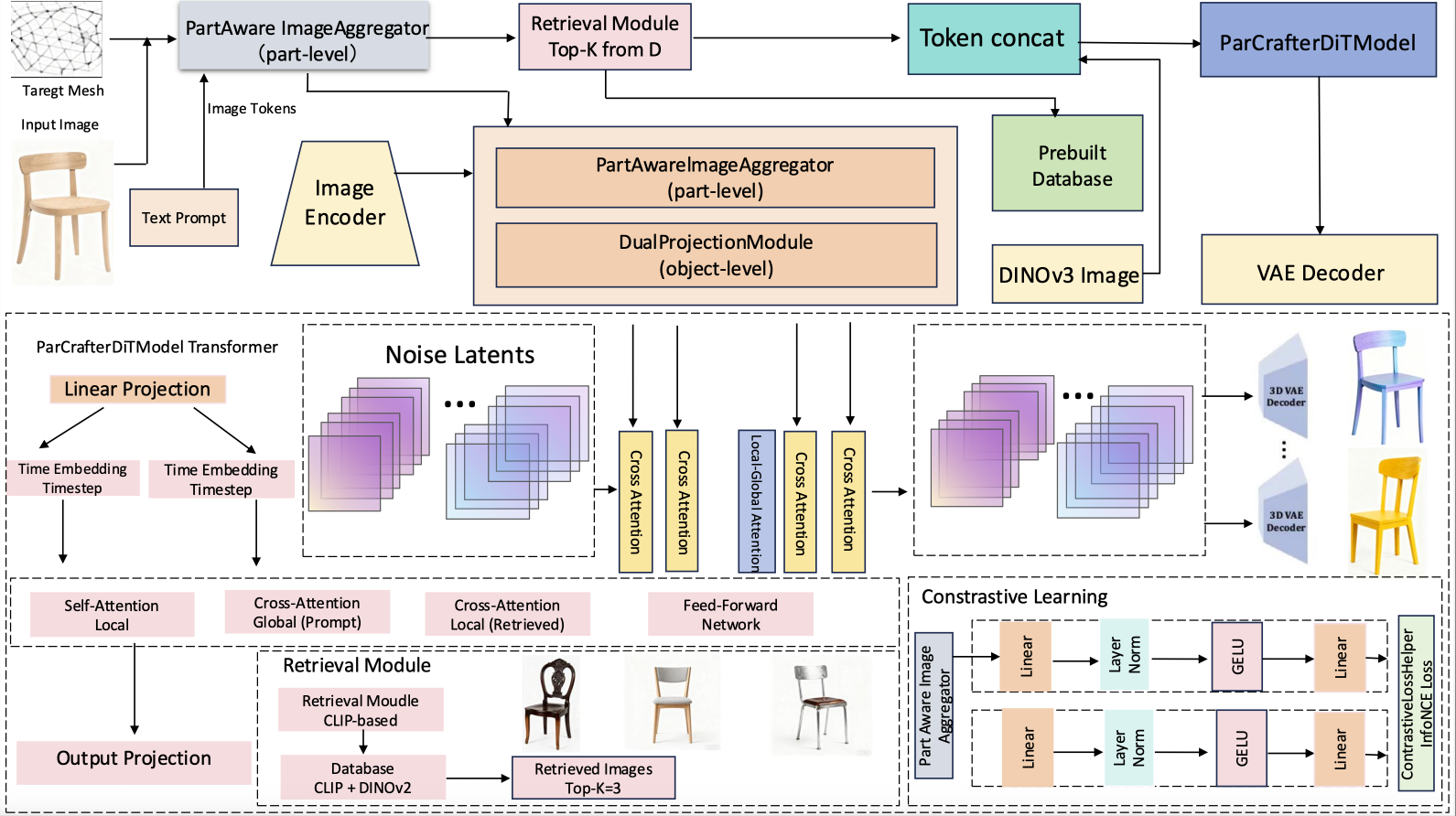

技术框架:PartRAG的整体框架包含以下几个主要模块:1) 分层对比检索模块:用于从外部部件数据库中检索与输入图像相关的3D部件;2) 扩散Transformer:用于生成3D对象,并将检索到的部件信息融入到生成过程中;3) 部件级编辑器:用于在规范空间中对3D对象进行局部编辑。整个流程首先通过分层对比检索模块检索相关部件,然后利用扩散Transformer生成初始3D对象,最后通过部件级编辑器进行局部修改。

关键创新:PartRAG的关键创新在于:1) 提出了分层对比检索模块,能够有效地从外部数据库中检索相关的3D部件;2) 引入了部件级编辑器,实现了高效且精确的3D对象局部编辑;3) 将检索增强与扩散Transformer相结合,提升了3D生成的质量和可控性。与现有方法相比,PartRAG能够生成更逼真、更精细的3D对象,并提供更灵活的编辑能力。

关键设计:分层对比检索模块采用对比学习的方式,将图像块与3D部件潜在空间对齐,从而实现高效的检索。扩散Transformer采用标准的Transformer架构,并引入了注意力机制,用于融合检索到的部件信息。部件级编辑器在规范空间中进行操作,通过掩码的方式选择需要编辑的部件,并利用优化算法调整部件的形状和位置。

🖼️ 关键图片

📊 实验亮点

PartRAG在Objaverse数据集上取得了显著的性能提升,Chamfer距离从0.1726降低到0.1528,F-Score从0.7472提高到0.844。此外,PartRAG还能够生成更清晰的部件边界和更好的薄结构保真度,并在铰接对象上表现出鲁棒性。交互式编辑速度也很快,仅需5-8秒。

🎯 应用场景

PartRAG具有广泛的应用前景,例如:游戏资产生成、虚拟现实内容创作、工业设计等。它可以帮助用户快速生成高质量的3D模型,并进行灵活的编辑和修改,从而提高工作效率和创作质量。未来,PartRAG可以进一步扩展到其他领域,例如:医学图像分析、机器人导航等。

📄 摘要(原文)

Single-image 3D generation with part-level structure remains challenging: learned priors struggle to cover the long tail of part geometries and maintain multi-view consistency, and existing systems provide limited support for precise, localized edits. We present PartRAG, a retrieval-augmented framework that integrates an external part database with a diffusion transformer to couple generation with an editable representation. To overcome the first challenge, we introduce a Hierarchical Contrastive Retrieval module that aligns dense image patches with 3D part latents at both part and object granularity, retrieving from a curated bank of 1,236 part-annotated assets to inject diverse, physically plausible exemplars into denoising. To overcome the second challenge, we add a masked, part-level editor that operates in a shared canonical space, enabling swaps, attribute refinements, and compositional updates without regenerating the whole object while preserving non-target parts and multi-view consistency. PartRAG achieves competitive results on Objaverse, ShapeNet, and ABO-reducing Chamfer Distance from 0.1726 to 0.1528 and raising F-Score from 0.7472 to 0.844 on Objaverse-with inference of 38s and interactive edits in 5-8s. Qualitatively, PartRAG produces sharper part boundaries, better thin-structure fidelity, and robust behavior on articulated objects. Code: https://github.com/AIGeeksGroup/PartRAG. Website: https://aigeeksgroup.github.io/PartRAG.