EasyControlEdge: A Foundation-Model Fine-Tuning for Edge Detection

作者: Hiroki Nakamura, Hiroto Iino, Masashi Okada, Tadahiro Taniguchi

分类: cs.CV

发布日期: 2026-02-18

💡 一句话要点

EasyControlEdge:一种用于边缘检测的基础模型微调方法

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 边缘检测 基础模型 微调 图像生成 数据效率

📋 核心要点

- 现有边缘检测方法在数据效率和生成清晰边缘图方面存在挑战,尤其是在训练数据有限的情况下。

- EasyControlEdge利用图像生成基础模型的预训练先验和迭代细化能力,通过边缘专用适配实现数据高效和清晰的边缘检测。

- 实验表明,EasyControlEdge在多个数据集上优于现有方法,尤其是在有限数据和无后处理的清晰度评估中。

📝 摘要(中文)

我们提出了EasyControlEdge,它将图像生成基础模型适配于边缘检测任务。在现实世界的边缘检测中(例如,楼层平面墙壁、卫星道路/建筑物和医疗器官边界),清晰度和数据效率至关重要,然而,在有限的训练样本下生成清晰的原始边缘图仍然具有挑战性。尽管图像生成基础模型在许多下游任务中表现良好,但它们用于数据高效迁移的预训练先验和用于高频细节保留的迭代细化在边缘检测中仍未得到充分利用。为了利用这些能力实现清晰且数据高效的边缘检测,我们引入了一种边缘专用型的图像生成基础模型适配方法。为了更好地使基础模型专门用于边缘检测,我们结合了边缘导向的目标函数和高效的像素空间损失。在推理时,我们引入了基于无条件动态的引导,使单个模型能够通过引导尺度来控制边缘密度。在BSDS500、NYUDv2、BIPED和CubiCasa上的实验与最先进的方法进行了比较,并显示出一致的收益,尤其是在无后处理清晰度评估和有限的训练数据下。

🔬 方法详解

问题定义:现有的边缘检测方法,尤其是在处理现实世界的复杂场景(如建筑平面图、卫星图像、医疗影像)时,往往需要在清晰度和数据效率之间做出权衡。在训练数据有限的情况下,生成清晰的、高分辨率的边缘图仍然是一个挑战。现有方法难以充分利用大规模预训练模型所蕴含的先验知识,导致数据效率不高。

核心思路:EasyControlEdge的核心思路是利用图像生成基础模型强大的生成能力和预训练知识,通过微调的方式将其适配到边缘检测任务上。通过边缘导向的损失函数和无条件动态引导,使模型能够生成清晰、可控的边缘图,并提高数据效率。这样设计的目的是充分利用预训练模型的泛化能力,减少对大量标注数据的依赖。

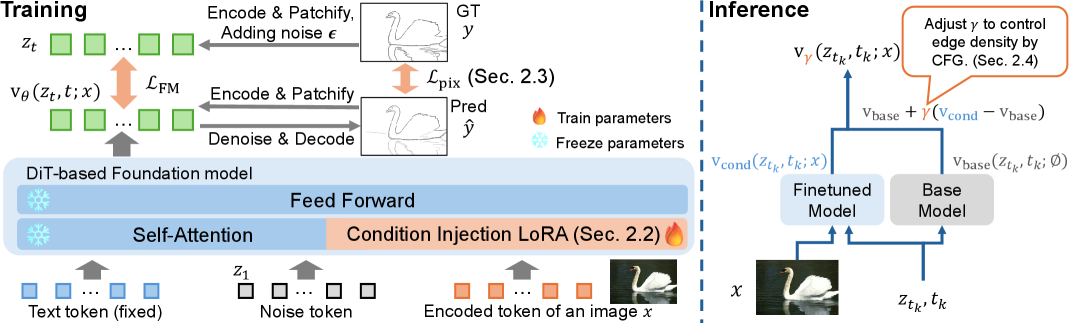

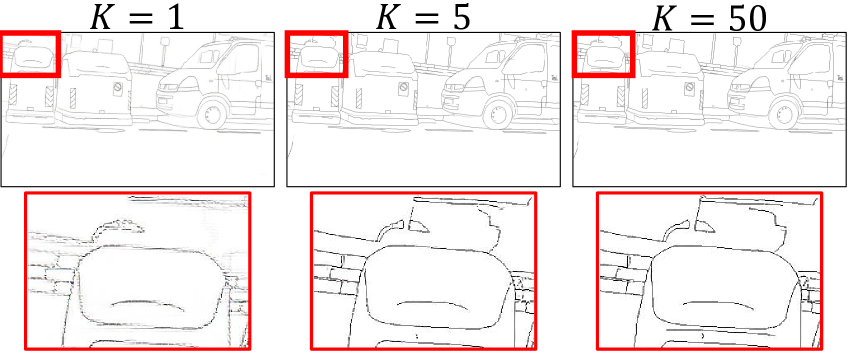

技术框架:EasyControlEdge的技术框架主要包括以下几个阶段:1) 选择一个图像生成基础模型作为backbone。2) 引入边缘导向的损失函数,用于微调基础模型,使其更专注于边缘信息的提取。3) 在推理阶段,利用无条件动态引导,通过调整引导尺度来控制边缘密度。整体流程是从预训练模型出发,通过微调和引导,实现高效、可控的边缘检测。

关键创新:EasyControlEdge的关键创新在于:1) 提出了一种边缘专用型的图像生成基础模型适配方法,充分利用了预训练模型的先验知识。2) 引入了边缘导向的损失函数,提高了模型对边缘信息的敏感度。3) 提出了基于无条件动态的引导方法,实现了边缘密度的可控性。这些创新使得EasyControlEdge在数据效率和边缘清晰度方面都优于现有方法。

关键设计:在损失函数方面,采用了像素空间损失,以提高边缘的清晰度。在网络结构方面,选择了一个合适的图像生成基础模型作为backbone,并对其进行微调。在推理阶段,通过调整引导尺度来控制边缘密度,这是一个关键的参数设置。

🖼️ 关键图片

📊 实验亮点

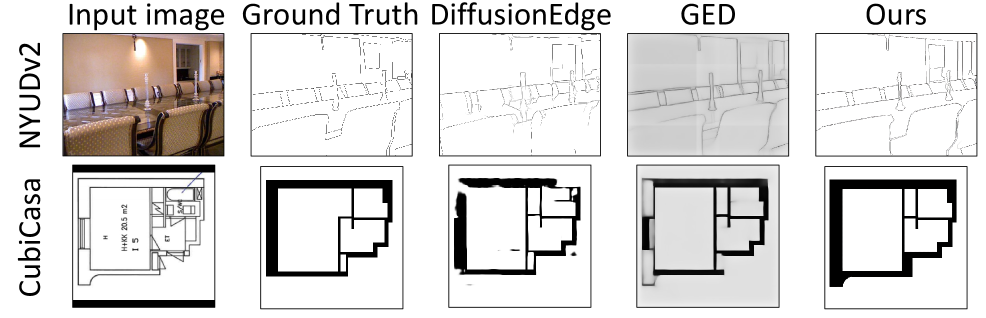

EasyControlEdge在BSDS500、NYUDv2、BIPED和CubiCasa等数据集上进行了实验,结果表明,该方法在边缘清晰度和数据效率方面均优于现有方法。尤其是在有限训练数据和无后处理的清晰度评估中,EasyControlEdge取得了显著的性能提升,证明了其有效性。

🎯 应用场景

EasyControlEdge具有广泛的应用前景,包括但不限于:建筑平面图的自动生成、卫星图像中道路和建筑物的提取、医学图像中器官边界的分割、以及机器人视觉中的场景理解。该方法能够提高边缘检测的准确性和效率,降低对大量标注数据的依赖,从而在各个领域实现更智能化的应用。

📄 摘要(原文)

We propose EasyControlEdge, adapting an image-generation foundation model to edge detection. In real-world edge detection (e.g., floor-plan walls, satellite roads/buildings, and medical organ boundaries), crispness and data efficiency are crucial, yet producing crisp raw edge maps with limited training samples remains challenging. Although image-generation foundation models perform well on many downstream tasks, their pretrained priors for data-efficient transfer and iterative refinement for high-frequency detail preservation remain underexploited for edge detection. To enable crisp and data-efficient edge detection using these capabilities, we introduce an edge-specialized adaptation of image-generation foundation models. To better specialize the foundation model for edge detection, we incorporate an edge-oriented objective with an efficient pixel-space loss. At inference, we introduce guidance based on unconditional dynamics, enabling a single model to control the edge density through a guidance scale. Experiments on BSDS500, NYUDv2, BIPED, and CubiCasa compare against state-of-the-art methods and show consistent gains, particularly under no-post-processing crispness evaluation and with limited training data.