NeRFscopy: Neural Radiance Fields for in-vivo Time-Varying Tissues from Endoscopy

作者: Laura Salort-Benejam, Antonio Agudo

分类: cs.CV

发布日期: 2026-02-17

备注: ISBI 2026

💡 一句话要点

NeRFscopy:提出基于神经辐射场的内窥镜体内时变组织三维重建方法

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 神经辐射场 内窥镜 三维重建 可变形模型 自监督学习

📋 核心要点

- 内窥镜视频的3D重建面临组织形变、单目相机、光照变化和未知相机轨迹等挑战。

- NeRFscopy利用神经辐射场,结合可变形模型和时间相关的形变场,实现自监督的3D重建。

- 该方法在内窥镜场景中实现了准确的新视角合成,优于现有方法,无需预训练模型。

📝 摘要(中文)

内窥镜技术在医学成像中至关重要,用于诊断、预后和治疗。开发一个鲁棒的内窥镜视频动态3D重建流程,可以增强可视化效果,提高诊断准确性,辅助治疗计划,并指导手术过程。然而,由于组织的可变形性、单目相机的使用、光照变化、遮挡和未知的相机轨迹,挑战依然存在。受神经渲染的启发,我们提出了NeRFscopy,一个自监督的流程,用于从单目视频中对可变形的内窥镜组织进行新视角合成和3D重建。NeRFscopy包含一个可变形模型,该模型具有规范的辐射场和一个由SE(3)变换参数化的时间相关形变场。此外,通过引入复杂的项来学习3D隐式模型,从而有效地利用彩色图像,而无需假设任何模板或预训练模型,仅从数据中学习。NeRFscopy在新视角合成方面取得了准确的结果,在各种具有挑战性的内窥镜场景中优于竞争方法。

🔬 方法详解

问题定义:内窥镜视频的三维重建是一个具有挑战性的问题,尤其是在体内组织这种可变形的场景下。现有的方法通常难以处理单目相机带来的深度信息缺失、组织形变、光照变化以及相机运动轨迹未知等问题,导致重建精度不高,鲁棒性较差。

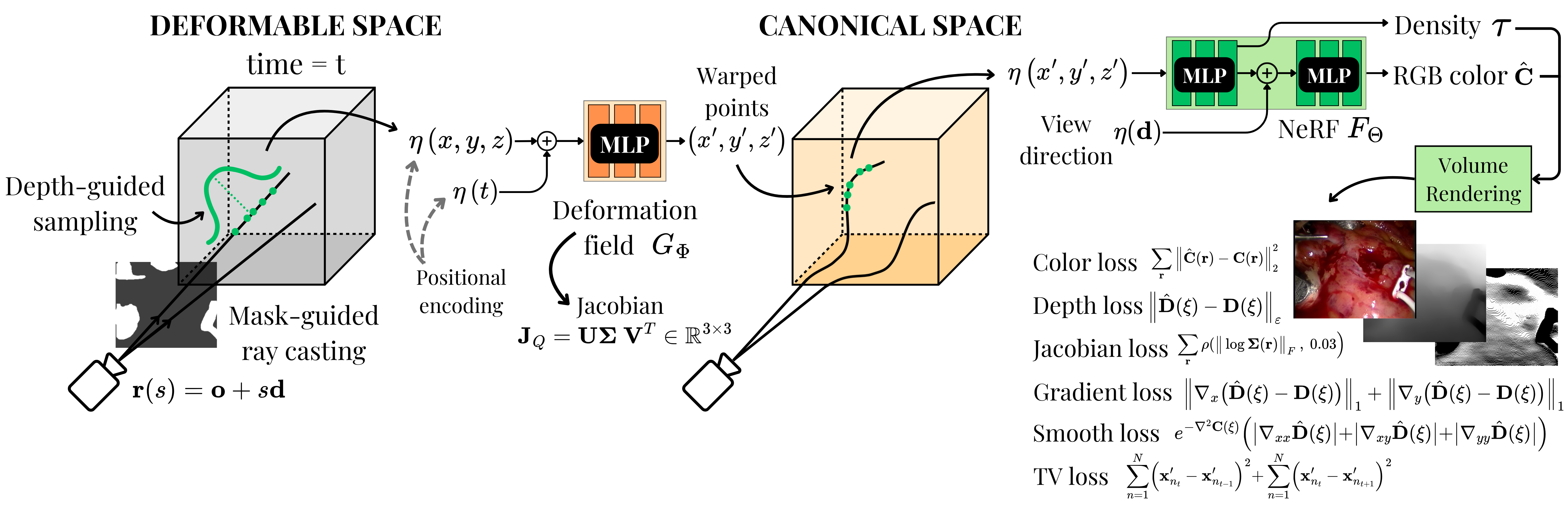

核心思路:NeRFscopy的核心思路是将神经辐射场(NeRF)扩展到可变形的场景中。通过引入一个规范的辐射场和一个时间相关的形变场,将每一帧图像都映射到一个规范空间,从而解决组织形变带来的问题。同时,利用自监督的方式进行训练,避免了对大量标注数据的依赖。

技术框架:NeRFscopy的整体框架包括以下几个主要模块:1) 图像输入模块:接收内窥镜视频的每一帧图像作为输入。2) 位姿估计模块:估计每一帧图像的相机位姿。3) 可变形NeRF模块:该模块是核心,包含一个规范的辐射场和一个时间相关的形变场,用于将每一帧图像映射到规范空间,并进行渲染。4) 渲染模块:根据相机位姿和规范辐射场,渲染出新的视角图像。5) 损失函数模块:计算渲染图像与真实图像之间的差异,用于优化网络参数。

关键创新:NeRFscopy的关键创新在于将NeRF扩展到可变形的内窥镜组织重建。具体来说,它引入了一个时间相关的形变场,该形变场由SE(3)变换参数化,能够有效地捕捉组织随时间变化的形变。此外,该方法采用自监督的方式进行训练,无需预训练模型或模板,仅从数据中学习。

关键设计:NeRFscopy的关键设计包括:1) 形变场的参数化方式:使用SE(3)变换来参数化形变场,能够保证形变的平滑性和连续性。2) 损失函数的设计:采用光度一致性损失函数,鼓励渲染图像与真实图像之间的相似性。3) 网络结构的设计:采用MLP网络来表示规范辐射场和形变场,能够有效地学习复杂的函数关系。

🖼️ 关键图片

📊 实验亮点

NeRFscopy在多个具有挑战性的内窥镜场景中进行了评估,实验结果表明,该方法在新视角合成方面取得了显著的提升,优于现有的方法。具体来说,NeRFscopy能够生成更清晰、更逼真的新视角图像,并且能够更好地处理组织形变和光照变化等问题。该方法无需预训练模型或模板,仅从数据中学习,具有很强的泛化能力。

🎯 应用场景

NeRFscopy在医学领域具有广泛的应用前景,例如可以用于增强内窥镜手术的可视化效果,提高诊断的准确性,辅助医生进行手术规划和导航,以及进行术后评估。此外,该技术还可以应用于虚拟内窥镜训练,帮助医生提高手术技能。未来,该技术有望与机器人技术相结合,实现更精准的微创手术。

📄 摘要(原文)

Endoscopy is essential in medical imaging, used for diagnosis, prognosis and treatment. Developing a robust dynamic 3D reconstruction pipeline for endoscopic videos could enhance visualization, improve diagnostic accuracy, aid in treatment planning, and guide surgery procedures. However, challenges arise due to the deformable nature of the tissues, the use of monocular cameras, illumination changes, occlusions and unknown camera trajectories. Inspired by neural rendering, we introduce NeRFscopy, a self-supervised pipeline for novel view synthesis and 3D reconstruction of deformable endoscopic tissues from a monocular video. NeRFscopy includes a deformable model with a canonical radiance field and a time-dependent deformation field parameterized by SE(3) transformations. In addition, the color images are efficiently exploited by introducing sophisticated terms to learn a 3D implicit model without assuming any template or pre-trained model, solely from data. NeRFscopy achieves accurate results in terms of novel view synthesis, outperforming competing methods across various challenging endoscopy scenes.