GMAIL: Generative Modality Alignment for generated Image Learning

作者: Shentong Mo, Sukmin Yun

分类: cs.CV, cs.AI, cs.LG, eess.IV

发布日期: 2026-02-17

💡 一句话要点

GMAIL:生成模态对齐框架,提升生成图像在视觉-语言任务中的利用率

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 生成图像学习 模态对齐 视觉-语言模型 跨模态学习 图像字幕 零样本学习 数据增强

📋 核心要点

- 现有方法直接将生成图像作为真实图像训练,忽略了真实域和生成域的模态差异,易导致模型性能下降。

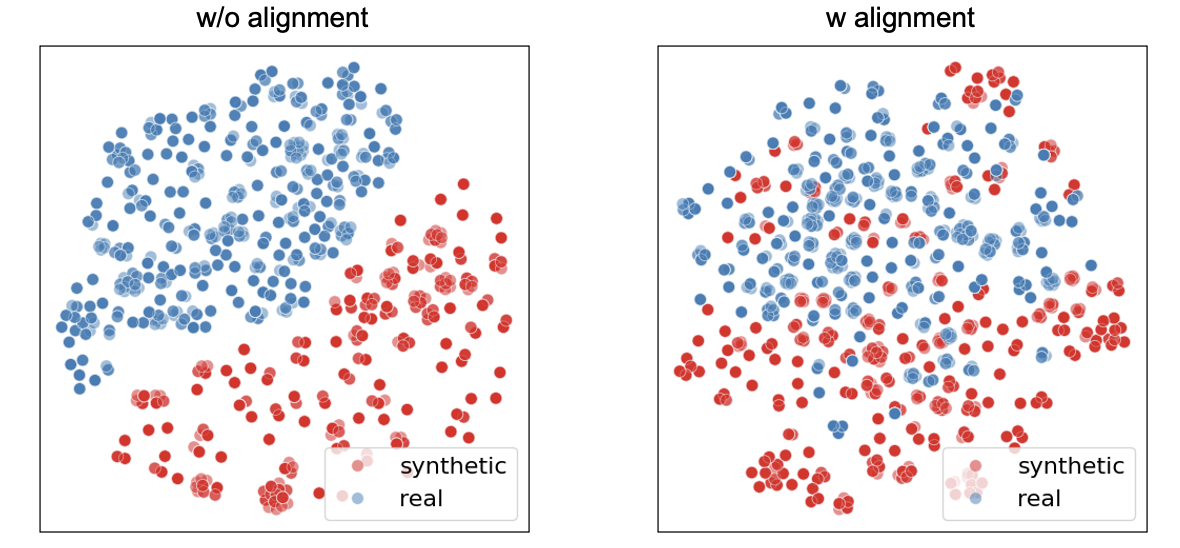

- GMAIL框架将生成图像视为独立模态,通过跨模态对齐损失,在潜在空间中对齐真实图像和生成图像。

- 实验表明,GMAIL框架显著提升了图像字幕、零样本图像检索等视觉-语言任务的性能,并改善了LLaVA的字幕效果。

📝 摘要(中文)

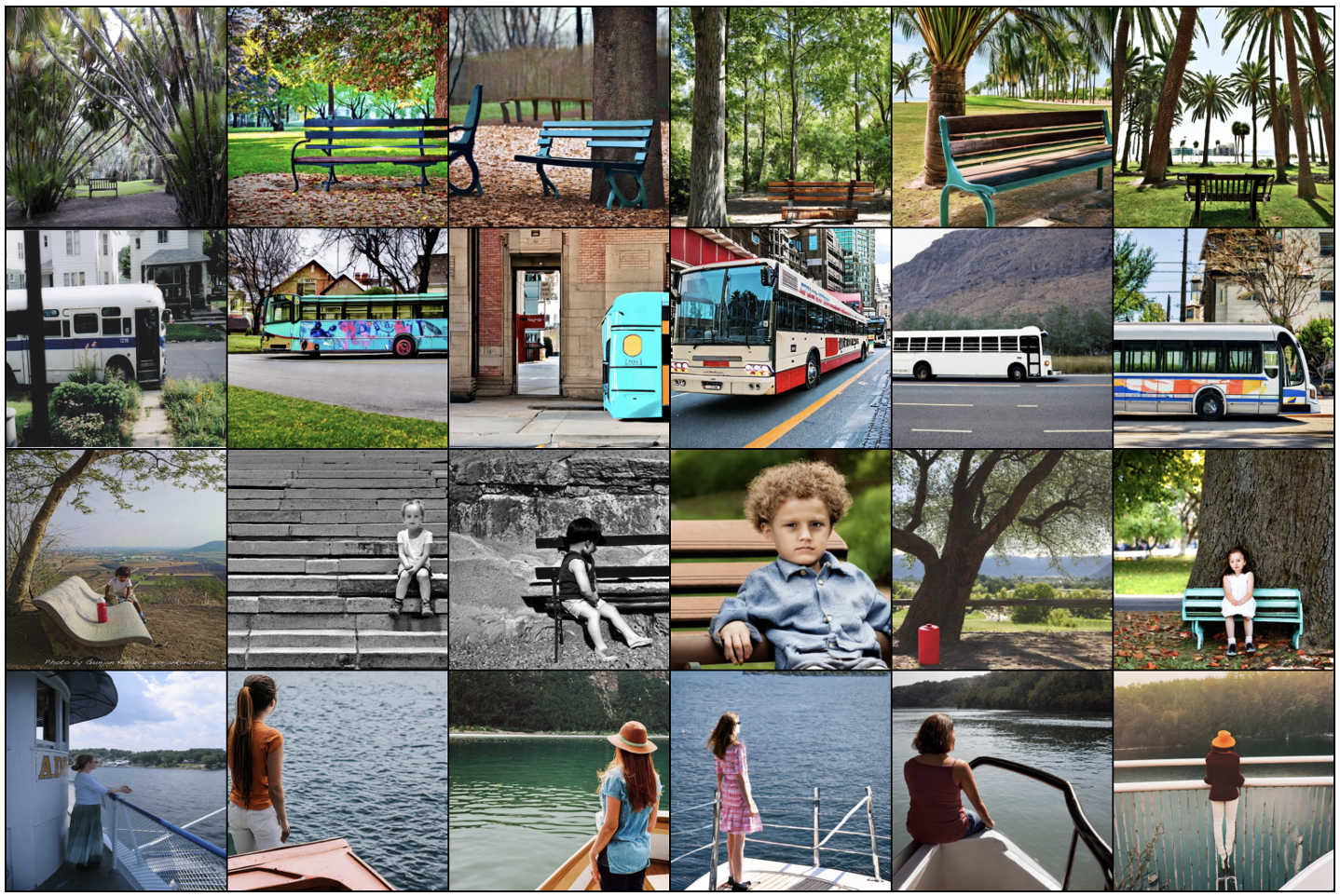

生成模型能够合成高度逼真的图像,为机器学习模型训练提供丰富的数据来源。然而,不加区分地将生成图像作为真实图像进行训练,可能因真实域和合成域之间的模态差异而导致模式崩溃。本文提出了一种名为GMAIL的新框架,用于判别性地使用生成图像,将生成图像明确视为与真实图像不同的模态。我们的方法不是在像素空间中不加区分地用生成图像替换真实图像,而是通过多模态学习方法在同一潜在空间中桥接两种不同的模态。具体来说,我们首先使用跨模态对齐损失在生成图像上专门微调模型,然后使用该对齐模型进一步训练各种视觉-语言模型。通过对齐两种模态,我们的方法有效地利用了生成模型最新进展的优势,从而提高了生成图像学习在各种视觉-语言任务中的有效性。我们的框架可以很容易地与各种视觉-语言模型结合,并通过广泛的实验证明了其有效性。例如,我们的框架显著提高了图像字幕、零样本图像检索、零样本图像分类和长字幕检索任务的性能。它还显示出积极的生成数据缩放趋势,并显著提高了大型多模态模型LLaVA的字幕性能。

🔬 方法详解

问题定义:现有方法直接将生成图像视为真实图像进行训练,忽略了生成图像和真实图像之间的模态差异。这种差异会导致模型训练不稳定,甚至出现模式崩溃,最终影响模型在真实数据上的泛化能力。因此,如何有效地利用生成图像,同时避免模态差异带来的负面影响,是一个亟待解决的问题。

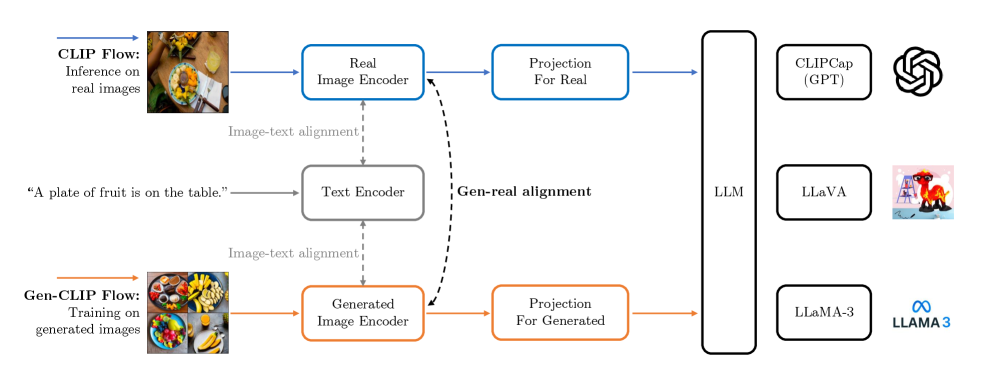

核心思路:GMAIL的核心思路是将生成图像视为与真实图像不同的模态,而不是简单地替换真实图像。通过多模态学习的方法,将两种模态映射到同一个潜在空间中,从而实现模态对齐。这种方法能够保留生成图像的有用信息,同时减轻模态差异带来的负面影响,从而提高模型在真实数据上的性能。

技术框架:GMAIL框架主要包含两个阶段:首先,使用生成图像微调模型,并引入跨模态对齐损失,将生成图像的特征与真实图像的特征对齐。其次,使用对齐后的模型,结合真实图像和生成图像,训练各种视觉-语言模型。整个框架可以很容易地集成到现有的视觉-语言模型中,例如图像字幕、图像检索等。

关键创新:GMAIL的关键创新在于显式地处理生成图像和真实图像之间的模态差异,并提出了一种跨模态对齐的方法。与以往直接替换真实图像的方法不同,GMAIL通过学习两种模态之间的映射关系,从而更有效地利用生成图像。

关键设计:GMAIL的关键设计包括:1) 使用对比学习或类似的损失函数来实现跨模态对齐,例如InfoNCE loss。2) 精心设计网络结构,确保模型能够有效地提取生成图像和真实图像的特征。3) 调整训练策略,例如学习率、batch size等,以优化模型的训练效果。具体的参数设置和网络结构可能需要根据具体的视觉-语言任务进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,GMAIL框架在图像字幕、零样本图像检索、零样本图像分类和长字幕检索等任务上均取得了显著的性能提升。例如,在图像字幕任务中,GMAIL框架相较于基线方法提升了约5-10%的CIDEr分数。此外,GMAIL框架还展现出良好的数据缩放性,即随着生成图像数量的增加,模型性能持续提升。GMAIL框架还显著提高了大型多模态模型LLaVA的字幕性能。

🎯 应用场景

GMAIL框架可广泛应用于各种需要大量训练数据的视觉-语言任务中,例如图像字幕、图像检索、视觉问答等。通过利用生成模型合成的图像,可以有效缓解数据稀缺问题,降低数据采集成本。此外,该框架还可以用于提升现有视觉-语言模型的性能,例如提高图像字幕的准确性和流畅性。未来,GMAIL有望成为一种通用的生成图像学习框架,推动视觉-语言领域的发展。

📄 摘要(原文)

Generative models have made it possible to synthesize highly realistic images, potentially providing an abundant data source for training machine learning models. Despite the advantages of these synthesizable data sources, the indiscriminate use of generated images as real images for training can even cause mode collapse due to modality discrepancies between real and synthetic domains. In this paper, we propose a novel framework for discriminative use of generated images, coined GMAIL, that explicitly treats generated images as a separate modality from real images. Instead of indiscriminately replacing real images with generated ones in the pixel space, our approach bridges the two distinct modalities in the same latent space through a multi-modal learning approach. To be specific, we first fine-tune a model exclusively on generated images using a cross-modality alignment loss and then employ this aligned model to further train various vision-language models with generated images. By aligning the two modalities, our approach effectively leverages the benefits of recent advances in generative models, thereby boosting the effectiveness of generated image learning across a range of vision-language tasks. Our framework can be easily incorporated with various vision-language models, and we demonstrate its efficacy throughout extensive experiments. For example, our framework significantly improves performance on image captioning, zero-shot image retrieval, zero-shot image classification, and long caption retrieval tasks. It also shows positive generated data scaling trends and notable enhancements in the captioning performance of the large multimodal model, LLaVA.