Effective and Robust Multimodal Medical Image Analysis

作者: Joy Dhar, Nayyar Zaidi, Maryam Haghighat

分类: cs.CV

发布日期: 2026-02-17

备注: Accepted at Proceedings of the 32nd ACM SIGKDD Conference on Knowledge Discovery and Data Mining (KDD 2026)

🔗 代码/项目: GITHUB

💡 一句话要点

提出MAIL和Robust-MAIL网络,用于有效且鲁棒的多模态医学图像分析。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态融合 医学图像分析 注意力机制 残差学习 对抗鲁棒性 深度学习 交叉注意力

📋 核心要点

- 现有MFL方法泛化性不足,计算成本高昂,且缺乏对抗攻击的鲁棒性,限制了其在医学AI中的应用。

- 提出MAIL网络,利用残差学习注意力块和多模态交叉注意力模块,高效捕获模态特定和共享互补信息。

- 通过引入随机投影滤波器和调制注意力噪声,MAIL扩展为Robust-MAIL,显著提升了对抗攻击下的鲁棒性。

📝 摘要(中文)

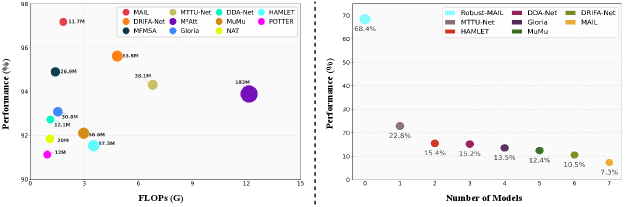

多模态融合学习(MFL)利用来自不同成像方式(如MRI、CT、SPECT)的异构数据,在解决皮肤癌和脑肿瘤预测等医学问题方面显示出巨大潜力。然而,现有的MFL方法面临三个关键限制:a)它们通常专注于特定模态,忽略了不同模态之间有效的共享互补信息,从而限制了其多疾病分析的泛化能力;b)它们依赖于计算成本高的模型,限制了其在资源有限环境中的适用性;c)它们缺乏对抗攻击的鲁棒性,损害了医学人工智能应用的可靠性。为了解决这些限制,我们提出了一种新的多注意力集成学习(MAIL)网络,包含两个关键组件:a)一个高效的残差学习注意力块,用于捕获精细的模态特定多尺度模式;b)一个高效的多模态交叉注意力模块,用于学习不同模态之间丰富的互补共享表示。此外,为了确保对抗鲁棒性,我们通过结合随机投影滤波器和调制注意力噪声,将MAIL网络扩展到Robust-MAIL。在20个公共数据集上的广泛评估表明,MAIL和Robust-MAIL均优于现有方法,性能提升高达9.34%,同时计算成本降低高达78.3%。这些结果突出了我们方法的优越性,确保了比顶级竞争对手更可靠的预测。

🔬 方法详解

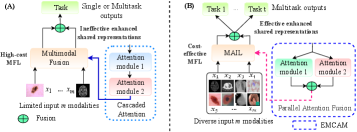

问题定义:论文旨在解决多模态医学图像分析中现有方法存在的三个主要问题:一是模型对特定模态的过度依赖,忽略了跨模态的互补信息;二是计算复杂度高,难以在资源受限的环境中使用;三是对抗攻击的鲁棒性不足,影响了模型的可靠性。现有方法难以兼顾性能、效率和鲁棒性。

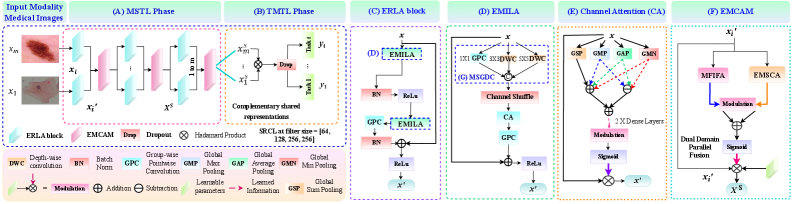

核心思路:论文的核心思路是设计一个高效且鲁棒的多模态融合框架,通过注意力机制显式地建模模态特定和跨模态的信息交互。具体来说,利用残差学习注意力块提取精细的模态特征,并使用多模态交叉注意力模块学习模态间的互补表示。为了增强鲁棒性,引入随机投影和注意力噪声,提高模型对对抗扰动的抵抗能力。

技术框架:整体框架由两个主要部分组成:MAIL和Robust-MAIL。MAIL网络首先使用残差学习注意力块提取每个模态的特征,然后通过多模态交叉注意力模块融合不同模态的特征。Robust-MAIL在MAIL的基础上,增加了随机投影滤波器和调制注意力噪声,以提高对抗鲁棒性。整个流程包括特征提取、特征融合和分类预测三个阶段。

关键创新:论文的关键创新在于提出了多注意力集成学习(MAIL)网络,并将其扩展到Robust-MAIL,实现了高效且鲁棒的多模态医学图像分析。与现有方法相比,MAIL网络能够更有效地利用跨模态的互补信息,同时降低计算成本。Robust-MAIL则通过引入随机投影和注意力噪声,显著提高了模型对对抗攻击的抵抗能力。

关键设计:残差学习注意力块采用残差连接和注意力机制,能够有效地提取模态特定多尺度特征。多模态交叉注意力模块通过计算不同模态特征之间的注意力权重,实现模态间的信息融合。随机投影滤波器用于降低输入数据的维度,减少对抗攻击的影响。调制注意力噪声则通过在注意力权重中添加随机噪声,提高模型的鲁棒性。具体的参数设置和损失函数细节在论文中有详细描述(未知)。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MAIL和Robust-MAIL在20个公共数据集上均优于现有方法,性能提升高达9.34%,同时计算成本降低高达78.3%。Robust-MAIL在对抗攻击下表现出更强的鲁棒性,证明了所提出方法的有效性和优越性。代码已开源。

🎯 应用场景

该研究成果可广泛应用于医学图像分析领域,例如皮肤癌检测、脑肿瘤预测等。通过融合MRI、CT、SPECT等多种模态的医学图像,可以提高诊断的准确性和可靠性。此外,该方法具有较高的计算效率和鲁棒性,适用于资源有限的环境和对抗攻击场景,具有重要的实际应用价值和潜在的临床转化前景。

📄 摘要(原文)

Multimodal Fusion Learning (MFL), leveraging disparate data from various imaging modalities (e.g., MRI, CT, SPECT), has shown great potential for addressing medical problems such as skin cancer and brain tumor prediction. However, existing MFL methods face three key limitations: a) they often specialize in specific modalities, and overlook effective shared complementary information across diverse modalities, hence limiting their generalizability for multi-disease analysis; b) they rely on computationally expensive models, restricting their applicability in resource-limited settings; and c) they lack robustness against adversarial attacks, compromising reliability in medical AI applications. To address these limitations, we propose a novel Multi-Attention Integration Learning (MAIL) network, incorporating two key components: a) an efficient residual learning attention block for capturing refined modality-specific multi-scale patterns and b) an efficient multimodal cross-attention module for learning enriched complementary shared representations across diverse modalities. Furthermore, to ensure adversarial robustness, we extend MAIL network to design Robust-MAIL by incorporating random projection filters and modulated attention noise. Extensive evaluations on 20 public datasets show that both MAIL and Robust-MAIL outperform existing methods, achieving performance gains of up to 9.34% while reducing computational costs by up to 78.3%. These results highlight the superiority of our approaches, ensuring more reliable predictions than top competitors. Code: https://github.com/misti1203/MAIL-Robust-MAIL.