Training-Free Zero-Shot Anomaly Detection in 3D Brain MRI with 2D Foundation Models

作者: Tai Le-Gia, Jaehyun Ahn

分类: cs.CV, stat.ML

发布日期: 2026-02-17

备注: Accepted for MIDL 2026

💡 一句话要点

提出一种基于2D预训练模型的3D脑MRI无训练零样本异常检测方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 零样本学习 异常检测 3D脑MRI 预训练模型 医学图像分析

📋 核心要点

- 现有3D医学图像零样本异常检测方法依赖切片特征和视觉-语言模型,难以有效捕捉体积结构信息。

- 该方法利用2D预训练模型处理多轴切片,聚合构建局部体积tokens,恢复立方空间上下文。

- 实验表明,该无训练框架可有效扩展2D编码器至3D MRI,为体积异常检测提供简单鲁棒方案。

📝 摘要(中文)

本文提出了一种完全无需训练的3D脑MRI零样本异常检测(ZSAD)框架。现有的ZSAD方法主要集中在2D数据集上,而扩展到3D医学图像具有挑战性,因为它们依赖于切片特征和视觉-语言模型,无法捕捉体积结构。该框架通过聚合由2D预训练模型处理的多轴切片,构建局部化的体积tokens。这些3D patch tokens恢复了立方空间上下文,并直接与基于距离的批次级别异常检测流程集成。该框架提供了紧凑的3D表示,可以在标准GPU上高效计算,且无需微调、提示或监督。实验结果表明,无训练的、基于批次的ZSAD可以有效地从2D编码器扩展到完整的3D MRI体积,为体积异常检测提供了一种简单而鲁棒的方法。

🔬 方法详解

问题定义:现有的零样本异常检测方法在3D医学图像上的应用面临挑战,主要原因是它们通常依赖于2D切片特征或视觉-语言模型,无法充分捕捉3D体积结构信息。这导致在3D空间中进行异常检测时,性能受到限制,难以准确识别异常区域。

核心思路:本文的核心思路是利用2D预训练模型提取多轴切片的特征,然后将这些特征聚合起来,构建局部化的3D体积tokens。通过这种方式,可以有效地恢复立方空间上下文信息,从而更好地表示3D MRI图像。这种方法避免了直接在3D数据上训练模型的需要,实现了真正的零样本异常检测。

技术框架:该框架主要包含以下几个阶段:1) 使用2D预训练模型(如CLIP)处理3D MRI图像的多个轴向切片(例如,横断面、矢状面和冠状面)。2) 将每个切片的特征进行聚合,形成3D patch tokens,这些tokens包含了局部体积信息。3) 将这些3D tokens输入到基于距离的批次级别异常检测流程中,例如使用k近邻算法或自编码器来识别异常样本。整个流程无需任何训练或微调。

关键创新:该方法最重要的创新点在于它提出了一种将2D预训练模型的知识迁移到3D医学图像异常检测任务中的有效方法。通过构建3D patch tokens,该方法能够恢复立方空间上下文,从而克服了传统方法在处理3D数据时的局限性。此外,该方法完全无需训练,使其具有很高的实用性和泛化能力。

关键设计:在具体实现上,该方法需要选择合适的2D预训练模型,例如CLIP或DINO。在聚合多轴切片特征时,可以使用简单的平均池化或更复杂的注意力机制。在异常检测阶段,可以使用不同的距离度量方法(如欧氏距离或余弦相似度)来计算样本之间的相似性。批次大小的选择也会影响异常检测的性能,通常需要根据数据集的大小进行调整。

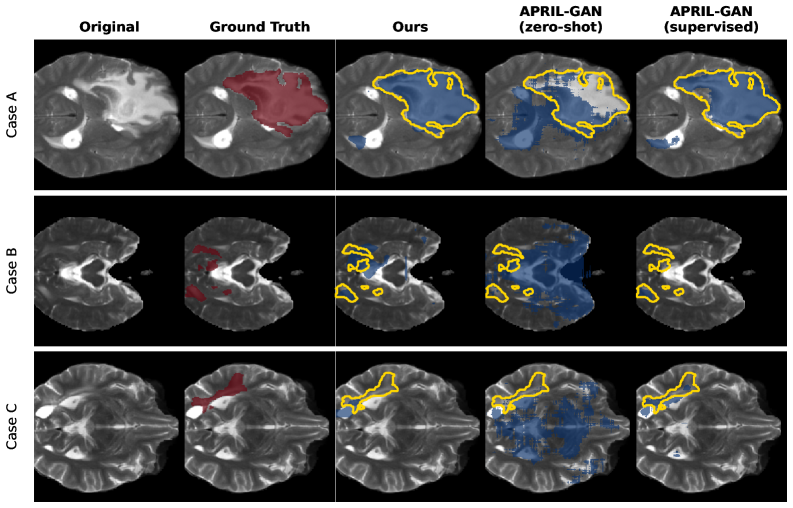

🖼️ 关键图片

📊 实验亮点

该研究提出了一种无需训练的零样本异常检测框架,在3D脑MRI图像上取得了良好的效果。与传统的基于2D切片的方法相比,该方法能够更好地捕捉3D体积结构信息,从而提高了异常检测的准确性。实验结果表明,该方法在多个公开数据集上取得了具有竞争力的性能,证明了其有效性和鲁棒性。

🎯 应用场景

该研究成果可应用于临床辅助诊断,帮助医生快速识别脑部MRI图像中的异常区域,例如肿瘤、出血或梗塞等。由于该方法无需训练数据,因此可以很容易地部署到不同的医疗机构,尤其是在缺乏标注数据的场景下。未来,该方法还可以扩展到其他3D医学图像,例如CT扫描或PET扫描,从而实现更广泛的应用。

📄 摘要(原文)

Zero-shot anomaly detection (ZSAD) has gained increasing attention in medical imaging as a way to identify abnormalities without task-specific supervision, but most advances remain limited to 2D datasets. Extending ZSAD to 3D medical images has proven challenging, with existing methods relying on slice-wise features and vision-language models, which fail to capture volumetric structure. In this paper, we introduce a fully training-free framework for ZSAD in 3D brain MRI that constructs localized volumetric tokens by aggregating multi-axis slices processed by 2D foundation models. These 3D patch tokens restore cubic spatial context and integrate directly with distance-based, batch-level anomaly detection pipelines. The framework provides compact 3D representations that are practical to compute on standard GPUs and require no fine-tuning, prompts, or supervision. Our results show that training-free, batch-based ZSAD can be effectively extended from 2D encoders to full 3D MRI volumes, offering a simple and robust approach for volumetric anomaly detection.