UniWeTok: An Unified Binary Tokenizer with Codebook Size $\mathit{2^{128}}$ for Unified Multimodal Large Language Model

作者: Shaobin Zhuang, Yuang Ai, Jiaming Han, Weijia Mao, Xiaohui Li, Fangyikang Wang, Xiao Wang, Yan Li, Shanchuan Lin, Kun Xu, Zhenheng Yang, Huaibo Huang, Xiangyu Yue, Hao Chen, Yali Wang

分类: cs.CV, cs.AI

发布日期: 2026-02-15

备注: 29 pages, 9 figures, 33 tables

💡 一句话要点

提出UniWeTok以解决多模态大语言模型的视觉表示问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 视觉表示 离散分词器 SigLu激活函数 图像生成 语义提取 训练框架

📋 核心要点

- 现有的视觉分词器难以在高保真重建、复杂语义提取和生成适应性之间取得平衡,导致多模态大语言模型的性能受限。

- 本文提出的UniWeTok通过一个巨大的二进制代码本和创新的训练框架,旨在提升视觉表示的质量和多模态理解能力。

- 实验结果表明,UniWeTok在图像生成和多模态任务上表现出色,尤其在ImageNet上取得了优于现有方法的性能,同时训练计算需求显著降低。

📝 摘要(中文)

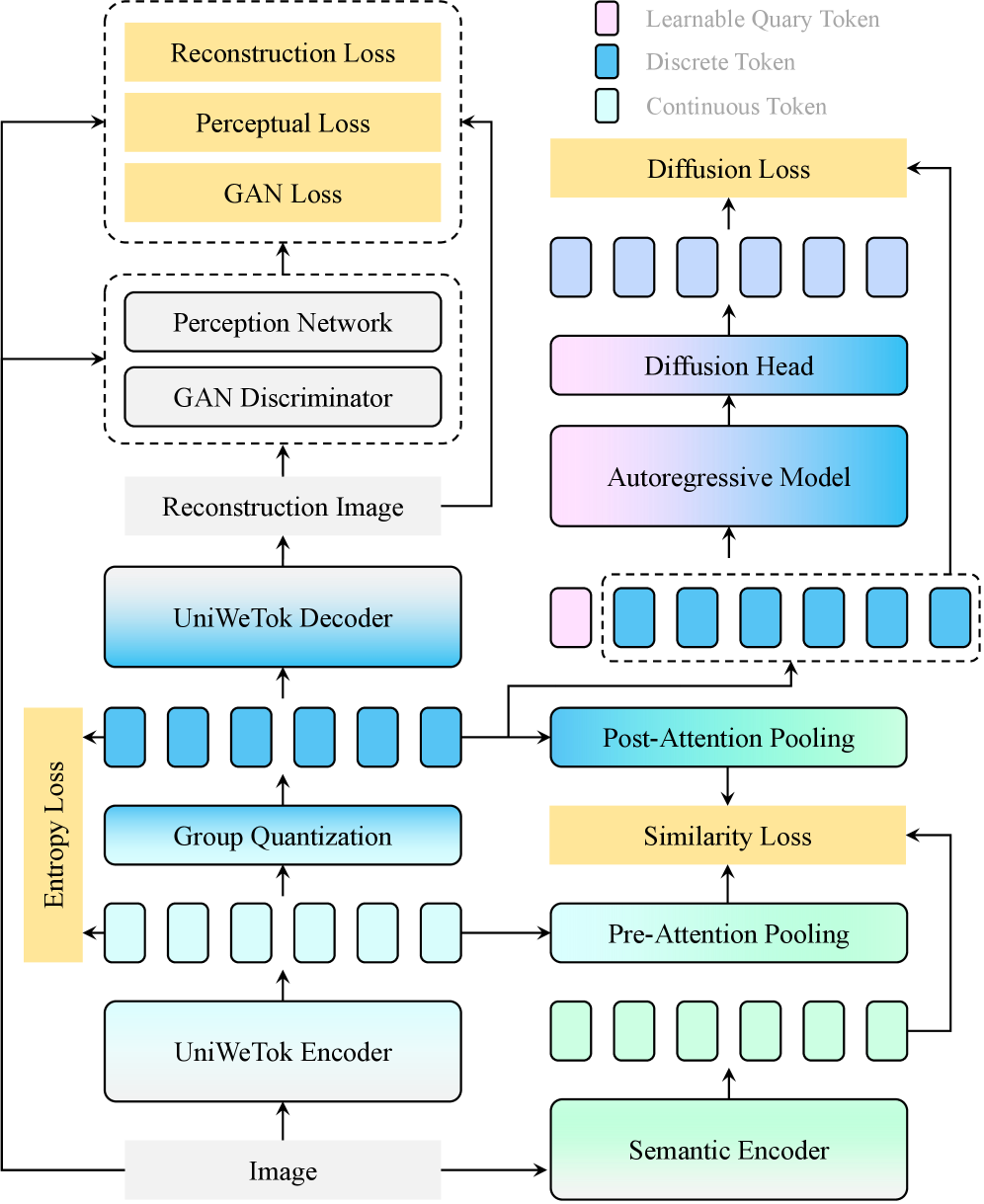

统一多模态大语言模型(MLLMs)需要一种视觉表示,能够同时支持高保真重建、复杂语义提取和生成适应性。然而,现有的视觉分词器通常难以在单一框架内满足这些相互矛盾的目标。本文提出了UniWeTok,这是一种统一的离散分词器,旨在通过一个巨大的二进制代码本($2^{128}$)来弥合这一差距。我们引入了预后蒸馏和生成感知先验的训练框架,以增强离散标记的语义提取和生成能力。在模型架构方面,我们提出了一种卷积-注意力混合架构,并使用SigLu激活函数。SigLu激活不仅限制了编码器输出并稳定了语义蒸馏过程,还有效解决了标记熵损失与承诺损失之间的优化冲突。UniWeTok在ImageNet上实现了最先进的图像生成性能,同时训练计算需求显著降低。

🔬 方法详解

问题定义:本文旨在解决现有视觉分词器在高保真重建、复杂语义提取和生成适应性之间的矛盾,导致多模态大语言模型性能不足的问题。

核心思路:UniWeTok通过引入一个巨大的二进制代码本($2^{128}$)和创新的训练策略,旨在提升离散标记的语义提取和生成能力,从而实现更好的多模态理解。

技术框架:整体架构包括预后蒸馏和生成感知先验的训练框架,结合卷积-注意力混合架构和SigLu激活函数,以增强模型的稳定性和性能。

关键创新:最重要的技术创新在于引入了SigLu激活函数,该函数有效解决了标记熵损失与承诺损失之间的优化冲突,提升了模型的训练效果。

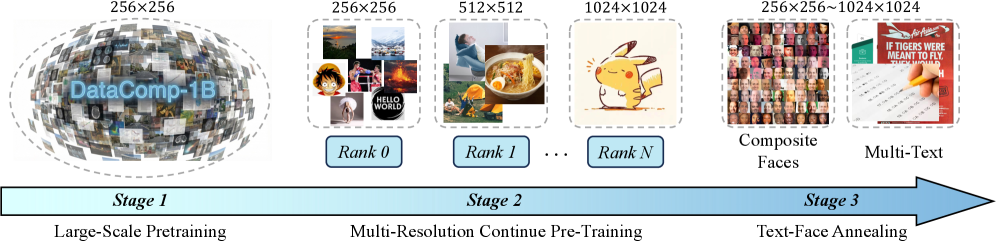

关键设计:在参数设置上,UniWeTok采用了巨大的二进制代码本,并在训练过程中使用了三阶段的训练框架,以增强其在不同图像分辨率和感知敏感场景下的适应性。

🖼️ 关键图片

📊 实验亮点

在实验中,UniWeTok在ImageNet上实现了1.38的FID,优于REPA的1.42,同时训练所需的计算量显著降低(UniWeTok 33B vs. REPA 262B)。此外,在多模态理解和图像生成任务中,UniWeTok的DPG得分为86.63,超过FLUX.1的83.84,展示了其强大的竞争力。

🎯 应用场景

UniWeTok的研究成果在多个领域具有广泛的应用潜力,包括计算机视觉、自然语言处理和多模态交互等。其高效的视觉表示和生成能力可用于图像生成、图像编辑、以及人机交互等场景,推动相关技术的发展与应用。

📄 摘要(原文)

Unified Multimodal Large Language Models (MLLMs) require a visual representation that simultaneously supports high-fidelity reconstruction, complex semantic extraction, and generative suitability. However, existing visual tokenizers typically struggle to satisfy these conflicting objectives within a single framework. In this paper, we introduce UniWeTok, a unified discrete tokenizer designed to bridge this gap using a massive binary codebook ($\mathit{2^{128}}$). For training framework, we introduce Pre-Post Distillation and a Generative-Aware Prior to enhance the semantic extraction and generative prior of the discrete tokens. In terms of model architecture, we propose a convolution-attention hybrid architecture with the SigLu activation function. SigLu activation not only bounds the encoder output and stabilizes the semantic distillation process but also effectively addresses the optimization conflict between token entropy loss and commitment loss. We further propose a three-stage training framework designed to enhance UniWeTok's adaptability cross various image resolutions and perception-sensitive scenarios, such as those involving human faces and textual content. On ImageNet, UniWeTok achieves state-of-the-art image generation performance (FID: UniWeTok 1.38 vs. REPA 1.42) while requiring a remarkably low training compute (Training Tokens: UniWeTok 33B vs. REPA 262B). On general-domain, UniWeTok demonstrates highly competitive capabilities across a broad range of tasks, including multimodal understanding, image generation (DPG Score: UniWeTok 86.63 vs. FLUX.1 [Dev] 83.84), and editing (GEdit Overall Score: UniWeTok 5.09 vs. OmniGen 5.06). We release code and models to facilitate community exploration of unified tokenizer and MLLM.