EgoSound: Benchmarking Sound Understanding in Egocentric Videos

作者: Bingwen Zhu, Yuqian Fu, Qiaole Dong, Guolei Sun, Tianwen Qian, Yuzheng Wu, Danda Pani Paudel, Xiangyang Xue, Yanwei Fu

分类: cs.CV

发布日期: 2026-02-15

备注: 17 pages

💡 一句话要点

EgoSound:首个用于评估以自我为中心视频中声音理解能力的基准

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自我中心视频 声音理解 多模态学习 基准数据集 听觉推理 空间定位 因果推理

📋 核心要点

- 现有MLLM在视觉语言理解方面表现出色,但缺乏对以自我为中心视频中声音的深入理解,限制了其对环境的感知。

- EgoSound基准旨在通过统一Ego4D和EgoBlind数据,并定义七个任务,系统评估MLLM在声音感知、定位、推理等方面的能力。

- 实验表明,现有MLLM在听觉推理方面有所进展,但在空间和因果理解方面仍有提升空间,EgoSound为此提供了一个有力的评估平台。

📝 摘要(中文)

多模态大型语言模型(MLLMs)在视觉-语言理解方面取得了显著进展。然而,人类的感知本质上是多感官的,整合视觉、听觉和运动来推理世界。在这些模态中,声音提供了关于空间布局、屏幕外事件和因果交互的不可或缺的线索,尤其是在听觉和视觉信号紧密耦合的以自我为中心的场景中。为此,我们推出了EgoSound,这是第一个旨在系统地评估MLLM中以自我为中心的声音理解能力的基准。EgoSound统一了来自Ego4D和EgoBlind的数据,涵盖了有视觉和依赖声音的体验。它定义了一个包含七个任务的分类,涵盖了内在声音感知、空间定位、因果推理和跨模态推理。EgoSound通过多阶段自动生成流程构建,包含900个视频中7315个经过验证的QA对。对九个最先进的MLLM进行的全面实验表明,当前的模型表现出新兴的听觉推理能力,但在细粒度的空间和因果理解方面仍然有限。EgoSound为推进多感官以自我为中心智能奠定了具有挑战性的基础,弥合了看到和真正听到世界之间的差距。

🔬 方法详解

问题定义:现有方法在以自我为中心视频中,对声音的理解不足,无法充分利用声音提供的空间布局、屏幕外事件和因果交互等信息。这限制了模型对环境的全面感知和推理能力。现有MLLM主要关注视觉信息,忽略了听觉信息的重要性,尤其是在自我中心视角下,听觉和视觉信息紧密耦合的情况下。

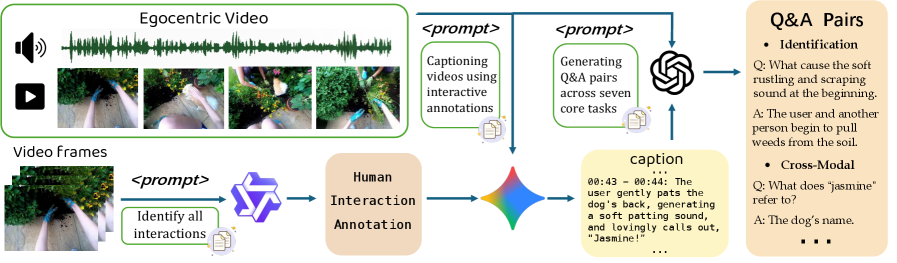

核心思路:EgoSound的核心思路是构建一个专门用于评估以自我为中心视频中声音理解能力的基准数据集。通过设计一系列涵盖不同声音理解任务的问答对,系统地评估MLLM在听觉感知、空间定位、因果推理和跨模态推理等方面的能力。这样可以更全面地了解模型在处理听觉信息方面的优势和不足。

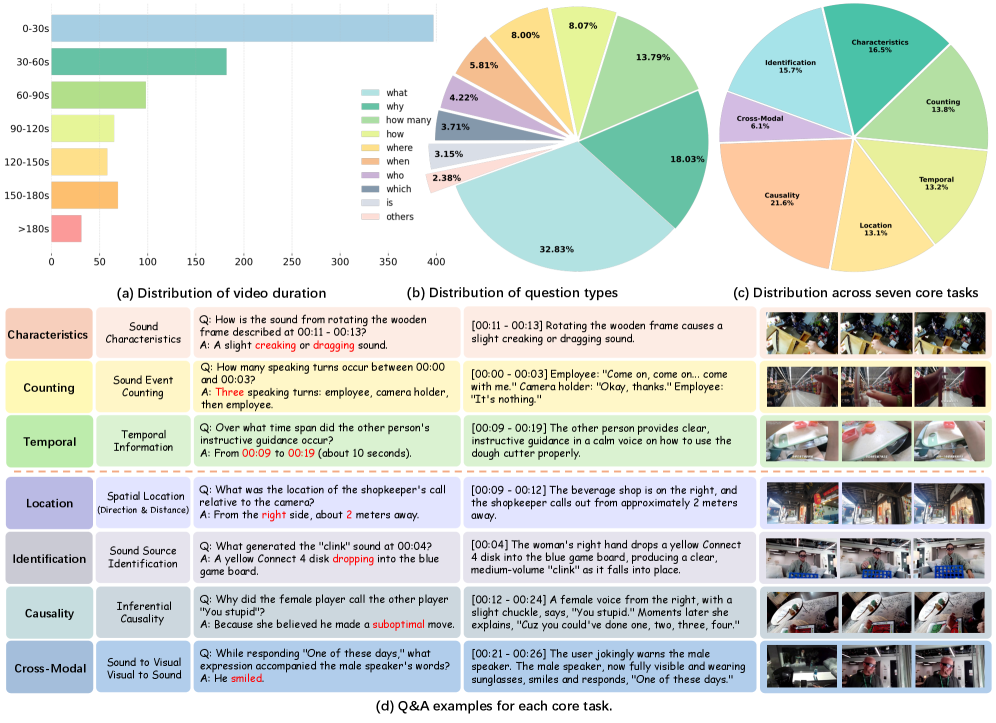

技术框架:EgoSound的构建包含以下主要阶段:1) 数据收集:整合来自Ego4D和EgoBlind的数据,涵盖有视觉和依赖声音的体验。2) 任务定义:定义七个任务,包括内在声音感知、空间定位、因果推理和跨模态推理。3) 问答对生成:通过多阶段自动生成流程,生成与任务相关的问答对。4) 数据验证:人工验证生成的问答对的质量和准确性。最终,EgoSound包含900个视频中7315个经过验证的QA对。

关键创新:EgoSound的关键创新在于它是第一个专门针对以自我为中心视频中声音理解的基准。它不仅统一了现有的相关数据集,还定义了一个全面的任务分类,涵盖了声音理解的多个方面。此外,EgoSound采用了多阶段自动生成流程,可以高效地生成大量的问答对,并保证了数据的质量。

关键设计:EgoSound的关键设计包括:1) 任务分类:七个任务的设计旨在全面评估MLLM在声音理解方面的能力。2) 问答对生成:多阶段自动生成流程包括问题生成、答案生成和验证等步骤,确保问答对的相关性和准确性。3) 数据集规模:包含900个视频和7315个问答对,保证了数据集的规模和多样性。

🖼️ 关键图片

📊 实验亮点

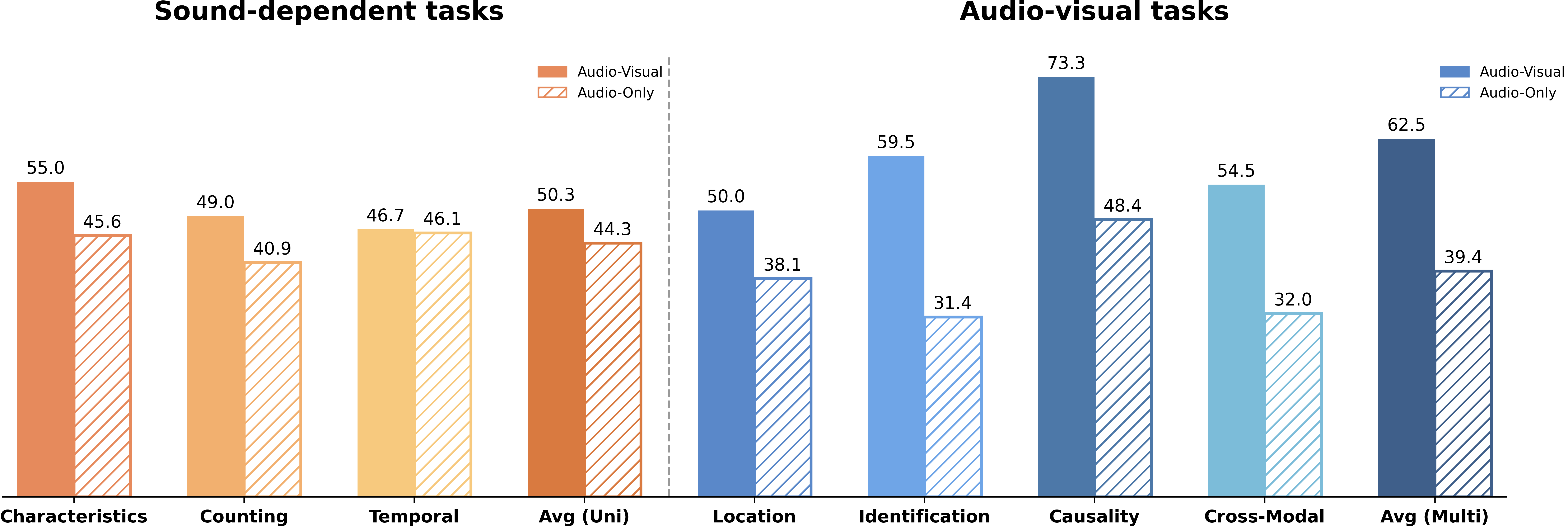

在九个最先进的MLLM上进行的实验表明,现有模型在听觉推理方面表现出初步能力,但在细粒度的空间和因果理解方面仍然存在局限性。例如,模型在回答关于声音来源的具体位置或声音事件的因果关系的问题时,表现不佳。这些结果表明,EgoSound可以有效地评估MLLM在声音理解方面的能力,并为未来的研究提供指导。

🎯 应用场景

EgoSound的研究成果可应用于开发更智能的辅助技术,例如为视障人士提供更精确的环境感知和导航辅助。此外,该基准可以促进多模态人工智能的发展,提升机器人在复杂环境中的感知和交互能力,例如在智能家居、自动驾驶等领域。

📄 摘要(原文)

Multimodal Large Language Models (MLLMs) have recently achieved remarkable progress in vision-language understanding. Yet, human perception is inherently multisensory, integrating sight, sound, and motion to reason about the world. Among these modalities, sound provides indispensable cues about spatial layout, off-screen events, and causal interactions, particularly in egocentric settings where auditory and visual signals are tightly coupled. To this end, we introduce EgoSound, the first benchmark designed to systematically evaluate egocentric sound understanding in MLLMs. EgoSound unifies data from Ego4D and EgoBlind, encompassing both sighted and sound-dependent experiences. It defines a seven-task taxonomy spanning intrinsic sound perception, spatial localization, causal inference, and cross-modal reasoning. Constructed through a multi-stage auto-generative pipeline, EgoSound contains 7315 validated QA pairs across 900 videos. Comprehensive experiments on nine state-of-the-art MLLMs reveal that current models exhibit emerging auditory reasoning abilities but remain limited in fine-grained spatial and causal understanding. EgoSound establishes a challenging foundation for advancing multisensory egocentric intelligence, bridging the gap between seeing and truly hearing the world.