MarsRetrieval: Benchmarking Vision-Language Models for Planetary-Scale Geospatial Retrieval on Mars

作者: Shuoyuan Wang, Yiran Wang, Hongxin Wei

分类: cs.CV, astro-ph.IM, cs.CL

发布日期: 2026-02-15

🔗 代码/项目: GITHUB

💡 一句话要点

MarsRetrieval:火星行星尺度地理空间检索的视觉-语言模型基准测试

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 火星探测 地理空间检索 视觉-语言模型 多模态学习 基准测试

📋 核心要点

- 现有行星科学的深度学习基准测试缺乏文本引导的地理空间检索能力,限制了对火星探测数据的有效利用。

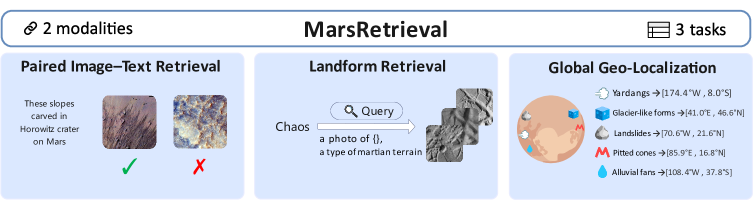

- MarsRetrieval基准测试通过图像-文本检索、地貌检索和全局地理定位三个任务,评估视觉-语言模型在火星地理空间发现中的能力。

- 实验表明,即使是强大的基础模型在MarsRetrieval上也表现出挑战,特定领域的微调对于提升性能至关重要。

📝 摘要(中文)

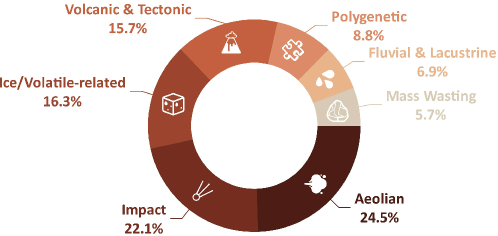

本文提出了MarsRetrieval,一个用于评估视觉-语言模型在火星地理空间发现中的检索基准。现有的基准测试大多局限于封闭集合的监督视觉任务,不支持文本引导的地理空间发现。MarsRetrieval包含三个任务:(1)配对图像-文本检索,(2)地貌检索,和(3)全局地理定位,覆盖了多个空间尺度和不同的地貌起源。我们提出了一个统一的以检索为中心的协议来评估多模态嵌入架构,包括对比双塔编码器和生成式视觉-语言模型。评估表明MarsRetrieval具有挑战性:即使是强大的基础模型也常常无法捕捉到特定领域的地貌差异。我们进一步表明,特定领域的微调对于行星环境中可泛化的地理空间发现至关重要。代码已开源。

🔬 方法详解

问题定义:论文旨在解决现有行星科学基准测试缺乏文本引导的地理空间检索能力的问题。现有方法主要集中在封闭集合的监督视觉任务,无法有效支持基于文本描述的火星地貌和地理位置检索,阻碍了对火星探测数据的深入理解和利用。

核心思路:论文的核心思路是构建一个专门针对火星地理空间检索的基准测试,即MarsRetrieval。该基准测试包含多个任务,涵盖不同空间尺度和地貌类型,旨在评估和提升视觉-语言模型在火星环境下的地理空间理解和检索能力。通过提供一个标准化的评估平台,促进相关算法的开发和优化。

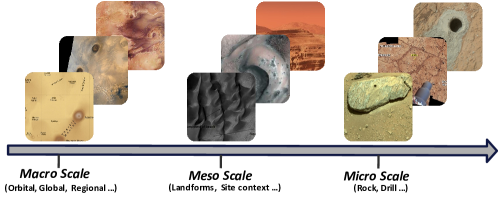

技术框架:MarsRetrieval基准测试包含三个主要任务:1) 配对图像-文本检索:根据文本描述检索对应的火星图像,或根据图像检索对应的文本描述;2) 地貌检索:根据文本描述检索特定类型的地貌图像,例如沙丘、陨石坑等;3) 全局地理定位:根据图像或文本描述确定火星表面的地理位置。该基准测试使用统一的检索协议,评估各种多模态嵌入架构,包括对比双塔编码器和生成式视觉-语言模型。

关键创新:MarsRetrieval的关键创新在于其针对行星尺度地理空间检索的特性。它首次将视觉-语言模型应用于火星探测数据的检索任务,并提供了一个标准化的评估平台。此外,该基准测试涵盖了多个空间尺度和地貌类型,更全面地评估了模型的泛化能力。

关键设计:MarsRetrieval的关键设计包括:1) 多样化的数据集:包含来自不同火星探测任务的图像和文本数据,涵盖各种地貌类型和地理位置;2) 统一的检索协议:使用标准的检索指标(例如Recall@K)评估模型的性能;3) 对比双塔编码器和生成式视觉-语言模型:评估不同类型的多模态嵌入架构在火星地理空间检索任务中的表现;4) 领域特定微调:研究领域特定微调对模型性能的影响。

🖼️ 关键图片

📊 实验亮点

实验结果表明,即使是强大的预训练视觉-语言模型在MarsRetrieval上也表现出挑战,表明火星地理空间检索任务的复杂性。通过领域特定数据的微调,模型性能得到显著提升,验证了领域知识对于行星尺度地理空间检索的重要性。具体性能数据和提升幅度在论文中详细给出。

🎯 应用场景

MarsRetrieval的研究成果可应用于火星探测任务的数据分析和知识发现。例如,可以利用该基准测试训练的模型,根据科学家提供的文本描述,快速检索相关的火星图像和地理位置,辅助地质分析和探测目标选择。此外,该研究也为其他行星探测任务的地理空间检索提供了借鉴。

📄 摘要(原文)

Data-driven approaches like deep learning are rapidly advancing planetary science, particularly in Mars exploration. Despite recent progress, most existing benchmarks remain confined to closed-set supervised visual tasks and do not support text-guided retrieval for geospatial discovery. We introduce MarsRetrieval, a retrieval benchmark for evaluating vision-language models for Martian geospatial discovery. MarsRetrieval includes three tasks: (1) paired image-text retrieval, (2) landform retrieval, and (3) global geo-localization, covering multiple spatial scales and diverse geomorphic origins. We propose a unified retrieval-centric protocol to benchmark multimodal embedding architectures, including contrastive dual-tower encoders and generative vision-language models. Our evaluation shows MarsRetrieval is challenging: even strong foundation models often fail to capture domain-specific geomorphic distinctions. We further show that domain-specific fine-tuning is critical for generalizable geospatial discovery in planetary settings. Our code is available at https://github.com/ml-stat-Sustech/MarsRetrieval