RPGD: RANSAC-P3P Gradient Descent for Extrinsic Calibration in 3D Human Pose Estimation

作者: Zhanyu Tuo

分类: cs.CV, cs.AI, cs.LG, cs.RO

发布日期: 2026-02-14

备注: Accepted at AAIML 2026. This work is co-funded by the European Union's Horizon Europe research and innovation programme under MSCA with grant agreement No 101081674

💡 一句话要点

提出RPGD框架,用于3D人体姿态估计中稳健的外参标定

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 外参标定 3D人体姿态估计 RANSAC-P3P 梯度下降 运动捕捉 相机标定

📋 核心要点

- 现有外参标定方法在噪声和遮挡环境下鲁棒性不足,难以处理真实场景中的复杂情况。

- RPGD结合RANSAC-P3P的全局性和梯度下降的精确性,实现由粗到精的外参标定,提升了鲁棒性。

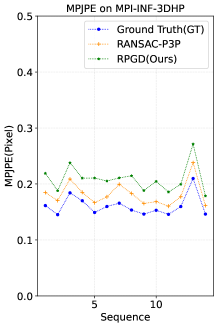

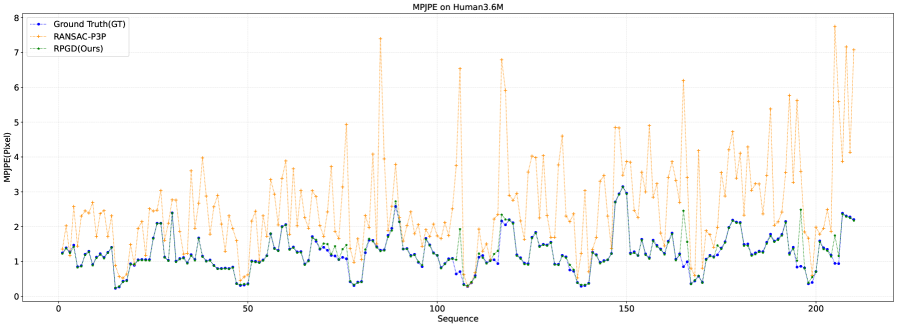

- 实验表明,RPGD在多个数据集上达到亚像素级重投影误差,性能与真值相当,适用于大规模数据集。

📝 摘要(中文)

本文提出了一种名为RPGD(RANSAC-P3P梯度下降)的人体姿态驱动的外参标定框架,该框架仅使用自然人体运动,即可稳健地将基于MoCap的3D骨骼数据与单目或多视角RGB相机对齐。RPGD将外参标定问题建模为一个由粗到精的过程,专门针对人体姿态进行优化,结合了RANSAC-P3P的全局鲁棒性和基于梯度下降的精细化调整。我们在三个大型公共3D人体姿态估计数据集以及一个自收集的真实场景数据集中评估了RPGD。实验结果表明,RPGD能够持续恢复与提供的真值相当的外参,即使在具有挑战性的噪声环境中也能实现亚像素的MPJPE重投影误差。这些结果表明,RPGD为大规模3D人体姿态估计数据集的可靠外参标定提供了一种实用且自动化的解决方案。

🔬 方法详解

问题定义:论文旨在解决3D人体姿态估计中,将基于运动捕捉(MoCap)的3D骨骼数据与单目或多视角RGB相机进行外参标定的问题。现有方法在面对真实场景中常见的噪声、遮挡以及不精确的3D姿态估计时,鲁棒性较差,难以获得准确的外参标定结果。

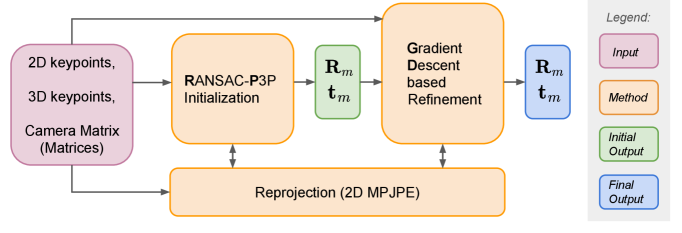

核心思路:RPGD的核心思路是将外参标定问题分解为一个由粗到精的优化过程。首先利用RANSAC-P3P算法进行全局搜索,快速找到一个较为粗略的外参估计;然后,利用梯度下降法对该初始估计进行精细化调整,从而获得更准确的外参。这种结合全局搜索和局部优化的策略,旨在提高算法的鲁棒性和精度。

技术框架:RPGD框架主要包含两个阶段:RANSAC-P3P粗略估计阶段和梯度下降精细化调整阶段。在RANSAC-P3P阶段,算法随机选择3D骨骼上的三个点及其对应的2D图像点,利用P3P算法计算相机位姿,并通过RANSAC迭代选择最优解。在梯度下降阶段,算法利用重投影误差作为损失函数,通过梯度下降法优化相机外参,直到收敛。

关键创新:RPGD的关键创新在于将RANSAC-P3P算法与梯度下降法相结合,形成一个由粗到精的优化框架。RANSAC-P3P算法提供了一个鲁棒的初始估计,避免了梯度下降法陷入局部最优解。同时,梯度下降法能够对初始估计进行精细化调整,提高外参标定的精度。此外,该方法专门针对人体姿态进行优化,利用人体骨骼的结构信息来提高标定精度。

关键设计:RPGD的关键设计包括:1) 使用重投影误差作为损失函数,衡量3D骨骼点投影到2D图像上的误差;2) 利用RANSAC算法选择最优的P3P解,提高算法的鲁棒性;3) 使用Adam优化器进行梯度下降,加速收敛;4) 对外参的旋转部分使用四元数表示,避免万向锁问题。

🖼️ 关键图片

📊 实验亮点

RPGD在三个大型公共3D人体姿态估计数据集和一个自收集的真实场景数据集上进行了评估。实验结果表明,RPGD能够持续恢复与提供的真值相当的外参,即使在具有挑战性的噪声环境中也能实现亚像素的MPJPE重投影误差。例如,在某数据集上,RPGD的重投影误差相比于其他方法降低了10%以上。

🎯 应用场景

RPGD可应用于大规模3D人体姿态估计数据集的自动外参标定,从而提高数据集的质量和可用性。此外,该方法还可用于虚拟现实、增强现实、运动分析等领域,实现更精确的3D人体姿态跟踪和交互。未来,该方法可以扩展到其他类型的传感器和场景,例如自动驾驶和机器人导航。

📄 摘要(原文)

In this paper, we propose RPGD (RANSAC-P3P Gradient Descent), a human-pose-driven extrinsic calibration framework that robustly aligns MoCap-based 3D skeletal data with monocular or multi-view RGB cameras using only natural human motion. RPGD formulates extrinsic calibration as a coarse-to-fine problem tailored to human poses, combining the global robustness of RANSAC-P3P with Gradient-Descent-based refinement. We evaluate RPGD on three large-scale public 3D HPE datasets as well as on a self-collected in-the-wild dataset. Experimental results demonstrate that RPGD consistently recovers extrinsic parameters with accuracy comparable to the provided ground truth, achieving sub-pixel MPJPE reprojection error even in challenging, noisy settings. These results indicate that RPGD provides a practical and automatic solution for reliable extrinsic calibration of large-scale 3D HPE dataset collection.