OmniScience: A Large-scale Multi-modal Dataset for Scientific Image Understanding

作者: Haoyi Tao, Chaozheng Huang, Nan Wang, Han Lyu, Linfeng Zhang, Guolin Ke, Xi Fang

分类: cs.CV, cs.AI

发布日期: 2026-02-14

💡 一句话要点

提出OmniScience大规模多模态数据集,提升科学图像理解能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 科学图像理解 大型数据集 数据增强 视觉问答

📋 核心要点

- 现有数据集在科学图像领域覆盖不足,注释粗糙,语义基础薄弱,限制了多模态大模型在科学图像理解上的能力。

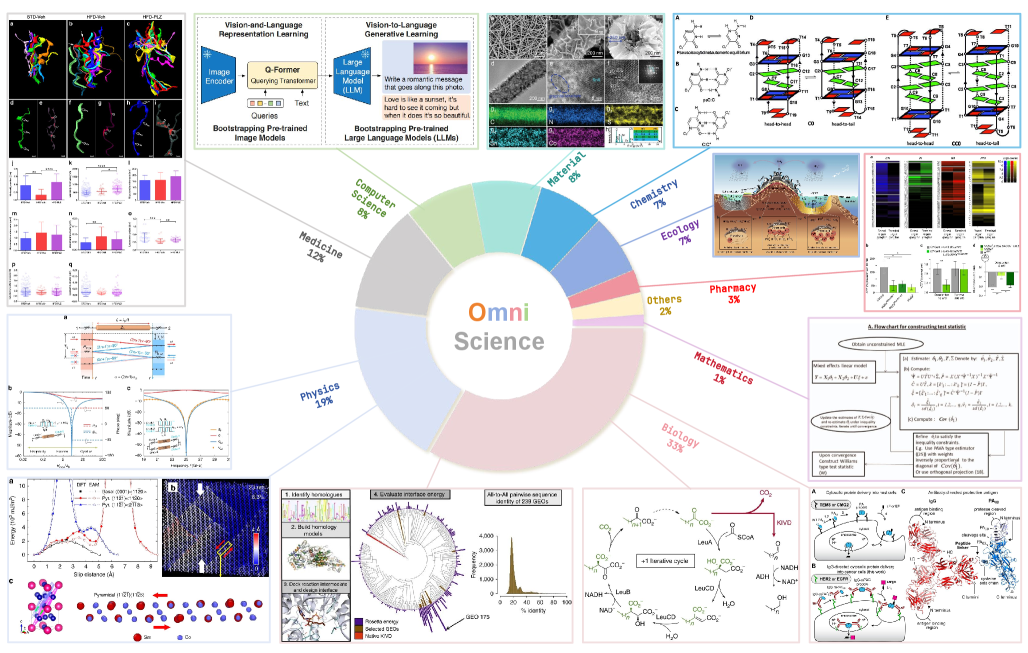

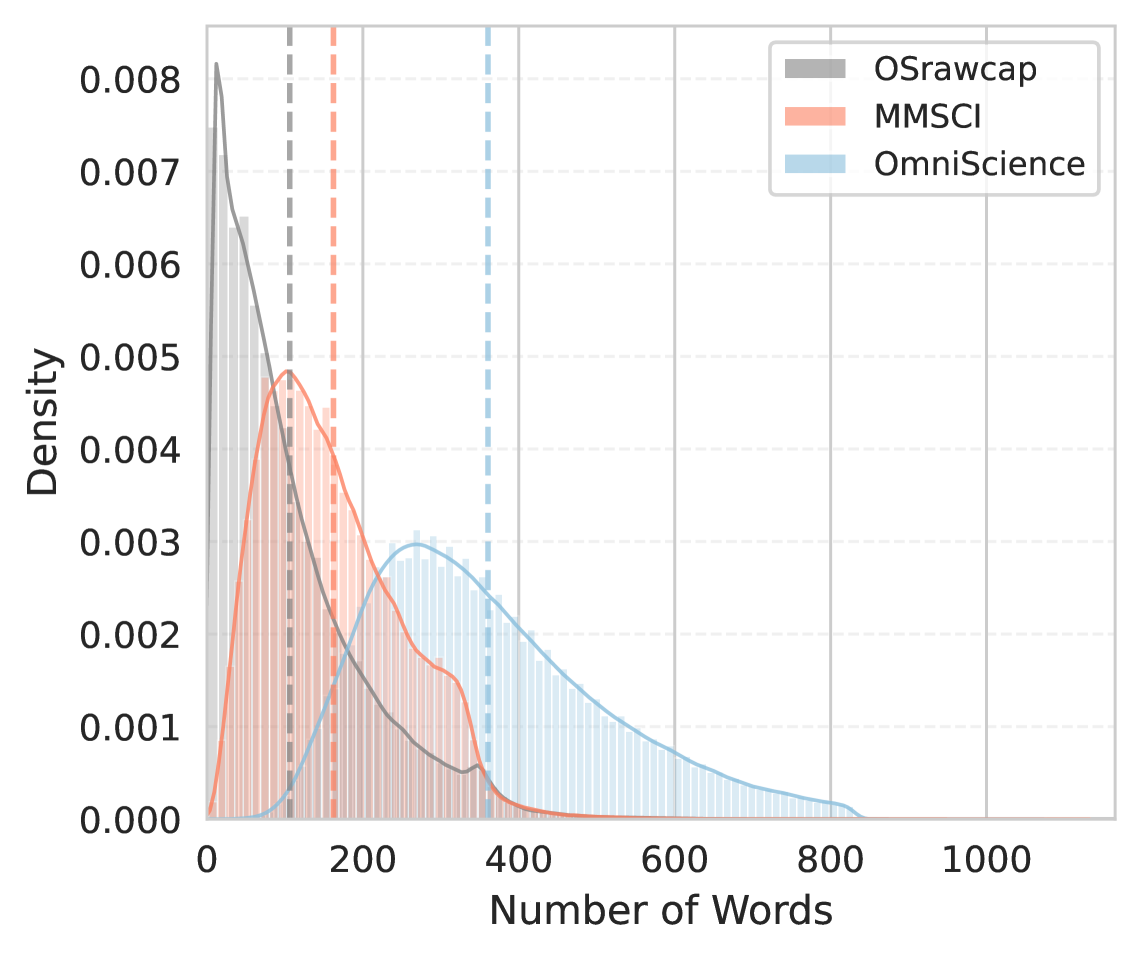

- 提出OmniScience数据集,包含150万图-标题-上下文三元组,并设计动态模型路由重述标题流程,提升数据质量。

- 实验表明,在OmniScience上微调的模型在MM-MT-Bench和MMMU等基准测试中取得了显著提升,验证了数据集的有效性。

📝 摘要(中文)

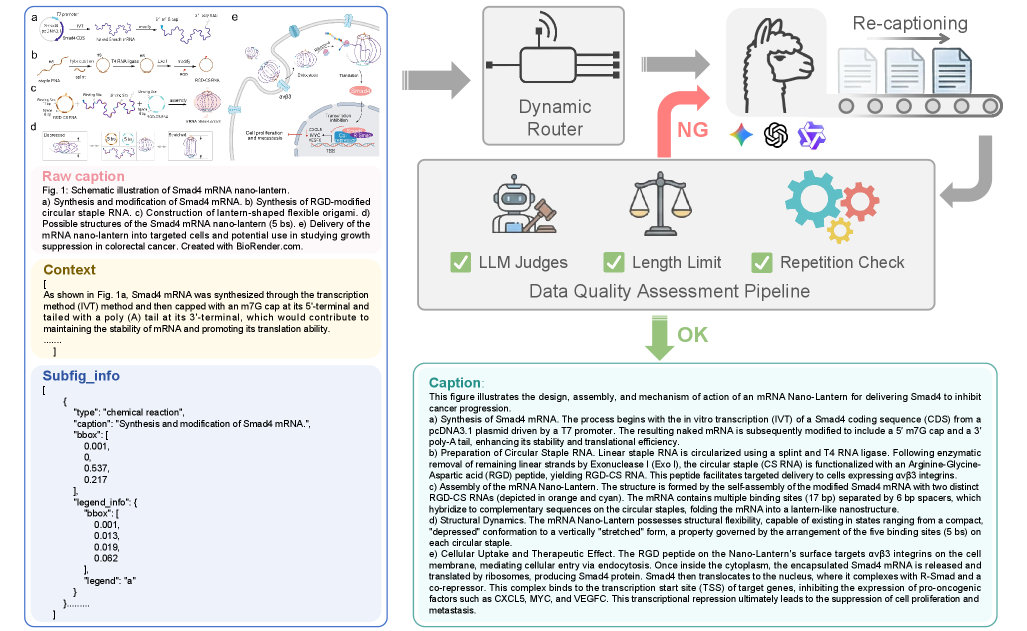

多模态大型语言模型在自然图像理解方面表现出色,但在解释科学图像(包括示意图、实验表征和分析图表)方面的能力有限,尤其是在开源MLLM中。这种差距主要源于现有数据集的领域覆盖范围有限、结构注释粗糙以及语义基础薄弱。我们引入了OmniScience,这是一个大规模、高保真的多模态数据集,包含150万个图-标题-上下文三元组,涵盖10多个主要科学学科。为了获得信息密度和准确性更高的图像标题数据,用于多模态大型模型训练,我们开发了一种动态模型路由重述标题流程,该流程利用最先进的多模态大型语言模型,通过联合合成视觉特征、原始图标题和人类科学家撰写的相应文本引用来生成密集、独立的描述。该流程通过严格的质量过滤和与人类专家判断的对齐得到进一步加强,确保了事实准确性和语义完整性,并将图像-文本多模态相似度得分从0.769提高到0.956。我们进一步提出了一种标题问答协议,作为评估视觉理解的代理任务。在此设置下,在OmniScience上微调的Qwen2.5-VL-3B模型显示出相对于基线的显着提升,在MM-MT-Bench上获得了0.378的增益,在MMMU上获得了0.140的增益。

🔬 方法详解

问题定义:现有的大型多模态模型在自然图像理解上表现良好,但在科学图像理解方面存在不足。现有的科学图像数据集存在领域覆盖范围有限、结构注释粗糙、语义基础薄弱等问题,无法有效训练多模态模型,使其具备理解科学图像的能力。

核心思路:论文的核心思路是构建一个大规模、高质量的科学图像数据集OmniScience,并设计一个动态模型路由重述标题流程来生成更准确、更密集的图像描述。通过高质量的数据和有效的训练方法,提升多模态模型在科学图像理解方面的能力。

技术框架:OmniScience数据集构建流程主要包含数据收集、动态模型路由重述标题、质量过滤和人工对齐等阶段。动态模型路由重述标题流程利用先进的多模态大语言模型,结合视觉特征、原始标题和上下文信息,生成更全面的图像描述。

关键创新:关键创新在于动态模型路由重述标题流程,该流程能够自动生成高质量的图像描述,并结合人工过滤和对齐,确保数据的准确性和完整性。此外,论文还提出了一个标题问答协议,用于评估视觉理解能力。

关键设计:动态模型路由重述标题流程中,使用了多个先进的多模态大语言模型,并设计了合适的路由策略,以选择最合适的模型生成标题。质量过滤阶段使用了多种指标,如信息密度、准确性等,并结合人工审核,确保数据质量。在实验中,使用了Qwen2.5-VL-3B模型进行微调,并采用了合适的学习率和训练策略。

🖼️ 关键图片

📊 实验亮点

OmniScience数据集将图像-文本多模态相似度得分从0.769提高到0.956。在OmniScience上微调的Qwen2.5-VL-3B模型在MM-MT-Bench上获得了0.378的增益,在MMMU上获得了0.140的增益,显著优于基线模型。

🎯 应用场景

OmniScience数据集可用于训练更强大的科学图像理解模型,从而在科研领域实现更智能的自动化分析和知识发现。例如,可以帮助研究人员快速理解论文中的图表,自动提取实验数据,辅助科学研究和教育。

📄 摘要(原文)

Multimodal Large Language Models demonstrate strong performance on natural image understanding, yet exhibit limited capability in interpreting scientific images, including but not limited to schematic diagrams, experimental characterizations, and analytical charts. This limitation is particularly pronounced in open-source MLLMs. The gap largely stems from existing datasets with limited domain coverage, coarse structural annotations, and weak semantic grounding. We introduce OmniScience, a large-scale, high-fidelity multi-modal dataset comprising 1.5 million figure-caption-context triplets, spanning more than 10 major scientific disciplines. To obtain image caption data with higher information density and accuracy for multi-modal large-model training, we develop a dynamic model-routing re-captioning pipeline that leverages state-of-the-art multi-modal large language models to generate dense, self-contained descriptions by jointly synthesizing visual features, original figure captions, and corresponding in-text references authored by human scientists. The pipeline is further reinforced with rigorous quality filtering and alignment with human expert judgments, ensuring both factual accuracy and semantic completeness, and boosts the image-text multi-modal similarity score from 0.769 to 0.956. We further propose a caption QA protocol as a proxy task for evaluating visual understanding. Under this setting, Qwen2.5-VL-3B model finetuned on OmniScience show substantial gains over baselines, achieving a gain of 0.378 on MM-MT-Bench and a gain of 0.140 on MMMU.