A WDLoRA-Based Multimodal Generative Framework for Clinically Guided Corneal Confocal Microscopy Image Synthesis in Diabetic Neuropathy

作者: Xin Zhang, Liangxiu Han, Yue Shi, Yalin Zheng, Uazman Alam, Maryam Ferdousi, Rayaz Malik

分类: cs.CV

发布日期: 2026-02-14

💡 一句话要点

提出基于WDLoRA的多模态生成框架,用于糖尿病神经病变中临床引导的角膜共聚焦显微镜图像合成。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 角膜共聚焦显微镜 糖尿病神经病变 图像合成 多模态生成 权重分解低秩适应 参数高效微调 医学图像分析

📋 核心要点

- 现有CCM图像数据稀缺,且神经形态差异大,限制了基于深度学习的DPN自动诊断模型的发展。

- 提出WDLoRA方法,解耦权重更新的幅度和方向,使模型能独立学习神经拓扑和基质对比度,提升医学图像真实感。

- 实验表明,该框架在视觉保真度和结构完整性上优于GAN和扩散模型,并能提升下游诊断和分割任务的性能。

📝 摘要(中文)

角膜共聚焦显微镜(CCM)是评估糖尿病周围神经病变(DPN)中小纤维损伤的敏感工具。然而,由于标记数据稀缺和角膜神经形态的精细差异,开发基于深度学习的鲁棒自动诊断模型受到限制。尽管人工智能(AI)驱动的基础生成模型擅长自然图像合成,但由于领域特定训练的限制,它们在医学成像中表现不佳,从而损害了临床分析所需的解剖学保真度。为了克服这些限制,我们提出了一种基于权重分解低秩适应(WDLoRA)的多模态生成框架,用于临床引导的CCM图像合成。WDLoRA是一种参数高效的微调(PEFT)机制,它解耦了幅度和方向权重更新,使基础生成模型能够独立地学习医学真实感所需的方向(神经拓扑)和强度(基质对比度)。通过联合调节神经分割掩码和疾病特异性临床提示,该模型可以合成跨DPN谱(对照、T1NoDPN、T1DPN)的解剖学连贯图像。全面的三支柱评估表明,所提出的框架实现了最先进的视觉保真度(Fréchet Inception Distance (FID): 5.18)和结构完整性(结构相似性指数度量(SSIM): 0.630),显著优于GAN和标准扩散基线。至关重要的是,合成图像保留了金标准临床生物标志物,并且在统计上与真实患者数据等效。当用于训练自动诊断模型时,合成数据集将下游诊断准确率提高了2.1%,分割性能提高了2.2%,验证了该框架在缓解医学人工智能数据瓶颈方面的潜力。

🔬 方法详解

问题定义:论文旨在解决糖尿病周围神经病变(DPN)诊断中,由于角膜共聚焦显微镜(CCM)图像数据量不足且标注困难,导致深度学习模型难以训练的问题。现有方法在医学图像生成方面存在解剖结构保真度不足的痛点。

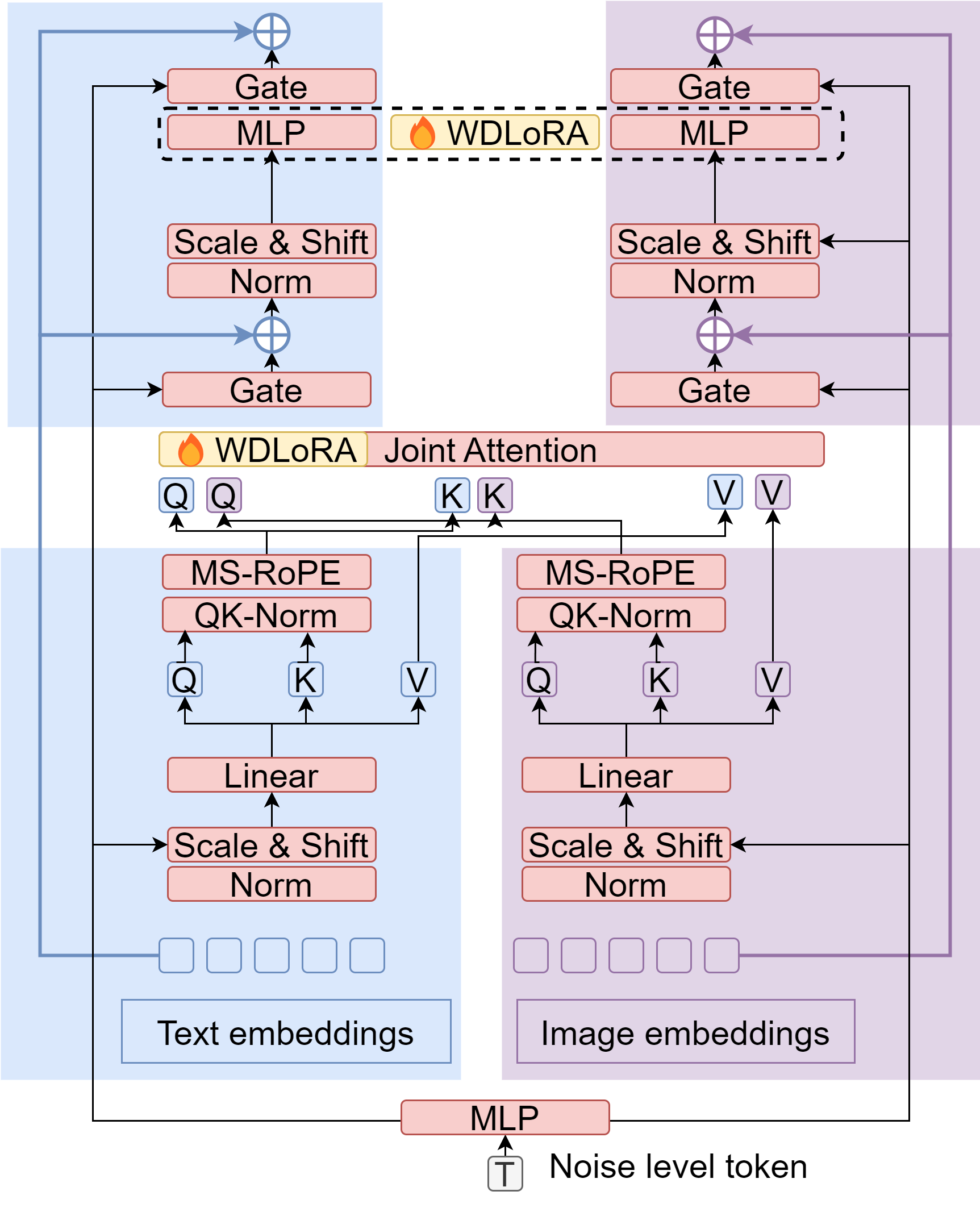

核心思路:论文的核心思路是利用参数高效微调(PEFT)技术WDLoRA,对预训练的生成模型进行微调,使其能够更好地适应CCM图像的生成任务。通过解耦权重更新的幅度和方向,模型可以独立学习神经拓扑结构和基质对比度,从而提高生成图像的真实感和临床价值。

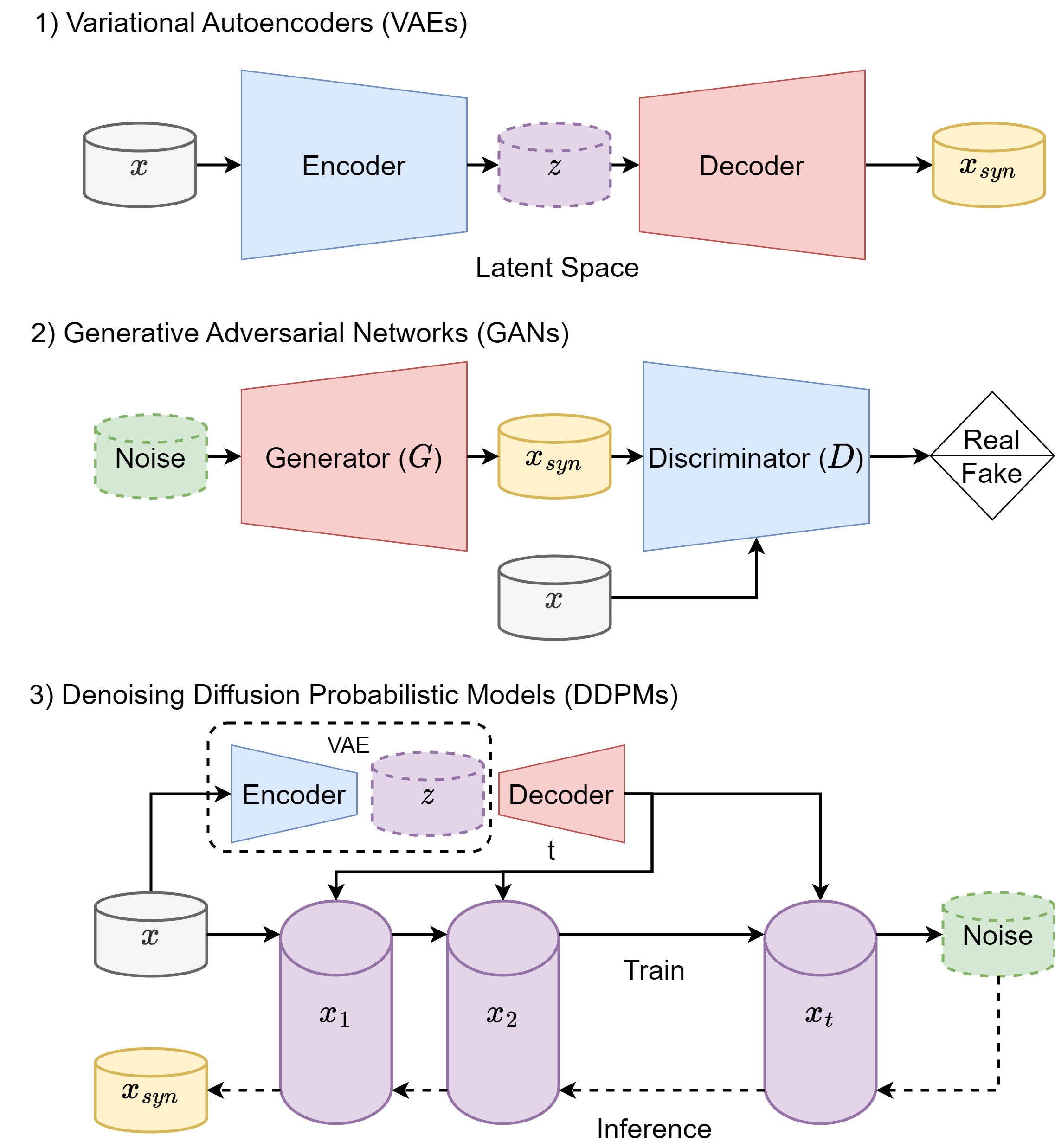

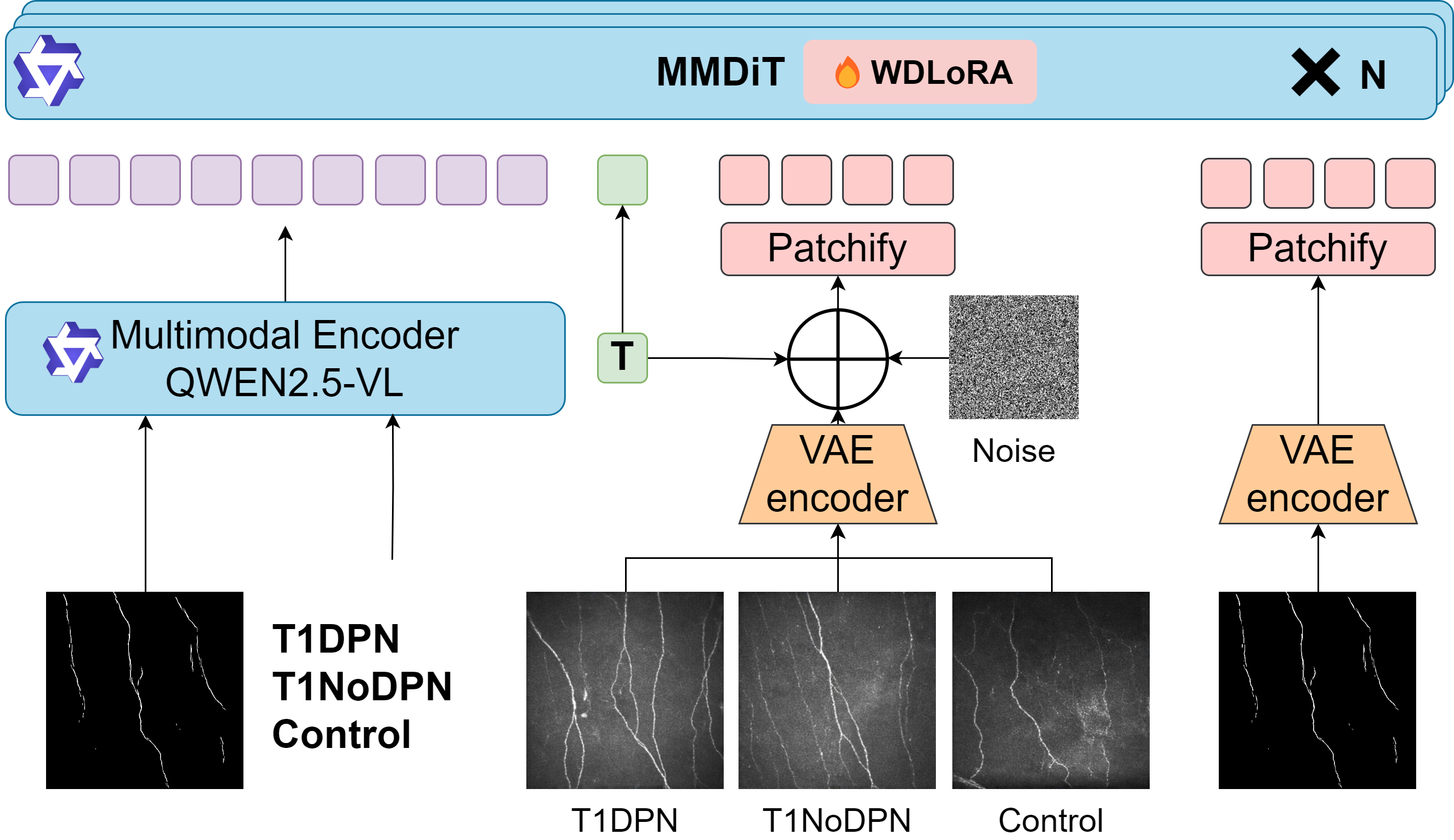

技术框架:该框架是一个多模态生成模型,以神经分割掩码和疾病特异性临床提示作为输入,生成CCM图像。主要包含以下几个阶段:1) 使用预训练的生成模型作为基础;2) 引入WDLoRA模块进行参数高效微调;3) 使用神经分割掩码和临床提示作为条件输入;4) 生成高质量的CCM图像。

关键创新:论文最重要的技术创新点在于WDLoRA的应用。WDLoRA通过解耦权重更新的幅度和方向,使得模型能够更好地学习医学图像的复杂特征,从而提高生成图像的质量和真实感。与传统的微调方法相比,WDLoRA具有更高的参数效率和更好的泛化能力。

关键设计:论文的关键设计包括:1) 使用预训练的生成模型,例如扩散模型,以利用其强大的生成能力;2) 设计合适的神经分割掩码和临床提示,以引导生成过程;3) 使用FID和SSIM等指标评估生成图像的质量;4) 将生成的图像用于训练下游诊断模型,以验证其临床价值。

🖼️ 关键图片

📊 实验亮点

该研究提出的WDLoRA框架在CCM图像生成任务上取得了显著的性能提升。实验结果表明,该框架实现了最先进的视觉保真度(FID: 5.18)和结构完整性(SSIM: 0.630),显著优于GAN和标准扩散模型。此外,使用合成图像训练的诊断模型,其诊断准确率提高了2.1%,分割性能提高了2.2%。

🎯 应用场景

该研究成果可应用于医学图像生成、数据增强和疾病诊断等领域。通过生成高质量的合成CCM图像,可以缓解DPN诊断中数据不足的问题,提高诊断模型的准确性和鲁棒性。此外,该方法还可以推广到其他医学图像生成任务中,为医学人工智能的发展提供新的思路。

📄 摘要(原文)

Corneal Confocal Microscopy (CCM) is a sensitive tool for assessing small-fiber damage in Diabetic Peripheral Neuropathy (DPN), yet the development of robust, automated deep learning-based diagnostic models is limited by scarce labelled data and fine-grained variability in corneal nerve morphology. Although Artificial Intelligence (AI)-driven foundation generative models excel at natural image synthesis, they often struggle in medical imaging due to limited domain-specific training, compromising the anatomical fidelity required for clinical analysis. To overcome these limitations, we propose a Weight-Decomposed Low-Rank Adaptation (WDLoRA)-based multimodal generative framework for clinically guided CCM image synthesis. WDLoRA is a parameter-efficient fine-tuning (PEFT) mechanism that decouples magnitude and directional weight updates, enabling foundation generative models to independently learn the orientation (nerve topology) and intensity (stromal contrast) required for medical realism. By jointly conditioning on nerve segmentation masks and disease-specific clinical prompts, the model synthesises anatomically coherent images across the DPN spectrum (Control, T1NoDPN, T1DPN). A comprehensive three-pillar evaluation demonstrates that the proposed framework achieves state-of-the-art visual fidelity (Fréchet Inception Distance (FID): 5.18) and structural integrity (Structural Similarity Index Measure (SSIM): 0.630), significantly outperforming GAN and standard diffusion baselines. Crucially, the synthetic images preserve gold-standard clinical biomarkers and are statistically equivalent to real patient data. When used to train automated diagnostic models, the synthetic dataset improves downstream diagnostic accuracy by 2.1% and segmentation performance by 2.2%, validating the framework's potential to alleviate data bottlenecks in medical AI.