Monocular Markerless Motion Capture Enables Quantitative Assessment of Upper Extremity Reachable Workspace

作者: Seth Donahue, J. D. Peiffer, R. Tyler Richardson, Yishan Zhong, Shaun Q. Y. Tan, Benoit Marteau, Stephanie R. Russo, May D. Wang, R. James Cotton, Ross Chafetz

分类: cs.CV

发布日期: 2026-02-13

💡 一句话要点

单目无标记动作捕捉实现上肢可达工作空间定量评估

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction)

关键词: 单目视觉 无标记动作捕捉 上肢可达工作空间 临床评估 人工智能

📋 核心要点

- 现有上肢可达工作空间(UERW)评估方法复杂且成本高,限制了其在临床上的广泛应用。

- 本研究提出使用单目相机和AI驱动的无标记动作捕捉(MMC)技术,简化UERW的量化评估流程。

- 实验结果表明,正面单目相机配置与基于标记的动作捕捉系统具有良好的一致性,验证了该方法的可行性。

📝 摘要(中文)

本研究旨在验证一种临床可及的方法,该方法使用单目相机和人工智能驱动的无标记动作捕捉(MMC)技术,用于量化上肢可达工作空间(UERW)并进行生物力学分析。对这些技术在特定临床任务中的客观评估和验证对于其在临床运动分析中的应用至关重要。人工智能驱动的单目MMC降低了临床应用的门槛,并有可能减少对常见临床评估的分析开销。九名无损伤的成年参与者执行了标准化的UERW任务,该任务包括到达分布在以躯干为中心的虚拟球体上的目标,目标显示在VR头显中。使用基于标记的动作捕捉系统和一组八个FLIR相机同时捕捉运动。我们对两个视频摄像机视图进行了单目视频分析,以比较正面和偏移相机配置。正面相机方向与基于标记的参考表现出很强的一致性,每个八分区的平均偏差最小,为0.61 ± 0.12 %(平均值 ± 标准差)。相比之下,偏移相机视图低估了到达的工作空间百分比(-5.66 ± 0.45 %)。结论:研究结果支持正面单目相机配置用于UERW评估的可行性,特别是对于前部工作空间评估,其中与基于标记的动作捕捉的一致性最高。总体性能证明了单相机评估的临床潜力。本研究首次验证了用于评估UERW任务的单目MMC系统。通过降低技术复杂性,这种方法能够更广泛地实施定量上肢活动能力评估。

🔬 方法详解

问题定义:论文旨在解决上肢可达工作空间(UERW)的定量评估问题。传统的基于标记的动作捕捉系统虽然精度高,但设备昂贵、设置复杂,难以在临床环境中普及。因此,需要一种更简单、更经济的解决方案,以便更广泛地进行上肢功能评估。

核心思路:论文的核心思路是利用单目相机和人工智能驱动的无标记动作捕捉(MMC)技术,替代传统的基于标记的动作捕捉系统。通过AI算法直接从单目视频中估计人体姿态,从而实现对UERW的定量分析,降低了设备成本和操作复杂度。

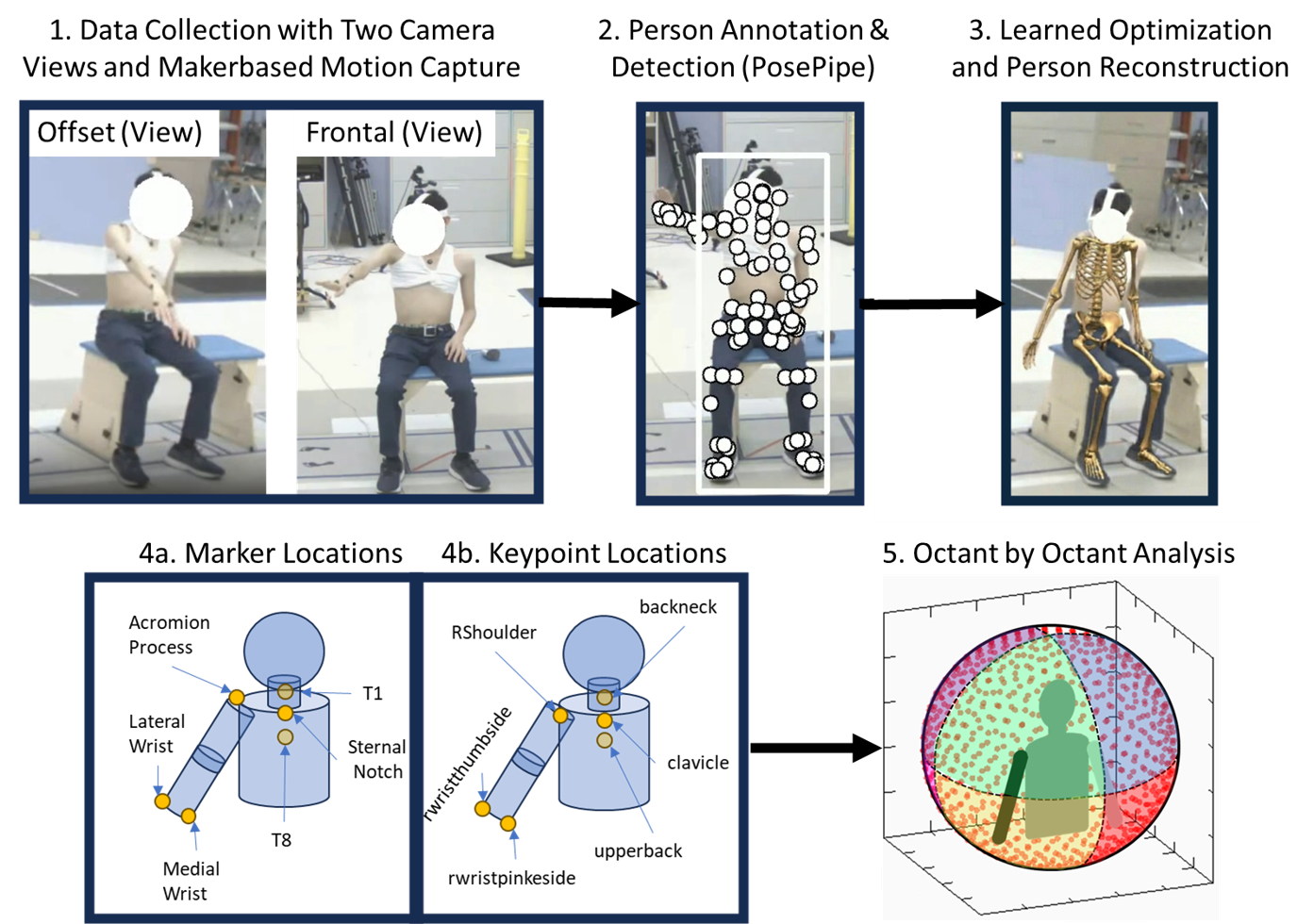

技术框架:整体流程包括:1) 使用VR头显呈现UERW任务的目标点;2) 使用单目相机记录参与者完成任务的视频;3) 使用AI算法对视频进行无标记动作捕捉,估计上肢关节位置;4) 根据关节位置计算可达工作空间;5) 将单目相机结果与基于标记的动作捕捉系统结果进行对比验证。

关键创新:最重要的技术创新点在于验证了单目无标记动作捕捉系统用于UERW评估的可行性。以往的研究大多依赖于多目或深度相机,而本研究表明,通过合理的相机配置和AI算法,单目相机也能实现较为准确的UERW评估。

关键设计:研究中比较了正面和偏移两种相机配置,发现正面相机配置与基于标记的动作捕捉系统具有更好的一致性。此外,研究使用了标准化的UERW任务,确保了实验的可重复性和结果的可比性。具体的AI算法细节未在摘要中详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

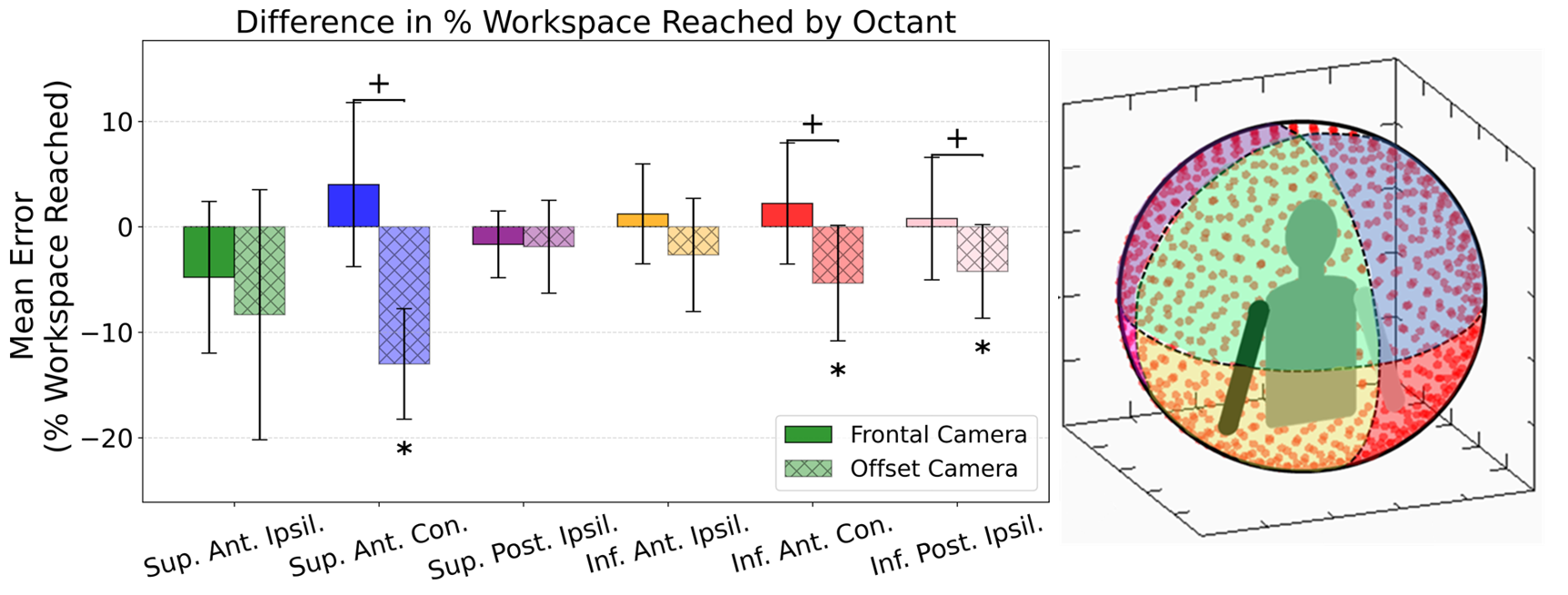

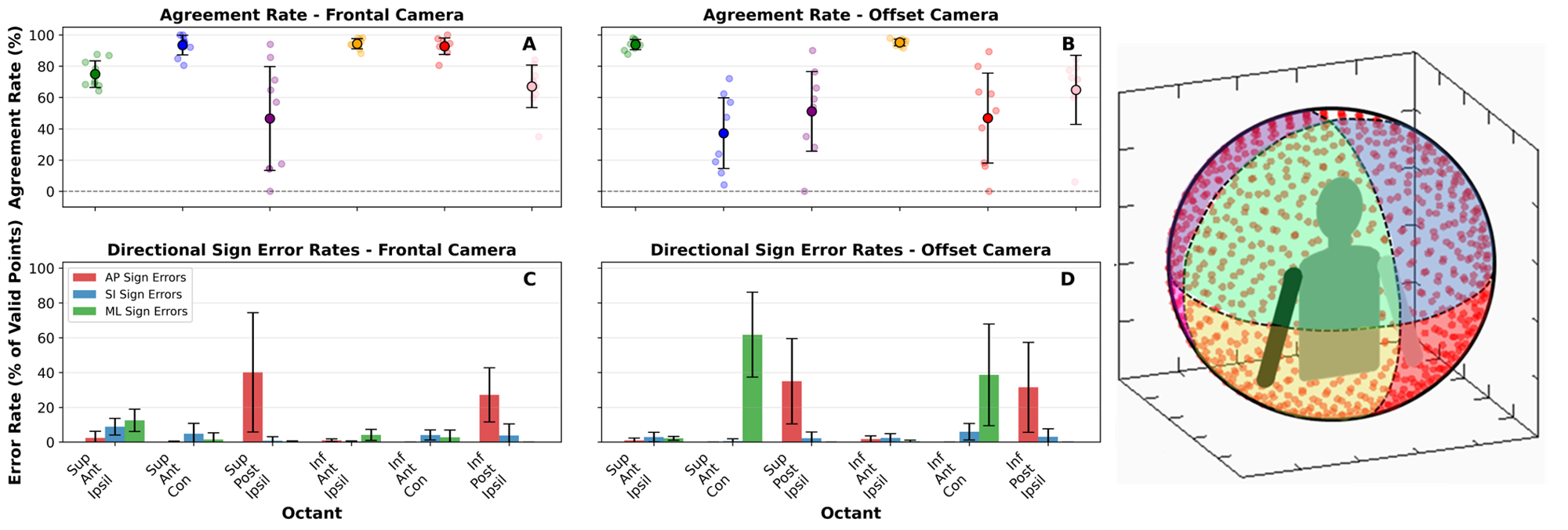

实验结果表明,正面单目相机配置与基于标记的动作捕捉系统具有良好的一致性,每个八分区的平均偏差仅为0.61 ± 0.12 %。相比之下,偏移相机配置低估了到达的工作空间百分比(-5.66 ± 0.45 %)。该研究首次验证了单目MMC系统用于评估UERW任务的可行性。

🎯 应用场景

该研究成果可广泛应用于临床康复、运动医学和人机工程学等领域。通过单目相机和AI技术,可以方便快捷地评估患者的上肢功能,为康复治疗方案的制定提供客观依据。此外,该技术还可以用于评估工作场所的人体工程学设计,预防职业病。

📄 摘要(原文)

To validate a clinically accessible approach for quantifying the Upper Extremity Reachable Workspace (UERW) using a single (monocular) camera and Artificial Intelligence (AI)-driven Markerless Motion Capture (MMC) for biomechanical analysis. Objective assessment and validation of these techniques for specific clinically oriented tasks are crucial for their adoption in clinical motion analysis. AI-driven monocular MMC reduces the barriers to adoption in the clinic and has the potential to reduce the overhead for analysis of this common clinical assessment. Nine adult participants with no impairments performed the standardized UERW task, which entails reaching targets distributed across a virtual sphere centered on the torso, with targets displayed in a VR headset. Movements were simultaneously captured using a marker-based motion capture system and a set of eight FLIR cameras. We performed monocular video analysis on two of these video camera views to compare a frontal and offset camera configurations. The frontal camera orientation demonstrated strong agreement with the marker-based reference, exhibiting a minimal mean bias of $0.61 \pm 0.12$ \% reachspace reached per octanct (mean $\pm$ standard deviation). In contrast, the offset camera view underestimated the percent workspace reached ($-5.66 \pm 0.45$ \% reachspace reached). Conclusion: The findings support the feasibility of a frontal monocular camera configuration for UERW assessment, particularly for anterior workspace evaluation where agreement with marker-based motion capture was highest. The overall performance demonstrates clinical potential for practical, single-camera assessments. This study provides the first validation of monocular MMC system for the assessment of the UERW task. By reducing technical complexity, this approach enables broader implementation of quantitative upper extremity mobility assessment.