LongStream: Long-Sequence Streaming Autoregressive Visual Geometry

作者: Chong Cheng, Xianda Chen, Tao Xie, Wei Yin, Weiqiang Ren, Qian Zhang, Xiaoyuang Guo, Hao Wang

分类: cs.CV

发布日期: 2026-02-13

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

LongStream:提出解耦的自回归视觉几何模型,实现长序列流式三维重建

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 长序列重建 流式三维重建 自回归模型 视觉几何 Transformer 尺度漂移 缓存管理

📋 核心要点

- 现有自回归模型在长序列三维重建中,由于位姿锚定于首帧,导致注意力衰减和尺度漂移等问题。

- LongStream 通过预测关键帧相对位姿,并引入正交尺度学习,将长程外推转化为局部任务,抑制尺度漂移。

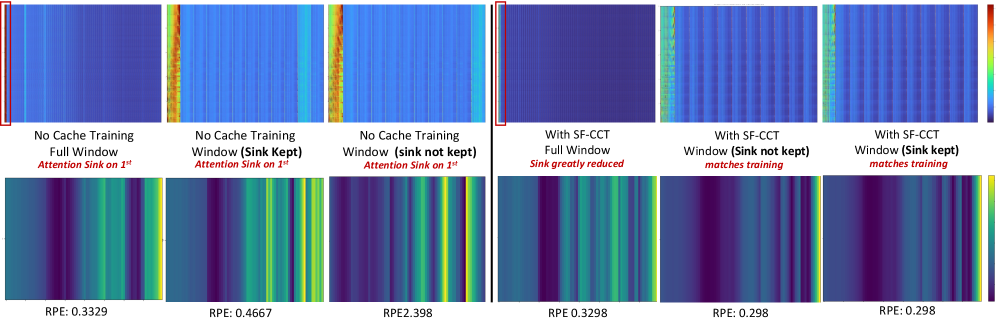

- LongStream 采用缓存一致性训练和周期性缓存刷新,解决了 Transformer 缓存污染问题,提升了长序列重建效果。

📝 摘要(中文)

长序列流式三维重建仍然是一个重要的开放挑战。现有的自回归模型在处理长序列时常常失效,它们通常将位姿锚定到第一帧,导致注意力衰减、尺度漂移和外推误差。我们提出了 LongStream,一种新颖的解耦流式视觉几何模型,用于在数千帧上进行度量尺度场景重建。我们的方法包含三个方面。首先,我们放弃了第一帧锚定,并预测关键帧相关的位姿,将长程外推转化为恒定难度的局部任务。其次,我们引入了正交尺度学习,该方法将几何与尺度估计完全解耦,以抑制漂移。最后,我们解决了Transformer缓存问题,例如注意力沉没依赖和长期KV缓存污染。我们提出了缓存一致性训练,结合周期性缓存刷新,抑制了超长序列上的注意力退化,并减少了训练和推理之间的差距。实验表明,LongStream 实现了最先进的性能,以 18 FPS 的速度在公里级序列上提供稳定、度量尺度的重建。

🔬 方法详解

问题定义:现有自回归模型在处理长序列流式三维重建时,存在严重的性能瓶颈。主要痛点在于:1) 位姿估计依赖于第一帧,导致长序列下的注意力衰减和误差累积;2) 尺度漂移问题严重影响重建精度;3) Transformer 的 KV 缓存存在注意力沉没和长期污染问题,限制了模型的有效序列长度。

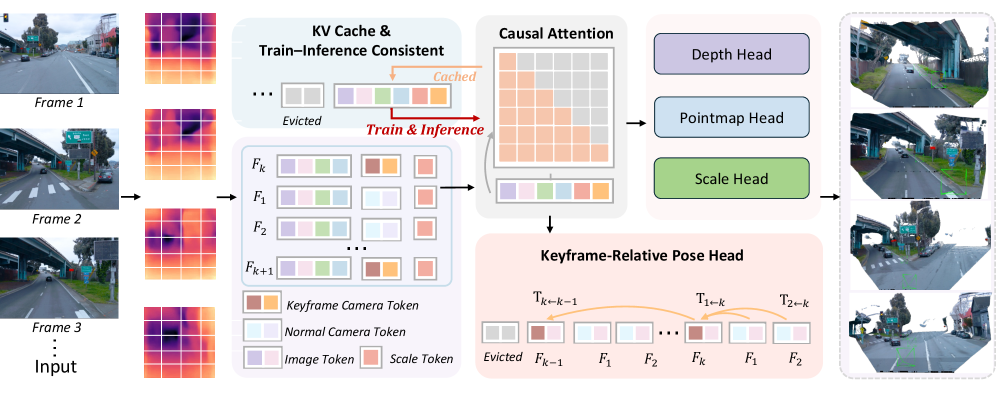

核心思路:LongStream 的核心思路是解耦。具体来说,它解耦了位姿估计与第一帧的依赖关系,转而预测关键帧相对位姿,将长程外推问题转化为局部问题。同时,它还解耦了几何结构与尺度估计,通过正交尺度学习抑制尺度漂移。此外,通过缓存一致性训练和周期性缓存刷新,缓解了 Transformer 缓存污染问题。

技术框架:LongStream 的整体框架包含以下几个关键模块:1) 关键帧选择模块:用于选择具有代表性的关键帧,作为位姿估计的参考;2) 位姿预测模块:预测当前帧相对于关键帧的位姿变换;3) 正交尺度学习模块:用于解耦几何结构与尺度估计,抑制尺度漂移;4) Transformer 编码器:用于提取图像特征并进行序列建模;5) 缓存管理模块:用于维护和更新 Transformer 的 KV 缓存,缓解缓存污染问题。

关键创新:LongStream 的关键创新在于:1) 提出了关键帧相对位姿预测方法,避免了对第一帧的依赖,有效缓解了长序列下的误差累积;2) 引入了正交尺度学习,将几何结构与尺度估计解耦,显著抑制了尺度漂移;3) 提出了缓存一致性训练和周期性缓存刷新策略,有效缓解了 Transformer 缓存污染问题,提升了模型的长期记忆能力。

关键设计:在正交尺度学习中,论文设计了一种特殊的损失函数,鼓励几何结构和尺度估计相互正交,从而实现解耦。在缓存管理方面,周期性缓存刷新的频率是一个重要的超参数,需要根据具体数据集进行调整。此外,缓存一致性训练通过引入额外的约束,保证训练过程中缓存的一致性,从而提升模型的泛化能力。

🖼️ 关键图片

📊 实验亮点

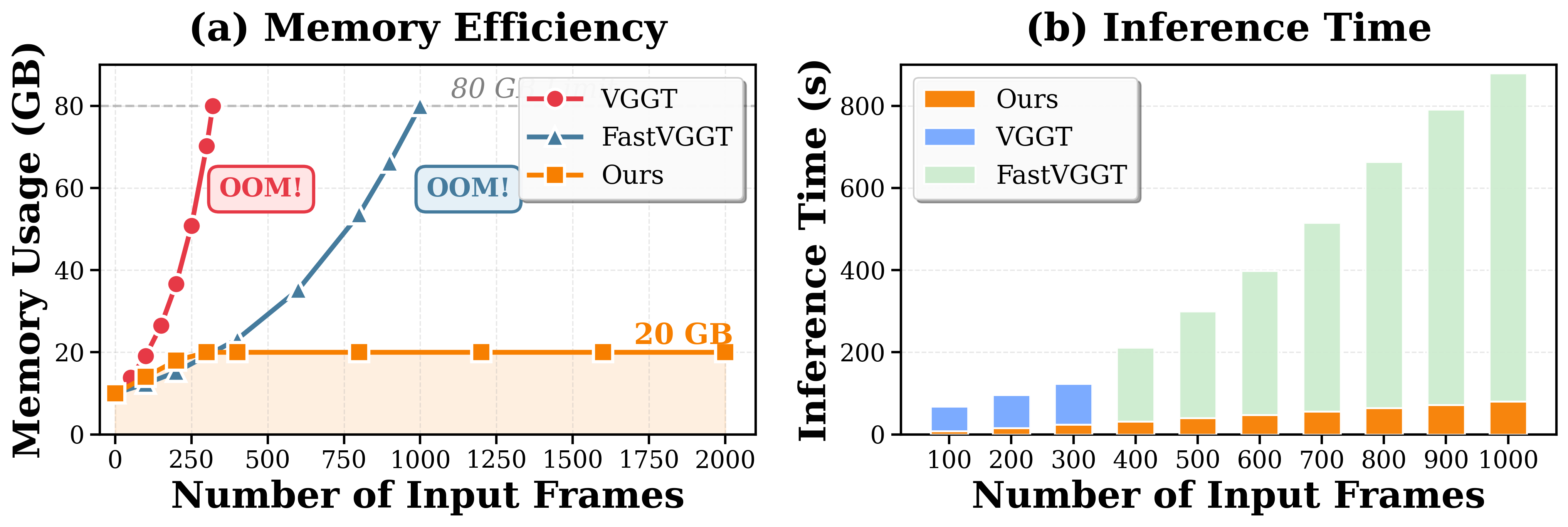

LongStream 在大规模场景重建任务上取得了显著的性能提升。实验结果表明,LongStream 能够以 18 FPS 的速度在公里级序列上进行稳定、度量尺度的重建,优于现有的自回归模型。与现有方法相比,LongStream 在重建精度和效率方面均有显著提升。

🎯 应用场景

LongStream 在机器人导航、自动驾驶、增强现实等领域具有广泛的应用前景。它能够实现大规模场景的实时三维重建,为机器人提供准确的环境感知信息,支持高精度的定位和导航。此外,该技术还可以应用于城市建模、虚拟现实等领域,具有重要的实际价值和商业潜力。

📄 摘要(原文)

Long-sequence streaming 3D reconstruction remains a significant open challenge. Existing autoregressive models often fail when processing long sequences. They typically anchor poses to the first frame, which leads to attention decay, scale drift, and extrapolation errors. We introduce LongStream, a novel gauge-decoupled streaming visual geometry model for metric-scale scene reconstruction across thousands of frames. Our approach is threefold. First, we discard the first-frame anchor and predict keyframe-relative poses. This reformulates long-range extrapolation into a constant-difficulty local task. Second, we introduce orthogonal scale learning. This method fully disentangles geometry from scale estimation to suppress drift. Finally, we solve Transformer cache issues such as attention-sink reliance and long-term KV-cache contamination. We propose cache-consistent training combined with periodic cache refresh. This approach suppresses attention degradation over ultra-long sequences and reduces the gap between training and inference. Experiments show LongStream achieves state-of-the-art performance. It delivers stable, metric-scale reconstruction over kilometer-scale sequences at 18 FPS. Project Page: https://3dagentworld.github.io/longstream/