FedHENet: A Frugal Federated Learning Framework for Heterogeneous Environments

作者: Alejandro Dopico-Castro, Oscar Fontenla-Romero, Bertha Guijarro-Berdiñas, Amparo Alonso-Betanzos, Iván Pérez Digón

分类: cs.CV, cs.LG

发布日期: 2026-02-13

备注: Accepted for publication at the 34th European Symposium on Artificial Neural Networks, Computational Intelligence and Machine Learning (ESANN 2026)

🔗 代码/项目: GITHUB

💡 一句话要点

FedHENet:一种面向异构环境的节能联邦学习框架

🎯 匹配领域: 支柱五:交互与反应 (Interaction & Reaction)

关键词: 联邦学习 同态加密 图像分类 预训练模型 异构环境

📋 核心要点

- 现有联邦学习方法依赖昂贵的迭代优化,且共享梯度存在隐私泄露风险,计算和通信成本高昂。

- FedHENet利用预训练特征提取器和单层输出层,避免本地微调,并通过同态加密实现单轮知识聚合。

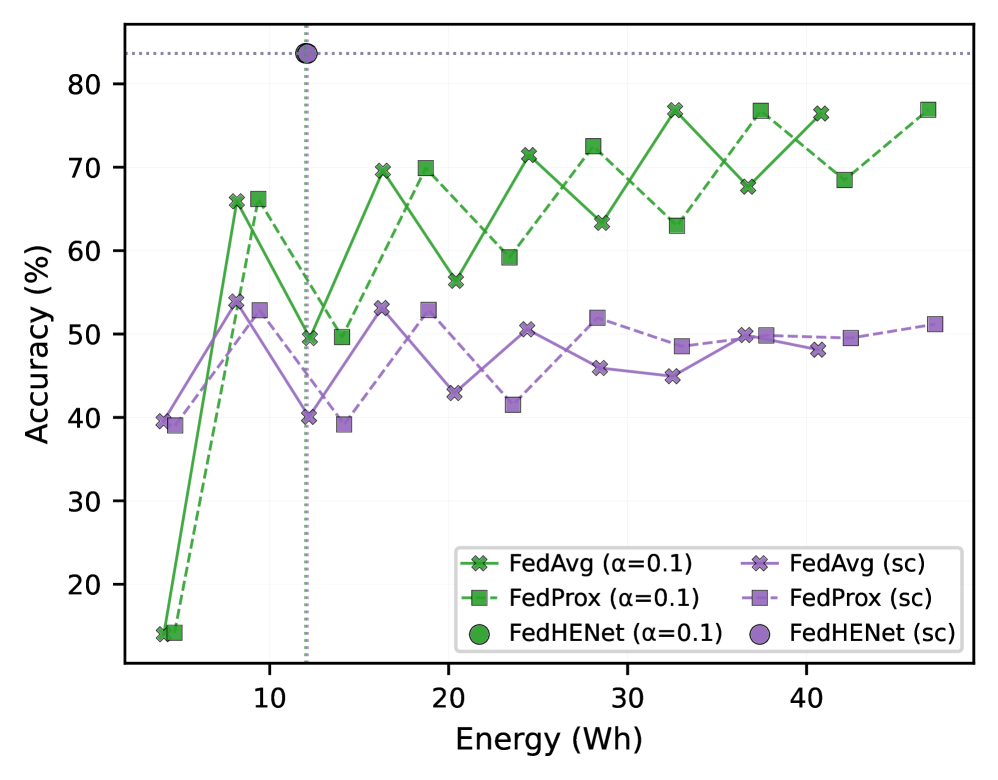

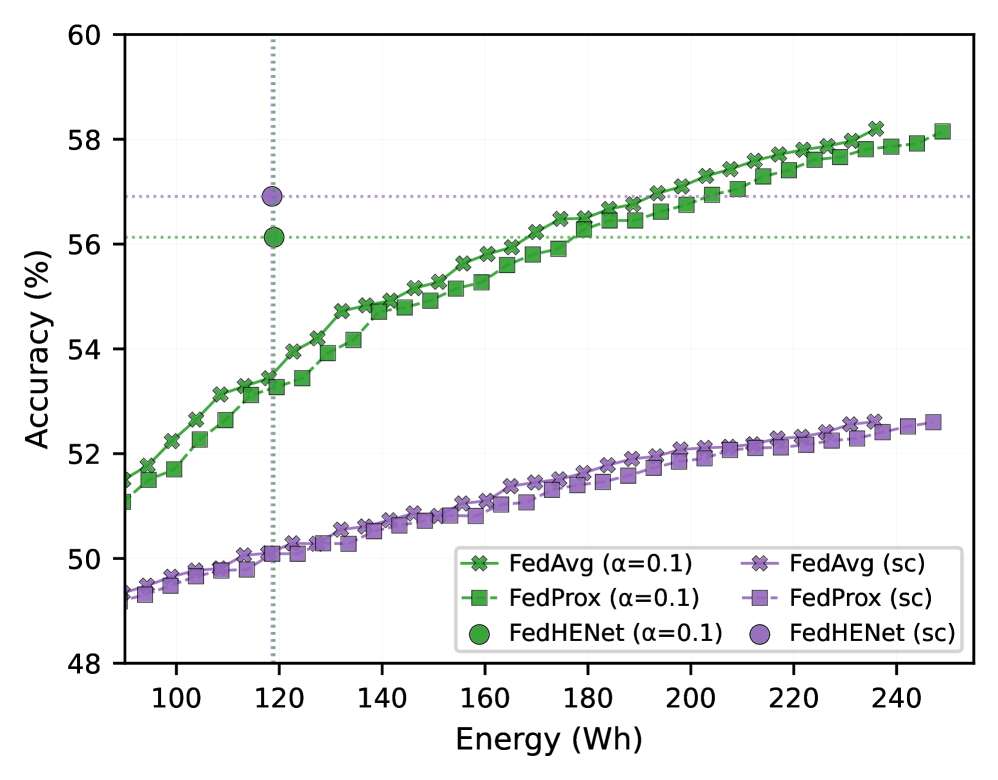

- 实验表明,FedHENet在精度上与迭代方法相当,同时显著提升了稳定性和能源效率,且无需超参数调整。

📝 摘要(中文)

联邦学习(FL)无需集中数据即可实现协作训练,这对于涉及敏感视觉信息的实际场景中的隐私合规至关重要。大多数FL方法依赖于昂贵的迭代深度网络优化,但仍然存在通过共享梯度泄露隐私的风险。本文提出了FedHENet,将FedHEONN框架扩展到图像分类。通过使用固定的、预训练的特征提取器,并且仅学习单个输出层,我们避免了代价高昂的本地微调。该层通过使用同态加密(HE)在单轮通信中分析性地聚合客户端知识来学习。实验表明,与迭代FL基线相比,FedHENet实现了具有竞争力的准确性,同时表现出卓越的稳定性性能和高达70%的能源效率。至关重要的是,我们的方法是无超参数的,从而消除了标准FL中与超参数调整相关的碳足迹。

🔬 方法详解

问题定义:联邦学习在保护用户隐私的前提下进行模型训练,但现有方法通常需要多轮迭代,计算开销大,通信成本高,且存在梯度泄露隐私的风险。尤其是在异构环境中,客户端设备算力有限,进一步加剧了这些问题。此外,超参数调优也会带来额外的计算负担和碳排放。

核心思路:FedHENet的核心在于利用预训练的特征提取器来避免本地微调,从而降低计算成本。同时,通过同态加密技术,在单轮通信中安全地聚合客户端的知识,减少通信轮数。这种设计旨在提高效率,降低隐私风险,并减少超参数调优的需求。

技术框架:FedHENet框架包含以下主要步骤:1) 客户端使用预训练的特征提取器提取本地数据的特征;2) 客户端使用本地特征训练一个单层输出层;3) 客户端使用同态加密对输出层参数进行加密;4) 服务器接收加密后的参数,利用同态加密的性质进行聚合;5) 服务器将聚合后的模型参数发送回客户端。

关键创新:FedHENet的关键创新在于结合了预训练特征提取器和同态加密的单轮聚合。预训练特征提取器避免了昂贵的本地微调,显著降低了计算成本。同态加密保证了在聚合过程中数据的隐私性,同时减少了通信轮数。此外,该方法是无超参数的,简化了训练流程。

关键设计:FedHENet的关键设计包括:1) 使用预训练的卷积神经网络(CNN)作为特征提取器,例如在ImageNet上预训练的模型;2) 使用单层线性模型作为输出层,降低训练复杂度;3) 使用同态加密方案,例如Paillier加密,保证数据隐私;4) 采用单轮通信,减少通信开销。损失函数通常选择交叉熵损失函数,优化目标是最小化分类误差。

🖼️ 关键图片

📊 实验亮点

实验结果表明,FedHENet在图像分类任务上取得了与迭代联邦学习方法相当的精度,同时能源效率提高了70%。此外,FedHENet表现出更强的稳定性,且无需进行超参数调整,显著降低了计算成本和碳排放。

🎯 应用场景

FedHENet适用于需要保护用户隐私的图像分类任务,例如医疗影像分析、自动驾驶中的行人检测、以及金融领域的身份验证等。该方法可以部署在资源受限的边缘设备上,实现高效的联邦学习,并降低碳排放,具有广泛的应用前景。

📄 摘要(原文)

Federated Learning (FL) enables collaborative training without centralizing data, essential for privacy compliance in real-world scenarios involving sensitive visual information. Most FL approaches rely on expensive, iterative deep network optimization, which still risks privacy via shared gradients. In this work, we propose FedHENet, extending the FedHEONN framework to image classification. By using a fixed, pre-trained feature extractor and learning only a single output layer, we avoid costly local fine-tuning. This layer is learned by analytically aggregating client knowledge in a single round of communication using homomorphic encryption (HE). Experiments show that FedHENet achieves competitive accuracy compared to iterative FL baselines while demonstrating superior stability performance and up to 70\% better energy efficiency. Crucially, our method is hyperparameter-free, removing the carbon footprint associated with hyperparameter tuning in standard FL. Code available in https://github.com/AlejandroDopico2/FedHENet/