DynaGuide: A Generalizable Dynamic Guidance Framework for Unsupervised Semantic Segmentation

作者: Boujemaa Guermazi, Riadh Ksantini, Naimul Khan

分类: cs.CV

发布日期: 2026-02-13

备注: Accepted at Image and Vision Computing

🔗 代码/项目: GITHUB

💡 一句话要点

DynaGuide:一种通用的动态引导框架,用于无监督语义分割。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 无监督语义分割 动态引导 伪标签 边界细化 深度学习

📋 核心要点

- 现有无监督分割方法难以兼顾全局语义信息和精细的边界细节,导致分割精度不足。

- DynaGuide采用双重引导策略,结合全局伪标签和局部边界细化,实现更准确的分割。

- 实验表明,DynaGuide在多个数据集上取得了显著的性能提升,mIoU指标提升高达17.5%。

📝 摘要(中文)

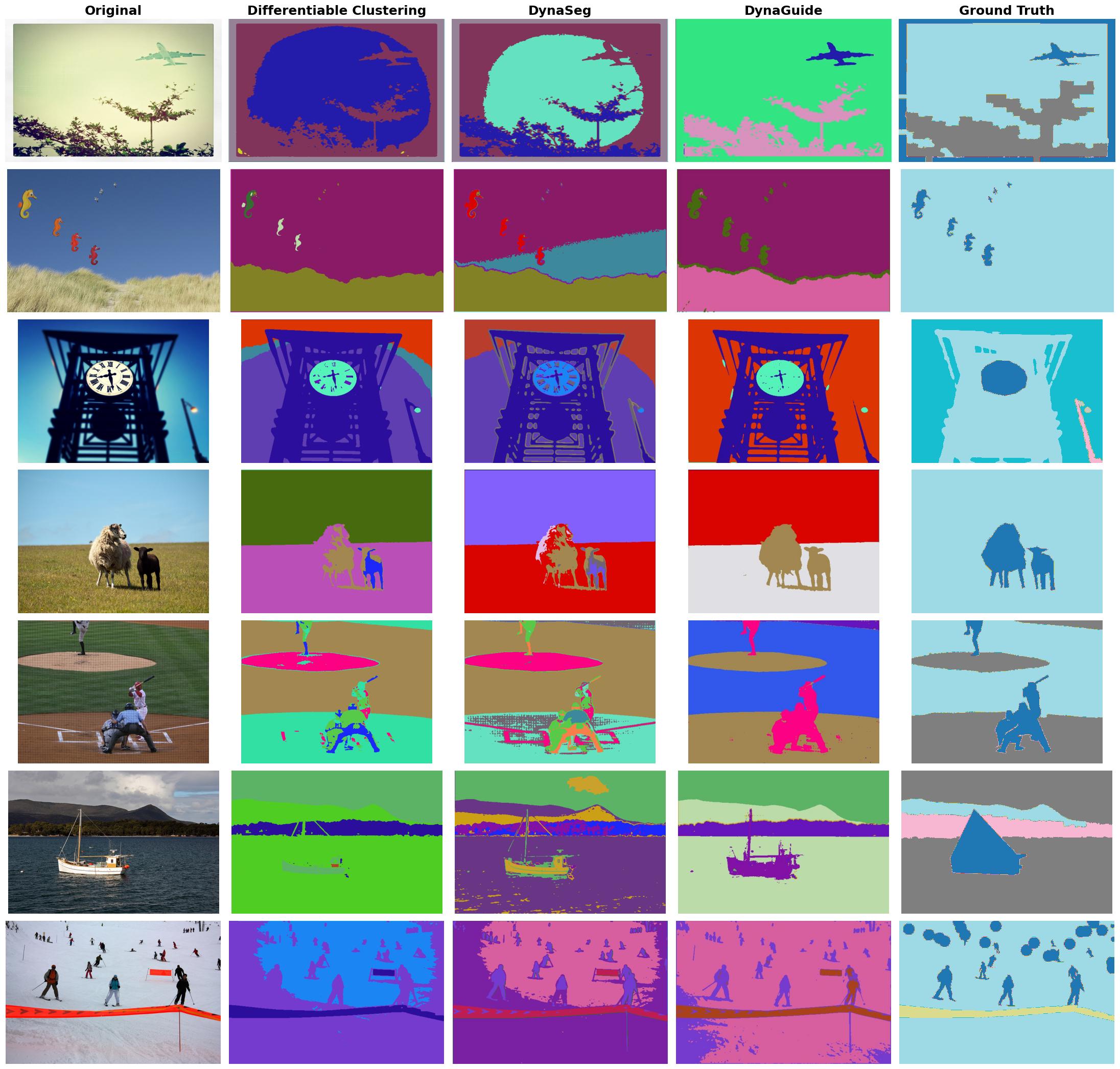

无监督图像分割是计算机视觉中的一项关键任务,它无需人工标注即可实现密集的场景理解,这在标注数据稀缺的领域尤其有价值。然而,现有方法通常难以协调全局语义结构与细粒度的边界精度。本文介绍了一种自适应分割框架DynaGuide,它通过一种新颖的双重引导策略和动态损失优化来解决这些挑战。DynaGuide建立在我们之前的工作DynaSeg的基础上,结合了来自零样本模型(如DiffSeg或SegFormer)的全局伪标签,以及使用从头开始训练的轻量级CNN进行局部边界细化。这种协同作用使模型能够纠正粗糙或嘈杂的全局预测,并产生高精度的分割。DynaGuide的核心是一个多组件损失,它动态平衡特征相似性、Huber平滑的空间连续性(包括对角关系)以及与全局伪标签的语义对齐。与以往的方法不同,DynaGuide完全在目标域中训练,无需ground-truth标签,并支持各种引导源的即插即用集成。在BSD500、PASCAL VOC2012和COCO上的大量实验表明,DynaGuide实现了最先进的性能,在BSD500上提高了17.5%的mIoU,在PASCAL VOC2012上提高了3.1%,在COCO上提高了11.66%。凭借其模块化设计、强大的泛化能力和最小的计算占用,DynaGuide为实际场景中的无监督分割提供了一种可扩展且实用的解决方案。

🔬 方法详解

问题定义:论文旨在解决无监督语义分割问题,即在没有人工标注的情况下,将图像分割成具有语义意义的区域。现有方法的痛点在于难以同时保证全局语义一致性和局部边界精度,容易出现分割结果粗糙或边界模糊的情况。

核心思路:DynaGuide的核心思路是利用双重引导策略,结合全局语义信息和局部边界信息。全局语义信息由零样本模型提供,用于指导整体分割方向;局部边界信息由轻量级CNN学习,用于细化分割边界,从而提高分割精度。

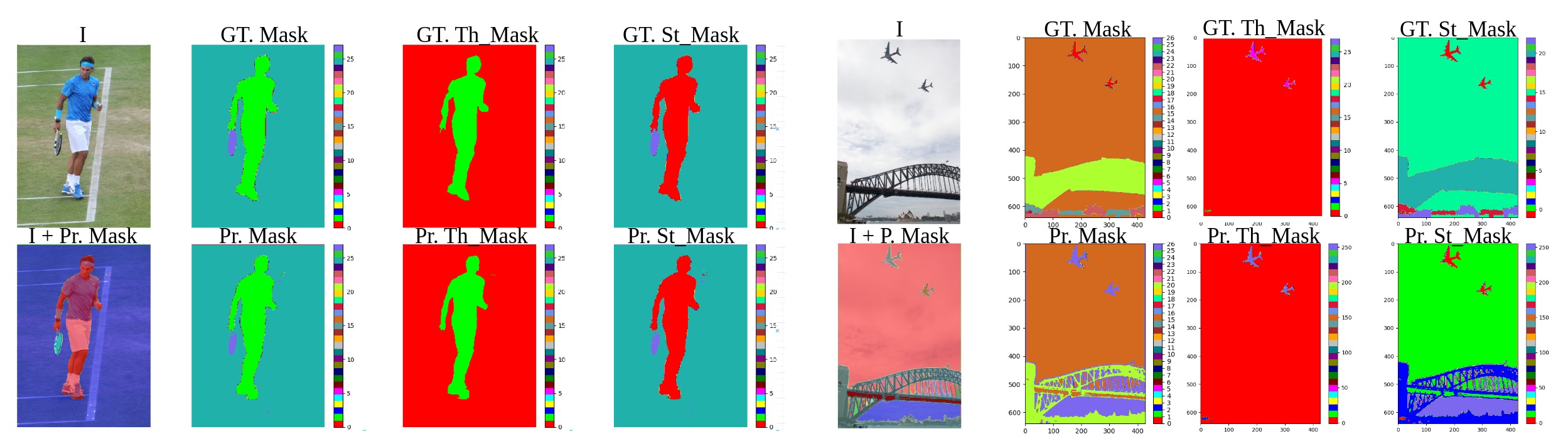

技术框架:DynaGuide的整体框架包含两个主要模块:全局伪标签生成模块和局部边界细化模块。全局伪标签生成模块使用预训练的零样本模型(如DiffSeg或SegFormer)生成图像的粗略分割结果,作为全局语义引导。局部边界细化模块使用一个轻量级CNN,以全局伪标签为指导,学习图像的局部边界信息,并对全局分割结果进行细化。这两个模块通过一个动态损失函数进行联合优化。

关键创新:DynaGuide的关键创新在于其双重引导策略和动态损失优化。双重引导策略能够有效结合全局语义信息和局部边界信息,从而提高分割精度。动态损失优化能够根据不同模块的训练状态,动态调整各个损失项的权重,从而实现更好的训练效果。

关键设计:DynaGuide的关键设计包括:1) 使用Huber平滑的空间连续性损失,以保证分割结果的空间一致性;2) 使用动态损失函数,根据训练状态调整特征相似性、空间连续性和语义对齐损失的权重;3) 使用轻量级CNN进行局部边界细化,以减少计算量。

🖼️ 关键图片

📊 实验亮点

DynaGuide在BSD500、PASCAL VOC2012和COCO等多个数据集上取得了显著的性能提升。在BSD500数据集上,DynaGuide的mIoU指标提升了17.5%,在PASCAL VOC2012数据集上提升了3.1%,在COCO数据集上提升了11.66%。这些结果表明,DynaGuide在无监督语义分割任务中具有强大的竞争力。

🎯 应用场景

DynaGuide在医学图像分析、遥感图像处理、自动驾驶等领域具有广泛的应用前景。在这些领域中,获取大量标注数据成本高昂,而DynaGuide无需人工标注即可实现高精度的图像分割,能够有效降低数据标注成本,提高工作效率。此外,DynaGuide的模块化设计使其易于扩展和定制,可以根据具体应用场景进行调整和优化。

📄 摘要(原文)

Unsupervised image segmentation is a critical task in computer vision. It enables dense scene understanding without human annotations, which is especially valuable in domains where labelled data is scarce. However, existing methods often struggle to reconcile global semantic structure with fine-grained boundary accuracy. This paper introduces DynaGuide, an adaptive segmentation framework that addresses these challenges through a novel dual-guidance strategy and dynamic loss optimization. Building on our previous work, DynaSeg, DynaGuide combines global pseudo-labels from zero-shot models such as DiffSeg or SegFormer with local boundary refinement using a lightweight CNN trained from scratch. This synergy allows the model to correct coarse or noisy global predictions and produce high-precision segmentations. At the heart of DynaGuide is a multi-component loss that dynamically balances feature similarity, Huber-smoothed spatial continuity, including diagonal relationships, and semantic alignment with the global pseudo-labels. Unlike prior approaches, DynaGuide trains entirely without ground-truth labels in the target domain and supports plug-and-play integration of diverse guidance sources. Extensive experiments on BSD500, PASCAL VOC2012, and COCO demonstrate that DynaGuide achieves state-of-the-art performance, improving mIoU by 17.5% on BSD500, 3.1% on PASCAL VOC2012, and 11.66% on COCO. With its modular design, strong generalization, and minimal computational footprint, DynaGuide offers a scalable and practical solution for unsupervised segmentation in real-world settings. Code available at: https://github.com/RyersonMultimediaLab/DynaGuide