Multimodal Classification via Total Correlation Maximization

作者: Feng Yu, Xiangyu Wu, Yang Yang, Jianfeng Lu

分类: cs.CV

发布日期: 2026-02-13

备注: Accepted for publication at ICLR 2026; 19 pages; 2 figures

🔗 代码/项目: GITHUB

💡 一句话要点

提出TCMax,通过最大化总相关解决多模态分类中的模态竞争问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 模态融合 总相关性 信息论 模态竞争 互信息神经估计 变分推断

📋 核心要点

- 多模态学习中,联合学习易过度拟合优势模态,忽略弱势模态,导致性能下降。

- 论文提出通过最大化多模态特征与标签的总相关性来缓解模态竞争,并捕获模态间交互。

- 实验表明,提出的TCMax方法在多模态分类任务上优于现有的联合学习和单模态学习方法。

📝 摘要(中文)

多模态学习整合来自不同传感器的数据,以有效利用来自不同模态的信息。然而,最近的研究表明,联合学习常常过度拟合某些模态,而忽略其他模态,导致性能不如单模态学习。尽管之前的研究试图平衡模态贡献或结合联合学习和单模态学习,从而减轻较弱模态的退化,并取得了有希望的结果,但很少有研究从信息论的角度考察联合学习和单模态学习之间的关系。本文从理论上分析了模态竞争,并提出了一种通过最大化多模态特征和标签之间的总相关性来进行多模态分类的方法。通过最大化这个目标,我们的方法缓解了模态竞争,同时通过特征对齐捕获模态间的交互。在互信息神经估计(MINE)的基础上,我们引入了总相关神经估计(TCNE)来推导总相关的下界。随后,我们提出了TCMax,一种通过变分界优化来最大化总相关性的无超参数损失函数。大量的实验表明,TCMax优于最先进的联合学习和单模态学习方法。我们的代码可在https://github.com/hubaak/TCMax 获得。

🔬 方法详解

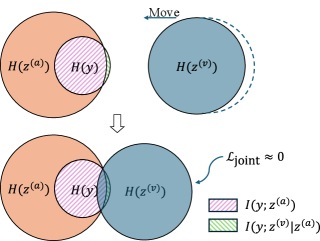

问题定义:多模态学习旨在融合来自不同模态的信息,但现有联合学习方法容易出现模态竞争问题,即某些模态被过度拟合,而其他模态被忽略,导致整体性能下降,甚至不如单模态学习。现有方法试图平衡模态贡献或结合联合学习和单模态学习,但缺乏对模态间关系的信息论分析。

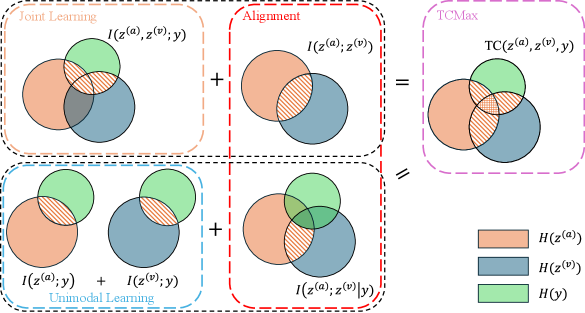

核心思路:论文的核心思路是通过最大化多模态特征与标签之间的总相关性来缓解模态竞争。总相关性能够衡量多个随机变量之间的依赖程度,最大化总相关性意味着鼓励模型学习到各个模态之间互补且与标签相关的特征,从而避免过度依赖单一模态。

技术框架:整体框架包含以下几个主要步骤:1) 使用各自的编码器提取不同模态的特征;2) 将提取的特征进行融合;3) 使用总相关神经估计器(TCNE)估计融合特征与标签之间的总相关性;4) 使用TCMax损失函数优化模型参数,最大化总相关性的下界。

关键创新:论文的关键创新在于:1) 从信息论角度分析了多模态学习中的模态竞争问题;2) 提出了基于总相关性最大化的多模态学习方法,能够有效缓解模态竞争;3) 提出了总相关神经估计器(TCNE)来估计总相关性,并推导了无超参数的TCMax损失函数。

关键设计:TCNE基于互信息神经估计(MINE),通过神经网络学习一个评分函数,用于估计总相关性的下界。TCMax损失函数基于变分界优化,无需手动设置超参数,能够自适应地调整不同模态的贡献。具体而言,TCMax损失函数包含一个总相关性估计项和一个正则化项,用于约束模型参数。

🖼️ 关键图片

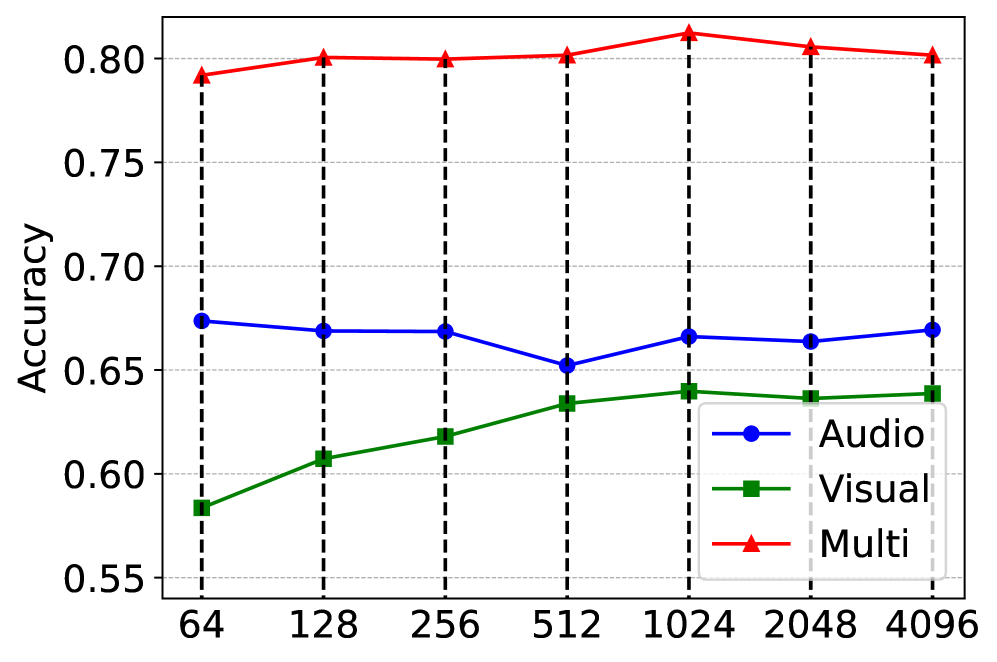

📊 实验亮点

实验结果表明,提出的TCMax方法在多个多模态数据集上取得了显著的性能提升。例如,在CMU-MOSEI数据集上,TCMax的准确率优于现有的最先进方法,并且在某些情况下甚至超过了单模态学习的性能上限。此外,TCMax无需手动调整超参数,具有更好的易用性和泛化能力。

🎯 应用场景

该研究成果可应用于各种多模态数据分析场景,例如:自动驾驶(融合摄像头、激光雷达等传感器数据)、医疗诊断(融合影像、基因组等数据)、情感分析(融合文本、语音、图像等数据)等。通过有效融合多模态信息,可以提升模型的鲁棒性和准确性,从而在实际应用中发挥更大的价值。

📄 摘要(原文)

Multimodal learning integrates data from diverse sensors to effectively harness information from different modalities. However, recent studies reveal that joint learning often overfits certain modalities while neglecting others, leading to performance inferior to that of unimodal learning. Although previous efforts have sought to balance modal contributions or combine joint and unimodal learning, thereby mitigating the degradation of weaker modalities with promising outcomes, few have examined the relationship between joint and unimodal learning from an information-theoretic perspective. In this paper, we theoretically analyze modality competition and propose a method for multimodal classification by maximizing the total correlation between multimodal features and labels. By maximizing this objective, our approach alleviates modality competition while capturing inter-modal interactions via feature alignment. Building on Mutual Information Neural Estimation (MINE), we introduce Total Correlation Neural Estimation (TCNE) to derive a lower bound for total correlation. Subsequently, we present TCMax, a hyperparameter-free loss function that maximizes total correlation through variational bound optimization. Extensive experiments demonstrate that TCMax outperforms state-of-the-art joint and unimodal learning approaches. Our code is available at https://github.com/hubaak/TCMax.