Reliable Thinking with Images

作者: Haobin Li, Yutong Yang, Yijie Lin, Xiang Dai, Mouxing Yang, Xi Peng

分类: cs.CV, cs.LG

发布日期: 2026-02-13 (更新: 2026-02-16)

备注: 26 pages, 19 figures

💡 一句话要点

提出RTWI以解决多模态大语言模型中带噪声的图像推理问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 大语言模型 图像推理 可靠性评估 噪声过滤

📋 核心要点

- 现有的图像推理方法依赖于完美的图像-文本推理链,但在实际场景中,由于多模态理解的复杂性,这一假设容易被打破。

- RTWI的核心思想是以文本为中心,评估视觉线索和文本推理链的可靠性,从而避免噪声推理对最终答案的影响。

- 实验结果表明,RTWI在多个基准测试中有效对抗了噪声推理问题,提升了多模态大语言模型的性能。

📝 摘要(中文)

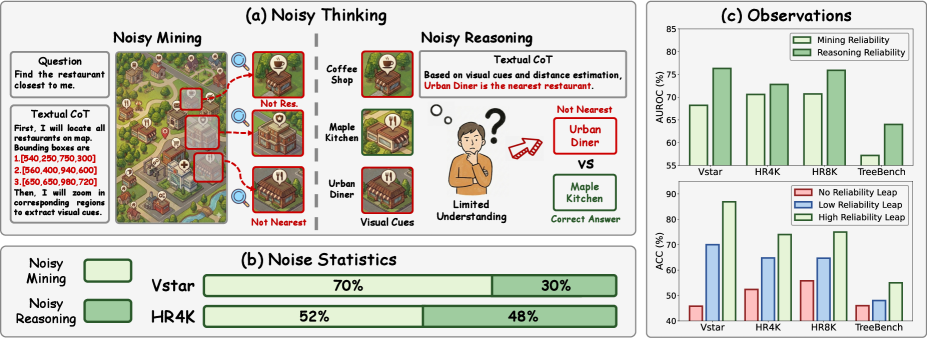

本文研究了多模态大语言模型(MLLM)中一种实际但未被充分探索的问题,即带噪声的图像推理(Noisy Thinking, NT)。NT指的是不完善的视觉线索挖掘和答案推理过程。错误的交错式图像-文本推理链会导致误差累积,显著降低MLLM的性能。为了解决NT问题,本文提出了一种名为可靠的图像推理(Reliable Thinking with Images, RTWI)的新方法。RTWI以统一的文本为中心的方式估计视觉线索和文本推理链的可靠性,并相应地采用鲁棒的过滤和投票模块,以防止NT污染最终答案。在七个基准数据集上的大量实验验证了RTWI在对抗NT方面的有效性。

🔬 方法详解

问题定义:论文旨在解决多模态大语言模型(MLLM)在进行图像推理时,由于视觉线索提取和文本推理过程中的不完善而导致的“带噪声的图像推理”(Noisy Thinking, NT)问题。现有方法假设图像-文本推理链是完美的,但实际中,多模态理解的复杂性使得这一假设难以成立,错误的推理链会导致误差累积,降低模型性能。

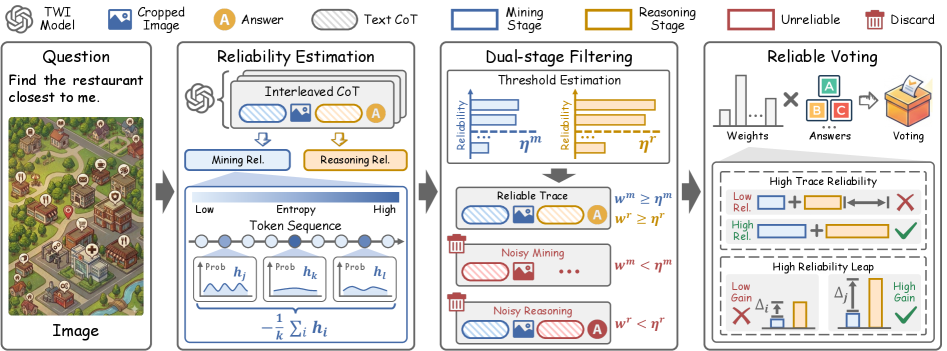

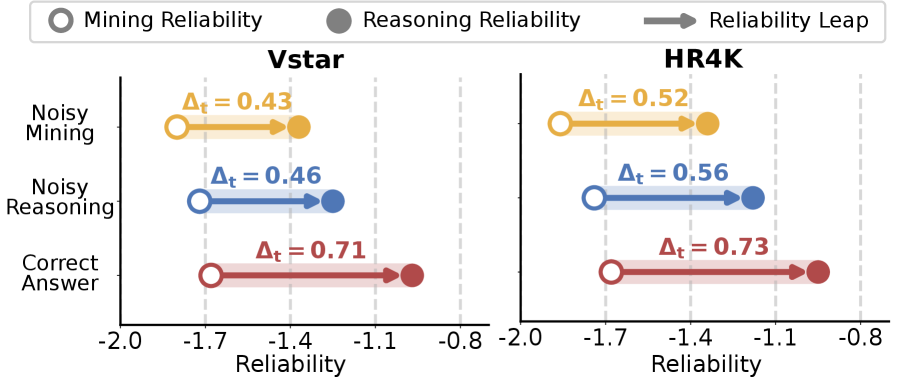

核心思路:RTWI的核心思路是评估视觉线索和文本推理链的可靠性,并利用这些可靠性信息来过滤掉噪声推理步骤,从而提高最终答案的准确性。该方法以文本为中心,统一评估视觉和文本信息的可靠性,避免了对视觉信息过度依赖可能带来的偏差。

技术框架:RTWI的整体框架包含以下几个主要模块:1) 视觉线索提取:利用MLLM提取图像中的视觉信息。2) 文本推理链生成:基于视觉线索和问题,生成交错的图像-文本推理链。3) 可靠性评估:以文本为中心,评估每个推理步骤(包括视觉线索和文本)的可靠性。4) 鲁棒过滤:根据可靠性评估结果,过滤掉低可靠性的推理步骤。5) 投票机制:对剩余的推理步骤进行投票,得到最终答案。

关键创新:RTWI的关键创新在于其统一的、以文本为中心的可靠性评估方法。与现有方法不同,RTWI不假设视觉线索总是可靠的,而是通过评估其与文本推理的连贯性来判断其可靠性。这种方法能够有效识别并过滤掉噪声视觉信息,从而提高推理的准确性。

关键设计:RTWI的具体实现细节包括:1) 使用预训练的MLLM(如LLaVA)作为基础模型。2) 可靠性评估模块可以使用不同的方法,例如基于交叉熵损失的置信度估计。3) 过滤模块可以采用不同的阈值策略,例如固定阈值或自适应阈值。4) 投票机制可以使用简单的多数投票或加权投票,权重可以基于可靠性评估结果。

🖼️ 关键图片

📊 实验亮点

RTWI在七个基准数据集上进行了广泛的实验,结果表明RTWI能够有效对抗噪声推理问题,显著提升MLLM的性能。例如,在某些数据集上,RTWI相对于基线方法取得了超过5%的准确率提升。实验还验证了RTWI的各个模块的有效性,证明了可靠性评估和鲁棒过滤对于提高推理准确性的重要性。

🎯 应用场景

RTWI可以应用于各种需要多模态推理的场景,例如视觉问答、图像描述生成、机器人导航等。通过提高多模态推理的可靠性,RTWI可以帮助提升这些应用在实际场景中的性能,例如在复杂环境中更准确地回答问题,生成更符合场景的图像描述,以及使机器人能够更可靠地完成导航任务。

📄 摘要(原文)

As a multimodal extension of Chain-of-Thought (CoT), Thinking with Images (TWI) has recently emerged as a promising avenue to enhance the reasoning capability of Multi-modal Large Language Models (MLLMs), which generates interleaved CoT by incorporating visual cues into the textual reasoning process. However, the success of existing TWI methods heavily relies on the assumption that interleaved image-text CoTs are faultless, which is easily violated in real-world scenarios due to the complexity of multimodal understanding. In this paper, we reveal and study a highly-practical yet under-explored problem in TWI, termed Noisy Thinking (NT). Specifically, NT refers to the imperfect visual cues mining and answer reasoning process. As the saying goes, ``One mistake leads to another'', erroneous interleaved CoT would cause error accumulation, thus significantly degrading the performance of MLLMs. To solve the NT problem, we propose a novel method dubbed Reliable Thinking with Images (RTWI). In brief, RTWI estimates the reliability of visual cues and textual CoT in a unified text-centric manner and accordingly employs robust filtering and voting modules to prevent NT from contaminating the final answer. Extensive experiments on seven benchmarks verify the effectiveness of RTWI against NT.