Thinking Like a Radiologist: A Dataset for Anatomy-Guided Interleaved Vision Language Reasoning in Chest X-ray Interpretation

作者: Yichen Zhao, Zelin Peng, Piao Yang, Xiaokang Yang, Wei Shen

分类: cs.CV

发布日期: 2026-02-13

🔗 代码/项目: GITHUB

💡 一句话要点

提出MMRad-IVL-22K数据集,用于解剖学引导的胸部X光片判读中的交错视觉语言推理。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 胸部X光片判读 视觉语言推理 医学影像 思维链 多模态学习

📋 核心要点

- 现有医学视觉语言模型依赖纯文本思维链推理,易产生幻觉,且无法充分利用视觉信息。

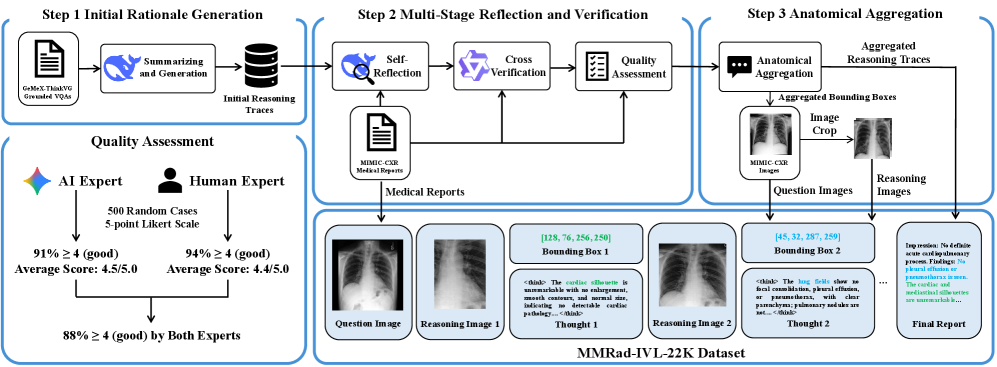

- 提出MMRad-IVL-22K数据集,模拟放射科医生交错推理和视觉检查的工作流程,提供视觉原理。

- 实验表明,多模态思维链引导的报告生成在临床准确性和报告质量方面显著优于纯文本方法。

📝 摘要(中文)

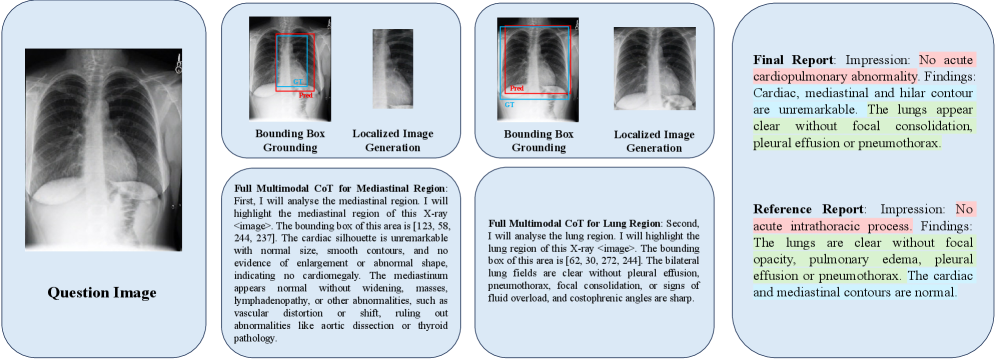

放射诊断是一个感知过程,其中仔细的视觉检查和语言推理反复交错进行。大多数医学大型视觉语言模型(LVLMs)仅执行一次视觉检查,然后依赖于纯文本的思维链(CoT)推理,这完全在语言空间中操作,容易产生幻觉。最近的方法试图通过引入视觉相关的坐标(如边界框)来缓解这个问题。然而,这些仍然是伪视觉解决方案:坐标仍然是文本,无法保留丰富的视觉细节,如纹理和密度。受放射诊断交错性质的启发,我们引入了MMRad-IVL-22K,这是第一个专为胸部X光片判读中原生交错视觉语言推理设计的大规模数据集。MMRad-IVL-22K反映了放射科医生的推理和视觉检查工作流程的重复循环,其中视觉原理补充了文本描述,并为推理过程的每个步骤奠定了基础。MMRad-IVL-22K包含21,994个诊断轨迹,能够系统地扫描35个解剖区域。在先进的闭源LVLM上的实验结果表明,多模态CoT引导的报告生成在临床准确性和报告质量方面明显优于纯文本CoT引导的报告生成(例如,RadGraph指标提高了6%),证实了高保真交错视觉语言证据是可靠医学AI不可替代的组成部分。此外,对七个最先进的开源LVLM的基准测试表明,在MMRad-IVL-22K上微调的模型与通用和医学专用LVLM相比,实现了卓越的推理一致性和报告质量。

🔬 方法详解

问题定义:现有医学视觉语言模型(LVLMs)在胸部X光片判读中,通常只进行一次视觉检查,然后依赖于纯文本的思维链(CoT)推理。这种方法忽略了放射诊断中视觉检查和语言推理反复交错的本质,导致模型容易产生幻觉,并且无法充分利用图像中的纹理、密度等视觉细节。即使引入边界框等视觉坐标,也只是伪视觉解决方案,因为坐标仍然是文本形式,无法真正捕捉图像的丰富信息。

核心思路:论文的核心思路是模拟放射科医生在诊断过程中的交错推理和视觉检查工作流程。通过构建一个大规模数据集,其中包含诊断轨迹,每个轨迹都反映了推理和视觉检查的重复循环。在每个推理步骤中,模型不仅可以利用文本信息,还可以访问相关的视觉原理,从而提高推理的准确性和可靠性。这种方法强调视觉证据在推理过程中的重要性,并试图弥合视觉和语言之间的差距。

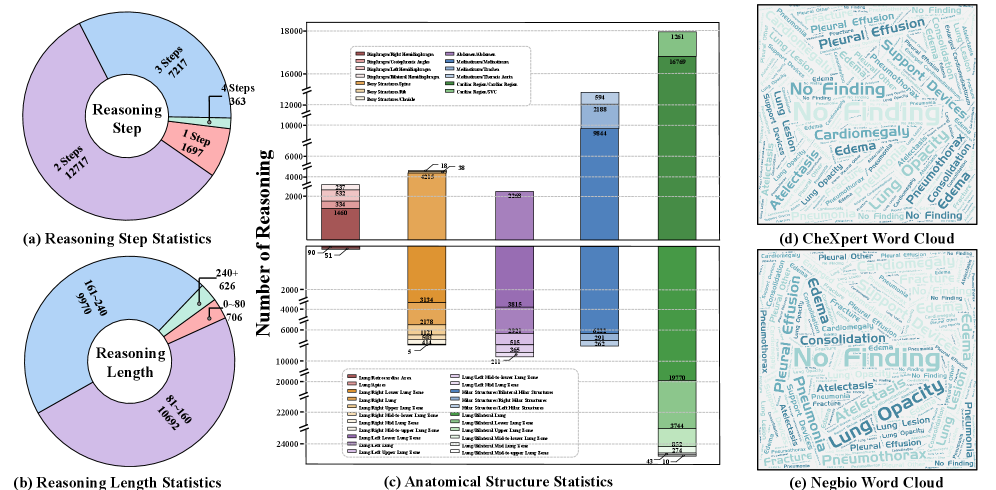

技术框架:论文构建了MMRad-IVL-22K数据集,该数据集包含21,994个诊断轨迹,覆盖35个解剖区域。每个轨迹都包含一系列交错的推理步骤和视觉检查步骤。在推理步骤中,模型需要根据已有的信息生成下一步的推理内容。在视觉检查步骤中,模型需要访问相关的图像区域,并提取视觉特征。整个框架模拟了放射科医生在诊断过程中不断进行视觉检查和推理的过程。

关键创新:论文的关键创新在于提出了一个专为交错视觉语言推理设计的大规模数据集MMRad-IVL-22K。与现有数据集不同,MMRad-IVL-22K强调视觉证据在推理过程中的重要性,并提供了丰富的视觉信息,例如图像区域和视觉特征。这使得模型可以更好地利用视觉信息进行推理,从而提高诊断的准确性和可靠性。此外,该数据集还覆盖了多个解剖区域,能够系统地评估模型在不同区域的推理能力。

关键设计:MMRad-IVL-22K数据集的设计关键在于模拟放射科医生的诊断流程。每个诊断轨迹都包含一系列交错的推理步骤和视觉检查步骤,每个步骤都与特定的解剖区域相关联。数据集还提供了详细的标注信息,包括诊断结论、推理过程和视觉证据。在实验中,论文使用了RadGraph指标来评估报告的质量,并使用了临床准确性指标来评估诊断的准确性。具体参数设置和网络结构信息在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在MMRad-IVL-22K数据集上微调的模型,在临床准确性和报告质量方面显著优于纯文本思维链引导的方法。具体而言,使用多模态思维链引导的报告生成,RadGraph指标提高了6%。此外,在七个最先进的开源LVLM上的基准测试表明,该数据集能够有效提升模型的推理一致性和报告质量。

🎯 应用场景

该研究成果可应用于辅助放射诊断,提高诊断效率和准确性,减少误诊漏诊。通过模拟放射科医生的思维方式,有望开发出更可靠的医学人工智能系统,为患者提供更好的医疗服务。未来可扩展到其他医学影像领域,如CT、MRI等。

📄 摘要(原文)

Radiological diagnosis is a perceptual process in which careful visual inspection and language reasoning are repeatedly interleaved. Most medical large vision language models (LVLMs) perform visual inspection only once and then rely on text-only chain-of-thought (CoT) reasoning, which operates purely in the linguistic space and is prone to hallucination. Recent methods attempt to mitigate this issue by introducing visually related coordinates, such as bounding boxes. However, these remain a pseudo-visual solution: coordinates are still text and fail to preserve rich visual details like texture and density. Motivated by the interleaved nature of radiological diagnosis, we introduce MMRad-IVL-22K, the first large-scale dataset designed for natively interleaved visual language reasoning in chest X-ray interpretation. MMRad-IVL-22K reflects a repeated cycle of reasoning and visual inspection workflow of radiologists, in which visual rationales complement textual descriptions and ground each step of the reasoning process. MMRad-IVL-22K comprises 21,994 diagnostic traces, enabling systematic scanning across 35 anatomical regions. Experimental results on advanced closed-source LVLMs demonstrate that report generation guided by multimodal CoT significantly outperforms that guided by text-only CoT in clinical accuracy and report quality (e.g., 6\% increase in the RadGraph metric), confirming that high-fidelity interleaved vision language evidence is a non-substitutable component of reliable medical AI. Furthermore, benchmarking across seven state-of-the-art open-source LVLMs demonstrates that models fine-tuned on MMRad-IVL-22K achieve superior reasoning consistency and report quality compared with both general-purpose and medical-specific LVLMs. The project page is available at https://github.com/qiuzyc/thinking_like_a_radiologist.