Unbiased Gradient Estimation for Event Binning via Functional Backpropagation

作者: Jinze Chen, Wei Zhai, Han Han, Tiankai Ma, Yang Cao, Bin Li, Zheng-Jun Zha

分类: cs.CV

发布日期: 2026-02-13

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于泛函反向传播的事件分箱无偏梯度估计方法

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 事件相机 事件分箱 梯度估计 泛函反向传播 无偏估计 视觉感知 光流估计 SLAM

📋 核心要点

- 现有基于事件相机的视觉算法在事件分箱过程中面临梯度截断问题,导致学习效率受限。

- 该论文提出一种新颖的泛函反向传播框架,通过合成弱导数实现任意分箱函数的无偏梯度估计。

- 实验结果表明,该方法在自运动估计、光流估计和SLAM等任务中均取得了显著的性能提升。

📝 摘要(中文)

事件视觉将动态场景编码为异步时空脉冲,称为事件。为了利用传统的图像处理流程,事件通常被分箱成帧。然而,分箱函数是不连续的,这会在帧级别截断梯度,并迫使大多数基于事件的算法仅依赖于基于帧的特征。直接从原始事件中学习可以避免这种限制,但由于分箱操作的不连续性,会导致有偏的梯度估计,最终限制了学习效率。为了解决这个挑战,我们提出了一个新的框架,通过在反向传播过程中合成弱导数,同时保持前向输出不变,来实现任意分箱函数的无偏梯度估计。关键思想是利用分部积分:将目标函数提升到泛函,从而在反向传播过程中产生分箱函数导数的积分形式,其中自然地出现了余切函数。通过从采样的余切向量重建这个余切函数,我们计算出弱导数,这些弱导数可以证明与平滑和非平滑目标的远距离有限差分相匹配。实验表明,我们的方法改进了简单的基于优化的自运动估计,降低了3.2%的RMS误差,并加快了1.57倍的收敛速度。在复杂的下游任务中,我们在自监督光流中实现了9.4%的EPE降低,在SLAM中实现了5.1%的RMS误差降低,证明了其对基于事件的视觉感知的广泛益处。源代码可在https://github.com/chjz1024/EventFBP找到。

🔬 方法详解

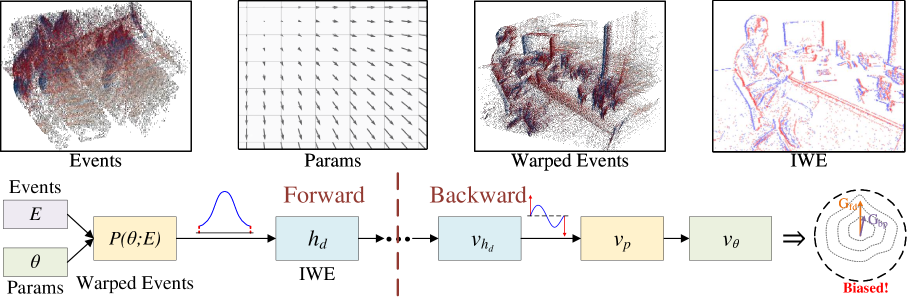

问题定义:事件相机产生的事件流数据需要经过分箱处理才能被传统图像处理算法利用,但分箱函数的不连续性会导致梯度截断,使得反向传播过程中梯度信息丢失,从而限制了基于事件的视觉算法的学习效率。现有方法要么依赖于帧级别特征,要么直接从原始事件学习,但后者会引入有偏的梯度估计。

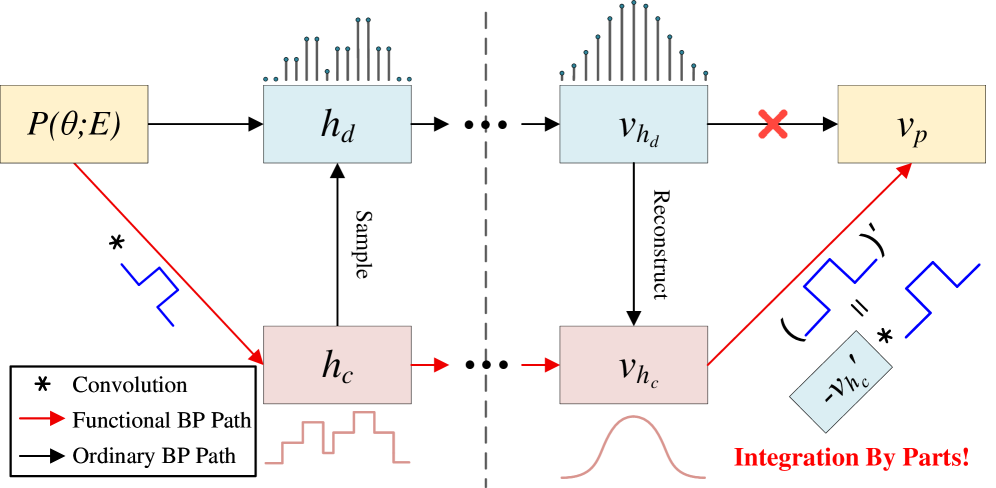

核心思路:该论文的核心思路是通过泛函分析中的分部积分技巧,将分箱操作的导数表示为积分形式,从而避免直接计算不连续函数的导数。具体来说,将目标函数提升到泛函空间,利用分部积分得到包含余切函数的导数表达式,并通过重建余切函数来计算弱导数。

技术框架:该方法的核心在于反向传播过程中的梯度估计。在前向传播过程中,事件数据经过分箱操作得到帧级别特征。在反向传播过程中,不再直接计算分箱函数的导数,而是利用分部积分得到的积分形式,通过采样余切向量并重建余切函数来计算弱导数,从而实现无偏的梯度估计。整体框架保持了前向传播的不变性,只修改了反向传播过程。

关键创新:该论文最重要的技术创新点在于提出了基于泛函反向传播的无偏梯度估计方法,通过分部积分将不连续分箱函数的导数转化为积分形式,并利用余切函数重建技术来计算弱导数。这种方法能够有效解决梯度截断问题,实现对任意分箱函数的无偏梯度估计,从而提高基于事件的视觉算法的学习效率。与现有方法的本质区别在于,该方法避免了直接计算不连续函数的导数,而是通过积分形式进行间接计算。

关键设计:该方法的关键设计在于余切函数的重建。论文中提出了一种基于采样的余切函数重建方法,通过对余切向量进行采样,并利用插值或其他函数逼近方法来重建整个余切函数。具体的采样策略和插值方法会影响重建的精度和计算效率。此外,损失函数的选择也会影响最终的学习效果。论文中使用了常用的均方误差(MSE)损失函数,并针对不同的任务进行了调整。

🖼️ 关键图片

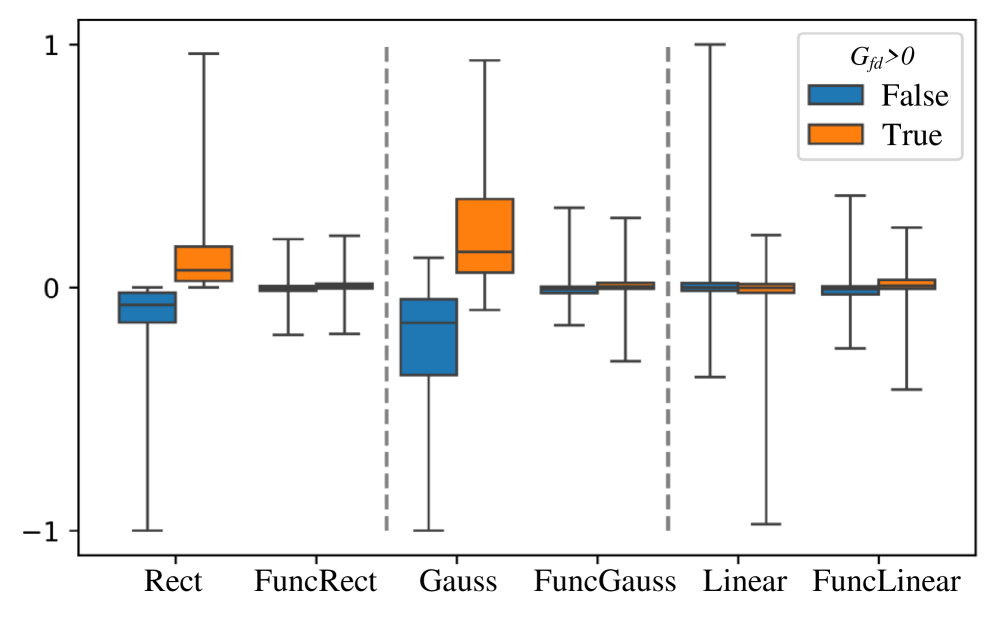

📊 实验亮点

实验结果表明,该方法在自运动估计任务中降低了3.2%的RMS误差,并加快了1.57倍的收敛速度。在自监督光流估计任务中,EPE降低了9.4%。在SLAM任务中,RMS误差降低了5.1%。这些结果表明,该方法能够显著提高基于事件的视觉算法的性能。

🎯 应用场景

该研究成果可广泛应用于基于事件相机的视觉感知任务,例如自动驾驶、机器人导航、无人机控制等。通过提高事件数据的利用效率,可以提升这些应用在动态环境下的鲁棒性和实时性。此外,该方法还可以应用于其他涉及不连续函数梯度估计的机器学习问题。

📄 摘要(原文)

Event-based vision encodes dynamic scenes as asynchronous spatio-temporal spikes called events. To leverage conventional image processing pipelines, events are typically binned into frames. However, binning functions are discontinuous, which truncates gradients at the frame level and forces most event-based algorithms to rely solely on frame-based features. Attempts to directly learn from raw events avoid this restriction but instead suffer from biased gradient estimation due to the discontinuities of the binning operation, ultimately limiting their learning efficiency. To address this challenge, we propose a novel framework for unbiased gradient estimation of arbitrary binning functions by synthesizing weak derivatives during backpropagation while keeping the forward output unchanged. The key idea is to exploit integration by parts: lifting the target functions to functionals yields an integral form of the derivative of the binning function during backpropagation, where the cotangent function naturally arises. By reconstructing this cotangent function from the sampled cotangent vector, we compute weak derivatives that provably match long-range finite differences of both smooth and non-smooth targets. Experimentally, our method improves simple optimization-based egomotion estimation with 3.2\% lower RMS error and 1.57$\times$ faster convergence. On complex downstream tasks, we achieve 9.4\% lower EPE in self-supervised optical flow, and 5.1\% lower RMS error in SLAM, demonstrating broad benefits for event-based visual perception. Source code can be found at https://github.com/chjz1024/EventFBP.