TexSpot: 3D Texture Enhancement with Spatially-uniform Point Latent Representation

作者: Ziteng Lu, Yushuang Wu, Chongjie Ye, Yuda Qiu, Jing Shao, Xiaoyang Guo, Jiaqing Zhou, Tianlei Hu, Kun Zhou, Xiaoguang Han

分类: cs.CV, cs.GR

发布日期: 2026-02-12

备注: Project page: https://anonymous.4open.science/w/TexSpot-page-2D91

💡 一句话要点

TexSpot:利用空间均匀点潜在表示增强3D纹理

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting)

关键词: 3D纹理生成 扩散模型 点云表示 纹理增强 几何一致性

📋 核心要点

- 现有3D纹理生成方法在视角一致性和高分辨率纹理生成方面存在挑战,UV贴图易扭曲,点云方法受几何密度限制。

- TexSpot提出Texlet表示,结合点云的几何表达和UV贴图的紧凑性,通过编码器-解码器结构学习纹理空间。

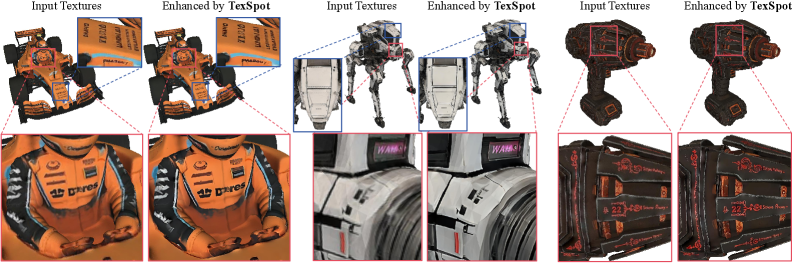

- TexSpot训练一个以Texlet为条件的扩散Transformer,用于细化和增强纹理,实验表明其在视觉保真度、几何一致性和鲁棒性方面有显著提升。

📝 摘要(中文)

高质量3D纹理生成仍然是一个根本性的挑战,因为当前主流的多视角扩散管道中存在固有的视角不一致性。现有的表示方法要么依赖于UV贴图,这在展开过程中会遭受扭曲;要么依赖于基于点的方法,这会将纹理保真度与几何密度紧密耦合,从而限制了高分辨率纹理的生成。为了解决这些限制,我们引入了TexSpot,一个基于扩散的纹理增强框架。其核心是Texlet,一种新颖的3D纹理表示,它融合了基于点的3D纹理的几何表达能力和基于UV表示的紧凑性。每个Texlet潜在向量通过2D编码器编码局部纹理块,并进一步使用3D编码器进行聚合,以结合全局形状上下文。级联的3D到2D解码器重建高质量的纹理块,从而实现Texlet空间学习。利用这种表示,我们训练了一个以Texlet为条件的扩散Transformer,以细化和增强多视角扩散方法产生的纹理。大量的实验表明,TexSpot在视觉保真度、几何一致性和鲁棒性方面显著优于现有的最先进的3D纹理生成和增强方法。

🔬 方法详解

问题定义:论文旨在解决高质量3D纹理生成的问题,现有方法如基于UV贴图的方法容易在展开时产生扭曲,而基于点的方法则将纹理质量与几何密度耦合,限制了高分辨率纹理的生成。因此,需要一种既能保持几何表达能力,又能生成高分辨率纹理的表示方法。

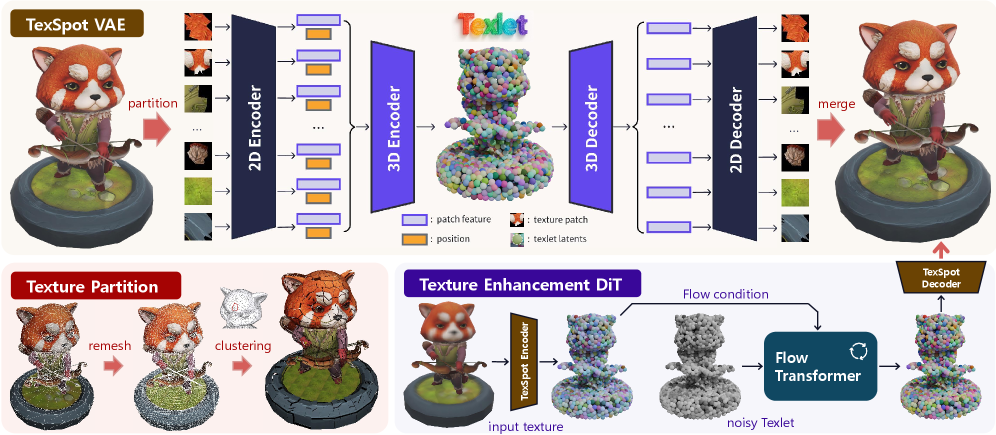

核心思路:论文的核心思路是提出一种新的3D纹理表示方法Texlet,它将3D空间划分为小的局部区域,每个区域对应一个Texlet。Texlet通过编码器-解码器结构学习局部纹理特征,并利用3D编码器聚合全局形状信息。这种设计既保留了点云的几何表达能力,又实现了纹理的紧凑表示,从而可以生成高分辨率的纹理。

技术框架:TexSpot框架包含以下几个主要模块:1) Texlet表示:将3D模型划分为小的局部区域,每个区域对应一个Texlet潜在向量。2) 2D编码器:用于编码局部纹理块的特征。3) 3D编码器:用于聚合全局形状上下文信息。4) 3D-to-2D解码器:用于重建高质量的纹理块。5) 扩散Transformer:以Texlet为条件,用于细化和增强纹理。

关键创新:TexSpot的关键创新在于Texlet表示,它是一种空间均匀的点潜在表示,能够有效地解耦几何信息和纹理信息。与传统的UV贴图和点云方法相比,Texlet表示既能保持几何表达能力,又能实现纹理的紧凑表示,从而可以生成更高质量的纹理。

关键设计:Texlet的大小是一个关键参数,它决定了局部纹理块的大小。论文中使用了级联的3D-to-2D解码器,以逐步重建高质量的纹理块。扩散Transformer使用了U-Net结构,并以Texlet潜在向量作为条件输入。损失函数包括重建损失和对抗损失,用于提高纹理的质量和真实感。

🖼️ 关键图片

📊 实验亮点

实验结果表明,TexSpot在视觉保真度、几何一致性和鲁棒性方面显著优于现有的最先进方法。具体来说,TexSpot在多个数据集上实现了更高的PSNR、SSIM和LPIPS指标,表明其生成的纹理更清晰、更真实,并且与几何形状更加一致。此外,TexSpot在处理噪声和遮挡等问题时表现出更强的鲁棒性。

🎯 应用场景

TexSpot技术可应用于游戏开发、电影制作、虚拟现实/增强现实等领域,用于生成高质量、逼真的3D模型纹理。该研究的实际价值在于提升3D内容的视觉质量和真实感,降低纹理生成的人工成本,并为未来的3D内容创作提供更高效的工具和方法。未来,该技术有望进一步扩展到动态纹理生成、材质编辑等领域。

📄 摘要(原文)

High-quality 3D texture generation remains a fundamental challenge due to the view-inconsistency inherent in current mainstream multi-view diffusion pipelines. Existing representations either rely on UV maps, which suffer from distortion during unwrapping, or point-based methods, which tightly couple texture fidelity to geometric density that limits high-resolution texture generation. To address these limitations, we introduce TexSpot, a diffusion-based texture enhancement framework. At its core is Texlet, a novel 3D texture representation that merges the geometric expressiveness of point-based 3D textures with the compactness of UV-based representation. Each Texlet latent vector encodes a local texture patch via a 2D encoder and is further aggregated using a 3D encoder to incorporate global shape context. A cascaded 3D-to-2D decoder reconstructs high-quality texture patches, enabling the Texlet space learning. Leveraging this representation, we train a diffusion transformer conditioned on Texlets to refine and enhance textures produced by multi-view diffusion methods. Extensive experiments demonstrate that TexSpot significantly improves visual fidelity, geometric consistency, and robustness over existing state-of-the-art 3D texture generation and enhancement approaches. Project page: https://anonymous.4open.science/w/TexSpot-page-2D91.