FAIL: Flow Matching Adversarial Imitation Learning for Image Generation

作者: Yeyao Ma, Chen Li, Xiaosong Zhang, Han Hu, Weidi Xie

分类: cs.CV

发布日期: 2026-02-12

🔗 代码/项目: GITHUB

💡 一句话要点

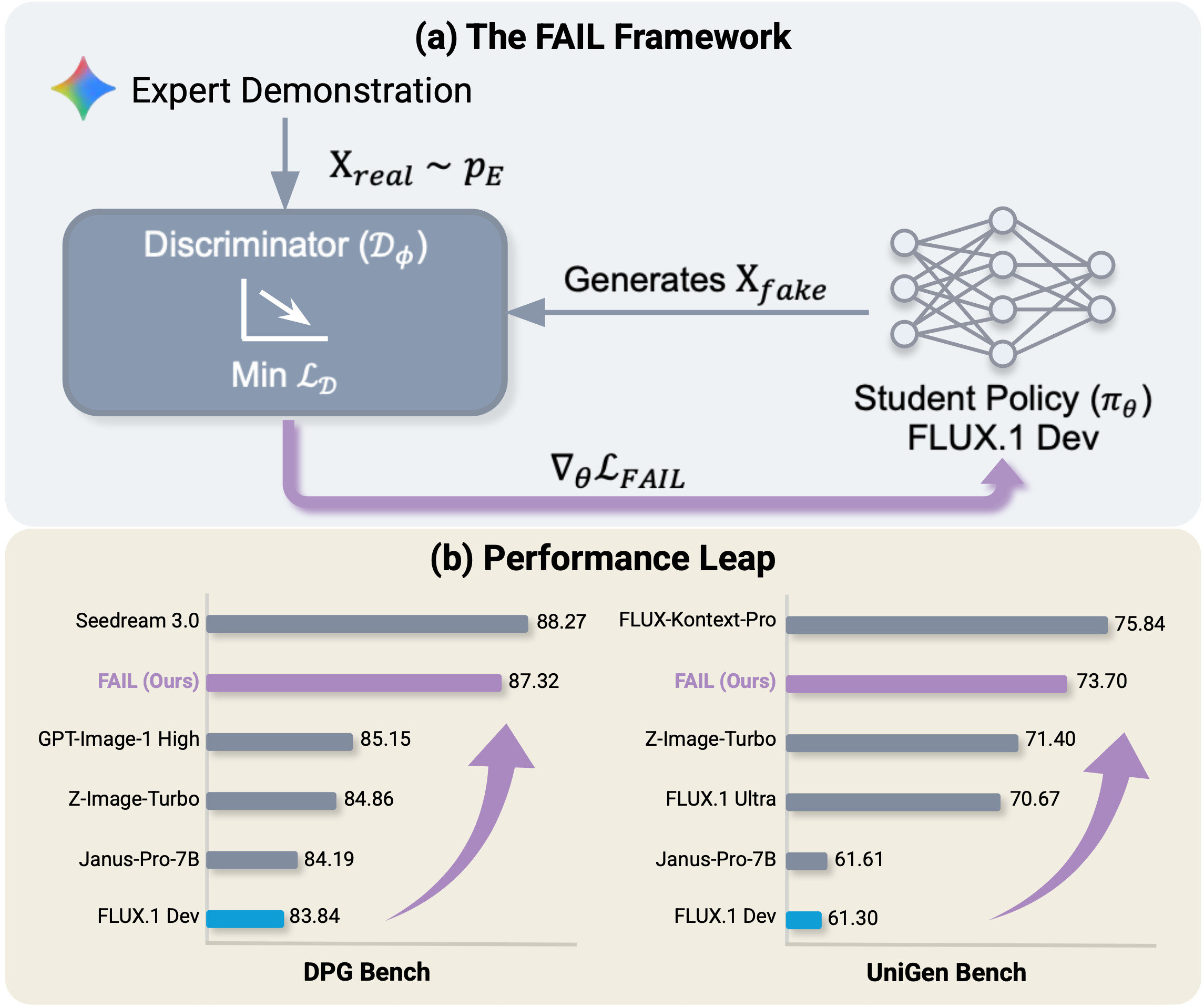

提出Flow Matching对抗模仿学习(FAIL)用于图像生成,无需显式奖励或成对比较。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: Flow Matching 对抗模仿学习 图像生成 视频生成 策略学习 奖励黑客 生成模型

📋 核心要点

- 现有Flow Matching模型微调方法易产生策略漂移,偏好优化方法成本高昂,需要大量数据或奖励建模。

- FAIL通过对抗训练,隐式学习专家策略,无需显式奖励或成对比较,降低了训练成本和数据需求。

- 实验表明,FAIL在图像和视频生成任务上表现出色,并能有效缓解奖励黑客问题,提升模型鲁棒性。

📝 摘要(中文)

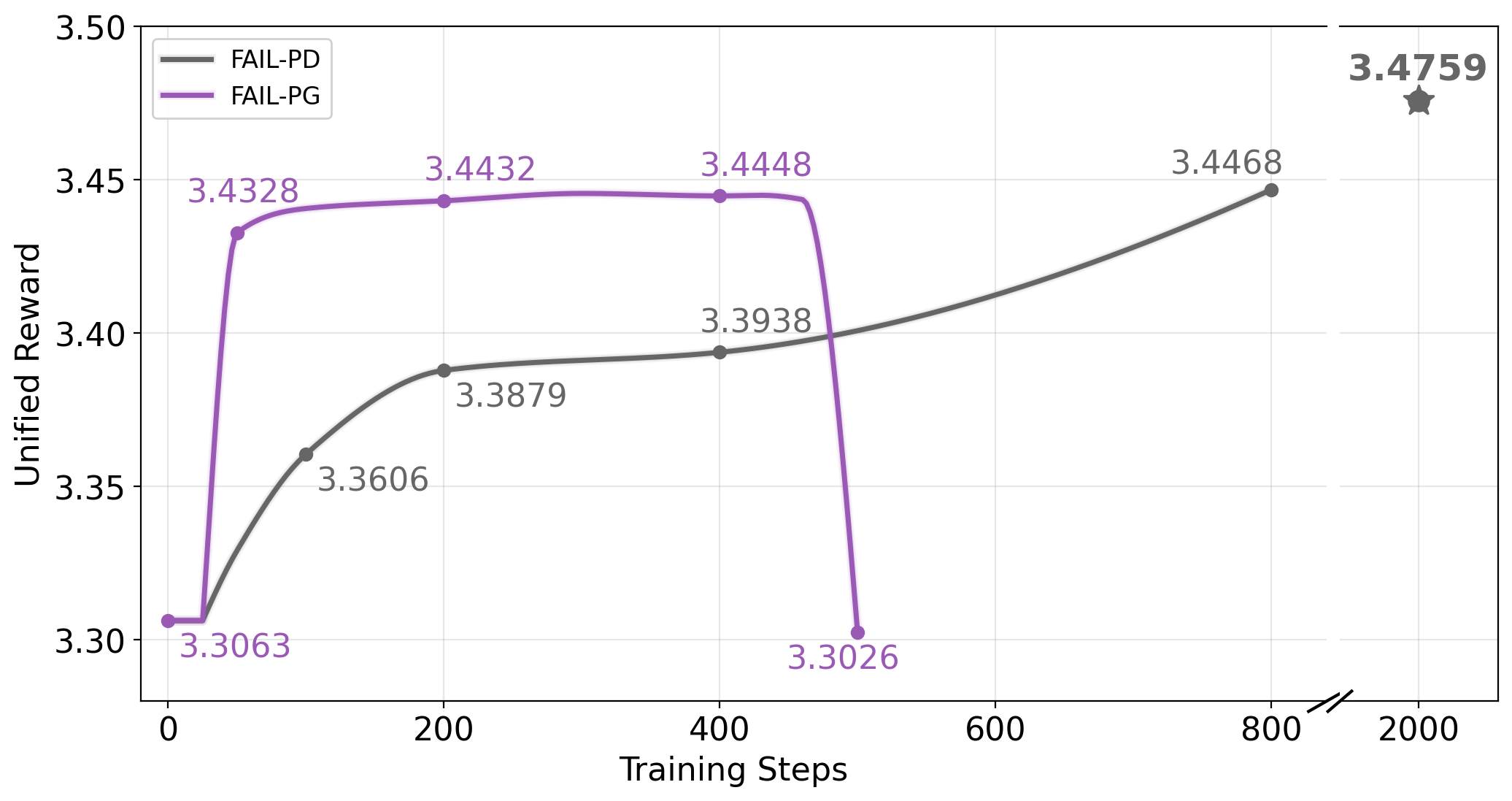

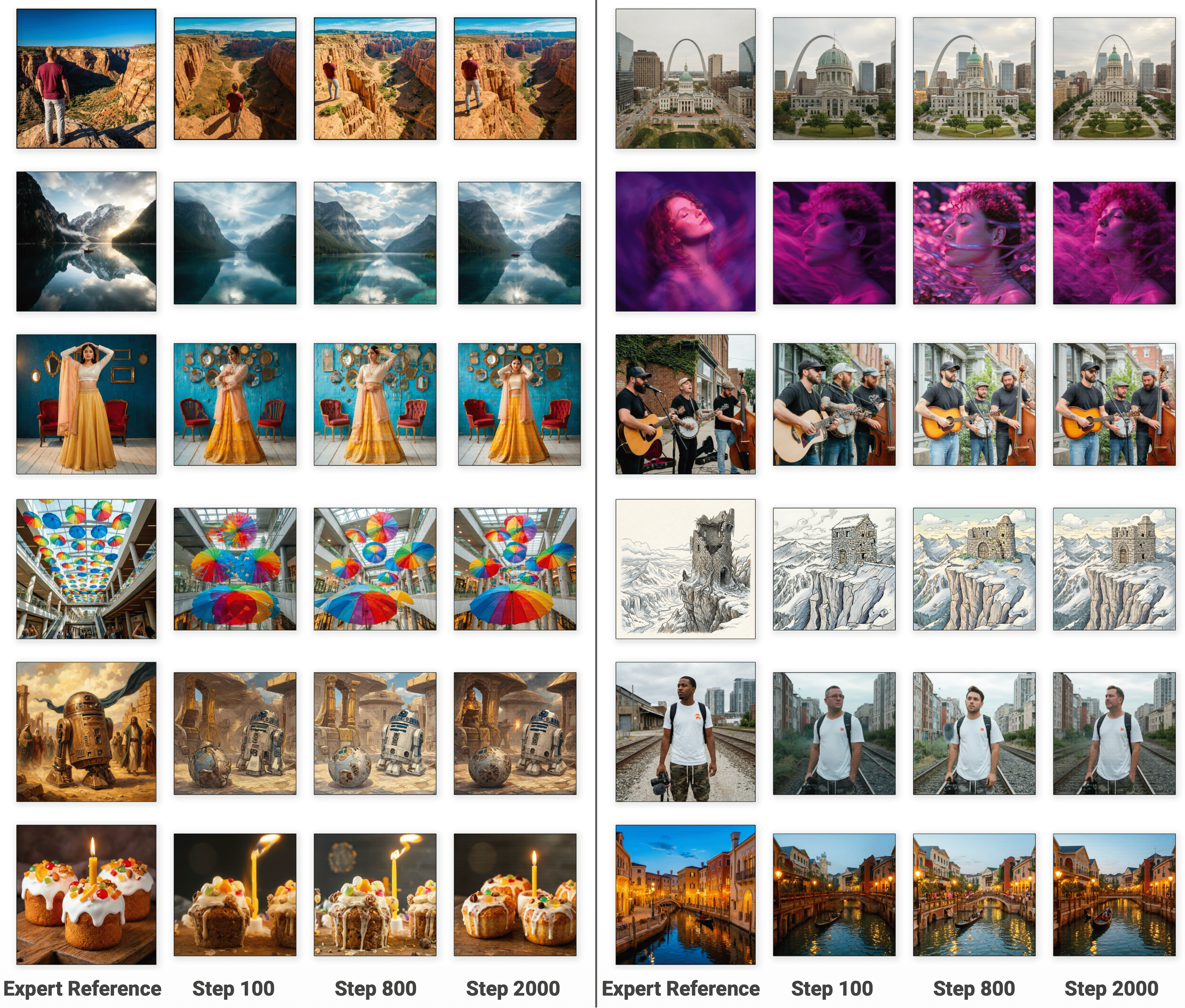

本文提出Flow Matching对抗模仿学习(FAIL),旨在通过对抗训练最小化策略与专家之间的差异,而无需显式奖励或成对比较。该方法应用于Flow Matching模型的后训练,使其输出分布与高质量目标对齐,这在数学上等价于模仿学习。虽然监督微调能有效模仿专家演示,但无法纠正未见状态下的策略漂移。偏好优化方法可以解决这个问题,但需要昂贵的偏好对或奖励建模。我们推导了两种算法:FAIL-PD利用可微ODE求解器获得低方差路径梯度,而FAIL-PG为离散或计算受限环境提供了一种黑盒替代方案。仅使用Nano Banana pro的13,000个演示对FLUX进行微调,FAIL在提示跟随和美学基准上实现了具有竞争力的性能。此外,该框架有效地推广到离散图像和视频生成,并作为一种强大的正则化器,以减轻基于奖励的优化中的奖励黑客行为。代码和数据可在https://github.com/HansPolo113/FAIL 获取。

🔬 方法详解

问题定义:论文旨在解决Flow Matching模型在图像生成任务中,通过模仿学习进行微调时遇到的问题。现有方法,如监督微调,容易出现策略漂移,即模型在训练数据未覆盖的状态下表现不佳。而偏好优化方法虽然能解决策略漂移问题,但需要大量的偏好数据对或复杂的奖励模型,训练成本高昂。

核心思路:论文的核心思路是通过对抗模仿学习,隐式地学习专家策略,从而避免显式的奖励函数或成对比较。具体来说,将Flow Matching模型的训练过程视为一个策略学习过程,并使用对抗训练的方式,让模型生成的样本尽可能地接近专家样本,从而最小化策略与专家之间的差异。

技术框架:FAIL框架主要包含两个部分:生成器(Flow Matching模型)和判别器。生成器的目标是生成尽可能逼真的图像,判别器的目标是区分生成的图像和真实的专家图像。通过对抗训练,生成器不断优化其生成策略,最终达到模仿专家策略的目的。论文提出了两种具体的算法实现:FAIL-PD和FAIL-PG。FAIL-PD利用可微ODE求解器,计算低方差的路径梯度,适用于连续控制问题。FAIL-PG则是一种黑盒优化方法,适用于离散控制或计算资源受限的场景。

关键创新:FAIL的关键创新在于将对抗模仿学习应用于Flow Matching模型的微调,从而避免了对显式奖励函数或成对比较的依赖。这种方法不仅降低了训练成本,还提高了模型的泛化能力和鲁棒性。此外,FAIL框架可以有效地推广到离散图像和视频生成任务,并能作为一种正则化器,缓解奖励黑客问题。

关键设计:FAIL-PD的关键设计在于使用可微ODE求解器来计算路径梯度。这使得可以使用梯度下降等优化算法来训练生成器,从而实现高效的策略学习。FAIL-PG的关键设计在于使用黑盒优化算法来训练生成器。这使得FAIL-PG可以应用于离散控制或计算资源受限的场景。损失函数方面,FAIL使用对抗损失来衡量生成器生成的样本与专家样本之间的差异。具体而言,判别器输出一个概率值,表示输入样本是真实样本的概率。生成器的目标是最小化判别器输出的概率值,而判别器的目标是最大化真实样本的概率值,同时最小化生成样本的概率值。

🖼️ 关键图片

📊 实验亮点

实验结果表明,仅使用13,000个Nano Banana pro的演示数据对FLUX模型进行微调,FAIL在提示跟随和美学基准上取得了具有竞争力的性能。此外,FAIL框架成功应用于离散图像和视频生成任务,并有效缓解了奖励黑客问题。这些结果验证了FAIL框架的有效性和泛化能力。

🎯 应用场景

FAIL框架可广泛应用于图像和视频生成领域,例如高质量图像合成、风格迁移、视频编辑等。该方法降低了模仿学习的成本,使得在数据有限或奖励难以定义的场景下,也能训练出高性能的生成模型。此外,FAIL作为一种正则化手段,可以提升强化学习模型的鲁棒性,缓解奖励黑客问题,具有重要的实际应用价值。

📄 摘要(原文)

Post-training of flow matching models-aligning the output distribution with a high-quality target-is mathematically equivalent to imitation learning. While Supervised Fine-Tuning mimics expert demonstrations effectively, it cannot correct policy drift in unseen states. Preference optimization methods address this but require costly preference pairs or reward modeling. We propose Flow Matching Adversarial Imitation Learning (FAIL), which minimizes policy-expert divergence through adversarial training without explicit rewards or pairwise comparisons. We derive two algorithms: FAIL-PD exploits differentiable ODE solvers for low-variance pathwise gradients, while FAIL-PG provides a black-box alternative for discrete or computationally constrained settings. Fine-tuning FLUX with only 13,000 demonstrations from Nano Banana pro, FAIL achieves competitive performance on prompt following and aesthetic benchmarks. Furthermore, the framework generalizes effectively to discrete image and video generation, and functions as a robust regularizer to mitigate reward hacking in reward-based optimization. Code and data are available at https://github.com/HansPolo113/FAIL.