DynaHOI: Benchmarking Hand-Object Interaction for Dynamic Target

作者: BoCheng Hu, Zhonghan Zhao, Kaiyue Zhou, Hongwei Wang, Gaoang Wang

分类: cs.CV, cs.AI

发布日期: 2026-02-12

💡 一句话要点

DynaHOI:针对动态目标的交互,提出手-物交互新基准与在线评估平台。

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion) 支柱五:交互与反应 (Interaction & Reaction) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 手-物交互 动态环境 运动生成 基准测试 在线评估

📋 核心要点

- 现有手部运动生成基准主要关注静态物体,缺乏对动态目标交互场景的有效测试和评估。

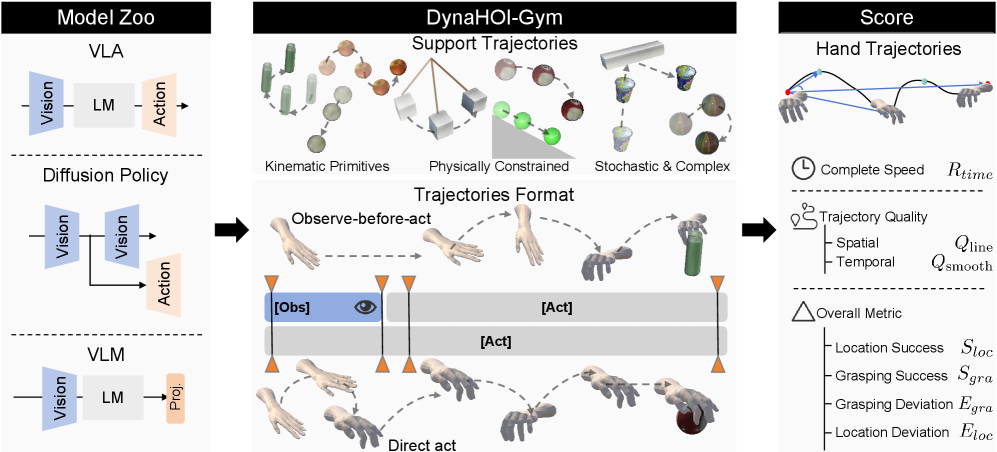

- DynaHOI-Gym提供了一个统一的在线闭环平台,用于动态手-物交互的评估,包含参数化运动生成器和rollout指标。

- DynaHOI-10M是一个大规模动态手-物交互基准,包含1000万帧数据,并提供了一个观察-行动基线模型。

📝 摘要(中文)

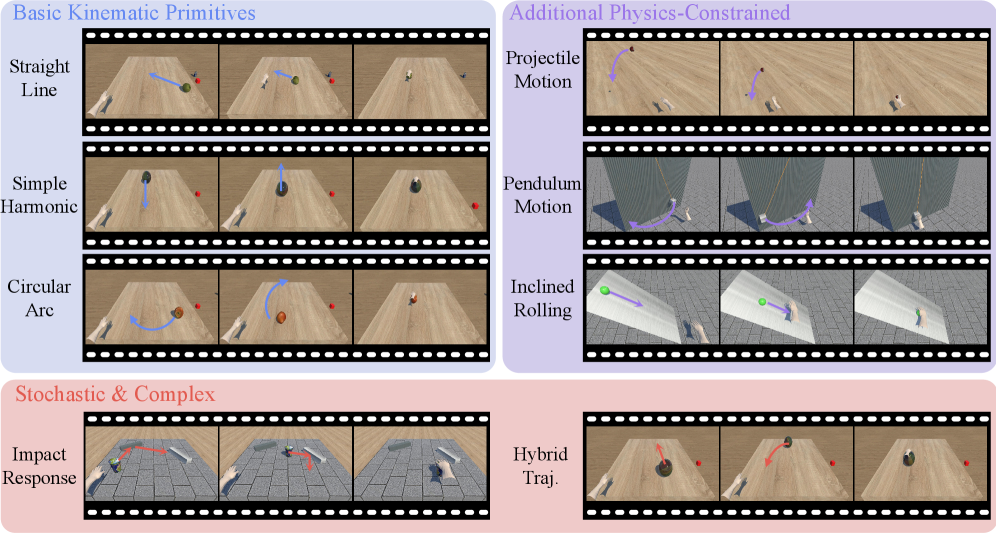

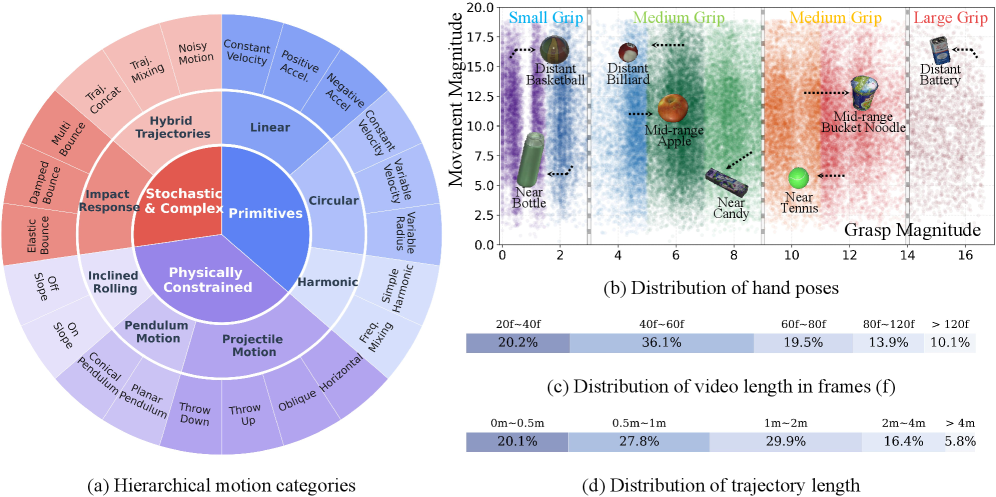

现有的手部运动生成基准主要集中于静态物体交互,忽略了动态场景中移动目标和时间敏感的协调。为了弥补这一差距,我们提出了DynaHOI-Gym,一个统一的在线闭环平台,具有参数化的运动生成器和基于rollout的动态捕获评估指标。基于DynaHOI-Gym,我们发布了DynaHOI-10M,一个大规模基准,包含1000万帧和18万条手部捕获轨迹,其目标运动被组织成8个主要类别和22个细粒度子类别。我们还提供了一个简单的观察-行动基线(ObAct),它通过时空注意力将短期观察与当前帧集成以预测动作,在位置成功率方面实现了8.1%的提升。

🔬 方法详解

问题定义:现有手部运动生成基准测试主要集中在静态物体上,无法有效评估手部与动态目标交互时的运动生成能力。这限制了算法在真实动态环境中的应用,缺乏对时间敏感性和协调性的考量。

核心思路:论文的核心思路是构建一个动态手-物交互的评估环境,通过参数化的运动生成器模拟动态目标,并设计基于rollout的评估指标来衡量手部运动生成的质量。这样可以更全面地评估算法在动态环境中的性能。

技术框架:DynaHOI-Gym是一个在线闭环平台,包含以下主要模块:1) 参数化运动生成器,用于生成动态目标的运动轨迹;2) 手部运动生成模型,用于预测手部运动;3) rollout-based评估模块,用于评估手部运动生成的质量。DynaHOI-10M数据集包含大量手部捕获轨迹和对应的动态目标运动。

关键创新:该论文的关键创新在于构建了一个动态手-物交互的评估平台DynaHOI-Gym,并提出了相应的评估指标。与现有静态基准相比,DynaHOI-Gym能够更真实地模拟动态环境,并更全面地评估手部运动生成算法的性能。

关键设计:论文提供了一个简单的观察-行动基线(ObAct),该基线模型使用时空注意力机制将短期观察与当前帧的信息融合,从而预测手部动作。具体来说,ObAct模型首先提取短期观察和当前帧的特征,然后使用时空注意力机制将这些特征融合,最后使用一个全连接层预测手部动作。损失函数采用位置成功率作为评估指标。

🖼️ 关键图片

📊 实验亮点

论文提出的ObAct基线模型在DynaHOI-Gym平台上取得了显著的性能提升,位置成功率提高了8.1%。DynaHOI-10M数据集的规模达到1000万帧,包含18万条手部捕获轨迹,为动态手-物交互研究提供了丰富的数据资源。

🎯 应用场景

该研究成果可应用于机器人操作、虚拟现实、人机交互等领域。例如,在机器人操作中,可以利用该基准测试和评估机器人在动态环境中抓取和操作物体的能力。在虚拟现实中,可以提高虚拟手部与动态虚拟物体的交互真实感。在人机交互中,可以设计更自然和高效的人机交互界面。

📄 摘要(原文)

Most existing hand motion generation benchmarks for hand-object interaction (HOI) focus on static objects, leaving dynamic scenarios with moving targets and time-critical coordination largely untested. To address this gap, we introduce the DynaHOI-Gym, a unified online closed-loop platform with parameterized motion generators and rollout-based metrics for dynamic capture evaluation. Built on DynaHOI-Gym, we release DynaHOI-10M, a large-scale benchmark with 10M frames and 180K hand capture trajectories, whose target motions are organized into 8 major categories and 22 fine-grained subcategories. We also provide a simple observe-before-act baseline (ObAct) that integrates short-term observations with the current frame via spatiotemporal attention to predict actions, achieving an 8.1% improvement in location success rate.