GSO-SLAM: Bidirectionally Coupled Gaussian Splatting and Direct Visual Odometry

作者: Jiung Yeon, Seongbo Ha, Hyeonwoo Yu

分类: cs.CV, cs.RO

发布日期: 2026-02-12

备注: 8 pages, 6 figures, RA-L accepted

💡 一句话要点

GSO-SLAM:双向耦合高斯溅射与直接视觉里程计的实时稠密SLAM系统

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: SLAM 高斯溅射 视觉里程计 实时重建 稠密场景 期望最大化 双向耦合

📋 核心要点

- 现有SLAM方法在跟踪和建图之间存在计算冗余或耦合不足的问题,限制了效率和精度。

- GSO-SLAM通过EM框架双向耦合VO和GS,联合优化深度估计和场景表示,避免额外计算开销。

- 提出的高斯溅射初始化方法利用VO信息快速生成高质量的初始场景,无需启发式方法,提升了重建质量和速度。

📝 摘要(中文)

本文提出GSO-SLAM,一种利用高斯场景表示的实时单目稠密SLAM系统。与现有方法不同,现有方法要么将跟踪和建图与统一场景耦合,导致计算成本高昂,要么将其与结构良好的跟踪框架松散集成,引入冗余。我们的方法双向耦合视觉里程计(VO)和高斯溅射(GS)。具体来说,我们的方法在期望最大化(EM)框架内制定联合优化,从而能够同时细化VO导出的半稠密深度估计和GS表示,而无需额外的计算开销。此外,我们提出了高斯溅射初始化,它利用图像信息、关键帧姿势和来自VO的像素关联来产生接近最终高斯场景的近似值,从而消除了对启发式方法的需求。通过大量的实验,我们验证了我们方法的有效性,表明它不仅可以实时运行,而且可以实现最先进的重建场景的几何/光度保真度和跟踪精度。

🔬 方法详解

问题定义:现有SLAM系统在稠密场景重建中面临计算效率和精度之间的权衡。一些方法将跟踪和建图紧密耦合,导致计算负担过重;另一些方法则采用松散耦合,引入了冗余信息,影响了重建质量。此外,高斯溅射的初始化通常依赖启发式方法,效率较低且效果不稳定。

核心思路:GSO-SLAM的核心在于通过双向耦合VO和GS,实现高效且精确的场景重建。VO提供初始的深度估计和相机姿态,GS负责场景的稠密表示和优化。通过EM框架,VO和GS相互促进,共同提升性能。这种设计避免了传统方法的计算冗余,并提高了重建质量。

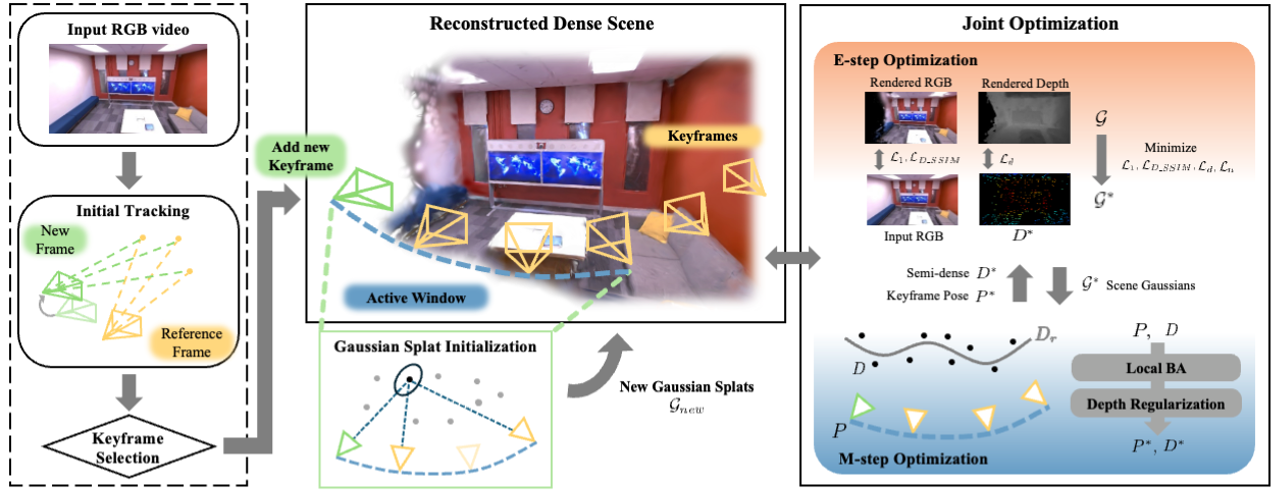

技术框架:GSO-SLAM系统主要包含以下几个模块:1) 视觉里程计(VO):负责估计相机的运动轨迹和生成半稠密深度图。2) 高斯溅射(GS):负责场景的稠密表示,并根据VO提供的深度信息进行初始化和优化。3) 期望最大化(EM)框架:用于联合优化VO和GS,实现双向耦合。在E步骤中,根据当前的GS表示更新深度估计;在M步骤中,根据更新后的深度估计优化GS参数。

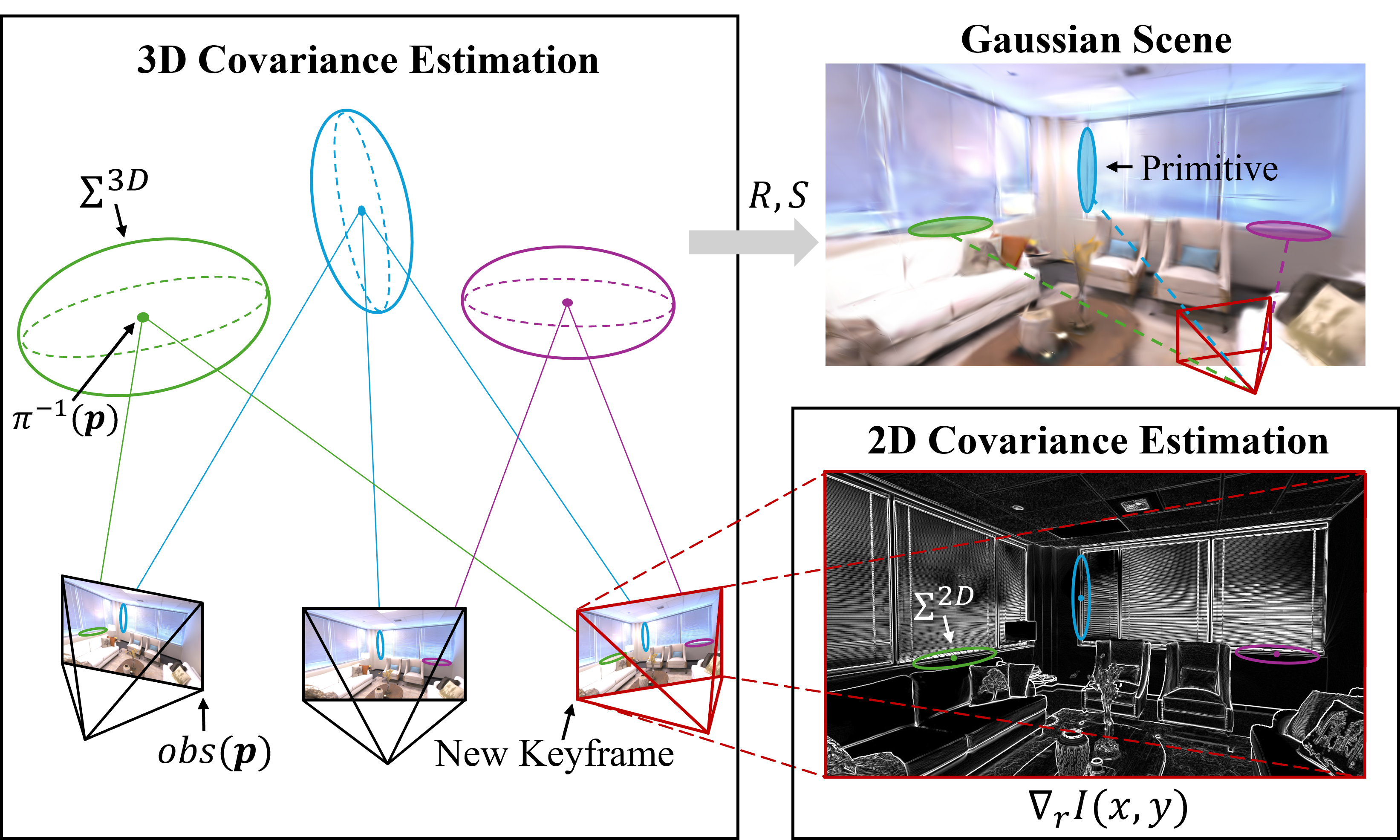

关键创新:GSO-SLAM的关键创新在于双向耦合的VO和GS以及基于VO信息的高斯溅射初始化方法。双向耦合允许VO和GS相互促进,共同提升性能。高斯溅射初始化方法利用图像信息、关键帧姿势和像素关联,快速生成高质量的初始场景,避免了启发式方法的低效和不稳定。

关键设计:GSO-SLAM使用期望最大化(EM)算法进行联合优化。E步骤更新深度图,M步骤优化高斯参数。高斯溅射初始化利用VO提供的关键帧姿态和深度信息,通过反投影和密度估计生成初始高斯分布。损失函数包括光度损失和深度损失,用于优化高斯参数。具体参数设置未知。

🖼️ 关键图片

📊 实验亮点

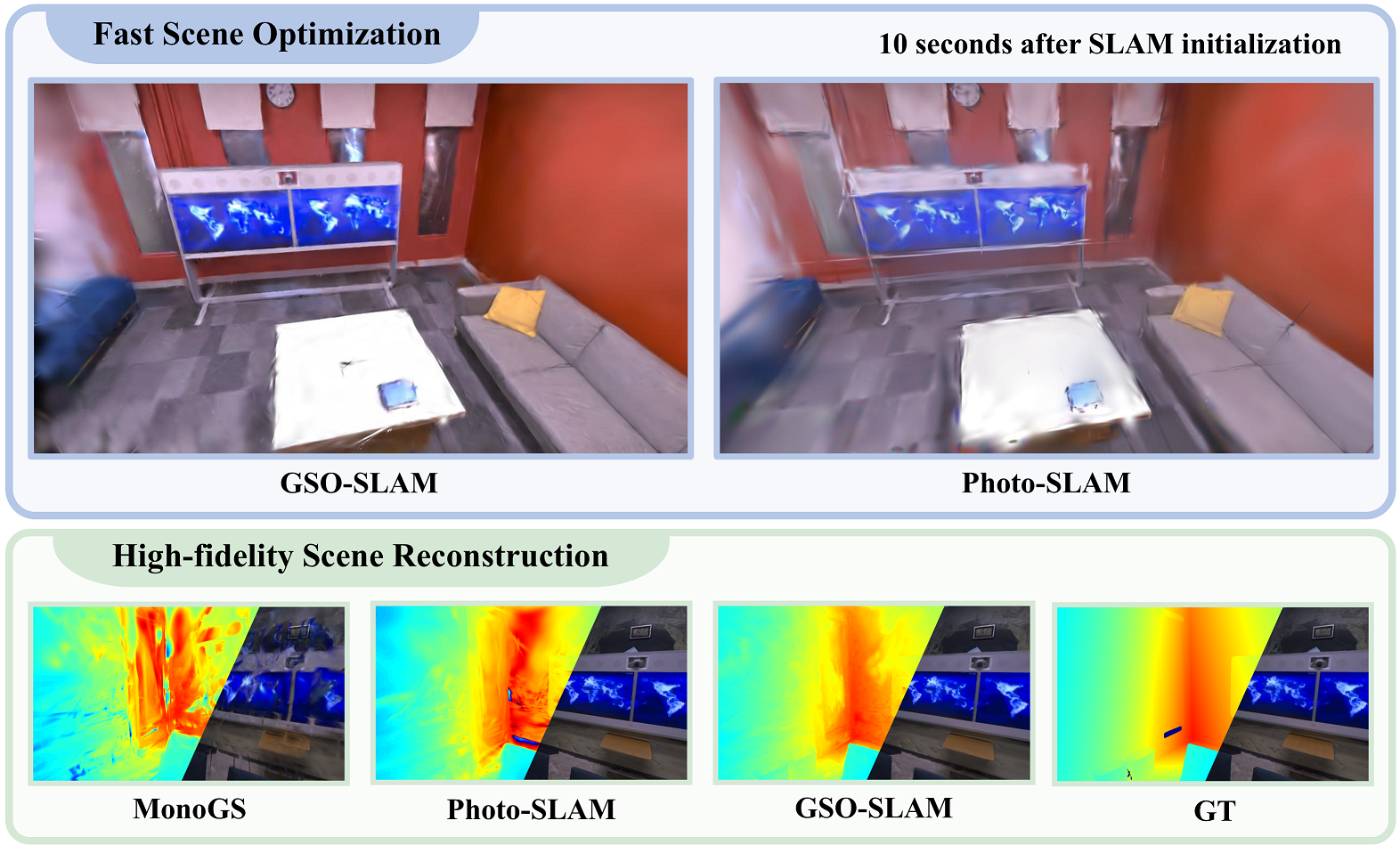

GSO-SLAM在实验中表现出卓越的性能,实现了实时运行,并在重建场景的几何和光度保真度以及跟踪精度方面达到了最先进水平。具体性能数据未知,但实验结果表明GSO-SLAM优于现有的SLAM系统,尤其是在稠密场景重建方面具有显著优势。

🎯 应用场景

GSO-SLAM具有广泛的应用前景,包括增强现实(AR)、虚拟现实(VR)、机器人导航、三维地图重建等领域。该系统能够实时生成高质量的稠密场景,为AR/VR应用提供逼真的环境交互,为机器人导航提供精确的环境感知,为三维地图重建提供高效的解决方案。未来,GSO-SLAM有望应用于自动驾驶、智能家居等更多领域。

📄 摘要(原文)

We propose GSO-SLAM, a real-time monocular dense SLAM system that leverages Gaussian scene representation. Unlike existing methods that couple tracking and mapping with a unified scene, incurring computational costs, or loosely integrate them with well-structured tracking frameworks, introducing redundancies, our method bidirectionally couples Visual Odometry (VO) and Gaussian Splatting (GS). Specifically, our approach formulates joint optimization within an Expectation-Maximization (EM) framework, enabling the simultaneous refinement of VO-derived semi-dense depth estimates and the GS representation without additional computational overhead. Moreover, we present Gaussian Splat Initialization, which utilizes image information, keyframe poses, and pixel associations from VO to produce close approximations to the final Gaussian scene, thereby eliminating the need for heuristic methods. Through extensive experiments, we validate the effectiveness of our method, showing that it not only operates in real time but also achieves state-of-the-art geometric/photometric fidelity of the reconstructed scene and tracking accuracy.