EmoSpace: Fine-Grained Emotion Prototype Learning for Immersive Affective Content Generation

作者: Bingyuan Wang, Xingbei Chen, Zongyang Qiu, Linping Yuan, Zeyu Wang

分类: cs.CV

发布日期: 2026-02-12

💡 一句话要点

EmoSpace:通过细粒度情感原型学习实现沉浸式情感内容生成

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 情感感知 内容生成 虚拟现实 视觉-语言对齐 情感原型学习

📋 核心要点

- 现有情感内容生成方法难以捕捉细微的情感语义,缺乏对沉浸式体验至关重要的细粒度控制。

- EmoSpace通过视觉-语言对齐学习动态、可解释的情感原型,实现细粒度情感控制,无需显式情感标签。

- 实验表明,EmoSpace在定性和定量评估中均优于现有方法,用户研究也验证了VR环境对情感感知的独特影响。

📝 摘要(中文)

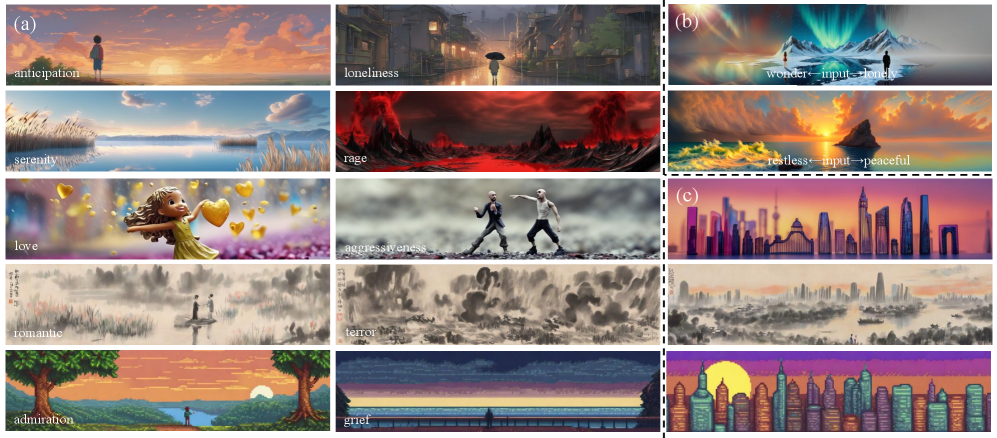

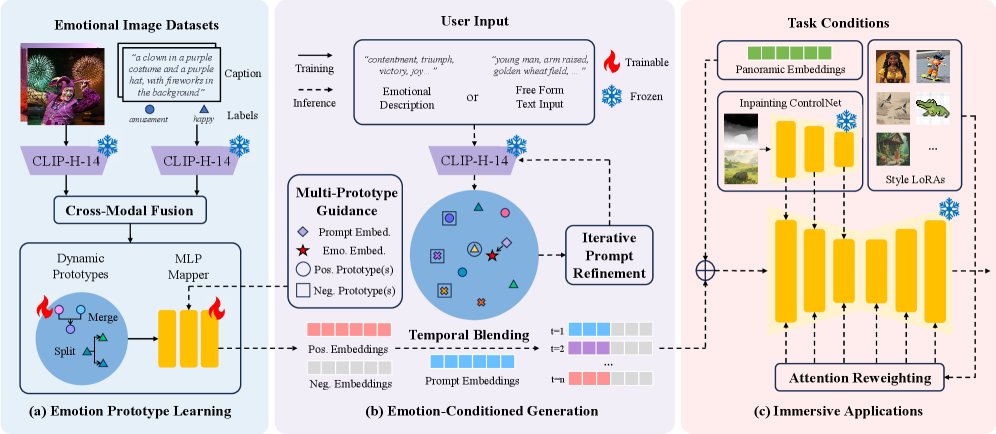

情感对于创建引人入胜的虚拟现实(VR)内容至关重要。虽然一些生成方法已被应用于降低创建情感丰富内容的门槛,但它们未能捕捉到细微的情感语义和沉浸式体验所必需的细粒度控制。为了解决这些限制,我们引入了EmoSpace,这是一个新颖的情感感知内容生成框架,它通过视觉-语言对齐学习动态的、可解释的情感原型。我们采用具有丰富可学习原型的分层情感表示,这些原型在训练过程中不断演变,从而实现细粒度的情感控制,而无需显式的情感标签。我们开发了一个可控的生成流程,具有多原型指导、时间混合和注意力重新加权,支持多种应用,包括情感图像外推、风格化生成和用于VR环境的情感全景生成。我们的实验证明了EmoSpace在定性和定量评估中优于现有方法。此外,我们还进行了一项全面的用户研究,调查VR环境与桌面设置相比如何影响情感感知。我们的工作促进了具有细粒度情感控制的沉浸式视觉内容生成,并支持治疗、教育、故事讲述、艺术创作和文化保护等应用。代码和模型将公开发布。

🔬 方法详解

问题定义:现有情感内容生成方法无法充分捕捉情感的细微差别,难以实现对生成内容情感的精确控制,尤其是在沉浸式VR环境中。现有方法通常依赖于粗粒度的情感标签,限制了生成内容的情感表达能力。

核心思路:EmoSpace的核心思路是通过学习一组动态的、可解释的情感原型来表示情感空间。这些原型在训练过程中不断演化,能够捕捉到情感的细微变化。通过视觉-语言对齐,EmoSpace将情感原型与视觉内容联系起来,从而实现情感感知的生成。

技术框架:EmoSpace包含以下主要模块:1) 分层情感表示模块,用于构建情感原型;2) 视觉-语言对齐模块,用于将情感原型与视觉内容对齐;3) 可控生成流程,包括多原型指导、时间混合和注意力重新加权,用于生成情感丰富的视觉内容。整体流程是从文本描述中提取情感信息,然后利用情感原型指导图像生成,并通过时间混合和注意力重新加权来优化生成结果。

关键创新:EmoSpace的关键创新在于其动态、可解释的情感原型学习方法。与现有方法相比,EmoSpace无需显式的情感标签,而是通过视觉-语言对齐自动学习情感原型。此外,EmoSpace的多原型指导和注意力重新加权机制能够实现对生成内容情感的细粒度控制。

关键设计:EmoSpace采用分层情感表示,允许模型学习不同层次的情感原型。损失函数包括视觉-语言对齐损失和生成对抗损失,用于优化情感原型和生成器。注意力重新加权机制通过调整不同区域的注意力权重来控制生成内容的情感表达。

🖼️ 关键图片

📊 实验亮点

实验结果表明,EmoSpace在情感图像外推、风格化生成和情感全景生成等任务中均优于现有方法。用户研究表明,与桌面设置相比,VR环境能够增强用户的情感感知。EmoSpace在定量指标和定性评估中均取得了显著提升,证明了其在情感感知内容生成方面的有效性。

🎯 应用场景

EmoSpace可应用于多种领域,包括情感治疗、教育、故事讲述、艺术创作和文化遗产保护。例如,可以利用EmoSpace生成具有特定情感氛围的VR环境,用于治疗心理疾病或进行情感教育。此外,EmoSpace还可以用于创作具有情感表现力的艺术作品或重建具有历史意义的文化场景。

📄 摘要(原文)

Emotion is important for creating compelling virtual reality (VR) content. Although some generative methods have been applied to lower the barrier to creating emotionally rich content, they fail to capture the nuanced emotional semantics and the fine-grained control essential for immersive experiences. To address these limitations, we introduce EmoSpace, a novel framework for emotion-aware content generation that learns dynamic, interpretable emotion prototypes through vision-language alignment. We employ a hierarchical emotion representation with rich learnable prototypes that evolve during training, enabling fine-grained emotional control without requiring explicit emotion labels. We develop a controllable generation pipeline featuring multi-prototype guidance, temporal blending, and attention reweighting that supports diverse applications, including emotional image outpainting, stylized generation, and emotional panorama generation for VR environments. Our experiments demonstrate the superior performance of EmoSpace over existing methods in both qualitative and quantitative evaluations. Additionally, we present a comprehensive user study investigating how VR environments affect emotional perception compared to desktop settings. Our work facilitates immersive visual content generation with fine-grained emotion control and supports applications like therapy, education, storytelling, artistic creation, and cultural preservation. Code and models will be made publicly available.