HairWeaver: Few-Shot Photorealistic Hair Motion Synthesis with Sim-to-Real Guided Video Diffusion

作者: Di Chang, Ji Hou, Aljaz Bozic, Assaf Neuberger, Felix Juefei-Xu, Olivier Maury, Gene Wei-Chin Lin, Tuur Stuyck, Doug Roble, Mohammad Soleymani, Stephane Grabli

分类: cs.CV

发布日期: 2026-02-11

备注: Website: https://boese0601.github.io/hairweaver/

💡 一句话要点

HairWeaver:基于扩散模型的少样本逼真头发运动合成

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱四:生成式动作 (Generative Motion) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 头发动画 扩散模型 LoRA Sim2Real 运动合成

📋 核心要点

- 现有方法在人物动画中缺乏对头发运动的精细控制,导致头发动画僵硬不真实。

- HairWeaver 提出使用 Motion-Context-LoRA 和 Sim2Real-Domain-LoRA 来引导视频扩散模型,从而实现对头发运动的精确控制。

- HairWeaver 在 CG 模拟数据上训练,并在真实图像上实现了逼真的头发动画效果,达到了新的技术水平。

📝 摘要(中文)

HairWeaver 是一种基于扩散模型的流程,旨在通过逼真且富有表现力的头发动态来动画化单个人物图像。现有方法虽然能成功控制身体姿势,但缺乏对头发的特定控制,导致无法捕捉复杂的头发运动,产生僵硬且不真实的动画。HairWeaver 通过两个专门的模块克服了这一限制:Motion-Context-LoRA 用于整合运动条件,Sim2Real-Domain-LoRA 用于在不同数据域中保持拍摄对象的逼真外观。这些轻量级组件旨在引导视频扩散骨干网络,同时保持其核心生成能力。通过在从 CG 模拟器生成的动态人体运动的专门数据集上进行训练,HairWeaver 能够精细控制头发运动,并最终学习生成对运动自然反应的高度逼真的头发。全面的评估表明,我们的方法树立了新的技术水平,产生了具有动态细节的逼真的人类头发动画。

🔬 方法详解

问题定义:现有的人物动画方法在控制身体姿势方面取得了进展,但缺乏对头发运动的精细控制。这导致生成的头发动画显得僵硬、不自然,无法捕捉到头发复杂的动态细节。因此,需要一种能够生成逼真头发运动的动画方法。

核心思路:HairWeaver 的核心思路是利用扩散模型强大的生成能力,并结合 LoRA (Low-Rank Adaptation) 技术,通过两个专门设计的模块来引导扩散模型生成逼真的头发运动。Motion-Context-LoRA 负责整合运动信息,Sim2Real-Domain-LoRA 负责保持生成图像的真实感。

技术框架:HairWeaver 的整体框架包括以下几个主要步骤:1) 输入单张人物图像和运动信息(例如身体姿势)。2) 使用 Motion-Context-LoRA 将运动信息融入到扩散模型的生成过程中。3) 使用 Sim2Real-Domain-LoRA 确保生成图像的真实感,弥合 CG 模拟数据和真实数据之间的差距。4) 通过扩散模型生成最终的动画视频。

关键创新:HairWeaver 的关键创新在于提出了 Motion-Context-LoRA 和 Sim2Real-Domain-LoRA 这两个模块。Motion-Context-LoRA 能够有效地将运动信息融入到扩散模型中,从而实现对头发运动的精确控制。Sim2Real-Domain-LoRA 能够弥合 CG 模拟数据和真实数据之间的差距,从而生成更加逼真的图像。与现有方法相比,HairWeaver 能够生成更加自然、逼真的头发动画。

关键设计:Motion-Context-LoRA 和 Sim2Real-Domain-LoRA 都是基于 LoRA 技术实现的轻量级模块。LoRA 通过学习低秩矩阵来适应预训练的扩散模型,从而避免了对整个模型进行微调,降低了训练成本。此外,HairWeaver 使用了专门的 CG 模拟数据集进行训练,该数据集包含了丰富的人体运动和头发动态信息。损失函数方面,使用了标准的扩散模型训练损失,并可能结合了一些额外的正则化项来提高生成图像的质量。

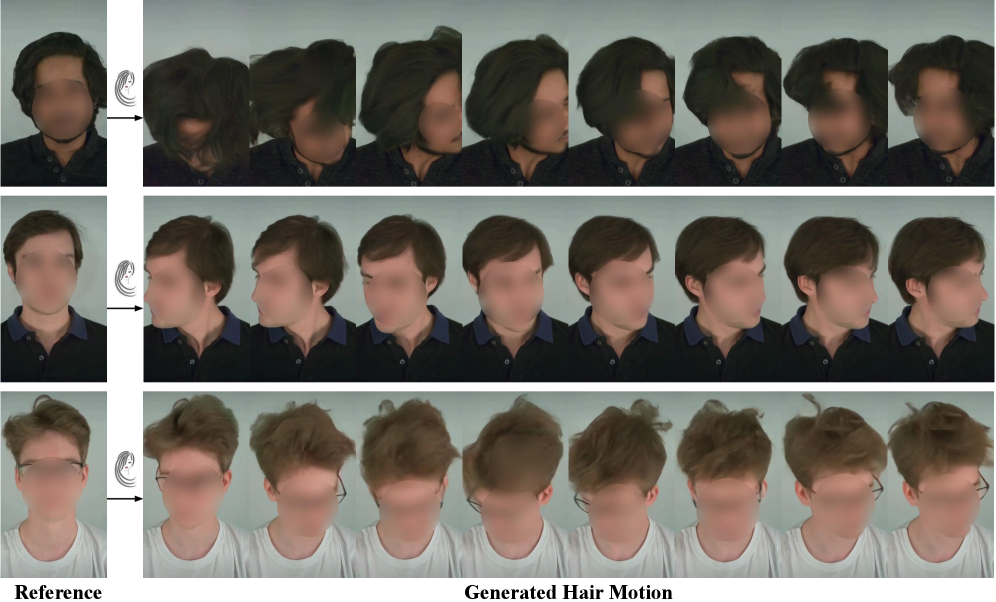

🖼️ 关键图片

📊 实验亮点

HairWeaver 通过在专门的 CG 模拟数据集上进行训练,并在真实图像上进行测试,展示了其生成逼真头发动画的能力。实验结果表明,HairWeaver 在头发动画的真实感和细节方面均优于现有方法,达到了新的技术水平。具体性能数据和对比基线的信息在摘要中未明确给出,属于未知信息。

🎯 应用场景

HairWeaver 可应用于电影、游戏、虚拟现实等领域,用于生成逼真的人物动画。该技术可以大幅提升虚拟角色的真实感和表现力,为用户带来更加沉浸式的体验。此外,HairWeaver 还可以用于服装设计、发型设计等领域,帮助设计师快速预览不同运动状态下的服装和发型效果。未来,该技术有望应用于更多需要逼真人物动画的场景。

📄 摘要(原文)

We present HairWeaver, a diffusion-based pipeline that animates a single human image with realistic and expressive hair dynamics. While existing methods successfully control body pose, they lack specific control over hair, and as a result, fail to capture the intricate hair motions, resulting in stiff and unrealistic animations. HairWeaver overcomes this limitation using two specialized modules: a Motion-Context-LoRA to integrate motion conditions and a Sim2Real-Domain-LoRA to preserve the subject's photoreal appearance across different data domains. These lightweight components are designed to guide a video diffusion backbone while maintaining its core generative capabilities. By training on a specialized dataset of dynamic human motion generated from a CG simulator, HairWeaver affords fine control over hair motion and ultimately learns to produce highly realistic hair that responds naturally to movement. Comprehensive evaluations demonstrate that our approach sets a new state of the art, producing lifelike human hair animations with dynamic details.