FastFlow: Accelerating The Generative Flow Matching Models with Bandit Inference

作者: Divya Jyoti Bajpai, Dhruv Bhardwaj, Soumya Roy, Tejas Duseja, Harsh Agarwal, Aashay Sandansing, Manjesh Kumar Hanawal

分类: cs.CV

发布日期: 2026-02-11

备注: Accepted at International Conference on Learning Representations (ICLR) 2026

🔗 代码/项目: GITHUB

💡 一句话要点

FastFlow:利用Bandit推断加速生成流匹配模型

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 生成流匹配模型 模型加速 自适应推理 多臂老虎机 图像生成 视频生成 图像编辑

📋 核心要点

- 现有流匹配模型生成质量高但速度慢,传统加速方法缺乏灵活性和泛化能力,需要重新训练。

- FastFlow通过近似不重要的去噪步骤来加速生成,利用有限差分估计进行状态推断,并采用多臂老虎机学习最佳跳过策略。

- 实验表明,FastFlow在图像、视频生成和编辑任务中实现了超过2.6倍的加速,同时保持了高质量的生成效果。

📝 摘要(中文)

流匹配模型在图像和视频生成方面表现出最先进的保真度,但其固有的顺序去噪过程导致速度较慢。现有的加速方法,如蒸馏、轨迹截断和一致性方法,是静态的,需要重新训练,并且通常无法跨任务泛化。我们提出了FastFlow,一个即插即用的自适应推理框架,用于加速流匹配模型中的生成过程。FastFlow识别出对去噪路径产生微小调整的去噪步骤,并近似它们,而无需使用用于速度预测的完整神经网络模型。该近似利用来自先前预测的有限差分速度估计来有效地推断未来状态,从而以零计算成本实现沿去噪路径的更快推进。这使得可以跳过中间步骤的计算。我们将安全跳过的步数(在需要完整模型计算之前)的决策建模为一个多臂老虎机问题。老虎机学习最佳跳过策略,以平衡速度和性能。FastFlow与现有流程无缝集成,并可推广到图像生成、视频生成和编辑任务。实验表明,在保持高质量输出的同时,速度提高了2.6倍以上。该工作的源代码可在https://github.com/Div290/FastFlow找到。

🔬 方法详解

问题定义:论文旨在解决生成流匹配模型推理速度慢的问题。现有的加速方法,如蒸馏、轨迹截断等,通常是静态的,需要针对特定任务重新训练,并且泛化能力有限。这些方法无法根据去噪过程的动态变化自适应地调整计算量,导致计算资源的浪费。

核心思路:FastFlow的核心思想是识别并跳过对去噪路径影响较小的中间步骤,从而减少计算量。它通过近似这些步骤,利用先前步骤的速度估计来推断后续状态,避免了对完整神经网络模型的重复计算。同时,采用多臂老虎机算法来学习最佳的跳过策略,以平衡生成速度和质量。

技术框架:FastFlow框架主要包含以下几个阶段:1) 速度估计:利用有限差分方法,根据先前步骤的预测结果估计当前步骤的速度。2) 状态推断:使用估计的速度来推断后续状态,从而近似跳过的去噪步骤。3) 多臂老虎机决策:根据当前状态和历史经验,决定跳过多少个去噪步骤。4) 模型计算:在跳过一定数量的步骤后,使用完整的神经网络模型进行精确计算,以保证生成质量。

关键创新:FastFlow的关键创新在于其自适应的推理策略。它能够根据去噪过程的动态变化,自动调整计算量,从而在保证生成质量的前提下,最大程度地提高生成速度。与传统的静态加速方法相比,FastFlow具有更强的灵活性和泛化能力。此外,将多臂老虎机算法引入到流匹配模型的推理过程中,也是一个重要的创新。

关键设计:FastFlow的关键设计包括:1) 有限差分速度估计:利用相邻步骤的预测结果计算速度,避免了额外的计算开销。2) 多臂老虎机奖励函数:奖励函数的设计需要平衡生成速度和质量,例如可以采用生成图像的FID分数作为奖励信号。3) 跳过步数的上限:为了保证生成质量,需要设置跳过步数的上限,避免过度近似。

🖼️ 关键图片

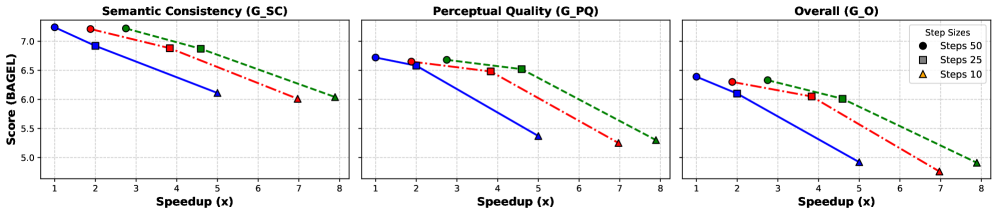

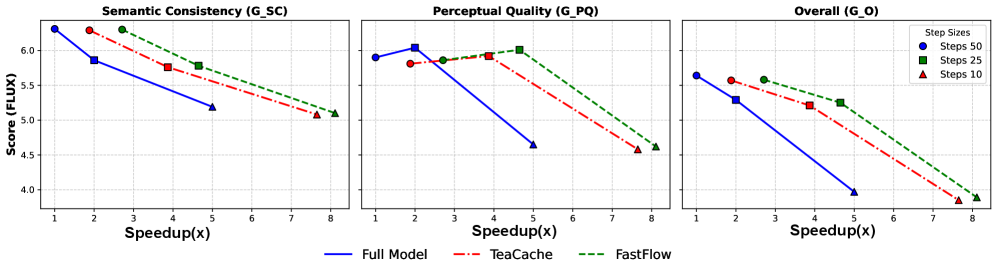

📊 实验亮点

FastFlow在图像生成、视频生成和编辑任务中实现了显著的加速效果。实验结果表明,FastFlow能够在保持高质量输出的同时,实现超过2.6倍的加速。与现有的加速方法相比,FastFlow具有更强的泛化能力,无需针对特定任务进行重新训练。此外,FastFlow的即插即用特性使其易于集成到现有的流匹配模型流程中。

🎯 应用场景

FastFlow可广泛应用于图像生成、视频生成、图像编辑等领域。它可以显著提高这些任务的生成速度,降低计算成本,并支持在资源受限的设备上进行高质量的生成。该研究的成果有助于推动生成模型在实际应用中的普及,例如在游戏开发、电影制作、广告设计等领域。

📄 摘要(原文)

Flow-matching models deliver state-of-the-art fidelity in image and video generation, but the inherent sequential denoising process renders them slower. Existing acceleration methods like distillation, trajectory truncation, and consistency approaches are static, require retraining, and often fail to generalize across tasks. We propose FastFlow, a plug-and-play adaptive inference framework that accelerates generation in flow matching models. FastFlow identifies denoising steps that produce only minor adjustments to the denoising path and approximates them without using the full neural network models used for velocity predictions. The approximation utilizes finite-difference velocity estimates from prior predictions to efficiently extrapolate future states, enabling faster advancements along the denoising path at zero compute cost. This enables skipping computation at intermediary steps. We model the decision of how many steps to safely skip before requiring a full model computation as a multi-armed bandit problem. The bandit learns the optimal skips to balance speed with performance. FastFlow integrates seamlessly with existing pipelines and generalizes across image generation, video generation, and editing tasks. Experiments demonstrate a speedup of over 2.6x while maintaining high-quality outputs. The source code for this work can be found at https://github.com/Div290/FastFlow.