Interpretable Vision Transformers in Monocular Depth Estimation via SVDA

作者: Vasileios Arampatzakis, George Pavlidis, Nikolaos Mitianoudis, Nikos Papamarkos

分类: cs.CV

发布日期: 2026-02-11

备注: 8 pages, 2 figures, submitted to CVPR Conference 2026

💡 一句话要点

提出SVDA的单目深度估计Transformer,实现可解释的自注意力机制

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 单目深度估计 Transformer 自注意力机制 可解释性 谱分解

📋 核心要点

- 现有Transformer的自注意力机制不透明,难以理解其内部运作,阻碍了模型改进和信任。

- 提出SVD-Inspired Attention (SVDA),通过谱分解解耦方向对齐和谱调制,实现本质上的可解释性。

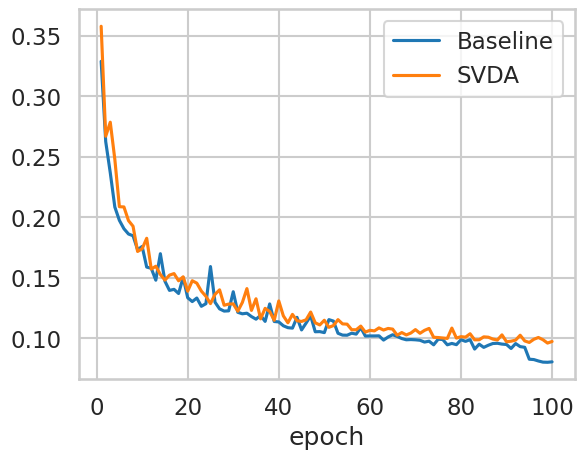

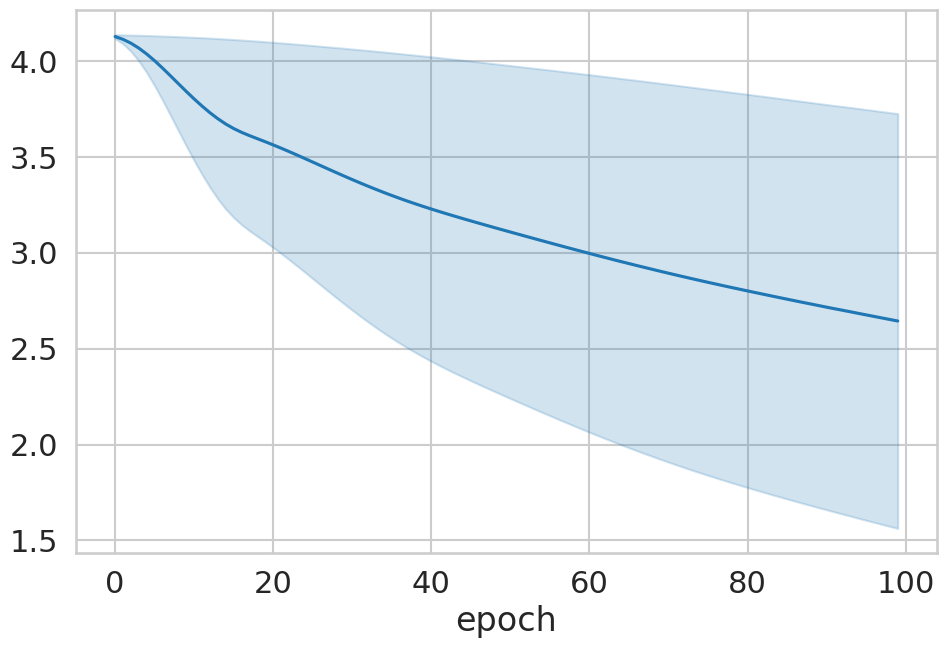

- 实验表明,SVDA在保持或略微提高预测精度的同时,解锁了六个谱指标,揭示了注意力组织的模式。

📝 摘要(中文)

单目深度估计是计算机视觉中的核心问题,在机器人、增强现实和自动驾驶等领域有广泛应用。然而,驱动现代Transformer架构的自注意力机制仍然不透明。本文将受奇异值分解(SVD)启发的注意力机制(SVDA)引入到密集预测Transformer (DPT)中,为密集预测任务提供了第一个谱结构化的注意力公式。SVDA通过在归一化的查询-键交互中嵌入可学习的对角矩阵,将方向对齐与谱调制解耦,从而实现本质上可解释的注意力图,而不是事后近似。在KITTI和NYU-v2上的实验表明,SVDA在仅增加少量计算开销的同时,保持或略微提高了预测精度。更重要的是,SVDA解锁了六个谱指标,可以量化熵、秩、稀疏性、对齐、选择性和鲁棒性。这些指标揭示了训练期间注意力如何组织的跨数据集和深度方向的一致模式,这些见解在标准Transformer中仍然无法获得。通过将注意力的作用从不透明的机制转变为可量化的描述符,SVDA重新定义了单目深度估计中的可解释性,并为透明的密集预测模型开辟了一条有原则的途径。

🔬 方法详解

问题定义:单目深度估计旨在仅使用单个图像来预测场景中每个像素的深度。现有的基于Transformer的方法,特别是使用自注意力机制的方法,虽然取得了良好的性能,但其内部运作机制复杂,缺乏可解释性。理解自注意力机制如何工作,以及它关注哪些特征,对于改进模型和建立信任至关重要。

核心思路:本文的核心思路是将自注意力机制进行谱分解,受到奇异值分解(SVD)的启发,将注意力操作分解为方向对齐和谱调制两个部分。通过这种分解,可以更容易地理解注意力机制关注哪些特征,以及这些特征如何影响深度预测。具体来说,通过引入一个可学习的对角矩阵,可以控制谱调制的过程,从而实现对注意力机制的更精细的控制。

技术框架:本文将提出的SVDA模块集成到Dense Prediction Transformer (DPT)架构中。DPT首先使用一个卷积神经网络提取图像特征,然后使用Transformer编码器对特征进行编码。SVDA模块被插入到Transformer编码器的自注意力层中,替换标准的自注意力操作。解码器使用编码后的特征来预测每个像素的深度。整体流程包括特征提取、Transformer编码(包含SVDA)、深度解码三个阶段。

关键创新:最重要的技术创新点是SVD-Inspired Attention (SVDA)模块。SVDA通过将注意力操作分解为方向对齐和谱调制两个部分,实现了对注意力机制的可解释性。与现有方法不同,SVDA不是通过事后分析来解释注意力图,而是通过设计本身就具有可解释性的注意力机制。这使得可以量化注意力机制的熵、秩、稀疏性、对齐、选择性和鲁棒性等指标。

关键设计:SVDA的关键设计在于引入了一个可学习的对角矩阵,用于控制谱调制的过程。这个对角矩阵的维度与特征维度相同,每个元素表示对应特征的重要性。通过学习这个对角矩阵,可以控制注意力机制关注哪些特征。此外,本文还定义了六个谱指标,用于量化注意力机制的各个方面。这些指标可以用于分析注意力机制的行为,并指导模型的设计和训练。损失函数方面,沿用DPT的损失函数,没有做特殊修改。

🖼️ 关键图片

📊 实验亮点

在KITTI和NYU-v2数据集上的实验表明,SVDA在保持或略微提高预测精度的同时,显著提高了模型的可解释性。SVDA解锁了六个谱指标,可以量化注意力机制的各个方面,揭示了训练期间注意力如何组织的跨数据集和深度方向的一致模式。例如,实验观察到注意力机制在不同深度范围内表现出不同的选择性和鲁棒性。

🎯 应用场景

该研究成果可应用于机器人导航、增强现实、自动驾驶等领域。通过提高单目深度估计的可解释性,可以增强人们对这些系统的信任,并促进其在安全关键型应用中的部署。此外,该方法还可以用于分析和改进其他基于Transformer的视觉模型。

📄 摘要(原文)

Monocular depth estimation is a central problem in computer vision with applications in robotics, AR, and autonomous driving, yet the self-attention mechanisms that drive modern Transformer architectures remain opaque. We introduce SVD-Inspired Attention (SVDA) into the Dense Prediction Transformer (DPT), providing the first spectrally structured formulation of attention for dense prediction tasks. SVDA decouples directional alignment from spectral modulation by embedding a learnable diagonal matrix into normalized query-key interactions, enabling attention maps that are intrinsically interpretable rather than post-hoc approximations. Experiments on KITTI and NYU-v2 show that SVDA preserves or slightly improves predictive accuracy while adding only minor computational overhead. More importantly, SVDA unlocks six spectral indicators that quantify entropy, rank, sparsity, alignment, selectivity, and robustness. These reveal consistent cross-dataset and depth-wise patterns in how attention organizes during training, insights that remain inaccessible in standard Transformers. By shifting the role of attention from opaque mechanism to quantifiable descriptor, SVDA redefines interpretability in monocular depth estimation and opens a principled avenue toward transparent dense prediction models.