RSHallu: Dual-Mode Hallucination Evaluation for Remote-Sensing Multimodal Large Language Models with Domain-Tailored Mitigation

作者: Zihui Zhou, Yong Feng, Yanying Chen, Guofan Duan, Zhenxi Song, Mingliang Zhou, Weijia Jia

分类: cs.CV, cs.AI

发布日期: 2026-02-11

💡 一句话要点

RSHallu:针对遥感多模态大语言模型的幻觉评估与领域定制缓解

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 遥感 多模态大语言模型 幻觉评估 幻觉缓解 领域自适应 视觉问答 视觉定位

📋 核心要点

- 遥感多模态大语言模型存在幻觉问题,严重影响其在高风险场景的应用,现有研究对此关注不足。

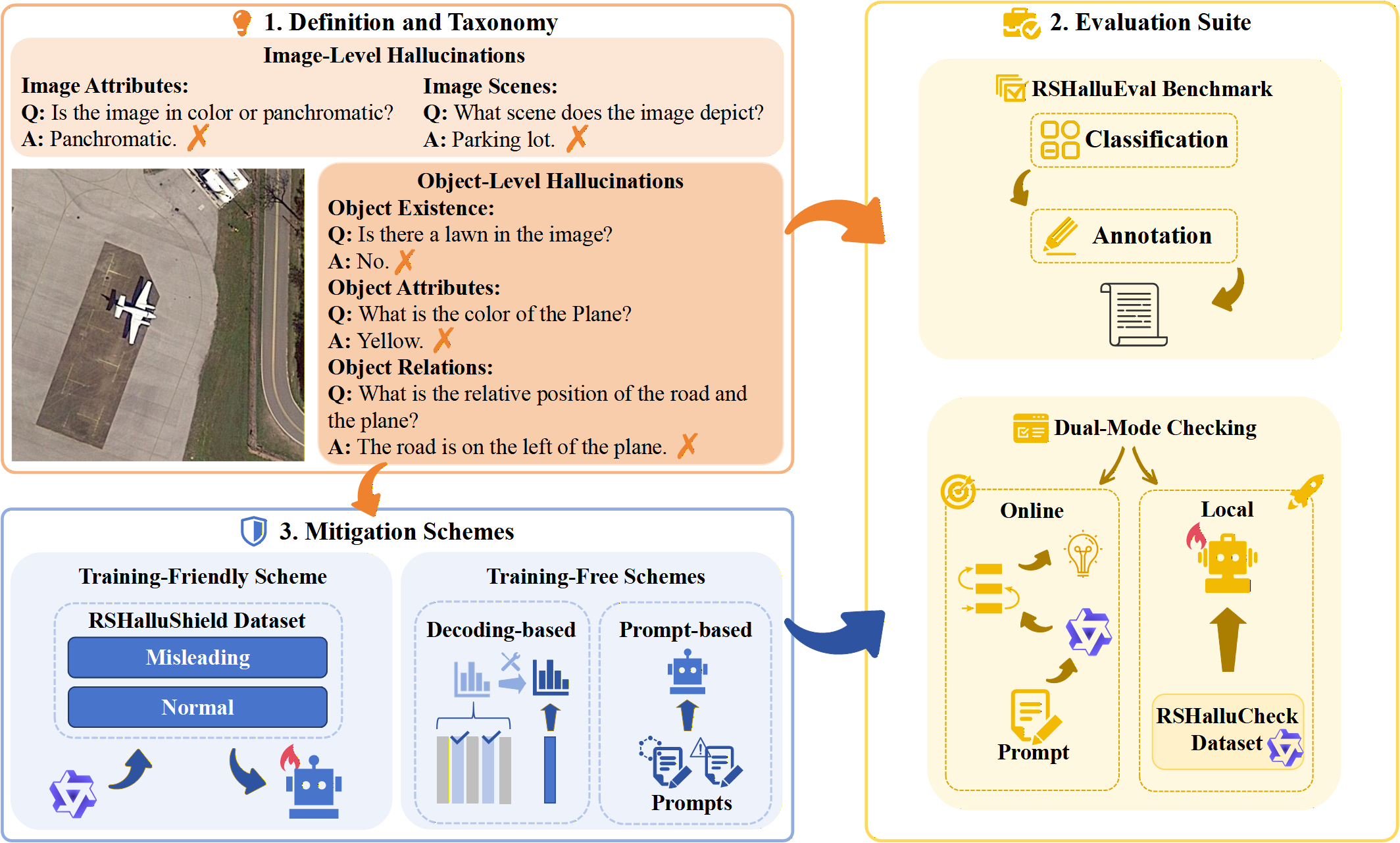

- 提出RSHallu,包含遥感幻觉分类、基准数据集、幻觉检查器和领域定制缓解策略。

- 实验表明,所提出的缓解策略可显著提高无幻觉率,同时保持下游任务的性能。

📝 摘要(中文)

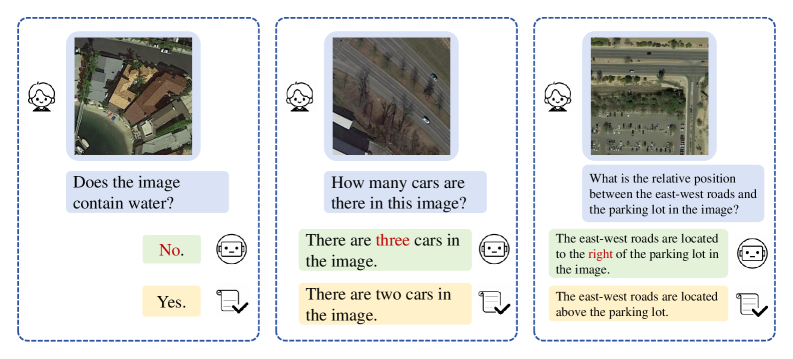

多模态大语言模型(MLLMs)在遥感(RS)领域应用日益广泛,并在遥感视觉定位(RSVG)、遥感视觉问答(RSVQA)和多模态对话等任务中表现出强大的性能。然而,与输入遥感图像不一致的幻觉响应严重阻碍了它们在高风险场景(如应急管理和农业监测)中的部署,并且在遥感领域尚未得到充分研究。本文提出了RSHallu,一项包含三个交付物的系统研究:(1)形式化了遥感幻觉,提出了面向遥感的分类法,并引入了图像级幻觉,以捕捉超出以对象为中心的错误的遥感特定不一致性(例如,模态、分辨率和场景级语义);(2)构建了一个幻觉基准RSHalluEval(2,023个QA对),并支持双模式检查,通过在RSHalluCheck数据集(15,396个QA对)上微调的紧凑型检查器,实现高精度云审计和低成本可重复的本地检查;(3)引入了一个领域定制的数据集RSHalluShield(30k个QA对),用于训练友好的缓解,并进一步提出了免训练的即插即用策略,包括解码时logit校正和遥感感知提示。在代表性的RS-MLLM中,我们的缓解措施在统一协议下将无幻觉率提高了高达21.63个百分点,同时保持了下游RS任务(RSVQA/RSVG)上的竞争性能。代码和数据集将发布。

🔬 方法详解

问题定义:遥感领域的多模态大语言模型(MLLMs)容易产生幻觉,即生成与输入遥感图像不一致的响应。现有的幻觉评估方法主要集中在通用领域,缺乏对遥感图像特点的考虑,例如模态差异、分辨率变化和场景语义理解。这些幻觉问题限制了MLLMs在应急管理、农业监测等高风险领域的可靠应用。

核心思路:论文的核心思路是系统性地研究遥感领域的幻觉问题,从定义、评估和缓解三个方面入手。首先,形式化遥感幻觉,提出面向遥感的分类法,并引入图像级幻觉的概念。其次,构建幻觉基准数据集RSHalluEval和RSHalluCheck,用于评估和检查幻觉。最后,提出领域定制的数据集RSHalluShield和免训练的即插即用策略,用于缓解幻觉。

技术框架:RSHallu框架包含三个主要组成部分:1) 遥感幻觉分类体系:定义了遥感领域特有的幻觉类型,包括模态幻觉、分辨率幻觉和场景语义幻觉等。2) 幻觉评估基准RSHalluEval和RSHalluCheck:RSHalluEval用于评估MLLMs的幻觉程度,RSHalluCheck用于训练一个紧凑型检查器,实现高效的幻觉检测。3) 幻觉缓解策略:包括领域定制的数据集RSHalluShield和免训练的即插即用策略(解码时logit校正和遥感感知提示)。

关键创新:论文的关键创新在于:1) 提出了面向遥感的幻觉分类体系,更全面地捕捉了遥感图像的特点。2) 构建了专门用于遥感领域的幻觉评估基准数据集RSHalluEval和RSHalluCheck。3) 提出了领域定制的幻觉缓解策略,包括数据集RSHalluShield和免训练的即插即用方法,无需重新训练模型即可有效降低幻觉。

关键设计:RSHalluCheck数据集用于微调一个紧凑型检查器,该检查器可以高效地判断QA对是否存在幻觉。RSHalluShield数据集包含30k个QA对,用于训练MLLMs,以提高其对遥感图像的理解能力,从而减少幻觉。解码时logit校正通过调整模型输出的logit值来抑制幻觉。遥感感知提示通过在输入中加入遥感领域的先验知识来引导模型生成更准确的响应。

🖼️ 关键图片

📊 实验亮点

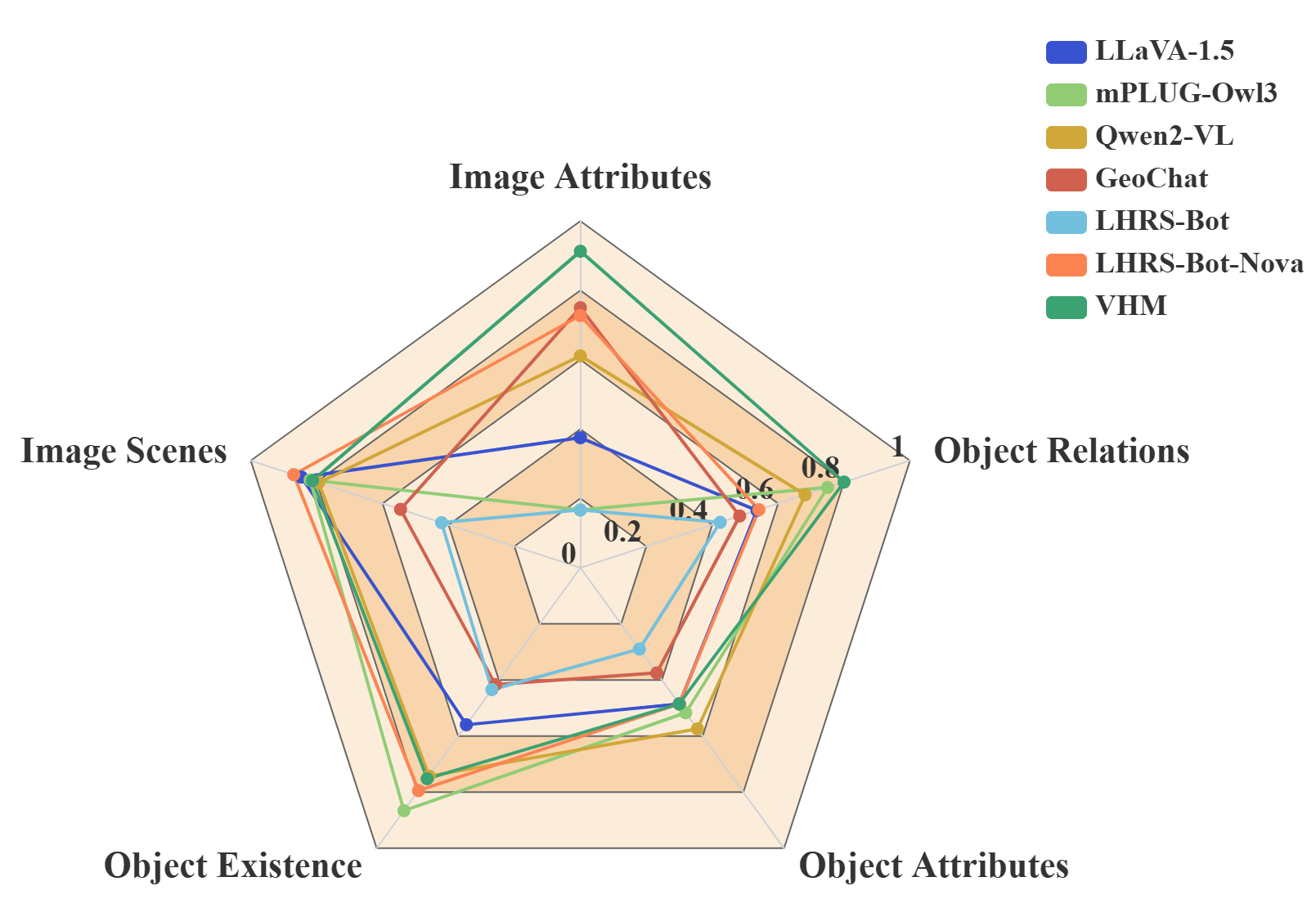

实验结果表明,在代表性的遥感多模态大语言模型上,使用RSHallu提出的缓解策略,无幻觉率提高了高达21.63个百分点,同时保持了在下游遥感任务(RSVQA/RSVG)上的竞争性能。这表明该方法在降低幻觉的同时,不会损害模型的整体性能。

🎯 应用场景

该研究成果可应用于应急管理、农业监测、城市规划等多个遥感领域。通过降低遥感多模态大语言模型的幻觉,可以提高其在这些领域的可靠性和实用性,例如在灾害发生时,可以更准确地分析遥感图像,辅助决策者进行救援部署。

📄 摘要(原文)

Multimodal large language models (MLLMs) are increasingly adopted in remote sensing (RS) and have shown strong performance on tasks such as RS visual grounding (RSVG), RS visual question answering (RSVQA), and multimodal dialogue. However, hallucinations, which are responses inconsistent with the input RS images, severely hinder their deployment in high-stakes scenarios (e.g., emergency management and agricultural monitoring) and remain under-explored in RS. In this work, we present RSHallu, a systematic study with three deliverables: (1) we formalize RS hallucinations with an RS-oriented taxonomy and introduce image-level hallucination to capture RS-specific inconsistencies beyond object-centric errors (e.g., modality, resolution, and scene-level semantics); (2) we build a hallucination benchmark RSHalluEval (2,023 QA pairs) and enable dual-mode checking, supporting high-precision cloud auditing and low-cost reproducible local checking via a compact checker fine-tuned on RSHalluCheck dataset (15,396 QA pairs); and (3) we introduce a domain-tailored dataset RSHalluShield (30k QA pairs) for training-friendly mitigation and further propose training-free plug-and-play strategies, including decoding-time logit correction and RS-aware prompting. Across representative RS-MLLMs, our mitigation improves the hallucination-free rate by up to 21.63 percentage points under a unified protocol, while maintaining competitive performance on downstream RS tasks (RSVQA/RSVG). Code and datasets will be released.