AugVLA-3D: Depth-Driven Feature Augmentation for Vision-Language-Action Models

作者: Zhifeng Rao, Wenlong Chen, Lei Xie, Xia Hua, Dongfu Yin, Zhen Tian, F. Richard Yu

分类: cs.CV, cs.AI

发布日期: 2026-02-11

💡 一句话要点

AugVLA-3D:基于深度驱动特征增强的视觉-语言-动作模型

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言动作模型 深度估计 3D感知 机器人控制 特征增强

📋 核心要点

- 现有VLA模型依赖2D图像训练的VLM,缺乏对复杂3D环境的空间理解和动作定位能力。

- 提出AugVLA-3D框架,通过深度估计提取几何感知的3D线索,并利用动作先验约束3D表示。

- 实验结果表明,该方法增强了几何模糊场景中的感知,并提高了动作预测的准确性,提升了VLA模型的泛化性和鲁棒性。

📝 摘要(中文)

视觉-语言-动作(VLA)模型在机器人感知和控制方面取得了显著进展,但现有方法主要依赖于使用2D图像训练的VLM,限制了其在复杂3D环境中的空间理解和动作定位。为了解决这一局限性,我们提出了一个新框架,将深度估计集成到VLA模型中,以丰富3D特征表示。具体来说,我们采用名为VGGT的深度估计基线,从标准RGB输入中提取几何感知的3D线索,从而有效利用现有的大规模2D数据集,同时隐式地恢复3D结构信息。为了进一步提高这些深度衍生特征的可靠性,我们引入了一个名为动作助手的模块,该模块使用动作先验来约束学习到的3D表示,并确保其与下游控制任务的一致性。通过将增强的3D特征与传统的2D视觉tokens融合,我们的方法显著提高了VLA模型的泛化能力和鲁棒性。实验结果表明,该方法不仅加强了几何模糊场景中的感知,而且提高了动作预测的准确性。这项工作突出了深度驱动的数据增强和辅助专家监督在弥合机器人系统中2D观察和3D感知决策之间差距的潜力。

🔬 方法详解

问题定义:现有视觉-语言-动作(VLA)模型主要依赖于2D图像训练的视觉语言模型(VLM),这限制了它们在复杂3D环境中理解空间关系和精确定位动作的能力。痛点在于缺乏有效的3D信息利用,导致模型在几何结构复杂的场景中表现不佳。

核心思路:该论文的核心思路是通过引入深度估计来增强VLA模型对3D环境的感知能力。通过从RGB图像中估计深度信息,可以有效地恢复场景的3D结构,从而为VLA模型提供更丰富的空间信息。此外,利用动作先验知识来约束深度估计的结果,可以提高深度信息的可靠性和与下游控制任务的一致性。

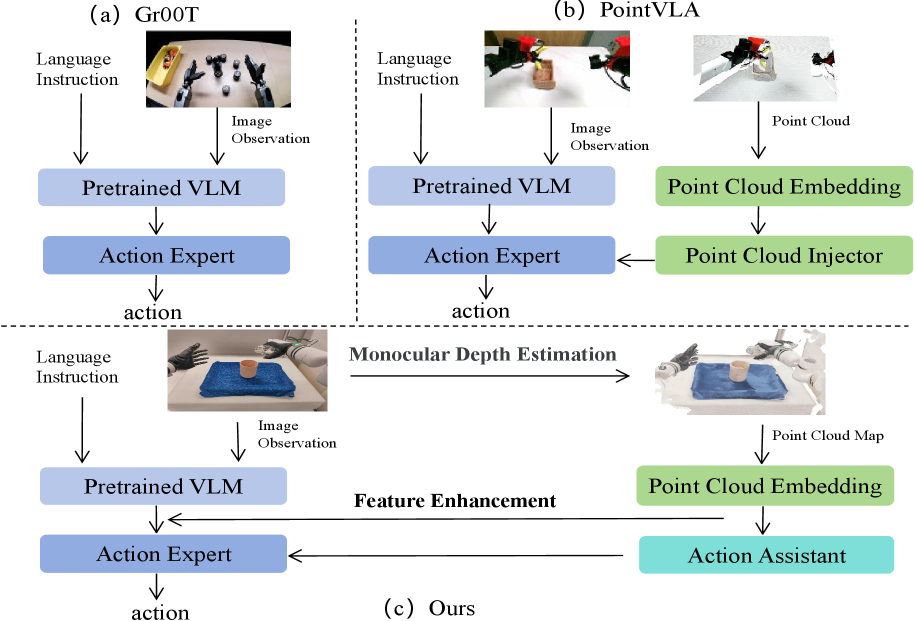

技术框架:AugVLA-3D框架主要包含以下几个模块:1) 深度估计模块:使用VGGT深度估计模型从RGB图像中提取深度信息。2) 特征增强模块:将深度信息与原始的2D视觉特征融合,形成增强的3D特征表示。3) 动作助手模块:利用动作先验知识来约束学习到的3D表示,确保其与下游控制任务的一致性。4) VLA模型:将增强的3D特征输入到VLA模型中,进行动作预测和控制。整体流程是从RGB图像开始,经过深度估计、特征增强和动作约束,最终输入到VLA模型中进行决策。

关键创新:该论文的关键创新在于将深度估计和动作先验知识有效地融入到VLA模型中。与直接使用3D数据训练VLA模型相比,该方法可以利用现有的大规模2D数据集,同时隐式地恢复3D结构信息。此外,动作助手模块的设计能够提高深度信息的可靠性和与下游控制任务的相关性,从而提升VLA模型的性能。

关键设计:深度估计模块采用VGGT模型,该模型是一个预训练的深度估计基线。特征融合的方式是将深度信息与2D视觉特征进行拼接或加权融合。动作助手模块的具体实现方式未知,可能涉及到设计特定的损失函数来约束3D表示与动作先验的一致性。VLA模型的具体结构也未知,但可以采用现有的VLA模型架构,如Transformer或LSTM等。

🖼️ 关键图片

📊 实验亮点

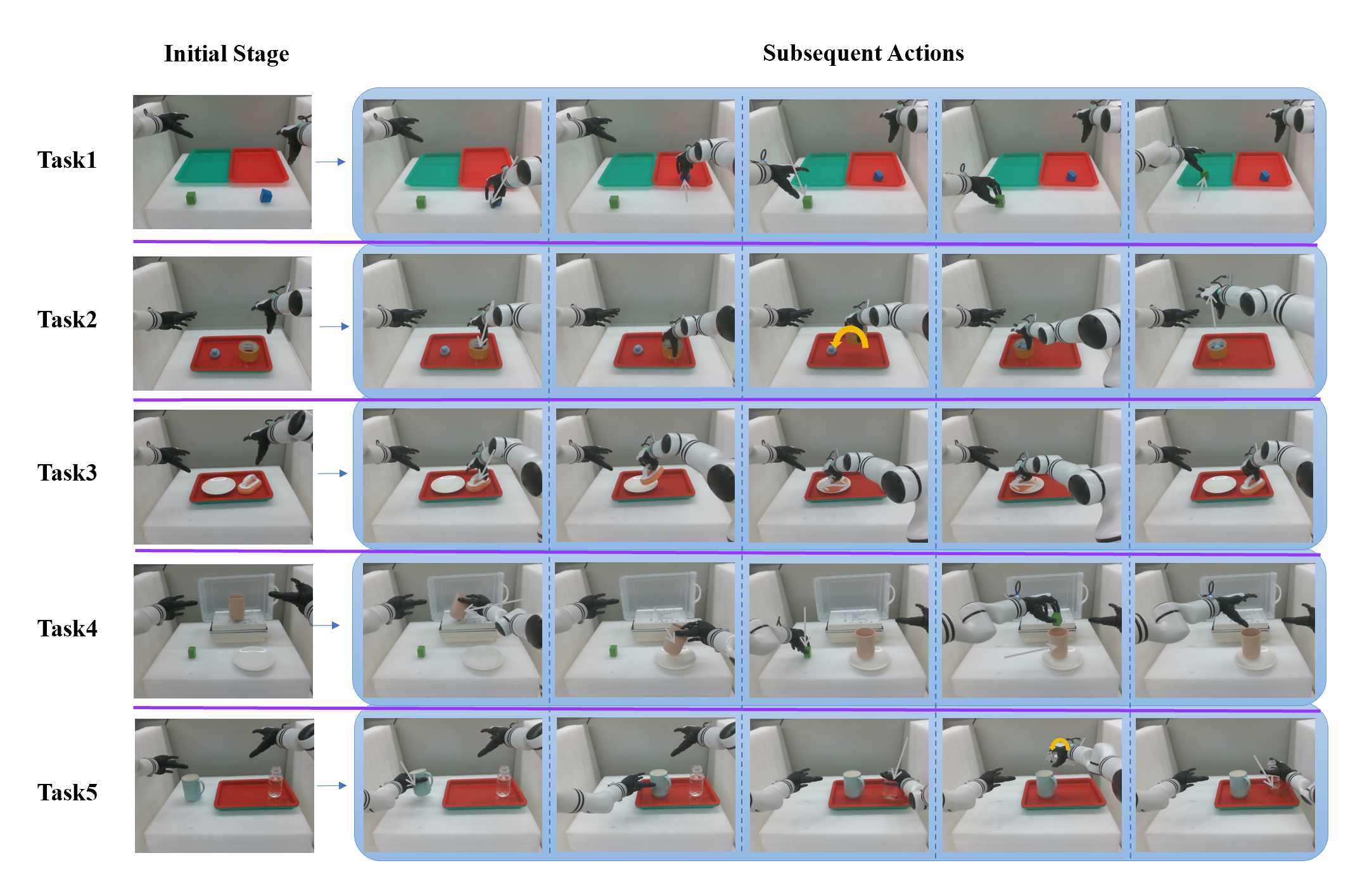

论文实验结果表明,AugVLA-3D方法在几何模糊场景中显著提升了感知能力,并提高了动作预测的准确性。具体性能提升数据未知,但强调了该方法在泛化性和鲁棒性方面的优势。通过与现有VLA模型进行对比,验证了深度驱动特征增强和动作先验约束的有效性。

🎯 应用场景

该研究成果可应用于机器人导航、操作和人机交互等领域。通过增强机器人对3D环境的感知能力,可以提高其在复杂环境中的自主性和适应性。例如,机器人可以在未知环境中进行物体识别、抓取和放置,或者在人机协作场景中更好地理解人类的意图和动作。

📄 摘要(原文)

Vision-Language-Action (VLA) models have recently achieved remarkable progress in robotic perception and control, yet most existing approaches primarily rely on VLM trained using 2D images, which limits their spatial understanding and action grounding in complex 3D environments. To address this limitation, we propose a novel framework that integrates depth estimation into VLA models to enrich 3D feature representations. Specifically, we employ a depth estimation baseline called VGGT to extract geometry-aware 3D cues from standard RGB inputs, enabling efficient utilization of existing large-scale 2D datasets while implicitly recovering 3D structural information. To further enhance the reliability of these depth-derived features, we introduce a new module called action assistant, which constrains the learned 3D representations with action priors and ensures their consistency with downstream control tasks. By fusing the enhanced 3D features with conventional 2D visual tokens, our approach significantly improves the generalization ability and robustness of VLA models. Experimental results demonstrate that the proposed method not only strengthens perception in geometrically ambiguous scenarios but also leads to superior action prediction accuracy. This work highlights the potential of depth-driven data augmentation and auxiliary expert supervision for bridging the gap between 2D observations and 3D-aware decision-making in robotic systems.