TwiFF (Think With Future Frames): A Large-Scale Dataset for Dynamic Visual Reasoning

作者: Junhua Liu, Zhangcheng Wang, Zhike Han, Ningli Wang, Guotao Liang, Kun Kuang

分类: cs.CV, cs.AI

发布日期: 2026-02-11

备注: preprint

🔗 代码/项目: GITHUB

💡 一句话要点

提出TwiFF,用于动态视觉推理的大规模数据集与模型

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 动态视觉推理 视觉问答 视频生成 时间建模 多模态学习

📋 核心要点

- 现有VCoT方法主要局限于静态场景,难以捕捉指令、预测和相机运动等任务所需的时间动态性。

- TwiFF模型通过协同利用预训练的视频生成和图像理解能力,生成时间连贯的视觉推理线索,解决动态视觉推理问题。

- 实验结果表明,TwiFF在动态推理任务上显著优于现有方法,验证了其在动态场景视觉问答中的有效性。

📝 摘要(中文)

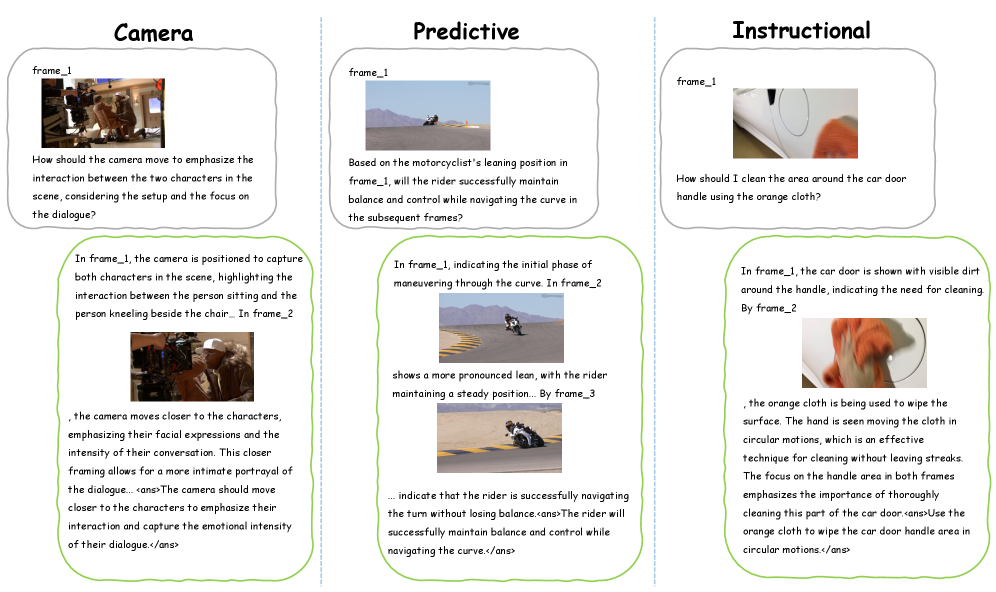

本文提出了TwiFF-2.7M,这是一个大规模的、时序相关的视觉常识推理数据集,包含270万个视频片段,专为动态视觉问答设计。同时,作者构建了TwiFF-Bench,一个高质量的评估基准,包含1078个样本,用于评估开放域动态场景中推理轨迹的合理性和最终答案的正确性。在此基础上,作者提出了TwiFF模型,该模型统一利用预训练的视频生成和图像理解能力,迭代地生成未来动作帧和文本推理,从而产生时间上连贯的视觉推理线索。大量实验表明,TwiFF在动态推理任务上显著优于现有的VCoT方法和文本CoT基线,充分验证了其在动态场景视觉问答中的有效性。代码和数据已开源。

🔬 方法详解

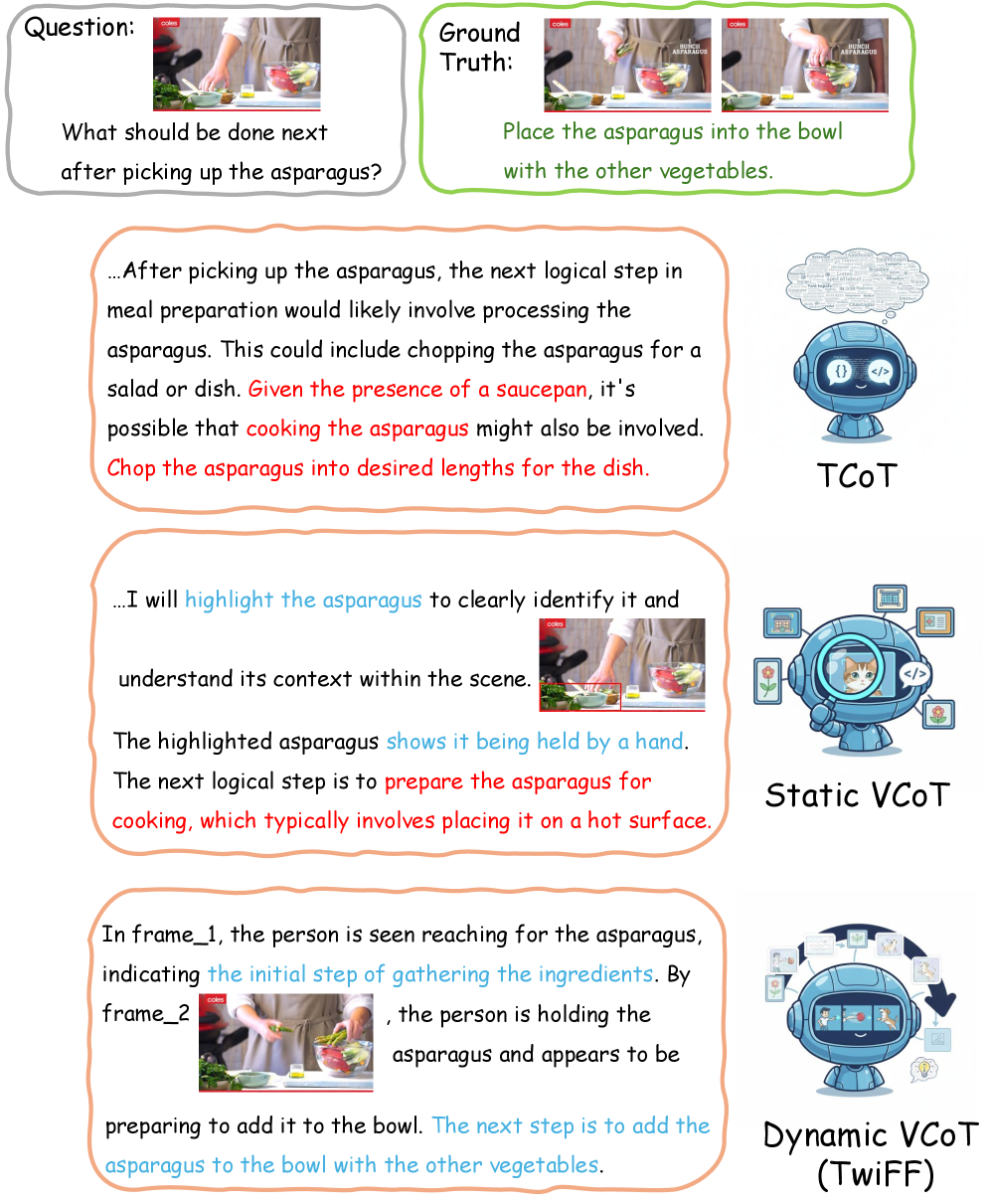

问题定义:论文旨在解决动态视觉推理问题,即在视频场景中进行视觉问答,需要理解时间上的变化和动作。现有VCoT方法主要针对静态图像,无法有效处理视频中的时间依赖关系,导致在动态场景下的推理性能下降。

核心思路:论文的核心思路是利用预训练的视频生成模型来预测未来帧,从而为视觉推理提供时间上的上下文信息。通过迭代地生成未来帧和进行文本推理,模型能够逐步理解场景的动态变化,并最终给出正确的答案。这种方法模拟了人类的思考过程,即通过想象未来可能发生的事情来辅助决策。

技术框架:TwiFF模型包含两个主要模块:视频生成模块和图像理解模块。视频生成模块负责根据当前帧和文本提示生成未来帧,图像理解模块负责理解当前帧和未来帧的内容,并进行文本推理。整个流程是迭代的,即模型会不断生成新的未来帧,并根据这些帧进行推理,直到得到最终答案。

关键创新:最重要的技术创新点在于将视频生成能力融入到视觉推理过程中。通过生成未来帧,模型能够显式地模拟场景的动态变化,从而更好地理解视频内容。与现有方法相比,TwiFF模型能够更好地捕捉时间依赖关系,从而在动态场景下取得更好的性能。

关键设计:TwiFF模型使用了预训练的视频生成模型和图像理解模型。视频生成模型可以是任何能够生成高质量视频帧的模型,例如基于GAN或Transformer的模型。图像理解模型可以是任何能够理解图像内容的模型,例如ResNet或ViT。论文中没有明确指出具体的参数设置、损失函数和网络结构,这些细节可能需要参考相关的预训练模型。

🖼️ 关键图片

📊 实验亮点

实验结果表明,TwiFF模型在动态推理任务上显著优于现有的VCoT方法和文本CoT基线。具体来说,TwiFF模型在TwiFF-Bench数据集上取得了显著的性能提升,验证了其在动态场景视觉问答中的有效性。论文中没有给出具体的性能数据和提升幅度,需要在论文原文中查找。

🎯 应用场景

TwiFF模型可应用于机器人导航、自动驾驶、视频监控等领域。例如,机器人可以利用TwiFF模型预测未来可能出现的障碍物,从而规划更安全的路径。自动驾驶系统可以利用TwiFF模型预测其他车辆的行驶轨迹,从而做出更合理的决策。视频监控系统可以利用TwiFF模型识别异常行为,从而及时发出警报。该研究有助于提升人工智能系统在动态环境中的感知和决策能力。

📄 摘要(原文)

Visual Chain-of-Thought (VCoT) has emerged as a promising paradigm for enhancing multimodal reasoning by integrating visual perception into intermediate reasoning steps. However, existing VCoT approaches are largely confined to static scenarios and struggle to capture the temporal dynamics essential for tasks such as instruction, prediction, and camera motion. To bridge this gap, we propose TwiFF-2.7M, the first large-scale, temporally grounded VCoT dataset derived from $2.7$ million video clips, explicitly designed for dynamic visual question and answer. Accompanying this, we introduce TwiFF-Bench, a high-quality evaluation benchmark of $1,078$ samples that assesses both the plausibility of reasoning trajectories and the correctness of final answers in open-ended dynamic settings. Building on these foundations, we propose the TwiFF model, a unified modal that synergistically leverages pre-trained video generation and image comprehension capabilities to produce temporally coherent visual reasoning cues-iteratively generating future action frames and textual reasoning. Extensive experiments demonstrate that TwiFF significantly outperforms existing VCoT methods and Textual Chain-of-Thought baselines on dynamic reasoning tasks, which fully validates the effectiveness for visual question answering in dynamic scenarios. Our code and data is available at https://github.com/LiuJunhua02/TwiFF.