SAGE: Scalable Agentic 3D Scene Generation for Embodied AI

作者: Hongchi Xia, Xuan Li, Zhaoshuo Li, Qianli Ma, Jiashu Xu, Ming-Yu Liu, Yin Cui, Tsung-Yi Lin, Wei-Chiu Ma, Shenlong Wang, Shuran Song, Fangyin Wei

分类: cs.CV, cs.RO

发布日期: 2026-02-10

备注: Project Page: https://nvlabs.github.io/sage

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

SAGE:用于具身AI的可扩展Agentic 3D场景生成

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 具身智能 3D场景生成 Agentic框架 模拟训练 场景理解

📋 核心要点

- 现有场景生成系统依赖于基于规则或特定任务的流程,导致生成结果存在伪影和物理上无效的场景。

- SAGE框架通过agentic方式,结合生成器和评论器,迭代优化场景,确保语义合理性、视觉真实性和物理稳定性。

- 实验表明,在SAGE生成的数据上训练的策略具有良好的泛化能力,能够推广到未见过的物体和布局。

📝 摘要(中文)

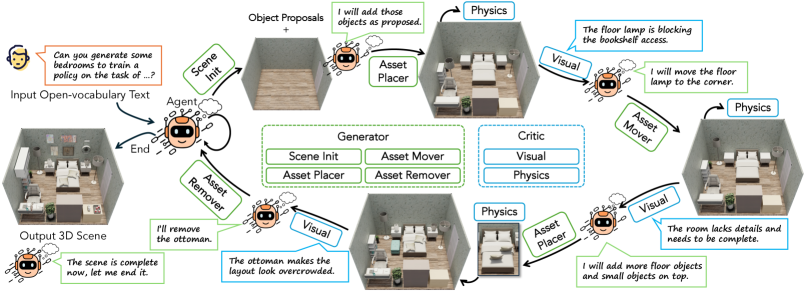

为解决具身智能体现实世界数据采集成本高昂且不安全的问题,本文提出SAGE,一个agentic框架,能够根据用户指定的具身任务(例如,“拿起碗并放在桌子上”)理解意图,并自动生成可扩展的、逼真的、可用于模拟器的3D环境。该智能体将布局和对象组合的多个生成器与评估语义合理性、视觉真实性和物理稳定性的评论器相结合。通过迭代推理和自适应工具选择,它可以自我完善场景,直到满足用户意图和物理有效性。生成的环境是逼真的、多样的,并且可以直接部署在现代模拟器中进行策略训练。纯粹在此数据上训练的策略表现出明显的扩展趋势,并泛化到未见过的对象和布局,证明了模拟驱动扩展对具身AI的潜力。代码、演示和SAGE-10k数据集可在项目页面找到。

🔬 方法详解

问题定义:论文旨在解决为具身智能体生成大规模、逼真且可用于模拟的3D环境的问题。现有方法通常依赖于规则或特定任务的流程,导致生成结果存在伪影,并且生成的场景在物理上可能无效,难以直接用于训练具身智能体的策略。

核心思路:论文的核心思路是采用agentic框架,通过智能体自主地进行场景生成和优化。该智能体结合了多个生成器和评论器,通过迭代推理和自适应工具选择,不断完善场景,直到满足用户意图和物理有效性。这种方法能够生成更加逼真、多样且物理上合理的3D环境。

技术框架:SAGE框架包含以下主要模块:1) 任务理解模块:理解用户指定的具身任务;2) 场景生成模块:包含布局生成器和对象组合生成器,用于生成初始场景;3) 场景评估模块:包含语义合理性评论器、视觉真实性评论器和物理稳定性评论器,用于评估场景的质量;4) 场景优化模块:根据评估结果,通过迭代推理和自适应工具选择,对场景进行优化。整个流程是一个迭代的过程,直到生成的场景满足用户意图和物理有效性。

关键创新:SAGE的关键创新在于其agentic框架,该框架能够自主地进行场景生成和优化,无需人工干预。通过结合生成器和评论器,SAGE能够生成更加逼真、多样且物理上合理的3D环境。此外,SAGE还采用了自适应工具选择机制,能够根据不同的场景选择合适的优化工具。

关键设计:SAGE的关键设计包括:1) 布局生成器:用于生成场景的布局,例如房间的形状和大小;2) 对象组合生成器:用于将对象放置在场景中,例如桌子、椅子和碗;3) 语义合理性评论器:用于评估场景中对象的语义合理性,例如碗是否应该放在桌子上;4) 视觉真实性评论器:用于评估场景的视觉真实性,例如光照和纹理是否逼真;5) 物理稳定性评论器:用于评估场景的物理稳定性,例如对象是否会掉落。这些模块共同作用,确保生成的场景是逼真的、多样的且物理上合理的。

🖼️ 关键图片

📊 实验亮点

在SAGE生成的数据上训练的策略表现出明显的扩展趋势,并且能够泛化到未见过的对象和布局。这表明SAGE生成的环境具有良好的真实性和多样性,能够有效地用于训练具身智能体的策略。实验结果证明了模拟驱动扩展对具身AI的潜力。

🎯 应用场景

SAGE生成的3D环境可用于训练具身智能体的策略,例如导航、操作和交互。这些策略可以应用于各种实际场景,例如家庭机器人、仓库自动化和虚拟现实。SAGE的出现降低了具身智能体数据采集的成本,加速了具身智能体技术的发展。

📄 摘要(原文)

Real-world data collection for embodied agents remains costly and unsafe, calling for scalable, realistic, and simulator-ready 3D environments. However, existing scene-generation systems often rely on rule-based or task-specific pipelines, yielding artifacts and physically invalid scenes. We present SAGE, an agentic framework that, given a user-specified embodied task (e.g., "pick up a bowl and place it on the table"), understands the intent and automatically generates simulation-ready environments at scale. The agent couples multiple generators for layout and object composition with critics that evaluate semantic plausibility, visual realism, and physical stability. Through iterative reasoning and adaptive tool selection, it self-refines the scenes until meeting user intent and physical validity. The resulting environments are realistic, diverse, and directly deployable in modern simulators for policy training. Policies trained purely on this data exhibit clear scaling trends and generalize to unseen objects and layouts, demonstrating the promise of simulation-driven scaling for embodied AI. Code, demos, and the SAGE-10k dataset can be found on the project page here: https://nvlabs.github.io/sage.