Faster-GS: Analyzing and Improving Gaussian Splatting Optimization

作者: Florian Hahlbohm, Linus Franke, Martin Eisemann, Marcus Magnor

分类: cs.CV, cs.GR

发布日期: 2026-02-10

备注: Project page: https://fhahlbohm.github.io/faster-gaussian-splatting

💡 一句话要点

Faster-GS:通过分析与改进高斯溅射优化,实现更快的训练速度和高质量重建

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 三维高斯溅射 3DGS 优化算法 三维重建 实时渲染

📋 核心要点

- 现有3DGS方法在加速优化时,常将实现细节与算法修改混淆,或牺牲性能换取质量,缺乏统一的评估标准。

- Faster-GS通过整合现有最佳策略,并引入数值稳定性、高斯截断和梯度近似等优化,提升训练效率。

- 实验表明,Faster-GS在保持视觉质量的同时,训练速度提升高达5倍,并可应用于四维高斯重建。

📝 摘要(中文)

近来,三维高斯溅射(3DGS)的研究重点在于加速优化过程,同时保持重建质量。然而,许多已提出的方法将实现层面的改进与基础算法的修改混淆,或者以性能换取保真度,导致研究领域分散,难以进行公平比较。本文整合并评估了先前3DGS研究中最有效和广泛适用的策略,并在此基础上增加了一些新的优化方法。此外,我们还研究了该框架中未被充分探索的方面,包括数值稳定性、高斯截断和梯度近似。由此产生的系统Faster-GS提供了一种经过严格优化的算法,我们在全面的基准测试套件中对其进行了评估。实验表明,Faster-GS在保持视觉质量的同时,实现了高达5倍的训练速度提升,为3DGS优化建立了一个新的经济高效且资源高效的基线。此外,我们证明了这些优化可以应用于四维高斯重建,从而实现高效的非刚性场景优化。

🔬 方法详解

问题定义:现有3D高斯溅射(3DGS)方法在优化速度和重建质量之间存在trade-off,并且缺乏统一的评估标准。许多改进方案将底层实现细节与算法创新耦合,使得不同方法难以公平比较,阻碍了该领域的发展。此外,数值稳定性、高斯截断和梯度近似等关键因素在现有研究中未得到充分重视。

核心思路:Faster-GS的核心思路是系统性地分析和改进3DGS的优化过程,通过整合现有最有效的策略,并引入新的优化方法,在保证重建质量的前提下,显著提升训练速度。该方法旨在建立一个经济高效且资源高效的3DGS优化基线,并为未来的研究提供参考。

技术框架:Faster-GS的整体框架基于标准的3DGS流程,主要包括以下几个阶段:1) 初始化:使用点云或深度图初始化3D高斯分布。2) 渲染:将3D高斯分布投影到2D图像平面,并进行可微渲染。3) 优化:基于渲染图像与目标图像之间的差异,更新3D高斯分布的参数。Faster-GS在优化阶段引入了多种优化策略,包括数值稳定性处理、高斯截断和梯度近似。

关键创新:Faster-GS的关键创新在于对3DGS优化过程的系统性分析和改进。它不仅整合了现有最有效的策略,还引入了新的优化方法,例如:1) 数值稳定性处理:通过引入小的扰动,避免梯度爆炸或消失。2) 高斯截断:通过移除不重要的高斯分布,减少计算量。3) 梯度近似:通过使用更高效的梯度计算方法,加速优化过程。

关键设计:Faster-GS的关键设计包括:1) 自适应学习率调整:根据高斯分布的参数变化动态调整学习率。2) 基于方差的高斯截断:根据高斯分布的方差大小,移除不重要的高斯分布。3) 基于梯度的梯度近似:使用更高效的梯度计算方法,例如AdamW优化器。

🖼️ 关键图片

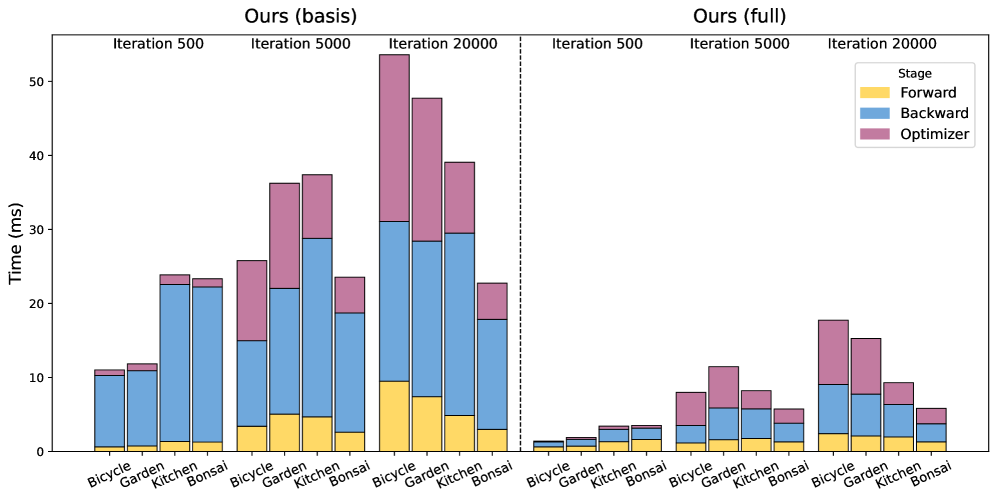

📊 实验亮点

Faster-GS在多个基准数据集上进行了评估,实验结果表明,Faster-GS在保持视觉质量的同时,实现了高达5倍的训练速度提升。与现有最先进的方法相比,Faster-GS在训练时间和资源消耗方面具有显著优势,为3DGS优化建立了一个新的基线。

🎯 应用场景

Faster-GS可广泛应用于三维重建、虚拟现实、增强现实、自动驾驶等领域。其高效的优化能力使得大规模场景的重建和渲染成为可能,并降低了对计算资源的需求。该研究为实时三维重建和动态场景建模提供了新的解决方案,具有重要的实际应用价值和广阔的未来发展前景。

📄 摘要(原文)

Recent advances in 3D Gaussian Splatting (3DGS) have focused on accelerating optimization while preserving reconstruction quality. However, many proposed methods entangle implementation-level improvements with fundamental algorithmic modifications or trade performance for fidelity, leading to a fragmented research landscape that complicates fair comparison. In this work, we consolidate and evaluate the most effective and broadly applicable strategies from prior 3DGS research and augment them with several novel optimizations. We further investigate underexplored aspects of the framework, including numerical stability, Gaussian truncation, and gradient approximation. The resulting system, Faster-GS, provides a rigorously optimized algorithm that we evaluate across a comprehensive suite of benchmarks. Our experiments demonstrate that Faster-GS achieves up to 5$\times$ faster training while maintaining visual quality, establishing a new cost-effective and resource efficient baseline for 3DGS optimization. Furthermore, we demonstrate that optimizations can be applied to 4D Gaussian reconstruction, leading to efficient non-rigid scene optimization.