Learning to Detect Baked Goods with Limited Supervision

作者: Thomas H. Schmitt, Maximilian Bundscherer, Tobias Bocklet

分类: cs.CV

发布日期: 2026-02-10

💡 一句话要点

提出基于有限监督的目标检测方法,用于识别烘焙产品以优化生产。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 目标检测 弱监督学习 伪标签 烘焙食品识别 YOLOv11

📋 核心要点

- 现有开放词汇检测器在识别多样化的烘焙食品方面表现不足,且完全监督训练成本高昂,限制了在专业化任务和数据稀缺行业中的应用。

- 结合 OWL-v2/Grounding DINO 定位与图像级监督进行弱监督训练,并利用 Segment Anything 2 进行伪标签传播,提升视点鲁棒性。

- 实验表明,仅使用图像级监督的模型 mAP 达到 0.91,在非理想条件下,伪标签微调使性能提升 19.3%,超过了完全监督基线。

📝 摘要(中文)

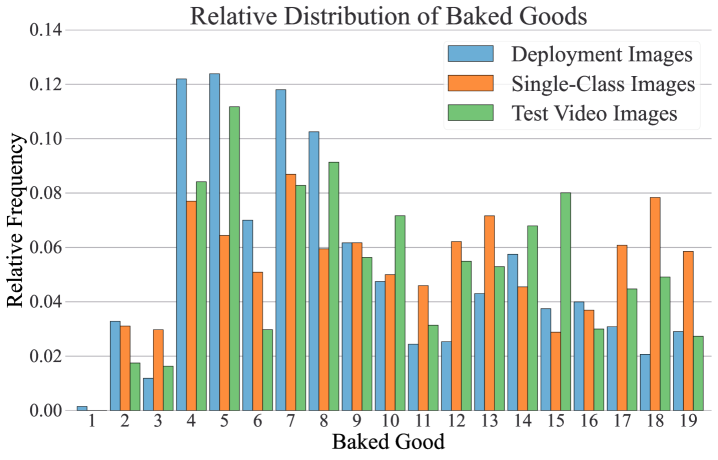

监控剩余产品能为优化未来生产提供有价值的见解。这对德国面包店尤为重要,因为新鲜烘焙食品的保质期很短。自动化此过程可以降低劳动力成本、提高准确性并简化运营。本文提出使用目标检测模型从图像中识别烘焙食品来自动化此过程。然而,德国烘焙食品的多样性使得完全监督的训练成本过高并限制了可扩展性。尽管开放词汇检测器(例如,OWLv2,Grounding DINO)提供了灵活性,但我们证明它们不足以完成我们的任务。虽然受到面包店的启发,但我们的工作解决了在行业中部署计算机视觉的更广泛挑战,在这些行业中,任务是专门的并且带注释的数据集很少。我们编译了具有不同监督级别的数据集拆分,涵盖 19 类烘焙食品。我们提出了两种训练工作流程,以在有限的监督下训练目标检测模型。首先,我们将 OWLv2 和 Grounding DINO 定位与图像级监督相结合,以弱监督方式训练模型。其次,我们通过使用 Segment Anything 2 作为伪标签传播模型,在带注释的视频帧上进行微调来提高视点鲁棒性。由于 YOLOv11 在速度和准确性之间具有良好的权衡,我们使用这些工作流程为我们的检测任务训练 YOLOv11。仅依靠图像级监督,该模型实现了 0.91 的平均精度均值 (mAP)。在非理想部署条件下,使用伪标签进行微调可将模型性能提高 19.3%。结合这些工作流程训练的模型在非理想部署条件下超过了我们的完全监督基线模型,尽管仅依赖于图像级监督。

🔬 方法详解

问题定义:论文旨在解决在有限监督条件下,如何准确检测图像中的烘焙食品这一问题。现有方法,如完全监督学习,需要大量标注数据,成本高昂且难以扩展。开放词汇检测器虽然灵活,但在特定领域(如烘焙食品)的检测精度不足。因此,如何在数据稀缺的情况下,训练出高性能的烘焙食品检测器是本研究的核心问题。

核心思路:论文的核心思路是利用弱监督学习和伪标签技术,在仅有图像级别标注的情况下,训练出具有竞争力的目标检测模型。通过结合开放词汇检测器的定位能力和图像级监督信息,初步训练模型,然后利用伪标签传播技术,提高模型在不同视角下的鲁棒性。

技术框架:整体框架包含两个主要阶段:1) 弱监督训练阶段:利用 OWL-v2 和 Grounding DINO 等开放词汇检测器生成候选框,并结合图像级别的标签信息,训练 YOLOv11 模型。2) 伪标签微调阶段:使用 Segment Anything 2 (SAM) 对视频帧进行分割,生成伪标签,并利用这些伪标签对 YOLOv11 模型进行微调,以提高模型的视点鲁棒性。

关键创新:论文的关键创新在于结合了弱监督学习和伪标签技术,提出了一种在有限监督条件下训练目标检测模型的新方法。该方法无需大量的像素级别标注,仅依赖图像级别标注和少量视频数据,即可训练出高性能的烘焙食品检测器。此外,利用 SAM 进行伪标签传播,有效提高了模型在不同视角下的鲁棒性。

关键设计:论文选择了 YOLOv11 作为基础检测器,因为它在速度和精度之间具有良好的平衡。在弱监督训练阶段,使用了交叉熵损失函数来约束图像级别的分类结果。在伪标签微调阶段,使用了 Smooth L1 损失函数来优化边界框的回归。此外,论文还探索了不同的数据增强策略,以提高模型的泛化能力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,仅使用图像级监督,模型即可达到 0.91 的 mAP。在非理想部署条件下,通过使用 SAM 生成的伪标签进行微调,模型性能提升了 19.3%,甚至超过了完全监督的基线模型。这表明该方法在有限监督条件下具有很强的竞争力,能够有效提高目标检测的性能。

🎯 应用场景

该研究成果可应用于自动化烘焙产品监控系统,帮助面包店优化生产计划、减少浪费、降低人工成本。此外,该方法也适用于其他领域,例如商品零售、库存管理等,在这些领域中,数据标注成本高昂,需要利用有限的监督信息来训练目标检测模型。该研究为在数据稀缺场景下部署计算机视觉系统提供了新的思路。

📄 摘要(原文)

Monitoring leftover products provides valuable insights that can be used to optimize future production. This is especially important for German bakeries because freshly baked goods have a very short shelf life. Automating this process can reduce labor costs, improve accuracy, and streamline operations. We propose automating this process using an object detection model to identify baked goods from images. However, the large diversity of German baked goods makes fully supervised training prohibitively expensive and limits scalability. Although open-vocabulary detectors (e.g., OWLv2, Grounding DINO) offer lexibility, we demonstrate that they are insufficient for our task. While motivated by bakeries, our work addresses the broader challenges of deploying computer vision in industries, where tasks are specialized and annotated datasets are scarce. We compile dataset splits with varying supervision levels, covering 19 classes of baked goods. We propose two training workflows to train an object detection model with limited supervision. First, we combine OWLv2 and Grounding DINO localization with image-level supervision to train the model in a weakly supervised manner. Second, we improve viewpoint robustness by fine-tuning on video frames annotated using Segment Anything 2 as a pseudo-label propagation model. Using these workflows, we train YOLOv11 for our detection task due to its favorable speed accuracy tradeoff. Relying solely on image-level supervision, the model achieves a mean Average Precision (mAP) of 0.91. Finetuning with pseudo-labels raises model performance by 19.3% under non-ideal deployment conditions. Combining these workflows trains a model that surpasses our fully-supervised baseline model under non-ideal deployment conditions, despite relying only on image-level supervision.