CompSplat: Compression-aware 3D Gaussian Splatting for Real-world Video

作者: Hojun Song, Heejung Choi, Aro Kim, Chae-yeong Song, Gahyeon Kim, Soo Ye Kim, Jaehyup Lee, Sang-hyo Park

分类: cs.CV

发布日期: 2026-02-10

备注: Preprint. Under review

💡 一句话要点

提出CompSplat,解决真实世界视频压缩感知的3D高斯溅射问题

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱七:动作重定向 (Motion Retargeting)

关键词: 3D高斯溅射 新视角合成 视频压缩感知 长视频序列 几何重建

📋 核心要点

- 现有方法在处理真实世界长视频时,由于压缩引入的不一致性,导致新视角合成中出现姿态漂移和几何失真。

- CompSplat通过显式建模帧级压缩特性,并结合压缩感知帧权重和自适应剪枝策略,来减轻帧间不一致性和累积误差。

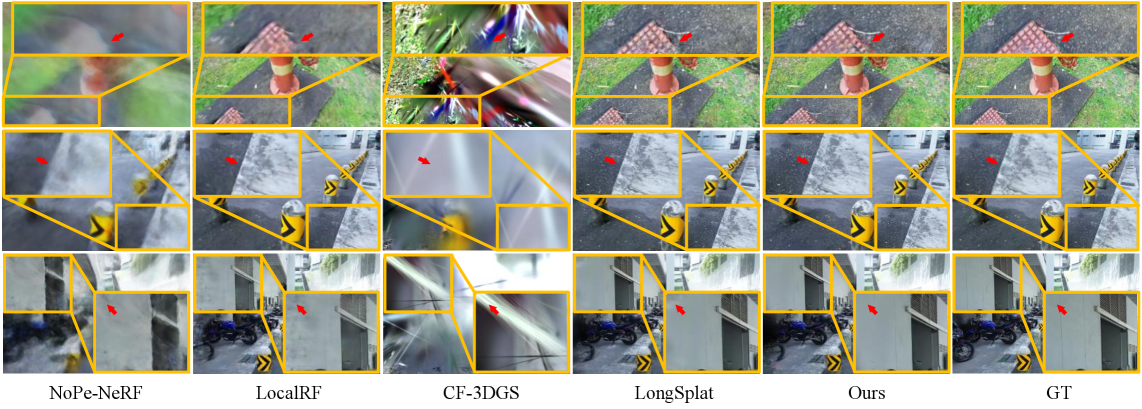

- 实验结果表明,CompSplat在严重压缩条件下,在渲染质量和姿态精度方面均优于现有方法,达到SOTA水平。

📝 摘要(中文)

高质量的真实世界视频新视角合成(NVS)对于文化遗产保护、数字孪生和沉浸式媒体等应用至关重要。然而,真实世界视频通常包含具有不规则相机轨迹和未知姿态的长序列,导致重建过程中出现姿态漂移、特征错位和几何失真。此外,有损压缩通过引入不一致性来加剧这些问题,逐渐降低几何和渲染质量。虽然最近的研究已经解决了长序列NVS或无姿态重建问题,但压缩感知方法仍然侧重于特定伪影或有限场景,对长视频中不同的压缩模式探索不足。在本文中,我们提出了CompSplat,一种压缩感知训练框架,它显式地建模逐帧压缩特性,以减轻帧间不一致性和累积的几何误差。CompSplat结合了压缩感知帧权重和自适应剪枝策略,以增强鲁棒性和几何一致性,尤其是在重压缩条件下。在具有挑战性的基准测试(包括Tanks and Temples、Free和Hike)上进行的大量实验表明,CompSplat实现了最先进的渲染质量和姿态精度,在严重的压缩条件下显著优于大多数最新的NVS方法。

🔬 方法详解

问题定义:论文旨在解决真实世界视频在经过有损压缩后,进行新视角合成时出现的几何失真和渲染质量下降问题。现有方法在处理长视频序列时,由于相机姿态估计的漂移和压缩引入的帧间不一致性,导致重建的3D模型质量不高,尤其是在高压缩比下,问题更加严重。

核心思路:CompSplat的核心思路是显式地建模视频压缩过程中的帧级压缩特性,从而在训练过程中考虑到压缩带来的影响。通过对不同压缩程度的帧赋予不同的权重,并采用自适应剪枝策略,来提高模型对压缩噪声的鲁棒性,并保持几何一致性。

技术框架:CompSplat的整体框架包括以下几个主要步骤:1) 使用带有压缩信息的视频帧进行训练;2) 引入压缩感知的帧权重,对不同压缩程度的帧赋予不同的权重;3) 使用自适应剪枝策略,去除对重建贡献较小的3D高斯粒子;4) 利用训练好的3D高斯模型进行新视角渲染。

关键创新:CompSplat的关键创新在于其压缩感知的训练方法,它显式地将视频压缩的特性纳入到3D高斯溅射的训练过程中。与以往忽略压缩影响的方法不同,CompSplat通过帧权重和自适应剪枝,有效地减轻了压缩噪声对重建质量的影响。

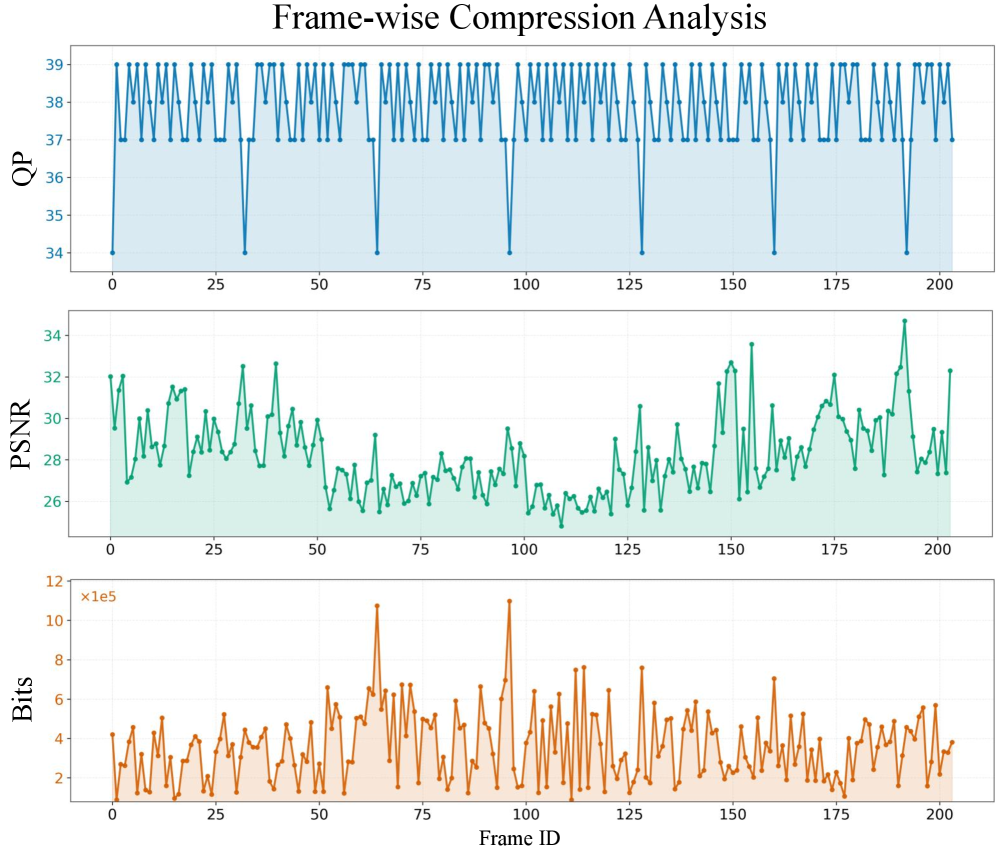

关键设计:CompSplat的关键设计包括:1) 压缩感知帧权重:根据帧的压缩程度(例如量化参数QP)来确定帧的权重,压缩越严重的帧权重越低;2) 自适应剪枝策略:根据3D高斯粒子的不透明度和梯度等指标,动态地去除对重建贡献较小的粒子,从而提高模型的效率和鲁棒性;3) 损失函数:除了标准的渲染损失外,可能还引入了正则化项,以约束3D高斯粒子的分布,提高几何一致性(具体细节未知)。

🖼️ 关键图片

📊 实验亮点

CompSplat在Tanks and Temples、Free和Hike等具有挑战性的数据集上进行了实验,结果表明,在严重的压缩条件下,CompSplat在渲染质量和姿态精度方面均显著优于现有的新视角合成方法。具体性能提升数据未知,但论文强调了其在压缩条件下的优越性。

🎯 应用场景

CompSplat在文化遗产数字化保护、数字孪生、沉浸式媒体、虚拟现实/增强现实等领域具有广泛的应用前景。通过提高压缩视频的新视角合成质量,可以降低存储和传输成本,同时保证用户体验。该技术还有助于从低质量或压缩过的视频中恢复出高质量的3D场景模型。

📄 摘要(原文)

High-quality novel view synthesis (NVS) from real-world videos is crucial for applications such as cultural heritage preservation, digital twins, and immersive media. However, real-world videos typically contain long sequences with irregular camera trajectories and unknown poses, leading to pose drift, feature misalignment, and geometric distortion during reconstruction. Moreover, lossy compression amplifies these issues by introducing inconsistencies that gradually degrade geometry and rendering quality. While recent studies have addressed either long-sequence NVS or unposed reconstruction, compression-aware approaches still focus on specific artifacts or limited scenarios, leaving diverse compression patterns in long videos insufficiently explored. In this paper, we propose CompSplat, a compression-aware training framework that explicitly models frame-wise compression characteristics to mitigate inter-frame inconsistency and accumulated geometric errors. CompSplat incorporates compression-aware frame weighting and an adaptive pruning strategy to enhance robustness and geometric consistency, particularly under heavy compression. Extensive experiments on challenging benchmarks, including Tanks and Temples, Free, and Hike, demonstrate that CompSplat achieves state-of-the-art rendering quality and pose accuracy, significantly surpassing most recent state-of-the-art NVS approaches under severe compression conditions.