Time2General: Learning Spatiotemporal Invariant Representations for Domain-Generalization Video Semantic Segmentation

作者: Siyu Chen, Ting Han, Haoling Huang, Chaolei Wang, Chengzheng Fu, Duxin Zhu, Guorong Cai, Jinhe Su

分类: cs.CV

发布日期: 2026-02-10

💡 一句话要点

提出Time2General框架,学习时空不变表征,解决域泛化视频语义分割问题。

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 域泛化 视频语义分割 时空记忆 时间一致性 深度学习

📋 核心要点

- 现有DGVSS方法在领域和时间采样偏移下,依赖对应关系传播和固定步幅聚合,导致帧间闪烁。

- Time2General通过时空记忆解码器聚合多帧上下文,生成时间一致的掩码,无需显式对应关系传播。

- 掩码时间一致性损失和随机训练步幅,增强模型对不同采样率的鲁棒性,显著提升跨域准确性和时间稳定性。

📝 摘要(中文)

域泛化视频语义分割(DGVSS)旨在仅使用单个带标签的驾驶领域数据进行训练,并直接部署到未见过的领域,无需目标标签和测试时自适应,同时保持视频流中时间上一致的预测。 实际上,领域偏移和时间采样偏移都会破坏基于对应关系的传播和固定步幅的时间聚合,即使在标签稳定的区域也会导致严重的帧间闪烁。 我们提出了Time2General,这是一个基于稳定性查询的DGVSS框架。 Time2General引入了一个时空记忆解码器,该解码器将多帧上下文聚合到剪辑级别的时空记忆中,并解码时间上一致的每帧掩码,而无需显式的对应关系传播。 为了进一步抑制闪烁并提高对不同采样率的鲁棒性,提出了掩码时间一致性损失,以规范不同步幅之间的时间预测差异,并随机化训练步幅以使模型暴露于不同的时间间隔。 在多个驾驶基准上的大量实验表明,Time2General在跨域准确性和时间稳定性方面均优于先前的DGSS和VSS基线,同时运行速度高达18 FPS。 代码将在审核过程后发布。

🔬 方法详解

问题定义:论文旨在解决域泛化视频语义分割(DGVSS)问题,即在单个源域上训练的模型,需要在未见过的目标域上进行视频语义分割,同时保持时间上的一致性。现有方法在面对领域偏移和时间采样偏移时,由于依赖帧间对应关系传播和固定步幅的时间聚合,容易产生帧间闪烁,导致分割结果不稳定。

核心思路:论文的核心思路是学习时空不变的表征,从而使模型能够更好地泛化到新的领域,并对不同的时间采样率具有鲁棒性。通过引入时空记忆解码器,将多帧上下文信息聚合到剪辑级别的时空记忆中,从而避免了显式的帧间对应关系传播,减少了闪烁现象。

技术框架:Time2General框架主要包含以下几个模块:1) 特征提取器:用于提取每帧图像的特征;2) 时空记忆解码器:将多帧特征聚合到时空记忆中,并解码出每帧的语义分割掩码;3) 掩码时间一致性损失:用于约束不同时间步长下的预测结果的一致性。整体流程是,首先提取视频帧的特征,然后通过时空记忆解码器生成分割掩码,最后使用掩码时间一致性损失进行训练。

关键创新:论文的关键创新在于提出了时空记忆解码器和掩码时间一致性损失。时空记忆解码器能够有效地聚合多帧上下文信息,避免了显式的帧间对应关系传播,从而减少了闪烁现象。掩码时间一致性损失能够约束不同时间步长下的预测结果的一致性,提高了模型对不同时间采样率的鲁棒性。

关键设计:掩码时间一致性损失的设计是关键。具体来说,该损失函数计算不同时间步长下预测掩码之间的差异,并将其作为正则化项添加到总损失函数中。此外,论文还采用了随机训练步幅的策略,即在训练过程中随机选择不同的时间步长,从而使模型能够更好地适应不同的时间采样率。时空记忆解码器的具体结构未知,但推测使用了注意力机制来聚合多帧特征。

🖼️ 关键图片

📊 实验亮点

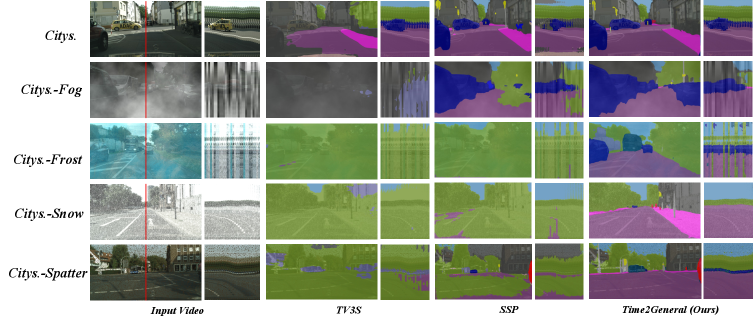

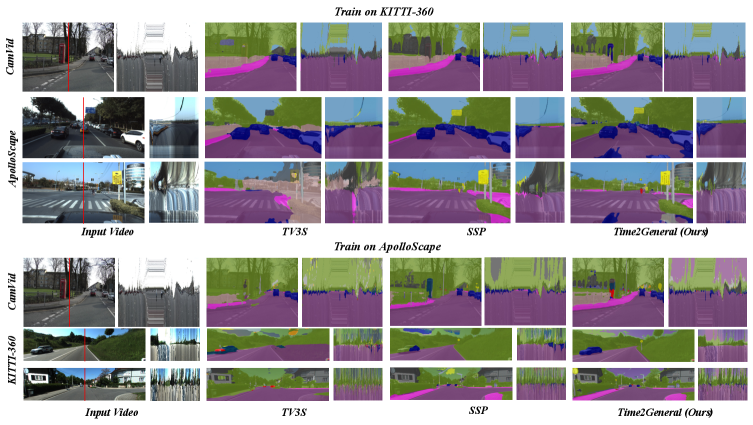

Time2General在多个驾驶基准数据集上进行了实验,结果表明,该方法在跨域准确性和时间稳定性方面均优于现有的DGSS和VSS基线方法。具体而言,该方法在跨域准确性方面取得了显著提升,同时运行速度高达18 FPS,具有实际应用价值。

🎯 应用场景

该研究成果可应用于自动驾驶、智能监控、机器人导航等领域。在这些场景中,视频语义分割的准确性和时间稳定性至关重要。通过提高模型在未见过的环境中的泛化能力,可以减少对大量标注数据的依赖,降低部署成本,并提升系统的可靠性。

📄 摘要(原文)

Domain Generalized Video Semantic Segmentation (DGVSS) is trained on a single labeled driving domain and is directly deployed on unseen domains without target labels and test-time adaptation while maintaining temporally consistent predictions over video streams. In practice, both domain shift and temporal-sampling shift break correspondence-based propagation and fixed-stride temporal aggregation, causing severe frame-to-frame flicker even in label-stable regions. We propose Time2General, a DGVSS framework built on Stability Queries. Time2General introduces a Spatio-Temporal Memory Decoder that aggregates multi-frame context into a clip-level spatio-temporal memory and decodes temporally consistent per-frame masks without explicit correspondence propagation. To further suppress flicker and improve robustness to varying sampling rates, the Masked Temporal Consistency Loss is proposed to regularize temporal prediction discrepancies across different strides, and randomize training strides to expose the model to diverse temporal gaps. Extensive experiments on multiple driving benchmarks show that Time2General achieves a substantial improvement in cross-domain accuracy and temporal stability over prior DGSS and VSS baselines while running at up to 18 FPS. Code will be released after the review process.