AGMark: Attention-Guided Dynamic Watermarking for Large Vision-Language Models

作者: Yue Li, Xin Yi, Dongsheng Shi, Yongyi Cui, Gerard de Melo, Linlin Wang

分类: cs.CV, cs.AI, cs.CR

发布日期: 2026-02-10

备注: preprint

💡 一句话要点

AGMark:注意力引导的动态水印技术,用于保护大型视觉-语言模型的内容版权。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言模型 水印技术 注意力机制 动态水印 知识产权保护

📋 核心要点

- 现有视觉-语言模型水印方法存在视觉无关token引入、破坏视觉基础,以及无法适应视觉依赖动态变化等问题。

- AGMark通过注意力机制动态识别语义关键证据,并结合上下文连贯性线索,实现更自适应和校准的权重分布。

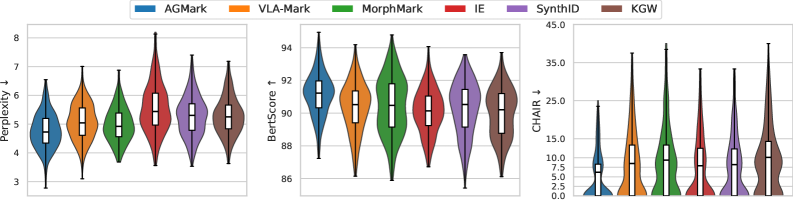

- 实验表明,AGMark在生成质量、视觉语义保真度、检测精度和抗攻击能力方面均优于现有方法,且不影响推理效率。

📝 摘要(中文)

水印技术已成为大型视觉-语言模型(LVLMs)中内容溯源和知识产权保护的关键解决方案。然而,与视觉无关的水印可能会引入视觉上不相关的token,并通过强制执行无差别的伪随机偏差来破坏视觉基础。此外,现有的特定于视觉的水印依赖于对视觉关键权重的静态、一次性估计,并且在确定受保护token的比例时忽略了权重分布密度。这种设计无法解释生成过程中视觉依赖的动态变化,并可能在长尾中引入低质量的token。为了解决这些挑战,我们提出了一种注意力引导的动态水印(AGMark)框架,该框架嵌入可检测的信号,同时严格保持视觉保真度。在每个解码步骤中,AGMark首先基于视觉相关性的注意力权重以及上下文感知的连贯性线索,动态地识别语义关键证据,从而产生更具适应性和良好校准的证据-权重分布。然后,它通过联合考虑不确定性感知(token熵)和证据校准(权重密度)来确定语义关键token的比例,从而实现自适应词汇分区以避免不相关的token。实验结果证实,AGMark优于传统方法,显着提高了生成质量,并在生成后期阶段在视觉语义保真度方面产生了特别强的增益。该框架保持了极具竞争力的检测精度(至少99.36%AUC)和强大的抗攻击能力(至少88.61%AUC),而不会牺牲推理效率,从而有效地为保持可靠性的多模态水印建立了一个新标准。

🔬 方法详解

问题定义:现有视觉-语言模型的水印方法,要么是视觉无关的,容易引入噪声token并破坏视觉语义一致性;要么是静态的,无法适应生成过程中视觉依赖的动态变化,导致长尾token质量下降。因此,需要一种能够动态适应视觉信息,同时保证生成质量和水印鲁棒性的水印方法。

核心思路:AGMark的核心思路是利用注意力机制动态地识别与视觉信息相关的语义关键token,并根据这些token的重要性来调整水印的嵌入策略。通过这种方式,可以避免在视觉无关的token上添加水印,从而提高生成质量,并增强水印的鲁棒性。

技术框架:AGMark框架主要包含以下几个步骤:1) 视觉相关性评估:利用注意力权重来衡量每个token与视觉信息的相关程度。2) 上下文连贯性评估:考虑token的上下文信息,进一步校准视觉相关性评估的结果。3) 自适应词汇分区:根据token的重要性(由视觉相关性和上下文连贯性共同决定)将词汇表划分为受保护和不受保护的token集合。4) 水印嵌入:在受保护的token集合中嵌入水印信息。

关键创新:AGMark的关键创新在于其动态性和自适应性。它能够根据视觉信息和上下文信息动态地调整水印的嵌入策略,从而在保证生成质量的同时,提高水印的鲁棒性。与现有方法相比,AGMark不再依赖于静态的视觉权重估计,而是能够实时地捕捉视觉依赖的变化。

关键设计:AGMark的关键设计包括:1) 使用注意力权重作为视觉相关性的度量;2) 引入上下文连贯性评估来校准注意力权重;3) 基于token熵和权重密度联合确定语义关键token的比例;4) 使用自适应词汇分区来避免无关token。具体的损失函数和网络结构细节未在摘要中详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

AGMark在实验中表现出色,显著提高了生成质量,尤其是在视觉语义保真度方面。该方法在保持高检测精度(至少99.36% AUC)和抗攻击能力(至少88.61% AUC)的同时,没有牺牲推理效率,优于传统水印方法,为多模态水印技术树立了新的标准。

🎯 应用场景

AGMark可应用于各种需要保护知识产权的大型视觉-语言模型,例如图像描述生成、视觉问答、多模态对话等。该技术能够有效追踪和溯源生成内容,防止未经授权的使用和传播,具有重要的商业价值和社会意义。未来,AGMark有望成为多模态内容安全领域的重要组成部分。

📄 摘要(原文)

Watermarking has emerged as a pivotal solution for content traceability and intellectual property protection in Large Vision-Language Models (LVLMs). However, vision-agnostic watermarks may introduce visually irrelevant tokens and disrupt visual grounding by enforcing indiscriminate pseudo-random biases. Additionally, current vision-specific watermarks rely on a static, one-time estimation of vision critical weights and ignore the weight distribution density when determining the proportion of protected tokens. This design fails to account for dynamic changes in visual dependence during generation and may introduce low-quality tokens in the long tail. To address these challenges, we propose Attention-Guided Dynamic Watermarking (AGMark), a novel framework that embeds detectable signals while strictly preserving visual fidelity. At each decoding step, AGMark first dynamically identifies semantic-critical evidence based on attention weights for visual relevance, together with context-aware coherence cues, resulting in a more adaptive and well-calibrated evidence-weight distribution. It then determines the proportion of semantic-critical tokens by jointly considering uncertainty awareness (token entropy) and evidence calibration (weight density), thereby enabling adaptive vocabulary partitioning to avoid irrelevant tokens. Empirical results confirm that AGMark outperforms conventional methods, observably improving generation quality and yielding particularly strong gains in visual semantic fidelity in the later stages of generation. The framework maintains highly competitive detection accuracy (at least 99.36\% AUC) and robust attack resilience (at least 88.61\% AUC) without sacrificing inference efficiency, effectively establishing a new standard for reliability-preserving multi-modal watermarking.