RAD: Retrieval-Augmented Monocular Metric Depth Estimation for Underrepresented Classes

作者: Michael Baltaxe, Dan Levi, Sagie Benaim

分类: cs.CV

发布日期: 2026-02-10

💡 一句话要点

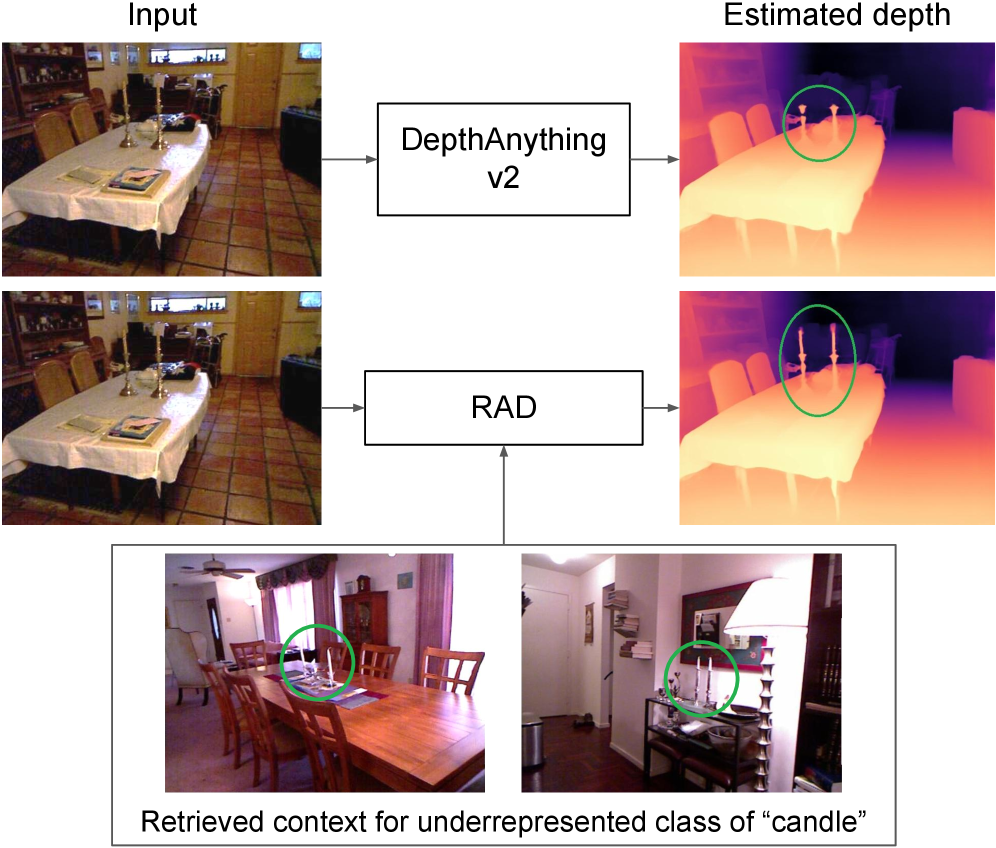

RAD:检索增强的单目深度估计,提升欠表示类别的深度预测精度

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 单目深度估计 检索增强 欠表示类别 几何信息融合 交叉注意力

📋 核心要点

- 单目深度估计在欠表示类别上精度不足,是物理智能系统应用的一大瓶颈。

- RAD利用检索增强,通过检索语义相似的RGB-D图像作为几何代理,提升深度估计。

- 实验表明,RAD在多个数据集的欠表示类别上显著优于现有方法,误差降低明显。

📝 摘要(中文)

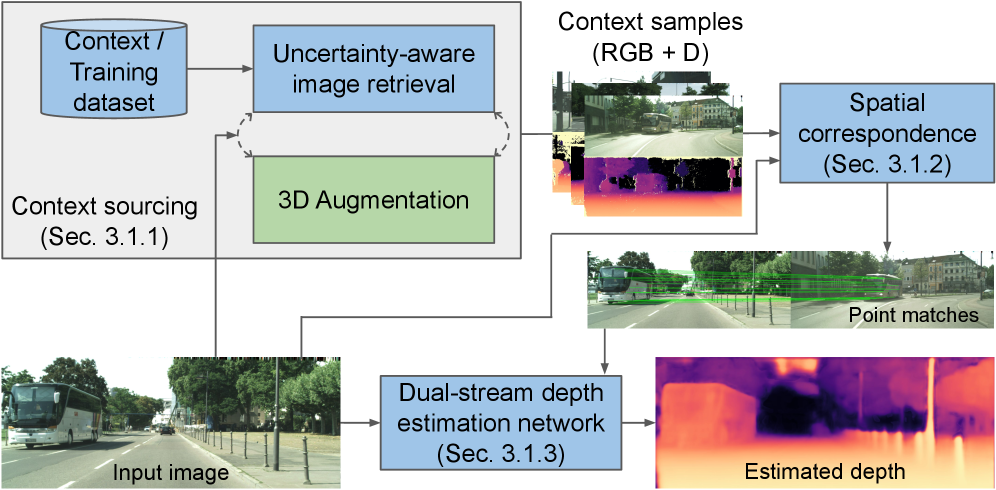

单目度量深度估计(MMDE)对于物理智能系统至关重要,但复杂场景中欠表示类别的精确深度估计仍然是一个持续的挑战。为了解决这个问题,我们提出了RAD,一个检索增强框架,它通过利用检索到的邻居作为结构几何代理来近似多视图立体的优势。我们的方法首先采用一种不确定性感知检索机制来识别输入中的低置信度区域,并检索包含语义相似内容的RGB-D上下文样本。然后,我们通过一个双流网络处理输入和检索到的上下文,并使用匹配的交叉注意力模块融合它们,该模块仅在可靠的点对应关系处传递几何信息。在NYU Depth v2、KITTI和Cityscapes上的评估表明,RAD在欠表示类别上显著优于最先进的基线,在NYU Depth v2上将相对绝对误差降低了29.2%,在KITTI上降低了13.3%,在Cityscapes上降低了7.2%,同时在标准领域内基准测试中保持了具有竞争力的性能。

🔬 方法详解

问题定义:单目深度估计(MMDE)在复杂场景中,对于那些数据集中出现频率较低的类别(欠表示类别),其深度估计精度往往较差。现有方法难以有效利用上下文信息,导致在这些类别上的泛化能力不足。

核心思路:RAD的核心思想是利用检索增强来模拟多视图立体的优势。通过检索与输入图像中低置信度区域语义相似的RGB-D图像,将这些检索到的图像作为几何信息的补充,从而提高深度估计的准确性。这种方法相当于引入了额外的视角信息,弥补了单目深度估计的不足。

技术框架:RAD的整体框架包含以下几个主要模块:1) 不确定性感知检索模块:用于识别输入图像中的低置信度区域,并检索包含语义相似内容的RGB-D上下文样本。2) 双流网络:分别处理输入图像和检索到的上下文图像,提取特征。3) 匹配的交叉注意力模块:用于融合来自输入图像和检索图像的特征,通过注意力机制,仅在可靠的点对应关系处传递几何信息。4) 深度估计模块:基于融合后的特征,预测最终的深度图。

关键创新:RAD的关键创新在于将检索增强引入到单目深度估计中,并设计了不确定性感知的检索机制和匹配的交叉注意力模块。这种方法能够有效地利用外部知识,提高模型在欠表示类别上的泛化能力。与现有方法相比,RAD不是单纯依赖于单张图像的信息,而是通过检索相似图像来获取额外的几何信息。

关键设计:不确定性感知检索模块使用深度估计网络输出的不确定性图来指导检索过程,优先检索那些模型预测不确定的区域。匹配的交叉注意力模块通过计算输入图像和检索图像之间的注意力权重,实现特征的有效融合。损失函数方面,除了标准的深度回归损失外,还可以加入正则化项,以约束深度图的平滑性。

🖼️ 关键图片

📊 实验亮点

RAD在NYU Depth v2、KITTI和Cityscapes数据集上进行了评估,结果表明其在欠表示类别上的性能显著优于现有方法。具体来说,在NYU Depth v2上,RAD将相对绝对误差降低了29.2%,在KITTI上降低了13.3%,在Cityscapes上降低了7.2%。同时,RAD在标准领域内基准测试中也保持了具有竞争力的性能,证明了其有效性和泛化能力。

🎯 应用场景

RAD技术可应用于机器人导航、自动驾驶、增强现实等领域。通过提高对场景中各种物体的深度感知精度,尤其是在光照条件差或物体遮挡的情况下,可以增强机器人的环境适应性和决策能力,提升自动驾驶系统的安全性,并为AR应用提供更逼真的场景渲染。

📄 摘要(原文)

Monocular Metric Depth Estimation (MMDE) is essential for physically intelligent systems, yet accurate depth estimation for underrepresented classes in complex scenes remains a persistent challenge. To address this, we propose RAD, a retrieval-augmented framework that approximates the benefits of multi-view stereo by utilizing retrieved neighbors as structural geometric proxies. Our method first employs an uncertainty-aware retrieval mechanism to identify low-confidence regions in the input and retrieve RGB-D context samples containing semantically similar content. We then process both the input and retrieved context via a dual-stream network and fuse them using a matched cross-attention module, which transfers geometric information only at reliable point correspondences. Evaluations on NYU Depth v2, KITTI, and Cityscapes demonstrate that RAD significantly outperforms state-of-the-art baselines on underrepresented classes, reducing relative absolute error by 29.2% on NYU Depth v2, 13.3% on KITTI, and 7.2% on Cityscapes, while maintaining competitive performance on standard in-domain benchmarks.