Weakly Supervised Contrastive Learning for Histopathology Patch Embeddings

作者: Bodong Zhang, Xiwen Li, Hamid Manoochehri, Xiaoya Tang, Deepika Sirohi, Beatrice S. Knudsen, Tolga Tasdizen

分类: cs.CV

发布日期: 2026-02-10

💡 一句话要点

提出弱监督对比学习WeakSupCon,提升病理切片嵌入表示质量,改善MIL性能

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 弱监督学习 对比学习 多示例学习 病理图像分析 特征表示学习

📋 核心要点

- 传统MIL方法忽略了编码器预训练的重要性,导致特征表示学习不足,影响最终性能。

- WeakSupCon通过引入包级别标签信息,在对比学习过程中有效区分不同标签的切片特征。

- 实验表明,WeakSupCon生成的特征表示能够显著提升下游MIL任务的性能,优于自监督方法。

📝 摘要(中文)

数字病理全切片图像(WSI)提供了千兆像素级的高分辨率图像,对疾病诊断非常有帮助。然而,由于手动标注大型WSI中的特定区域或小切片需要大量时间和精力,数字病理图像分析面临着训练标签有限的重大挑战。弱监督多示例学习(MIL)通过仅需要包级别(切片级别)的标签,提供了一种实用且高效的解决方案,而每个包通常包含多个实例(切片)。大多数MIL方法直接使用各种图像编码器生成的冻结图像切片特征作为输入,主要关注特征聚合。然而,MIL设置中编码器预训练的特征表示学习在很大程度上被忽略了。在我们的工作中,我们提出了一种新的特征表示学习框架,称为弱监督对比学习(WeakSupCon),它在训练过程中结合了包级别的标签信息。我们的方法不依赖于实例级别的伪标签,但它有效地分离了特征空间中具有不同标签的切片。实验结果表明,与自监督对比学习方法相比,我们的WeakSupCon方法生成的图像特征在三个数据集中带来了改进的下游MIL性能。

🔬 方法详解

问题定义:论文旨在解决数字病理图像分析中,由于标注成本高昂导致训练数据有限的问题。现有的多示例学习(MIL)方法主要关注特征聚合,而忽略了图像编码器预训练阶段的特征表示学习,导致特征表示能力不足,影响最终的诊断性能。

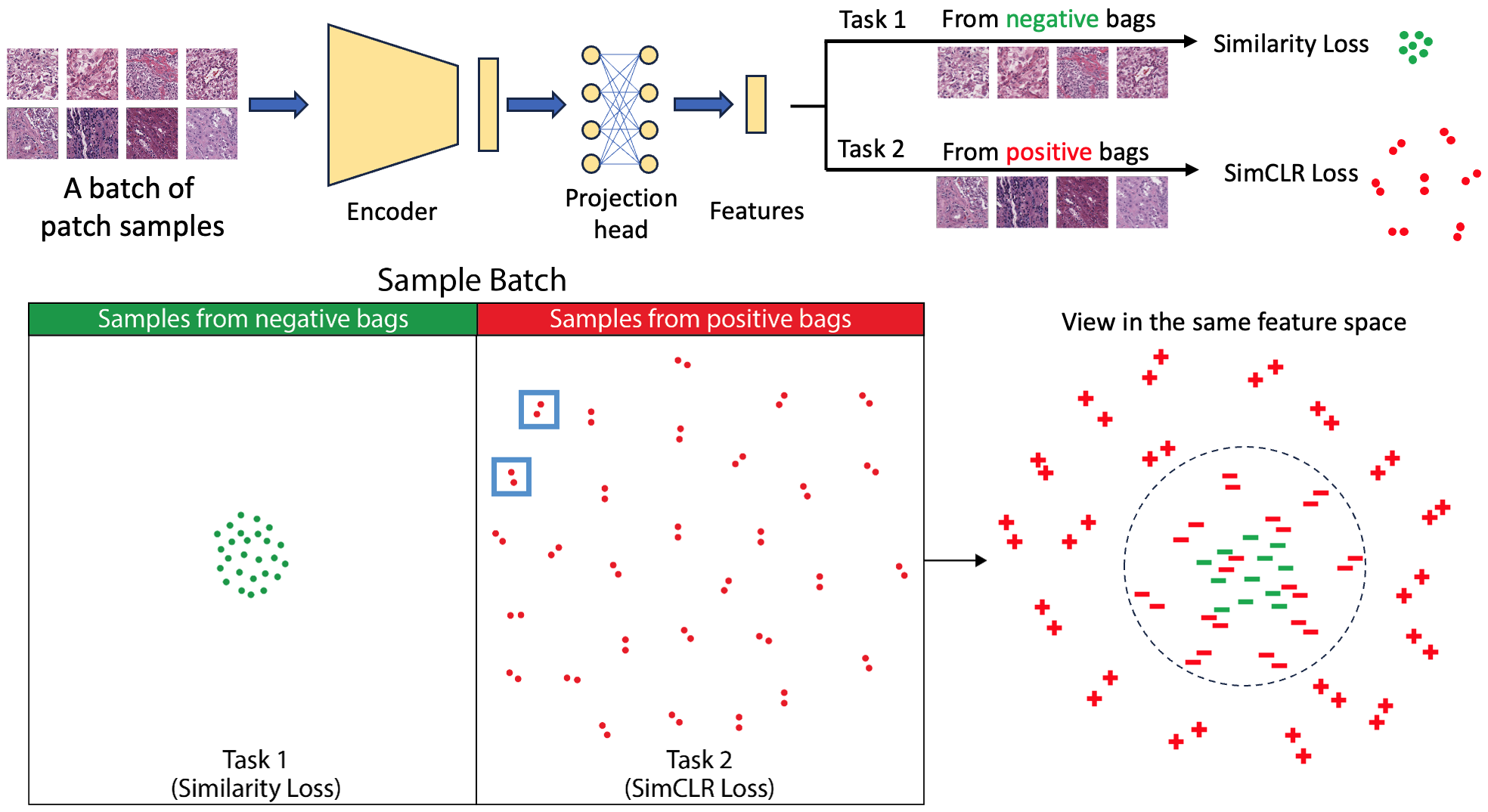

核心思路:论文的核心思路是利用弱监督对比学习(WeakSupCon)来提升病理切片图像的特征表示能力。通过在对比学习过程中引入包级别的标签信息,使得来自不同标签包的切片在特征空间中尽可能远离,从而学习到更具区分性的特征表示。

技术框架:WeakSupCon框架主要包含两个阶段:1) 编码器预训练阶段:使用弱监督对比学习方法训练图像编码器,使其能够生成高质量的切片特征表示。2) 下游MIL任务:使用预训练的编码器提取切片特征,然后使用MIL方法进行疾病诊断。

关键创新:WeakSupCon的关键创新在于将包级别的弱监督信息融入到对比学习过程中。与传统的自监督对比学习方法不同,WeakSupCon能够利用标签信息来指导特征表示学习,从而学习到更适合下游MIL任务的特征表示。

关键设计:WeakSupCon的关键设计包括:1) 对比损失函数:设计了一种新的对比损失函数,该函数能够利用包级别的标签信息来区分不同标签的切片。2) 负样本选择策略:采用了一种有效的负样本选择策略,以提高对比学习的效率和效果。具体的网络结构和参数设置在论文中有详细描述,可以参考论文原文。

🖼️ 关键图片

📊 实验亮点

实验结果表明,WeakSupCon方法在三个病理数据集上均取得了显著的性能提升。与自监督对比学习方法相比,WeakSupCon能够生成更具区分性的特征表示,从而提高了下游MIL任务的准确率。具体的性能数据和对比基线可以在论文的实验部分找到,例如在某个数据集上,WeakSupCon将MIL的准确率提升了X个百分点。

🎯 应用场景

该研究成果可应用于多种数字病理图像分析任务,例如癌症诊断、预后预测和治疗反应评估。通过提升病理切片图像的特征表示能力,可以提高诊断的准确性和效率,从而帮助医生做出更明智的临床决策,改善患者的治疗效果。该方法还可以推广到其他弱监督学习场景,具有广泛的应用前景。

📄 摘要(原文)

Digital histopathology whole slide images (WSIs) provide gigapixel-scale high-resolution images that are highly useful for disease diagnosis. However, digital histopathology image analysis faces significant challenges due to the limited training labels, since manually annotating specific regions or small patches cropped from large WSIs requires substantial time and effort. Weakly supervised multiple instance learning (MIL) offers a practical and efficient solution by requiring only bag-level (slide-level) labels, while each bag typically contains multiple instances (patches). Most MIL methods directly use frozen image patch features generated by various image encoders as inputs and primarily focus on feature aggregation. However, feature representation learning for encoder pretraining in MIL settings has largely been neglected. In our work, we propose a novel feature representation learning framework called weakly supervised contrastive learning (WeakSupCon) that incorporates bag-level label information during training. Our method does not rely on instance-level pseudo-labeling, yet it effectively separates patches with different labels in the feature space. Experimental results demonstrate that the image features generated by our WeakSupCon method lead to improved downstream MIL performance compared to self-supervised contrastive learning approaches in three datasets. Our related code is available at github.com/BzhangURU/Paper_WeakSupCon_for_MIL