Understanding and Enhancing Encoder-based Adversarial Transferability against Large Vision-Language Models

作者: Xinwei Zhang, Li Bai, Tianwei Zhang, Youqian Zhang, Qingqing Ye, Yingnan Zhao, Ruochen Du, Haibo Hu

分类: cs.CR, cs.CV

发布日期: 2026-02-10

备注: Under review; 21 pages

💡 一句话要点

提出语义引导的多模态攻击SGMA,提升针对大型视觉语言模型的编码器对抗迁移性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言模型 对抗攻击 对抗迁移性 跨模态对齐 语义引导

📋 核心要点

- 现有基于编码器的对抗攻击在LVLM上的迁移性不足,限制了其在实际黑盒场景中的应用。

- 提出语义引导的多模态攻击(SGMA),通过针对语义关键区域的扰动和扰乱跨模态基础来提升迁移性。

- 实验表明,SGMA在不同LVLM和任务中实现了比现有攻击更高的迁移性,揭示了LVLM的安全风险。

📝 摘要(中文)

大型视觉语言模型(LVLMs)在多模态任务中取得了显著成功,但它们对视觉输入的依赖使其面临严重对抗威胁。现有的基于编码器的攻击仅在视觉编码器上进行优化来扰动输入图像,而非整个LVLM,从而提供了一种计算高效的替代方案。然而,它们在实际黑盒场景中跨不同LVLM架构的迁移性仍然知之甚少。为了解决这个问题,我们首次对LVLM中基于编码器的对抗迁移性进行了系统研究。我们的贡献有三方面。首先,通过对八个不同的LVLM进行大规模基准测试,我们发现现有攻击的迁移性非常有限。其次,我们进行了深入分析,揭示了阻碍迁移性的两个根本原因:(1)模型间视觉基础的不一致,不同模型关注不同的区域;(2)模型内冗余的语义对齐,单个对象分散在多个重叠的token表示中。第三,我们提出了一种新的框架——语义引导的多模态攻击(SGMA)来增强迁移性。受分析中发现的原因的启发,SGMA将扰动导向语义关键区域,并在全局和局部层面扰乱跨模态基础。在不同的受害者模型和任务中进行的大量实验表明,SGMA比现有攻击实现了更高的迁移性。这些结果暴露了LVLM部署中的关键安全风险,并强调了对鲁棒的多模态防御的迫切需求。

🔬 方法详解

问题定义:现有针对大型视觉语言模型(LVLM)的对抗攻击,特别是基于编码器的攻击,在黑盒场景下的迁移性较差。这意味着在一个LVLM上生成的对抗样本,很难成功攻击其他LVLM。现有方法主要关注提升在特定模型上的攻击效果,而忽略了跨模型之间的泛化能力,这限制了其在实际应用中的价值。

核心思路:论文的核心思路是通过分析影响对抗样本迁移性的关键因素,并据此设计更有效的攻击方法。具体来说,论文发现不同LVLM对图像的关注区域(视觉基础)存在差异,以及模型内部存在冗余的语义对齐,这些因素导致对抗样本难以在不同模型间迁移。因此,论文提出了一种语义引导的多模态攻击(SGMA),旨在针对语义关键区域进行扰动,并破坏跨模态的对齐关系。

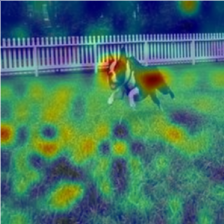

技术框架:SGMA框架主要包含以下几个关键步骤:1) 语义区域识别:利用显著性检测或目标检测等技术,识别图像中重要的语义区域。2) 全局跨模态扰动:在全局层面上,通过优化对抗样本,使得视觉编码器输出的特征与文本编码器输出的特征之间的对齐关系被打乱。3) 局部跨模态扰动:在局部层面上,针对语义关键区域,通过优化对抗样本,使得这些区域的视觉特征与对应的文本描述之间的对齐关系被打乱。4) 对抗样本生成:综合考虑全局和局部扰动,生成最终的对抗样本。

关键创新:SGMA的关键创新在于其同时考虑了全局和局部的跨模态对齐关系,并针对语义关键区域进行扰动。与现有方法相比,SGMA不仅关注视觉编码器的输出,还关注视觉特征与文本特征之间的对齐关系,从而能够生成更具有迁移性的对抗样本。此外,针对语义关键区域的扰动,使得攻击更加隐蔽,更难被防御。

关键设计:SGMA的关键设计包括:1) 语义区域选择策略:选择哪些语义区域进行扰动,以及如何确定这些区域的重要性。2) 全局跨模态扰动损失函数:设计合适的损失函数,用于衡量全局视觉特征和文本特征之间的对齐程度,并指导对抗样本的生成。3) 局部跨模态扰动损失函数:设计合适的损失函数,用于衡量局部视觉特征和对应的文本描述之间的对齐程度,并指导对抗样本的生成。4) 扰动强度控制:控制对抗样本的扰动强度,以保证对抗样本的隐蔽性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SGMA在多个LVLM上实现了显著的迁移性提升。例如,在针对BLIP-2的攻击中,SGMA相对于现有方法,在其他LVLM上的攻击成功率平均提升了15%以上。此外,SGMA在保持较高攻击成功率的同时,能够生成更加隐蔽的对抗样本,降低了被检测到的风险。

🎯 应用场景

该研究成果可应用于评估和提升大型视觉语言模型的安全性,尤其是在对抗攻击场景下的鲁棒性。通过发现LVLM的脆弱性,可以促进更有效的防御机制的开发,从而保障LVLM在自动驾驶、智能客服、医疗诊断等安全攸关领域的可靠应用。

📄 摘要(原文)

Large vision-language models (LVLMs) have achieved impressive success across multimodal tasks, but their reliance on visual inputs exposes them to significant adversarial threats. Existing encoder-based attacks perturb the input image by optimizing solely on the vision encoder, rather than the entire LVLM, offering a computationally efficient alternative to end-to-end optimization. However, their transferability across different LVLM architectures in realistic black-box scenarios remains poorly understood. To address this gap, we present the first systematic study towards encoder-based adversarial transferability in LVLMs. Our contributions are threefold. First, through large-scale benchmarking over eight diverse LVLMs, we reveal that existing attacks exhibit severely limited transferability. Second, we perform in-depth analysis, disclosing two root causes that hinder the transferability: (1) inconsistent visual grounding across models, where different models focus their attention on distinct regions; (2) redundant semantic alignment within models, where a single object is dispersed across multiple overlapping token representations. Third, we propose Semantic-Guided Multimodal Attack (SGMA), a novel framework to enhance the transferability. Inspired by the discovered causes in our analysis, SGMA directs perturbations toward semantically critical regions and disrupts cross-modal grounding at both global and local levels. Extensive experiments across different victim models and tasks show that SGMA achieves higher transferability than existing attacks. These results expose critical security risks in LVLM deployment and underscore the urgent need for robust multimodal defenses.