MotionCrafter: Dense Geometry and Motion Reconstruction with a 4D VAE

作者: Ruijie Zhu, Jiahao Lu, Wenbo Hu, Xiaoguang Han, Jianfei Cai, Ying Shan, Chuanxia Zheng

分类: cs.CV, cs.AI, cs.CG, cs.LG

发布日期: 2026-02-09

备注: Project page: https://ruijiezhu94.github.io/MotionCrafter_Page

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出MotionCrafter以解决单目视频中的4D几何与运动重建问题

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 4D几何重建 密集运动估计 变分自编码器 视频扩散 单目视频理解

📋 核心要点

- 现有方法在从单目视频中重建4D几何和运动时,往往面临数据对齐和性能优化的挑战。

- 本论文提出了一种新颖的联合表示方法,利用4D VAE有效学习密集3D点图和场流,避免了严格对齐的限制。

- 实验结果显示,MotionCrafter在多个数据集上实现了几何和运动重建的显著提升,分别提高了38.64%和25.0%。

📝 摘要(中文)

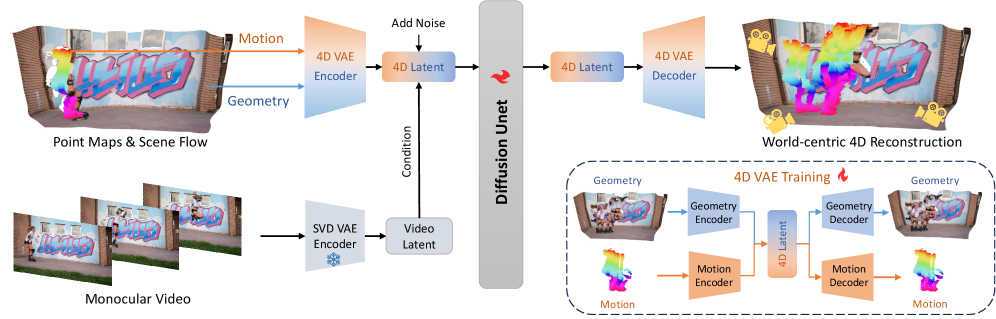

我们介绍了MotionCrafter,一个基于视频扩散的框架,能够从单目视频中联合重建4D几何并估计密集运动。我们的方法核心在于一种新颖的密集3D点图和3D场流的联合表示,采用共享坐标系统,并利用一种新的4D变分自编码器(VAE)有效学习该表示。与以往强制3D值与RGB VAE潜变量严格对齐的工作不同,我们表明这种对齐并非必要,且会导致次优性能。相反,我们引入了一种新的数据归一化和VAE训练策略,更好地传递扩散先验,显著提高重建质量。大量实验表明,MotionCrafter在几何重建和密集场流估计方面均实现了最先进的性能,几何和运动重建分别提升了38.64%和25.0%,且无需后期优化。

🔬 方法详解

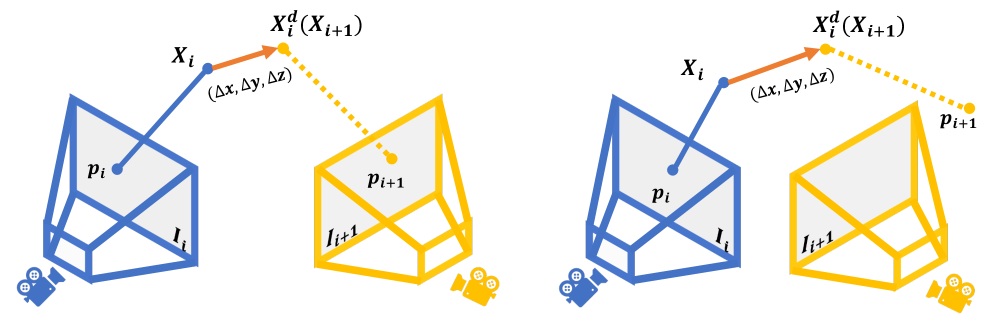

问题定义:本论文旨在解决从单目视频中重建4D几何和估计密集运动的问题。现有方法通常强制3D值与RGB VAE潜变量对齐,导致性能不佳。

核心思路:我们提出了一种新颖的联合表示方法,利用共享坐标系统来表示密集3D点图和3D场流,采用4D VAE进行有效学习,避免了对齐的限制。

技术框架:整体架构包括数据归一化、4D VAE训练和重建模块。首先对输入数据进行归一化处理,然后通过4D VAE学习联合表示,最后进行几何和运动的重建。

关键创新:最重要的创新在于引入了一种新的数据归一化和VAE训练策略,显著改善了重建质量,与传统方法相比,避免了严格对齐的必要性。

关键设计:在参数设置上,我们优化了VAE的超参数,并设计了适应性损失函数,以提高重建的准确性和稳定性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MotionCrafter在几何重建和密集场流估计方面均达到了最先进的性能,几何重建提升了38.64%,运动重建提升了25.0%。这些结果在多个数据集上均得到了验证,且无需后期优化,显示出其优越性。

🎯 应用场景

该研究的潜在应用领域包括虚拟现实、增强现实和机器人导航等。通过精确的4D几何和运动重建,MotionCrafter能够为这些领域提供更高质量的环境理解和交互体验,未来可能推动相关技术的进一步发展。

📄 摘要(原文)

We introduce MotionCrafter, a video diffusion-based framework that jointly reconstructs 4D geometry and estimates dense motion from a monocular video. The core of our method is a novel joint representation of dense 3D point maps and 3D scene flows in a shared coordinate system, and a novel 4D VAE to effectively learn this representation. Unlike prior work that forces the 3D value and latents to align strictly with RGB VAE latents-despite their fundamentally different distributions-we show that such alignment is unnecessary and leads to suboptimal performance. Instead, we introduce a new data normalization and VAE training strategy that better transfers diffusion priors and greatly improves reconstruction quality. Extensive experiments across multiple datasets demonstrate that MotionCrafter achieves state-of-the-art performance in both geometry reconstruction and dense scene flow estimation, delivering 38.64% and 25.0% improvements in geometry and motion reconstruction, respectively, all without any post-optimization. Project page: https://ruijiezhu94.github.io/MotionCrafter_Page