MVAnimate: Enhancing Character Animation with Multi-View Optimization

作者: Tianyu Sun, Zhoujie Fu, Bang Zhang, Guosheng Lin

分类: cs.CV

发布日期: 2026-02-09

💡 一句话要点

MVAnimate:多视角优化增强角色动画生成质量

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 角色动画 多视角学习 视频生成 三维重建 时空一致性 深度学习 计算机视觉

📋 核心要点

- 现有动画生成算法在建模人体姿态时面临输出质量低和训练数据不足等问题。

- MVAnimate利用多视角先验信息,综合2D和3D信息,生成时空一致的动画。

- 实验表明,MVAnimate在处理各种运动模式和外观方面表现出鲁棒性,优于现有方法。

📝 摘要(中文)

对逼真且多功能角色动画的需求日益增长,这得益于其在各个领域的广泛应用。然而,现有的基于2D或3D结构建模人体姿态的动画生成算法都面临着各种问题,包括输出内容质量低和训练数据不足,这阻碍了相关算法生成高质量的动画视频。因此,我们提出了MVAnimate,这是一个新颖的框架,它基于多视角先验信息综合动态人物的2D和3D信息,以提高生成的视频质量。我们的方法利用多视角先验信息来产生时间上一致和空间上连贯的动画输出,展示了相对于现有动画方法的改进。我们的MVAnimate还优化了目标角色的多视角视频,从而提高了不同视角的视频质量。在各种数据集上的实验结果突出了我们的方法在处理各种运动模式和外观方面的鲁棒性。

🔬 方法详解

问题定义:现有基于2D或3D结构的角色动画生成方法,由于缺乏高质量的训练数据和对多视角信息的有效利用,导致生成动画的质量较低,时空一致性较差。这些方法难以处理复杂的运动模式和多样化的角色外观。

核心思路:MVAnimate的核心思路是利用多视角先验信息,将2D和3D信息融合,从而约束动画生成过程,提高生成视频的质量和时空一致性。通过优化多视角视频,可以从不同视角提升视频质量,增强动画的真实感。

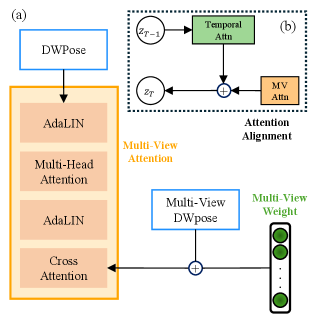

技术框架:MVAnimate框架包含以下主要模块:1) 多视角视频输入;2) 2D和3D信息提取模块,用于提取人物的姿态、形状等信息;3) 多视角信息融合模块,利用多视角先验信息,将2D和3D信息进行融合,生成一致的角色表示;4) 动画生成模块,基于融合后的角色表示,生成目标动画视频;5) 多视角优化模块,对生成的动画视频进行多视角优化,提高视频质量。

关键创新:MVAnimate的关键创新在于利用多视角先验信息来约束动画生成过程。与传统的单视角方法相比,多视角信息能够提供更丰富的几何和运动信息,从而提高生成动画的时空一致性和真实感。此外,多视角优化模块能够进一步提高生成视频的质量。

关键设计:具体的技术细节包括:使用多视角相机标定技术获取准确的相机参数;采用深度学习模型提取2D和3D信息;设计特定的损失函数来约束多视角信息的一致性;使用生成对抗网络(GAN)来生成高质量的动画视频;采用多视角渲染技术进行视频优化。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MVAnimate在多个数据集上都取得了显著的性能提升。与现有方法相比,MVAnimate生成的动画视频在时空一致性和视觉质量方面都有明显改善。该方法能够处理各种复杂的运动模式和多样化的角色外观,展现了良好的鲁棒性。

🎯 应用场景

MVAnimate具有广泛的应用前景,包括游戏开发、电影制作、虚拟现实/增强现实、在线教育等领域。它可以用于生成逼真且多样的角色动画,提升用户体验。此外,该技术还可以应用于虚拟试衣、远程协作等场景,具有重要的实际价值和未来影响。

📄 摘要(原文)

The demand for realistic and versatile character animation has surged, driven by its wide-ranging applications in various domains. However, the animation generation algorithms modeling human pose with 2D or 3D structures all face various problems, including low-quality output content and training data deficiency, preventing the related algorithms from generating high-quality animation videos. Therefore, we introduce MVAnimate, a novel framework that synthesizes both 2D and 3D information of dynamic figures based on multi-view prior information, to enhance the generated video quality. Our approach leverages multi-view prior information to produce temporally consistent and spatially coherent animation outputs, demonstrating improvements over existing animation methods. Our MVAnimate also optimizes the multi-view videos of the target character, enhancing the video quality from different views. Experimental results on diverse datasets highlight the robustness of our method in handling various motion patterns and appearances.