SynSacc: A Blender-to-V2E Pipeline for Synthetic Neuromorphic Eye-Movement Data and Sim-to-Real Spiking Model Training

作者: Khadija Iddrisu, Waseem Shariff, Suzanne Little, Noel OConnor

分类: cs.CV

发布日期: 2026-02-09

备注: Accepted to the 2nd Workshop on "Event-based Vision in the Era of Generative AI - Transforming Perception and Visual Innovation, IEEE Winter Conference on Applications of Computer Vision (WACV 2026)

💡 一句话要点

SynSacc:用于神经形态眼动数据的Blender-to-V2E合成管线及SNN模型训练

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 神经形态视觉 事件相机 脉冲神经网络 合成数据 眼动追踪

📋 核心要点

- 眼动分析对于理解认知过程至关重要,但传统相机易受运动模糊影响,限制了高精度分析。

- 论文提出SynSacc,一个基于Blender的合成数据生成管线,用于创建逼真的神经形态眼动数据。

- 实验表明,使用合成数据训练的脉冲神经网络(SNN)在眼动分类任务中表现出高精度和计算效率。

📝 摘要(中文)

本研究旨在通过眼动研究,特别是扫视和注视,来理解人类认知和感知机制。精确分类这些运动需要能够捕捉快速动态而无失真的传感技术。事件相机(DVS)提供光强变化的异步记录,消除了传统帧相机中固有的运动模糊,并提供卓越的时间分辨率和数据效率。本研究介绍了一个用Blender生成的合成数据集,用于在受控条件下模拟扫视和注视。利用脉冲神经网络(SNN),我们通过训练两个架构并在真实事件数据上进行微调来评估其鲁棒性。所提出的模型实现了高达0.83的准确率,并在不同的时间分辨率下保持一致的性能,证明了眼动分类的稳定性。此外,使用带有合成事件流的SNN比人工神经网络(ANN)在计算效率方面产生了显著的提升,突出了合成数据增强在推进基于事件的视觉方面的效用。所有代码和数据集均可在 https://github.com/Ikhadija-5/SynSacc-Dataset 获取。

🔬 方法详解

问题定义:现有眼动追踪技术,特别是基于传统帧相机的技术,在捕捉快速眼动(如扫视)时容易产生运动模糊,限制了时间和空间分辨率。此外,真实事件相机数据的获取和标注成本高昂,阻碍了基于事件相机的眼动分析模型的发展。

核心思路:论文的核心思路是利用计算机图形学软件Blender生成高质量的合成事件相机数据,用于训练和评估脉冲神经网络(SNN)。通过合成数据,可以精确控制眼动参数,并自动生成标注,从而克服真实数据获取和标注的困难。同时,SNN具有事件驱动的特性,与事件相机的数据格式天然契合,能够实现高效的眼动分析。

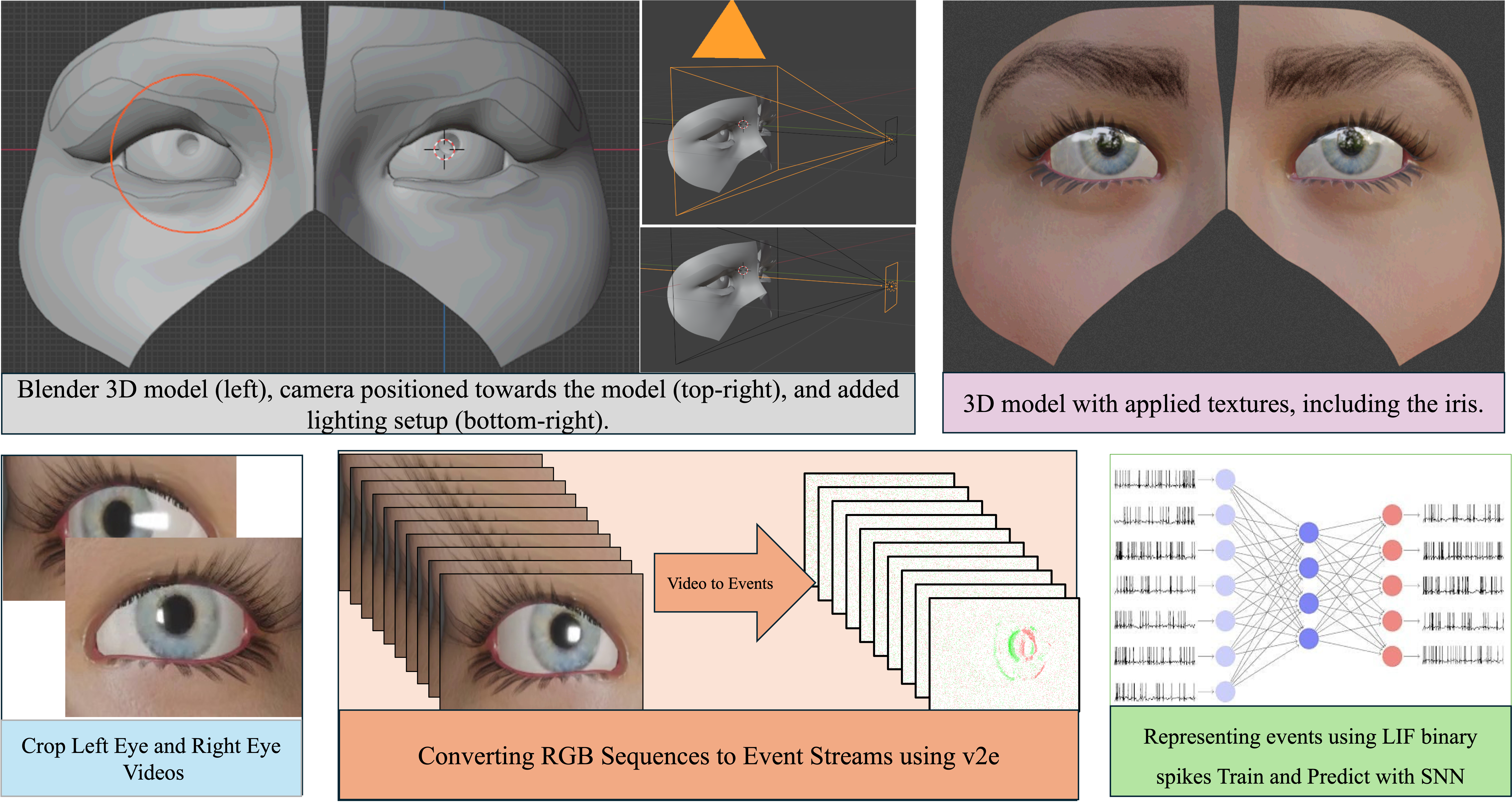

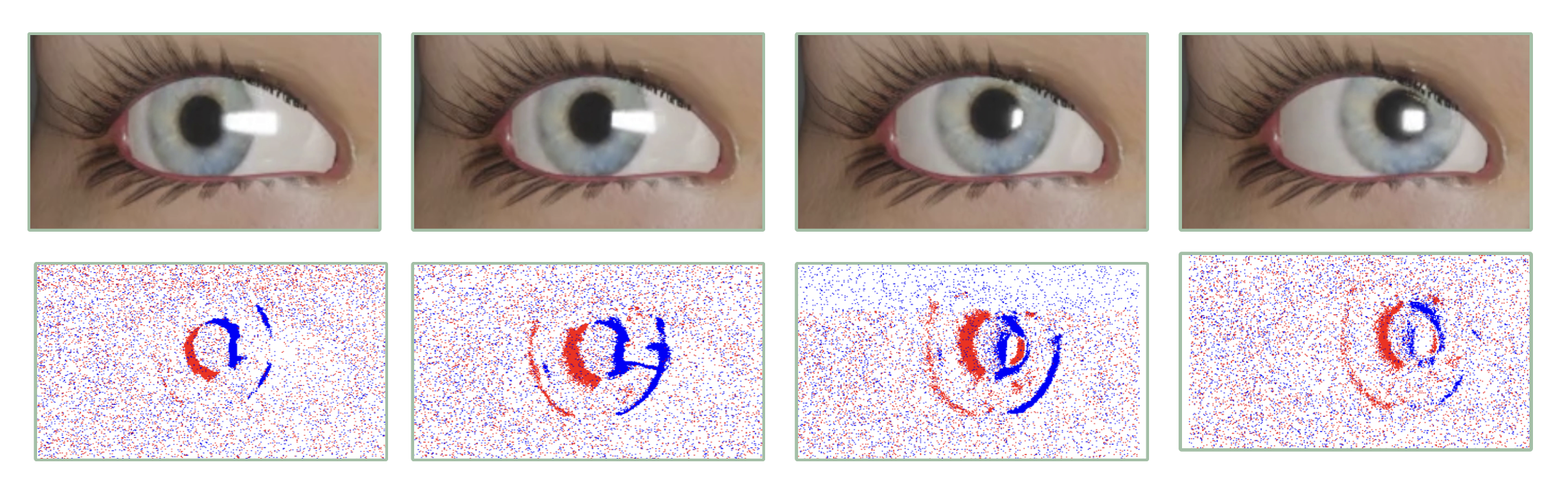

技术框架:该方法包含一个Blender-to-V2E管线,用于生成合成的神经形态眼动数据。首先,在Blender中创建虚拟场景,并模拟眼球运动(扫视和注视)。然后,使用V2E(Virtual to Event)算法将Blender渲染的图像转换为事件流数据,模拟事件相机输出。最后,使用生成的合成数据训练SNN模型,并使用真实事件相机数据进行微调。

关键创新:该方法的主要创新点在于提出了一种基于Blender的合成数据生成管线,能够生成高质量、可控的神经形态眼动数据。此外,论文还探索了使用SNN进行眼动分析,并验证了SNN在计算效率方面的优势。

关键设计:论文使用了两种SNN架构进行实验,并比较了它们在眼动分类任务中的性能。此外,论文还研究了不同时间分辨率对SNN性能的影响。在训练过程中,使用了标准的监督学习方法,并针对事件数据的特点进行了优化。具体的网络结构和训练参数在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用合成数据训练的SNN模型在眼动分类任务中取得了高达0.83的准确率。此外,SNN在计算效率方面优于传统的ANN模型,证明了合成数据增强在推进基于事件的视觉方面的效用。该模型在不同时间分辨率下保持了稳定的性能,验证了其鲁棒性。

🎯 应用场景

该研究成果可应用于眼动追踪、人机交互、虚拟现实等领域。通过使用合成数据和脉冲神经网络,可以降低眼动追踪系统的成本和功耗,并提高其精度和鲁棒性。此外,该方法还可以用于研究人类的认知过程,例如注意力和视觉搜索。

📄 摘要(原文)

The study of eye movements, particularly saccades and fixations, are fundamental to understanding the mechanisms of human cognition and perception. Accurate classification of these movements requires sensing technologies capable of capturing rapid dynamics without distortion. Event cameras, also known as Dynamic Vision Sensors (DVS), provide asynchronous recordings of changes in light intensity, thereby eliminating motion blur inherent in conventional frame-based cameras and offering superior temporal resolution and data efficiency. In this study, we introduce a synthetic dataset generated with Blender to simulate saccades and fixations under controlled conditions. Leveraging Spiking Neural Networks (SNNs), we evaluate its robustness by training two architectures and finetuning on real event data. The proposed models achieve up to 0.83 accuracy and maintain consistent performance across varying temporal resolutions, demonstrating stability in eye movement classification. Moreover, the use of SNNs with synthetic event streams yields substantial computational efficiency gains over artificial neural network (ANN) counterparts, underscoring the utility of synthetic data augmentation in advancing event-based vision. All code and datasets associated with this work is available at https: //github.com/Ikhadija-5/SynSacc-Dataset.