Rotated Lights for Consistent and Efficient 2D Gaussians Inverse Rendering

作者: Geng Lin, Matthias Zwicker

分类: cs.CV, cs.GR

发布日期: 2026-02-09

备注: Project Page: https://rotlight-ir.github.io/

💡 一句话要点

提出RotLight:一种基于旋转光照的2D高斯反向渲染方法,提升albedo估计精度。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 反向渲染 高斯溅射 光照估计 材质估计 旋转光照 视图合成 全局光照

📋 核心要点

- 现有反向渲染方法在分解场景材质和光照时存在模糊性,导致albedo估计出现颜色偏差和阴影烘焙等问题。

- 论文提出RotLight,通过在捕获过程中旋转物体,从多个角度获取光照信息,从而减少反向渲染过程中的歧义性。

- 实验结果表明,RotLight能够显著提升albedo估计的准确性,同时保持高效的计算性能,适用于合成和真实场景。

📝 摘要(中文)

反向渲染旨在将场景分解为几何形状、材质属性和光照条件,并在特定渲染模型下进行。它在视图合成、重光照和场景编辑等领域有广泛应用。近年来,反向渲染方法受到神经辐射场和高斯溅射等视图合成方法的启发,能够有效地将场景分解为几何形状和辐射率。然后,它们进一步估计导致观察到的场景辐射率的材质和光照。然而,后一步骤具有高度模糊性,并且先前的工作尽管进行了正则化,但在albedo估计中存在不准确的颜色和烘焙阴影。为此,我们提出了一种简单的捕获设置RotLight来解决这种模糊性。与通常的捕获相比,RotLight仅需要在过程中将对象旋转几次。我们表明,仅两次旋转即可有效减少伪影。为了进一步改进基于2DGS的反向渲染,我们还引入了一个代理网格,该网格不仅可以实现精确的入射光线追踪,还可以实现残差约束并改善全局光照处理。我们通过合成和真实世界数据集证明,我们的方法在保持高效计算的同时实现了卓越的albedo估计。

🔬 方法详解

问题定义:现有基于神经辐射场或高斯溅射的反向渲染方法,在估计场景的材质和光照时,由于观测数据不足,存在严重的歧义性。这导致估计出的albedo贴图存在颜色偏差和不真实的阴影,影响了后续的重光照和场景编辑等应用。

核心思路:论文的核心思路是通过引入可控的光照变化,即在数据采集阶段旋转物体,从多个角度获取光照信息。这种方法增加了观测数据的多样性,从而降低了反向渲染问题的不适定性,使得材质和光照的估计更加准确。

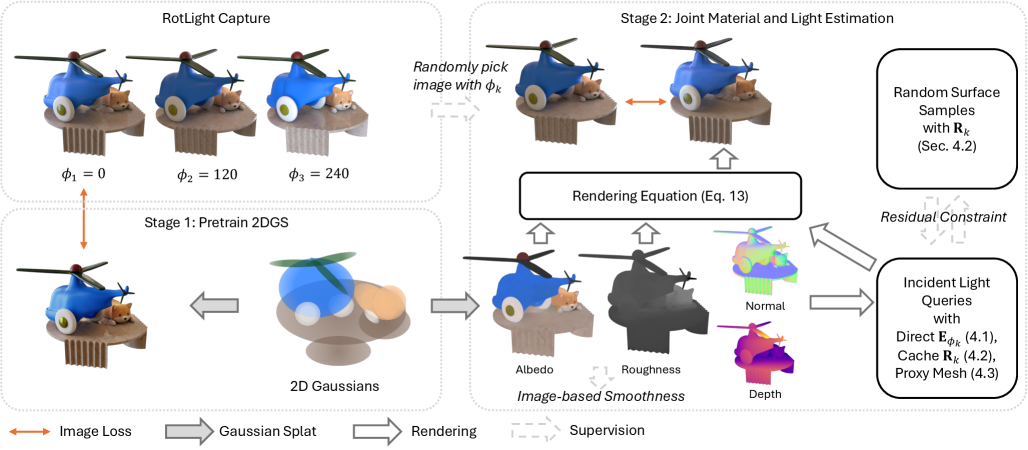

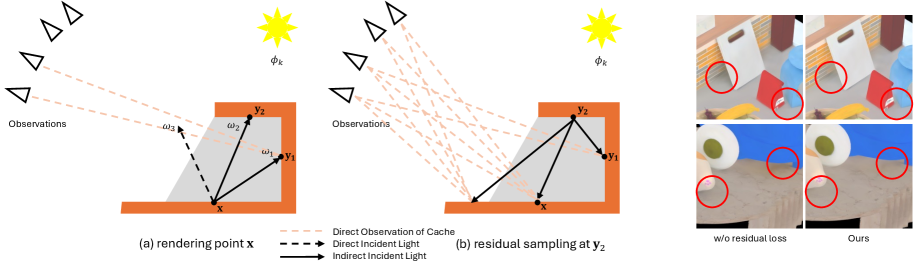

技术框架:整体框架包括数据采集和反向渲染两个主要阶段。在数据采集阶段,使用RotLight装置,即在固定光照条件下,旋转物体并拍摄多张照片。在反向渲染阶段,首先使用2D高斯溅射(2DGS)重建场景的几何和辐射率。然后,利用代理网格进行精确的光线追踪,估计入射光照。最后,通过优化albedo、光照和全局光照分量,得到最终的反向渲染结果。

关键创新:论文的关键创新在于RotLight的引入,它通过简单的旋转运动,有效地增加了观测数据的多样性,从而解决了反向渲染中的歧义性问题。此外,使用代理网格进行光线追踪,提高了光照估计的准确性,并能够更好地处理全局光照效果。

关键设计:RotLight装置的设计需要考虑旋转轴的位置和旋转角度的设置。论文建议至少进行两次旋转,以获得足够的光照变化信息。在反向渲染阶段,使用残差约束来进一步提高albedo估计的准确性。损失函数包括重建损失、正则化项和残差约束项。代理网格可以使用现有的三维重建方法生成,并进行优化以匹配2DGS的几何形状。

🖼️ 关键图片

📊 实验亮点

实验结果表明,RotLight方法在合成和真实数据集上均取得了显著的albedo估计提升。与现有方法相比,RotLight能够减少albedo贴图中的颜色偏差和阴影烘焙,生成更准确的材质信息。定量评估指标显示,RotLight在albedo估计的均方误差和感知质量方面均优于其他方法。

🎯 应用场景

该研究成果可应用于虚拟现实、增强现实、游戏开发等领域。通过RotLight捕获真实物体的图像,可以快速生成高质量的3D模型,并进行逼真的重光照和材质编辑。这有助于提高虚拟内容的真实感和交互性,并降低内容制作的成本。

📄 摘要(原文)

Inverse rendering aims to decompose a scene into its geometry, material properties and light conditions under a certain rendering model. It has wide applications like view synthesis, relighting, and scene editing. In recent years, inverse rendering methods have been inspired by view synthesis approaches like neural radiance fields and Gaussian splatting, which are capable of efficiently decomposing a scene into its geometry and radiance. They then further estimate the material and lighting that lead to the observed scene radiance. However, the latter step is highly ambiguous and prior works suffer from inaccurate color and baked shadows in their albedo estimation albeit their regularization. To this end, we propose RotLight, a simple capturing setup, to address the ambiguity. Compared to a usual capture, RotLight only requires the object to be rotated several times during the process. We show that as few as two rotations is effective in reducing artifacts. To further improve 2DGS-based inverse rendering, we additionally introduce a proxy mesh that not only allows accurate incident light tracing, but also enables a residual constraint and improves global illumination handling. We demonstrate with both synthetic and real world datasets that our method achieves superior albedo estimation while keeping efficient computation.