Chain-of-Caption: Training-free improvement of multimodal large language model on referring expression comprehension

作者: Yik Lung Pang, Changjae Oh

分类: cs.CV

发布日期: 2026-02-09

备注: 4 pages, 5 figures, 2 tables

💡 一句话要点

提出Chain-of-Caption框架,无需训练即可提升多模态大语言模型在指代表达理解任务上的性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 指代表达理解 多模态大语言模型 上下文学习 免训练 视觉上下文 文本上下文 Chain-of-Caption

📋 核心要点

- 现有的多模态大语言模型在指代表达理解任务中,依赖大规模模型和训练数据,缺乏灵活性。

- Chain-of-Caption框架通过为模型提供额外的视觉和文本上下文,引导模型更好地理解指代表达,无需额外训练。

- 实验表明,该框架在多个数据集上显著提升了指代表达理解的精度,最高提升幅度达到30%。

📝 摘要(中文)

本文研究了如何通过工具使用为多模态大语言模型(MLLM)提供额外的视觉和文本上下文,并分析了其对指代表达理解(REC)任务的影响。作者提出了一种名为Chain-of-Caption的免训练框架,旨在提升MLLM在REC任务上的性能。通过在RefCOCO/RefCOCOg/RefCOCO+和Ref-L4数据集上进行实验,结果表明,单独的文本或视觉上下文可以在无需任何微调的情况下提高REC性能。通过结合多种上下文,该免训练框架在不同的交并比(IoU)阈值下,精度相比基线模型提高了5%到30%。

🔬 方法详解

问题定义:指代表达理解(REC)任务旨在根据给定的文本描述,在图像中定位所指对象。现有方法主要依赖于大规模预训练和微调,计算成本高昂,且泛化能力可能受限。缺乏一种轻量级、免训练的提升REC性能的方法。

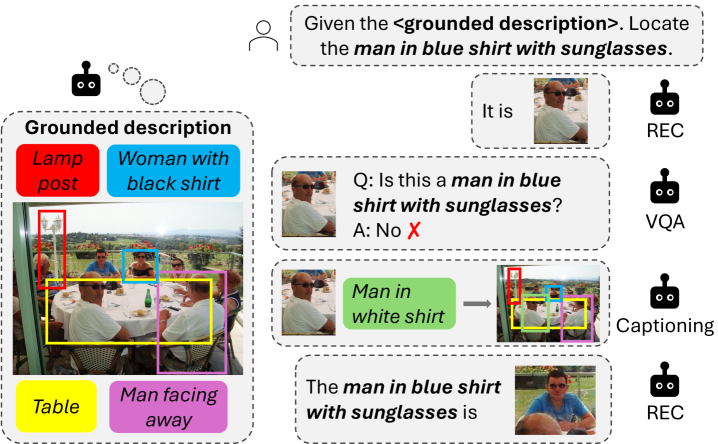

核心思路:Chain-of-Caption的核心思想是利用多模态大语言模型(MLLM)的上下文学习能力,通过提供额外的视觉和文本上下文信息,引导模型更准确地理解指代表达。该方法无需对MLLM进行任何训练或微调,即可提升其在REC任务上的性能。

技术框架:Chain-of-Caption框架主要包含以下几个阶段:1) 输入图像和指代表达;2) 利用工具(如图像描述生成器、目标检测器等)生成额外的视觉和文本上下文;3) 将原始输入和生成的上下文信息组合成一个提示(prompt);4) 将提示输入MLLM,得到预测结果。框架的关键在于如何有效地生成和组合上下文信息。

关键创新:该方法最重要的创新点在于提出了一个免训练的框架,通过上下文增强来提升MLLM在REC任务上的性能。与传统的微调方法相比,该方法更加轻量级、灵活,且易于部署。此外,该方法探索了多种视觉和文本上下文的组合方式,并分析了它们对REC性能的影响。

关键设计:框架的关键设计包括:1) 上下文信息的选择:选择合适的视觉和文本上下文信息,例如图像描述、目标检测结果等,以提供更全面的场景理解;2) 提示的设计:设计有效的提示模板,将原始输入和上下文信息有机地结合起来,引导MLLM进行推理;3) 上下文组合策略:探索不同的上下文组合方式,例如串联、并联等,以最大化上下文信息的利用率。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Chain-of-Caption框架在RefCOCO/RefCOCOg/RefCOCO+和Ref-L4数据集上取得了显著的性能提升。在不同的IoU阈值下,精度相比基线模型提高了5%到30%。尤其是在Ref-L4数据集上,提升幅度最为显著,表明该框架在处理更复杂的指代表达时具有更强的优势。

🎯 应用场景

该研究成果可应用于智能客服、图像搜索、机器人导航等领域。例如,在智能客服中,可以帮助机器人更准确地理解用户的指令,从而提供更精准的服务。在图像搜索中,可以根据用户的文本描述,更准确地定位图像中的目标对象。在机器人导航中,可以帮助机器人理解人类的指代表达,从而实现更自然的人机交互。

📄 摘要(原文)

Given a textual description, the task of referring expression comprehension (REC) involves the localisation of the referred object in an image. Multimodal large language models (MLLMs) have achieved high accuracy on REC benchmarks through scaling up the model size and training data. Moreover, the performance of MLLMs can be further improved using techniques such as Chain-of-Thought and tool use, which provides additional visual or textual context to the model. In this paper, we analyse the effect of various techniques for providing additional visual and textual context via tool use to the MLLM and its effect on the REC task. Furthermore, we propose a training-free framework named Chain-of-Caption to improve the REC performance of MLLMs. We perform experiments on RefCOCO/RefCOCOg/RefCOCO+ and Ref-L4 datasets and show that individual textual or visual context can improve the REC performance without any fine-tuning. By combining multiple contexts, our training-free framework shows between 5% to 30% performance gain over the baseline model on accuracy at various Intersection over Union (IoU) thresholds.